线性回归的简洁复现

1-torch.utils.data 数据处理

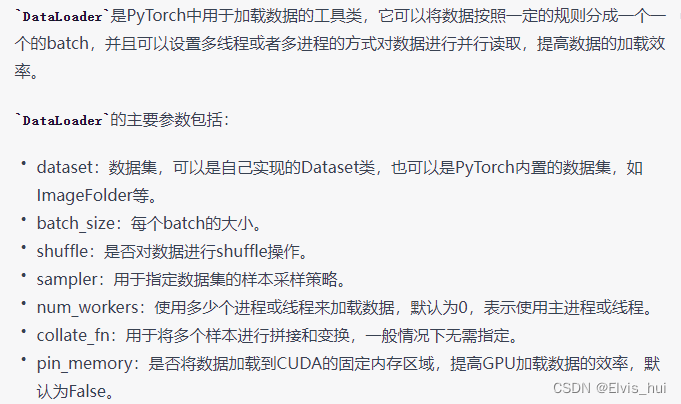

用于读取数据,高效的处理数据方面

from torch.utils.data import DataLoader

dataset = my_dataset()

dataloader = DataLoader(dataset, batch_size=batch_size, shuffle=True, num_workers=4)

for i, batch_data in enumerate(dataloader):

# 处理batch_data

2-torch.nn.Module 模型的定义

写一个自己的网络

from torch import nn

class LinearNet(nn.Module):

def __init__(self,n_feature):

super(LinearNet,self).__init__()

self.linear = nn.Linear(n_feature,1)

#定义前向传播

def forward(self,x):

y = self.linear(x)

return y

net = LinearNet(num_inputs)

print(net)

#输出网络结构

==> LinearNet(

(linear): Linear(in_features=2, out_features=1, bias=True)

)

net.linear#Linear(in_features=2, out_features=1, bias=True)

net.linear.weight

#net[0]这样根据下标访问子模块的写法只有当net是个ModuleList或者Sequential实例时才可以

#这里不允许

3-nn.Sequential 容器搭建网络

利用序列搭建网络,Sequential是一个有序的容器,网络层将按照在传入Sequential的顺序依次被添加到计算图中

# 写法一

net = nn.Sequential(

nn.Linear(num_inputs, 1)

# 此处还可以传入其他层

)

# 写法二

net = nn.Sequential()

net.add_module('linear', nn.Linear(num_inputs, 1))

# net.add_module ......

# 写法三

from collections import OrderedDict

net = nn.Sequential(OrderedDict([

('linear', nn.Linear(num_inputs, 1))

# ......

]))

4-net.parameters() 查看模型学习的参数

net.parameters() 来查看模型所有的可学习参数,此函数将返回一个生成器。

for param in net.parameters():

print(param)

torch.nn仅支持输入一个batch的样本不支持单个样本输入,如果只有单个样本,可使用input.unsqueeze(0)来添加一维。

参数初始化

init.normal_将权重参数每个元素初始化为随机采样于均值为0、标准差为0.01的正态分布。

偏差会初始化为零。

from torch.nn import init

init.normal_(net[0].weight, mean=0, std=0.01)

init.constant_(net[0].bias, val=0)

# 也可以直接修改bias的data: net[0].bias.data.fill_(0)

6-线性回归代码实现

import torch

import numpy as np

import torch.utils.data as Data

from torch.nn import init

#创建数据集

true_w = [2, -3.4]

true_b = 4.2

X = torch.tensor(np.random.normal(0,1,(1000,2)),dtype=torch.float)

Y = true_w[0]*X[:,0]+true_w[1]*X[:,1]+true_b

Y += torch.tensor(np.random.normal(0,0.01,size=y.size()),dtype=torch.float)

#读取数据集

batch_size=10

dataset = Data.TensorDataset(X,Y)#将训练集的特征和标签组合

data_iter = Data.DataLoader(dataset,batch_size,shuffle=True)#随机读取小批量

#定义模型

net=torch.nn.Sequential(torch.nn.Linear(2,1))

#参数初始化

init.normal_(net[0].weight,0,1)

init.constant_(net[0].bias,0)

#定义损失函数 优化器

loss=torch.nn.MSELoss()

optimizer = torch.optim.SGD(net.parameters(),lr=0.01,momentum=0.9)

num_epocs=10

for epoch in range(1,num_epochs+1):

for X,y in data_iter:

y_pre=net(X)

l = loss(y_pre,y.view(-1,1))

optimizer.zero_grad()#梯度清零

l.backward()#反向传播

optimizer.step()

print('epoch %d,loss:%f'%(epoch,l.item()))

print(true_w ,net[0].weight)

print(true_b ,net[0].bias)

6186

6186

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?