1. 引言:金融市场中的情感分析新视角

在当今数字化时代,社交媒体平台上的信息传播速度极快,影响力也日益增强。一条来自公众人物的推文就可能在几分钟内引发全球市场数十亿美元的资金流动。随着市场的发展,投资者群体的心理和行为对市场走势的影响愈发显著。投资者情绪通常反映在推特等社交媒体平台上,成为市场预期的代理指标。金融情感分析(FSA)旨在量化这些情绪,并将其分类为看涨(Bullish)、看跌(Bearish)或中性(Neutral),以预测市场走势。然而,传统的 FSA 方法在将情绪分类转化为可操作的交易洞察方面面临诸多挑战:

-

情绪分类缺乏精确性和可解释性:例如,“看涨”标签可能意味着未来五天内价格小幅上涨 2%,也可能是未来一个月内大幅上涨 10%。这种模糊性使得基于此类信号的清晰交易策略难以建立。

-

传统 FSA 依赖人工标注的情绪标签:这些标签嵌入了对文本市场影响的主观解释,往往与历史市场反应相背离,导致情绪感知与可衡量的结果之间存在差距。

-

金融推文与传统文本数据存在显著差异:其特点包括简洁性、特定领域的行话以及对实时事件的引用。忽略这些背景信息会削弱情感分析在预测市场趋势方面的相关性。

为了解决这些局限性,本文提出了一种全新的 FSA 方法,该方法侧重于可衡量的市场反应,而非推断的意图。

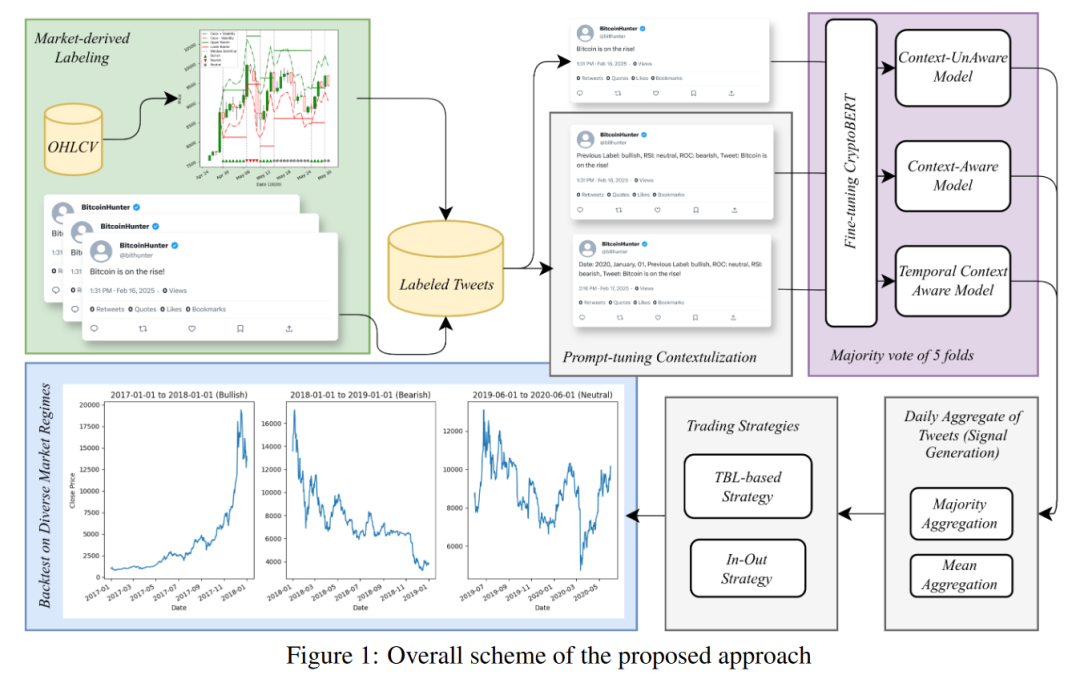

2. 核心创新点:市场驱动标签与上下文增强的提示微调

本文的核心创新点在于以下两个方面:

(1) 市场驱动标签 (Market-Driven Labeling)

本文摒弃了传统 FSA 中依赖人工标注的主观情绪标签,转而采用市场驱动标注方法。该方法直接将标签与随后的市场走势挂钩,具体步骤如下:

-

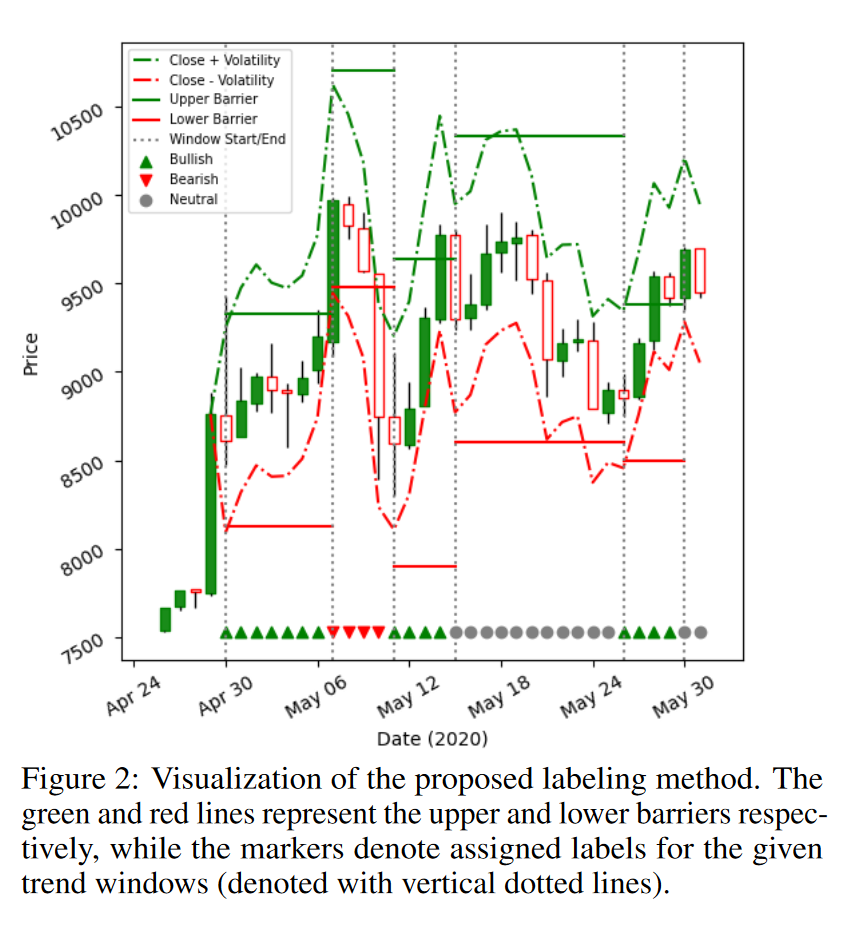

市场反应量化: 推文发布后的短期价格趋势被用来定义标签。例如,如果推文发布后的 8 到 15 天内价格达到设定的盈利阈值,则将该推文标记为“看涨”;如果价格跌破止损阈值,则标记为“看跌”;如果两者都未达到,则标记为“中性”。

-

动态调整机制: 为了适应市场波动性,盈利和止损阈值会根据历史波动率进行动态调整。历史波动率采用指数加权移动平均 (EWMA) 方法计算,公式如下:

其中, 表示时间 时的收盘价, 表示时间 时的 EWMA 波动率, 是平滑因子, 是窗口长度(本研究设为 30 天), 是数据集中最大项数。

-

标签分配: 根据以下规则分配标签:

-

如果在达到垂直屏障(时间限制)之前,价格达到或超过上限屏障,则分配“看涨”标签。

-

如果在达到垂直屏障之前,价格跌破下限屏障,则分配“看跌”标签。

-

如果在达到垂直屏障之前,两者都未达到,则分配“中性”标签。

这种市场驱动标签方法的优势在于:

-

更贴近市场行为: 标签直接反映了实际的市场反应,而非主观的情绪感知。

-

与交易实践相一致: 通过整合止盈、止损和时间限制,该方法更符合现实世界的交易实践。

-

减少前视偏差: 标签的分配仅依赖于截至当前时间点的信息,避免了前视偏差。

(2) 上下文增强的提示微调 (Context-Enhanced Prompt Tuning)

为了使语言模型能够更好地捕捉文本信号与市场动态之间的关系,本文采用了提示微调技术,并引入了市场和时间上下文信息:

-

市场上下文: 将关键的市场指标(如价格趋势和波动率指标)直接嵌入文本提示中。例如,提示可能包含前一个标签、ROC(变化率)、RSI(相对强弱指数)等信息。

-

时间上下文: 将推文的日期信息添加到提示中,以增强模型对特定时间市场条件的敏感性。

通过这种方式,模型能够更好地识别文本内容、市场指标和时间动态之间的复杂关系,从而提高预测准确性。

3. 方法论:数据收集、模型构建与策略评估

3.1 数据收集

本文构建了包含以下数据集的多方面基础,以支持基于情绪和技术指标的市场趋势预测:

-

比特币历史事件: 包含 2009 年至 2024 年间的 227 个重大比特币市场事件,重点关注 2015 年至 2023 年间具有影响力的时期。该数据集用于在关键日期(尤其是高市场波动或重大新闻周期期间)评估模型性能。

-

推文数据: 从两个来源收集了 2015 年至 2023 年初的推文数据,并进行了预处理,包括文本规范化、表情符号和主题标签提取、促销内容删除等。

-

技术指标: 从 OHLCV 数据中计算得出相对强弱指数 (RSI) 和变化率 (ROC),并将其用作提示微调的技术指标。

3.2 模型构建

本文提出了三种语言模型分类器,用于预测短期市场趋势:

-

上下文无关模型 (CUA): 在市场驱动标签上对 CryptoBERT 模型进行微调,以检测与市场趋势相关的推文内容模式。

-

上下文感知模型 (CA): 在 CUA 模型的基础上,通过提示工程将市场上下文信息(如前一个标签、ROC 和 RSI)作为文本输入添加到模型中。

-

时间上下文感知模型 (TCA): 在 CA 模型的基础上,进一步将推文的日期信息添加到提示中,以增强模型对时间特定市场条件的敏感性。

3.3 信号生成与回测策略

为了将推文分类转化为可操作的交易信号,本文提出了两种信号生成方法:

-

多数投票法: 确定给定日期内的多数情绪类别,并将其作为当天的信号。

-

均值法: 对一天内编码的类值进行平均,并根据阈值确定整体每日信号。

此外,本文还提出了三种主要的策略来评估情绪驱动交易信号的有效性:

-

TBL 策略: 使用基于波动率的动态屏障(止盈和止损水平)来定义交易决策,允许根据市场条件进行自适应交易。

-

进出策略: 使用聚合的每日信号来确定进场和出场点,包括做多和做空两种策略。

-

买入并持有策略: 作为基准策略,用于比较所提出方法的性能。

4. 结果:模型性能与策略评估

4.1 推文分类评估

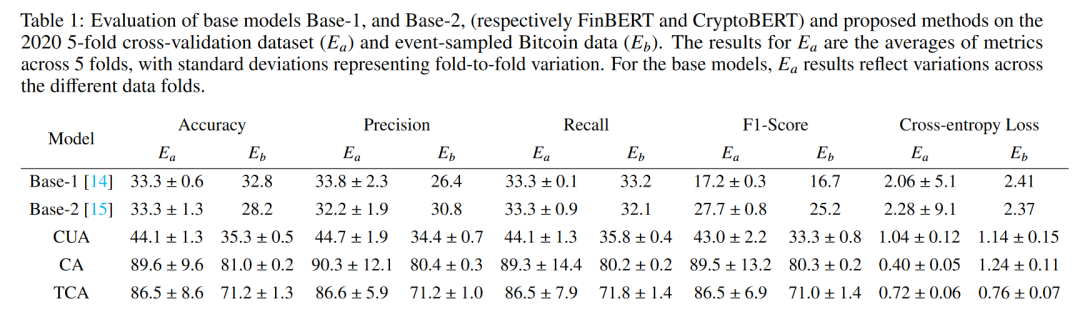

实验结果表明:

-

传统的基于情绪的模型(FinBERT 和 CryptoBERT)在预测短期市场趋势方面表现不佳,在测试集上的 F1 分数分别仅为 17.2% 和 27.7%。

-

上下文无关模型 (CUA) 在市场驱动标签上进行微调后,性能显著提高,在测试集上的 F1 分数达到 43.0%。

-

上下文感知模型 (CA) 通过将市场上下文信息作为文本输入添加到提示中,进一步提高了性能,在测试集上的 F1 分数达到 89.5%。

-

时间上下文感知模型 (TCA) 在 2020 年数据集上的表现良好,但在事件采样数据集上的表现有所下降,表明其可能存在过拟合风险。

这些结果验证了市场驱动标签和上下文增强提示微调的有效性,证明了语言模型在整合市场上下文信息后,可以作为端到端的短期趋势预测器。

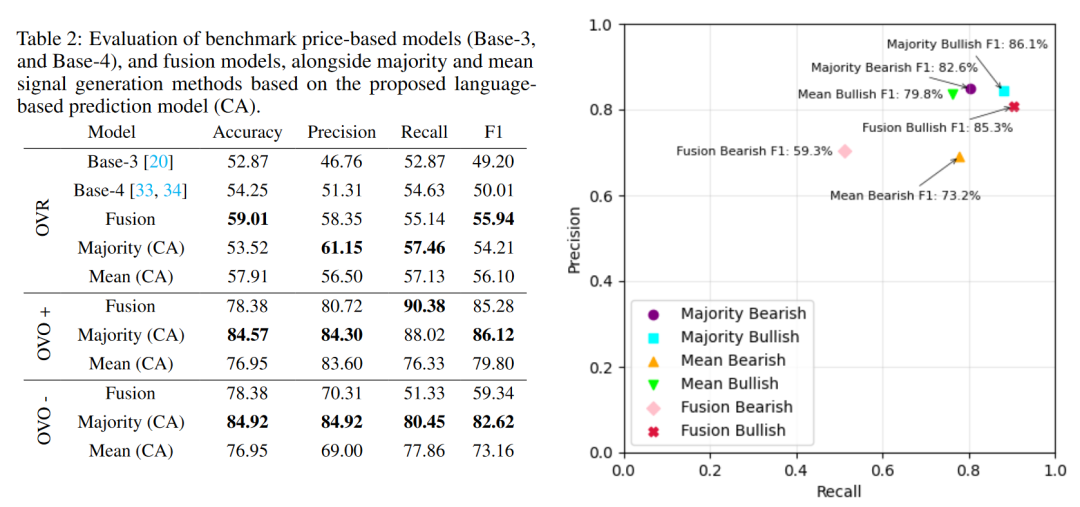

4.2 信号生成

实验结果表明:

-

多数投票法聚合的 CA 模型在测试集上的 F1 分数为 54.21%,优于基于价格的 LSTM 模型 (49.20%) 和自编码器模型 (50.01%)。

-

融合模型结合了 CA 模型的预测、情绪比率和基于价格的预测,在 Bullish 场景下表现良好,但在 Bearish 场景下表现不佳。

-

混淆矩阵分析表明,该模型避免了 Bullish 和 Bearish 标签之间的高影响错误,大多数错误发生在将 Bullish 或 Bearish 标签预测为中性时,这有助于在不确定的情况下避免过于激进的交易信号。

这些发现证明了所提出方法在动态市场环境中的适应性,以及其作为可靠的端到端预测模型的能力。

4.3 交易策略

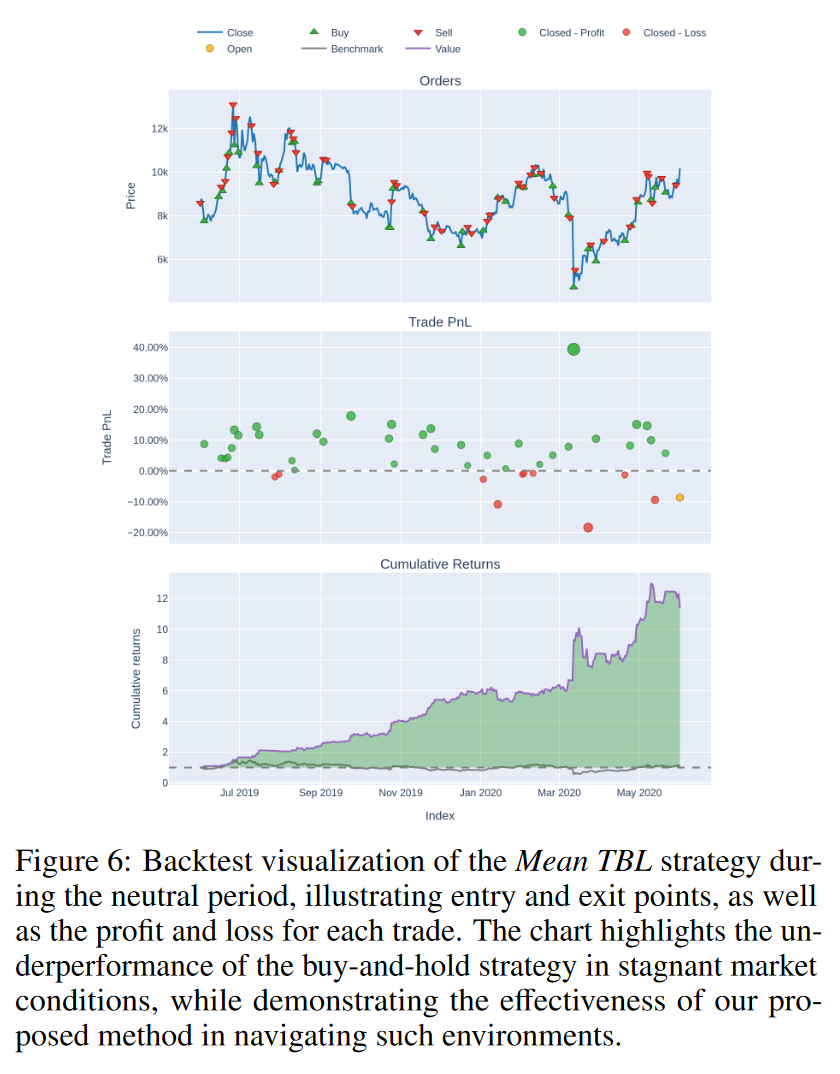

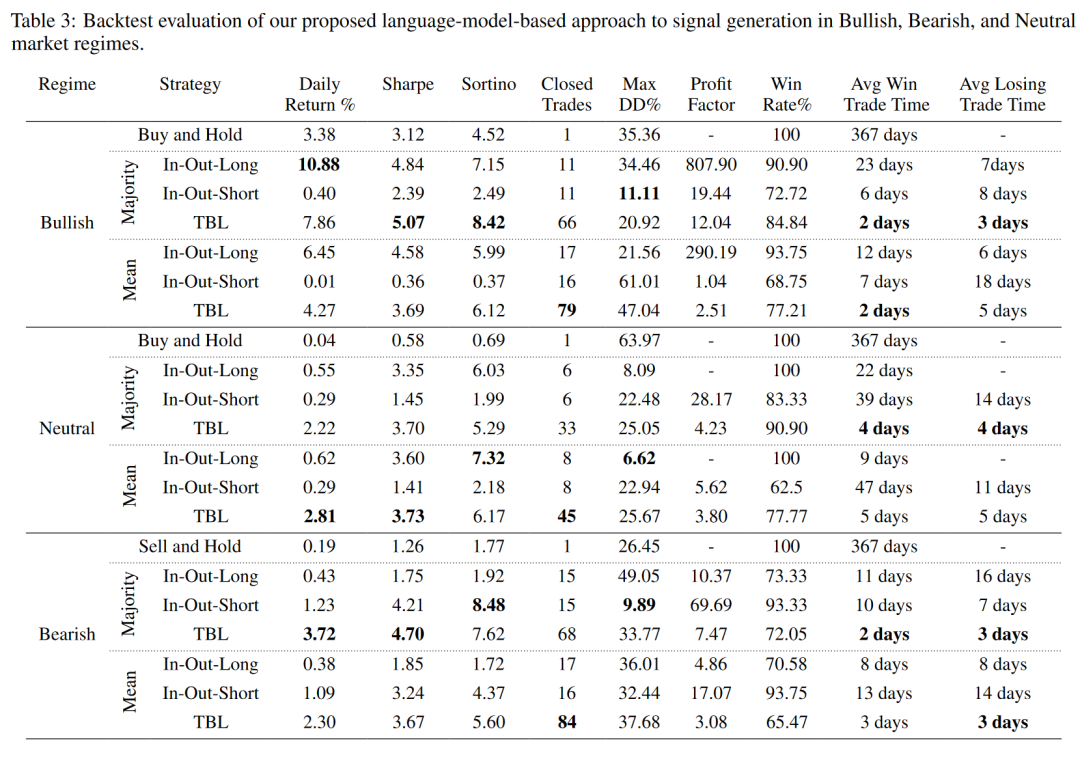

回测结果表明:

-

在牛市期间,基准买入并持有策略的夏普比率 (Sharpe Ratio) 为 3.14,而四种提出的策略的夏普比率均超过这一水平。

-

在熊市和横盘期间,所有提出的策略均优于基准策略。

-

TBL 策略在所有市场制度下均表现出色,尤其是在横盘市场制度下,其夏普比率达到 3.73,显示出在停滞市场中获利的能力。

-

多数投票法和均值法在整体结果上相当,但多数方法在趋势市场中表现更好,而均值方法在横盘市场中表现更好。

这些结果证明了语言模型驱动的预测在回测环境中的实用性和稳健性。

5. 讨论:局限性与启示

5.1 局限性

-

该方法假设每条推文对市场都有直接的短期影响,这可能过于简化了社交媒体活动与市场走势之间复杂且往往是间接的关系。

-

特定文本模式与市场趋势之间的关联可能是短暂的,需要频繁更新模型以保持性能。

-

依赖提示工程可能会导致过拟合,因为模型可能会过度适应训练数据模式,从而限制其泛化到新数据的能力

5.2 启示

-

本研究强调了将情感分析应用于金融市场预测时,需要更加注重上下文感知和市场聚焦的方法。

-

整合市场上下文信息对于提高预测性能至关重要,将关键市场指标嵌入文本提示中,可以使模型更全面地理解影响市场走势的条件。

-

提出的模型能够生成可操作的交易信号,证明了其在现实世界金融决策中的实际效用。

6. 结论

本文证明了基于市场的直接方法在预测比特币短期市场走势方面优于传统的基于情绪的模型。通过使用市场驱动标签并结合市场上下文信息,语言模型可以产生可操作的洞察、生成有效的交易策略,并在高度波动的市场中管理风险。

如何学习AI大模型 ?

“最先掌握AI的人,将会比较晚掌握AI的人有竞争优势”。

这句话,放在计算机、互联网、移动互联网的开局时期,都是一样的道理。

我在一线互联网企业工作十余年里,指导过不少同行后辈。帮助很多人得到了学习和成长。

我意识到有很多经验和知识值得分享给大家,故此将并将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。【保证100%免费】🆓

CSDN粉丝独家福利

这份完整版的 AI 大模型学习资料已经上传CSDN,朋友们如果需要可以扫描下方二维码&点击下方CSDN官方认证链接免费领取 【保证100%免费】

读者福利: 👉👉CSDN大礼包:《最新AI大模型学习资源包》免费分享 👈👈

对于0基础小白入门:

如果你是零基础小白,想快速入门大模型是可以考虑的。

一方面是学习时间相对较短,学习内容更全面更集中。

二方面是可以根据这些资料规划好学习计划和方向。

👉1.大模型入门学习思维导图👈

要学习一门新的技术,作为新手一定要先学习成长路线图,方向不对,努力白费。

对于从来没有接触过AI大模型的同学,我们帮你准备了详细的学习成长路线图&学习规划。可以说是最科学最系统的学习路线,大家跟着这个大的方向学习准没问题。(全套教程文末领取哈)

👉2.AGI大模型配套视频👈

很多朋友都不喜欢晦涩的文字,我也为大家准备了视频教程,每个章节都是当前板块的精华浓缩。

👉3.大模型实际应用报告合集👈

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。(全套教程文末领取哈)

👉4.大模型落地应用案例PPT👈

光学理论是没用的,要学会跟着一起做,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。(全套教程文末领取哈)

👉5.大模型经典学习电子书👈

随着人工智能技术的飞速发展,AI大模型已经成为了当今科技领域的一大热点。这些大型预训练模型,如GPT-3、BERT、XLNet等,以其强大的语言理解和生成能力,正在改变我们对人工智能的认识。 那以下这些PDF籍就是非常不错的学习资源。(全套教程文末领取哈)

👉6.大模型面试题&答案👈

截至目前大模型已经超过200个,在大模型纵横的时代,不仅大模型技术越来越卷,就连大模型相关的岗位和面试也开始越来越卷了。为了让大家更容易上车大模型算法赛道,我总结了大模型常考的面试题。(全套教程文末领取哈)

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习

CSDN粉丝独家福利

这份完整版的 AI 大模型学习资料已经上传CSDN,朋友们如果需要可以扫描下方二维码&点击下方CSDN官方认证链接免费领取 【保证100%免费】

读者福利: 👉👉CSDN大礼包:《最新AI大模型学习资源包》免费分享 👈👈

490

490

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?