-

Boosting 思想

当每个弱分类器的分类效果不理想时,我们可以尝试将多个不同的弱分类器组合起来,形成效果更好的强分类器。Boosting 着重于减小模型的 bias。Boosting 与 Bagging 的区别如下:

为何说 Bagging 是减小 Variance,Bagging 是减小 bias?

在 Bagging 中,对样本重采样,每个子样本训练一个强(甚至过强)模型,最后取平均。由于子样本之间的相似程度高,多个模型的类型、结构与分布也非常相似,故多个模型有着近似的效果。而经过 Bagging 后,可以有效减小子模型的过拟合情况,因此可以显著降低模型的 Variance。 在 Boosting 中,把许多个弱分类器组合成一个强的分类器,着重于提高弱模型的性能,即着重降低模型的 bias。而 Variance 则不在 Boosting 的考虑范围之内。在 Boosting 中,多个模型有着同样的优化目标,并且通过在每一轮中的不断优化,能够达到降低 bias 的目的。

-

样本选择上,Bagging 在每次训练中是通过 Bootstrap 有放回选取不同的数据,每轮训练的数据集是独立的;Boosting 中每轮的训练集不变,只是训练集中每个样本的权重在训练中发生变化,样本的权重根据上一轮的分类结果进行调整。

-

模型预测上,Bagging 中每个模型的权重相等,通过投票或取均值的方式进行结合;Boosting 中每个弱分类器都有对应的权重,对于分类误差小的分类器分配更大的权重。

-

计算方式上,Bagging 的各个模型可以并行训练;Boosting 中每个模型只能串行训练,因为后一个模型的样本权重需要通过上一轮的训练结果来调整。

-

Bagging 着重于减小模型的 Variance;Boosting 着重于减小模型的 bias。

-

-

XGBoost 基本原理

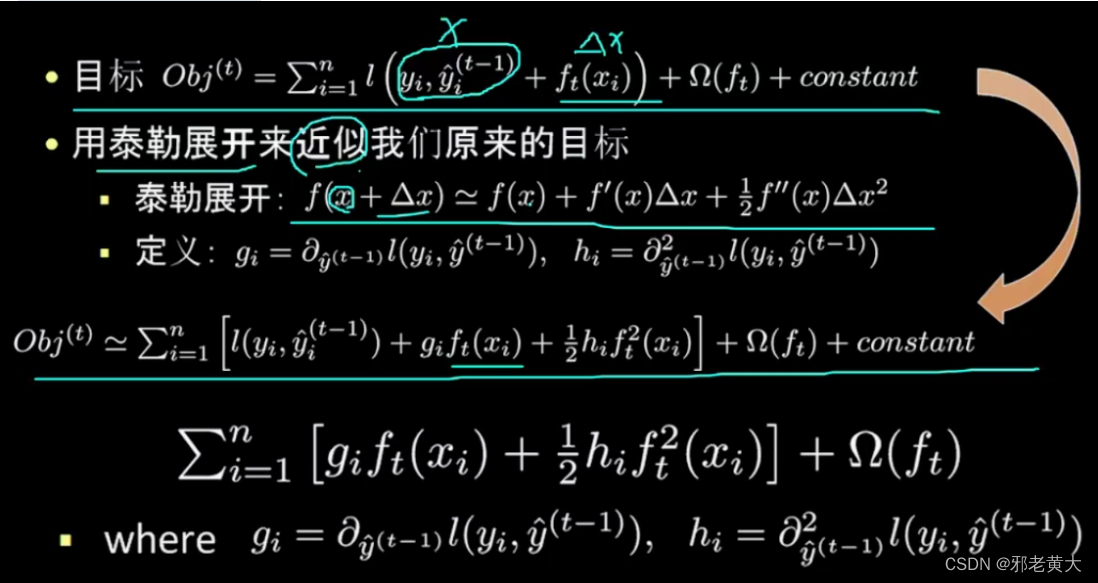

在第 $t$ 轮训练中,在保留前 $t-1$ 轮训练结果的前提下,加入一棵树 $f_t$,使得目标函数尽可能地降低。用公式表达如下:

$$

\begin{aligned} Obj_t & = \sum_{i=1}^n l(y_i, \hat{y}_i^t) \\ & = \sum_{i=1}^n l(y_i, \hat{y}_i^{t-1} + f_t(x_i)) \\ \end{aligned}

$$设损失函数为 MSE,则原目标函数写为:

$$

\begin{aligned} Obj_t &= \sum_{i=1}^n (y_i - (\hat{y}_i^{t-1} + f_t(x_i)))^2 \\ & = \sum_{i=1}^n[2(\hat{y}_i^{t-1} - y_i)f_t(x_i)+f_t(x_i)^2] + \sum_{i=1}^n ({y_i - \hat{y}_i^{t-1}})^2 \end{aligned}

$$其中,$\sum{i=1}^n ({y_i - \hat{y}i^{t-1}})^2$ 与本轮无关,可以视为常数,$(\hat{y}_i^{t-1} - y_i)$ 一般被叫做残差,表示了上一轮预测值与真实值之间的差异,也是 XGBoost 算法在每一轮中预测的主要目标。即,将上一轮的训练结果看作一个整体,而新的一轮则对残差值进行预测。

-

此外,XGBoost 在每个叶子节点上都增加了正则化项 $\Omega(f_t) = \gamma T + \lambda\frac{1}{2}\sum^T{j=1} w_j^2$,其中,$T$ 代表叶子节点数量,$\lambda\frac{1}{2}\sum^T{j=1} w_j^2$ 为 L2 正则化项。

4875

4875

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?