Adaptive aggregation with self-attention network for gastrointestinal image classification

-

【IET Image Processing】

-

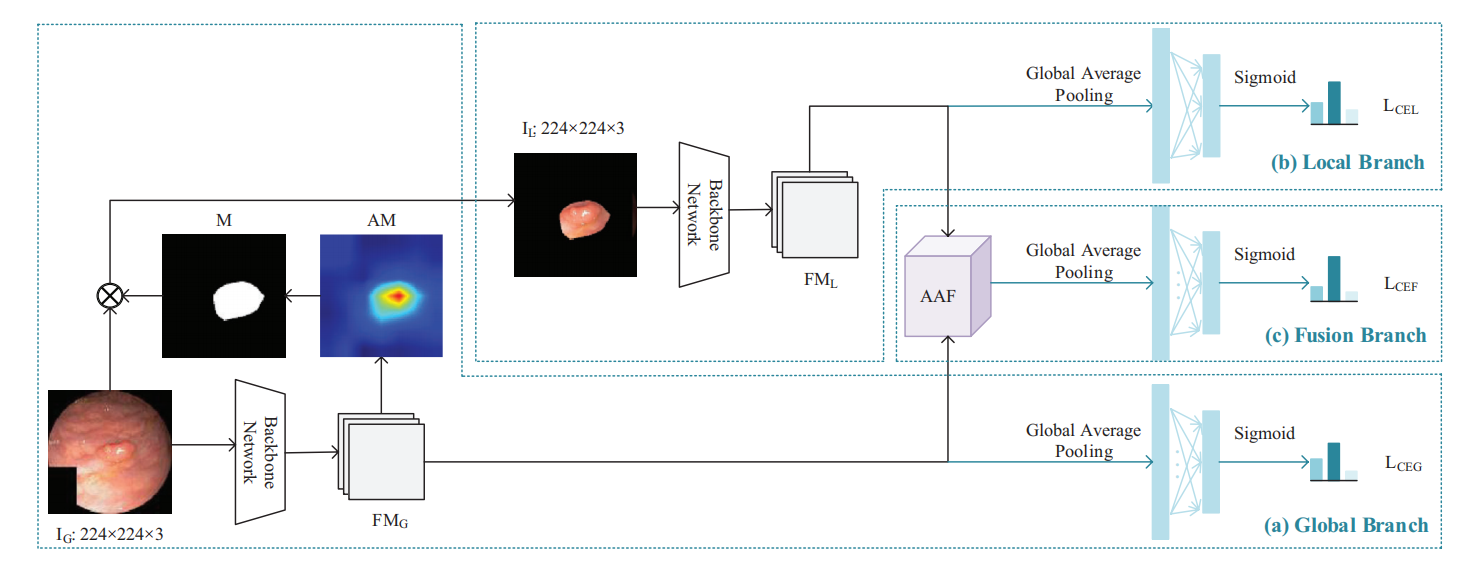

简介:提出了一种基于自注意网络的自适应聚合方法(Adaptive aggregation with self-attention network , AASAN),其包括了一个全局分支、一个局部分支和一个融合分支,全局分支获取整个图像的全局特征并定位可能的病变区域,局部分支提取病变区域的局部特征,融合分支综合考虑整体特征和局部特征,实现了内镜图像自动分类。实验得到模型的分类准确率为96.37%

-

关键技术

1.具有相对位置编码的自注意模块(SA-RPE),可以通过在更大范围的病变区域内提取邻域信息来捕获长期依赖关系。

2.自适应聚合特征模块(AAF),在全局特征和不同维度的局部特征之间进行软选择,可以根据分类任务自适应地学习适当的权值,并自动整合更有判别的特征,以提高网络的分类能力。

-

网络评价

1.在Kvasir公开数据集上进行消融实验,得到文章提出的方法总体准确率在96.37%,证明了SA-RPE和AAF模块的有效性。

2.大多数错误分类的图像集中在息肉和溃疡图像之间,因为有时息肉和溃疡图像在临床表现上非常相似。

3.将文章提出的方法与DenseNet、SEnet、CBAM等深度学习方法进行比较实验,结果显示文章提出的AASAN更具优势。

文章提出了一种AASAN方法,包含全局、局部和融合分支,用于胃肠内镜图像分类。通过SA-RPE模块捕获长期依赖关系,AAF模块自适应整合特征,提高分类准确率至96.37%。与DenseNet等对比,AASAN表现更优,尤其在息肉和溃疡图像区分上具有挑战性。

文章提出了一种AASAN方法,包含全局、局部和融合分支,用于胃肠内镜图像分类。通过SA-RPE模块捕获长期依赖关系,AAF模块自适应整合特征,提高分类准确率至96.37%。与DenseNet等对比,AASAN表现更优,尤其在息肉和溃疡图像区分上具有挑战性。

5200

5200

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?