一、相同点

torch.nn.Softmax()和torch.nn.functional.softmax()函数都是用于计算softmax函数的输出,将输入的值转换为概率分布。

二、不同点

1.torch.nn.Softmax()的用法

torch.nn.Softmax()是一个类,在神经网络的模型中使用,通常作为一个层(layer)添加到模型中

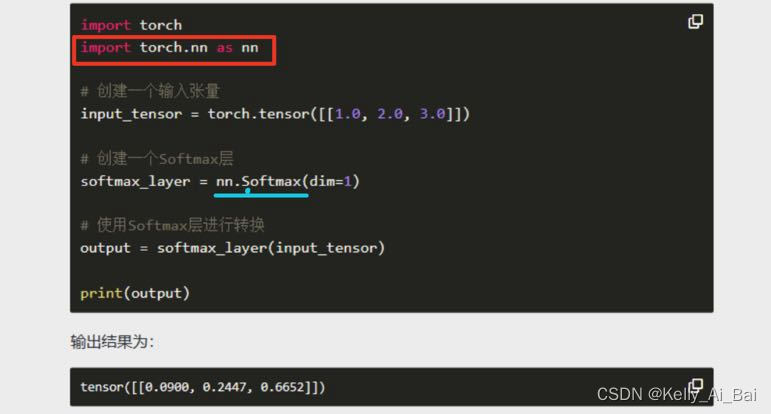

下面是一个使用torch.nn.Softmax()的示例:

2.torch.nn.functional.softmax()的用法

是一个函数,可以直接调用,通常在模型的前向传播过程中使用

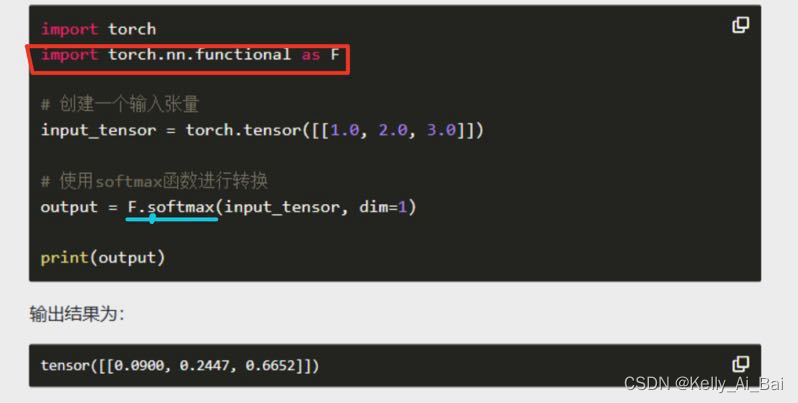

下面是一个使用torch.nn.functional.softmax()的示例:

无论是使用 torch.nn.functional.softmax() 还是 torch.nn.Softmax(),功能都是一样的,都是将输入的值转换为概率分布

只是使用的方式不同:torch.nn.Softmax()作为一个层添加到模型中, torch.nn. functional.softmax()作为一个函数直接调用

9万+

9万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?