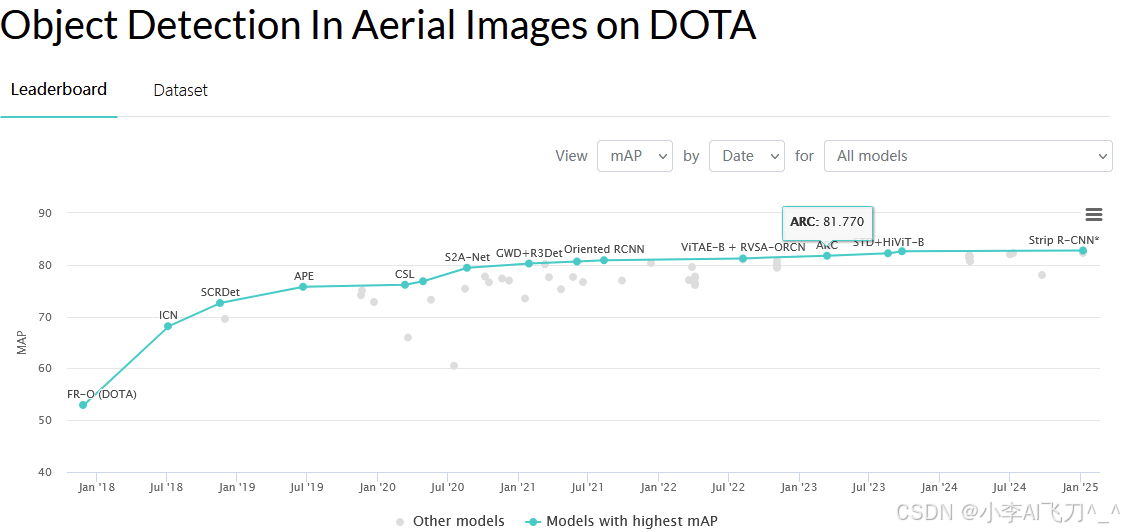

这是南开大学继LSKNet后的又一力作,是遥感目标检测的新SOTA。主要思想是针对遥感影像中长宽比较大的目标,采用了条状卷积进行特征提取,同时解耦了检测头,并在定位头中引入了条状卷积,以增强对目标的定位能力。

- 论文题目:《Strip R-CNN: Large Strip Convolution for Remote Sensing Object Detection》

- 论文地址:https://arxiv.org/pdf/2501.03775v1

- 代码地址(基于mmrotate-0.x系列):GitHub - HVision-NKU/Strip-R-CNN: Offical implementation of "Strip R-CNN: Large Strip Convolution for Remote Sensing Object Detection"

- 基础知识:Oriented R-CNN、LSKNet

一、引言

1. 【问题发现】遥感目标检测中,精确检测大的长宽比目标仍然是一种挑战。通过实验发现,现有的目标检测方法在处理细长目标时往往表现不佳,检测性能随着目标宽高比的增加而下降。

2. 【原因分析】检测大长宽比目标的难点有两方面。首先,大长宽比的目标在一个空间维度上包含丰富的特征信息,而在另一个维度上则表现出相对稀疏的特征。方形卷积难以有效捕捉遥感图像中各向异性上下文信息的能力,还容易引入了周围区域的无关信息。其次,大长宽比的目标其独特的几何特性,定位时的精确回归难度大,相对自然图像的目标检测,大长宽比目标的角度估计中的小误差也可能导致与真实值(ground truth)的显著偏差。

3. 【已有方法的不足】先前方法中广泛采用的一种通用方法是使用大核卷积(large-kernel convolutions)来扩大模型的感受野。例如,LSKNet引入了具有空间选择机制的大核卷积来捕捉长距离上下文信息。PKINet进一步扩展了LSKNet,并提出了多分支结构以增强对目标尺度变化的检测能力。然而,利用多个大核卷积的并行范式加剧了计算负担,复杂的模块设计又会进一步限制模型的效率。

4. 【本文思路】本文的设计原则有两点:首先,新的网络架构应简单高效;其次,应擅长处理不同长宽比的目标,尤其是大长宽比的目标。考虑到遥感图像中目标的特性,本文使用正交的large strip convolution(条状卷积)作为主要空间滤波器,这也是本方法的核心组件——Strip module。

此外,为了克服大长宽比目标的定位问题,本文解耦了检测头,并通过提出的Strip Module增强了定位分支。实验发现,这不仅有助于提高定位能力,还能更准确地回归边界框的角度。

本文提出的方法能够高效结合方形卷积和条状卷积的优势,同时减少特征冗余。在DOTA、FAIR1M、HRSC2016和DIOR等数据集上的广泛实验也展示了本文方法的优越性。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

600

600

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?