注:本周笔者阅读了龚雪鸾、陈艳娇的文章ATTEQ-NN:Attention-based QoE-aware Evasive

Backdoor Attacks。本文讲了作者设计的一种基于注意力机制的后门攻击:ATTEQ-NN

Content

1.abstract&introduction

2.background and related work

3.problem scope and threat model

4.attack methodology

5.implementation and evaluation

abstract&introduction

首先,作者简要介绍在普遍使用神经网络的大背景下,由于用户自身无能进行训练,绝大部分用户选择云平台提供的训练模型的现状。在这种情况下,后门攻击者便有了可乘之机,通过这个用户无法掌握的训练过程植入后门,在触发情况下扰乱模型的判断结果。

由于现行模型中,可见的后门攻击易被察觉,不可见的后门攻击“毒性”比较低。而本文作者抓住现行DNN注意力机制的特点,设计了一个基于注意力机制的后门攻击:ATTEQ-NN

在这里,作者对三个问题进行了解答:

1.如何生成一个触发器来有效地激活模型中的后门?

How to generate a trigger that can effectively excite the backdoor in the model?

作者认为现有的触发器设计没有充分发挥其强化攻击效果的功能。掩码用于确定触发器位置和形状,而现有工作一般随机定掩码,这就使得触发后门效率受到了影响。作者设计一种新的基于注意的触发掩码确定方法。由于DNN模型关注的是图像的重要区域(如人脸),过滤掉图像中不相关的区域(如背景),从而做出更准确的判断,因此图像中不同的区域对预测结果的影响程度不同。所以作者根据属于目标误分类标签的样本的注意映射来计算获取触发掩码。通过这种方式,生成的触发器可以强烈地驱动模型输出朝向目标标签。

2.如何将触发器融入其中以逃避目视检查?

How to naturalize the trigger to evade visual inspections?

在第一个回答中作者提及要将掩码控制触发器放在“注意力最集中” 的地区,但这样也就增大了触发器暴露的几率。为了解决这一问题,作者在触发生成的损失函数中引入了体验质量(Quality - experience, QoE)这一个概念,用于衡量原图像和扭曲后的图像对用户而言体验的差异。

3.如何注入后门来实现有效的规避攻击?

How to inject the backdoor to realize effective and evasive attacks?

实际上这里问的就是怎么在保证高成功率的前提下逃避现行防御策略。在大多数情况下,较高的毒比(中毒样本与所有再训练样本的比值)会导致较高的攻击成功率,但可能扭曲决策边界,从而使元分类器能够区分良性模型和后门模型。因此,作者设计了一种交替再训练策略,它有利于提高干净数据的准确性,同时能帮助逃避现行防御策略。

background and related work

这一部分,作者分了三部分进行介绍:DNN、后门攻击、现行防御策略

A.DNN

作者简述了DNN的工作原理,在此前的文章中也都基本有所提及,在此不再赘述。(详见:神经网络基础学习笔记_Stetman的博客-CSDN博客)

B.Backdoor Attacks

后门攻击是在训练阶段针对神经网络的攻击。这一部分作者从几个方面介绍了后门攻击:

攻击者:一般为数据供应商或模型供应商。前者通过提供有毒训练集,通过有毒训练数据实现决策边界的波动完成攻击;后者通过控制用户无法触及的训练过程植入后门。

触发器设计:触发器设计上分为模型无关的触发器或与模型相关的触发器。相关的指触发器是根据模型设计的,无关则为触发器是从普适型中随便选取的。一般情况下,模型相关的触发器成功率高,也不容易被发现,但对权限的要求也更多。

神经元的选择:一般会选远离输出层权重和最大的神经元(详见Stetman读peper小记:Defense-Resistant Backdoor Attacks Against DeepNeural Networks in Outsourced Cloud_Stetman的博客-CSDN博客中的触发生成小节关于神经元选取的介绍),这类神经元活性高、权重大:活性高可以提高攻击成功率、权重大可以避免被修剪。神经元选择后,通过梯度下降生成触发器,使所选神经元的激活最大化。

学习场景:后门攻击的学习场景分为集中式学习场景和联邦学习场景。在联邦学习场景中,攻击者可以很大一部分参与者。集中学习中攻击者能够控制中心聚合器。如果攻击者能够控制参与者,则攻击者控制的一个或多个恶意参与者旨在通过操纵本地模型向全局模型注入后门,但如此会存在挑战,良性参与者的更新会稀释触发因素。因此,为了使后门在全局模型中的效果最大化,参与者协调触发器生成和后门注入是很重要的。

C. Backdoor Defenses

根据不同的后门攻击,现行防御策略也分为基于数据的防御与基于模型的防御。

基于数据的防御:其本质为检查输入样例是否包含触发器。以STRIP为例,它多次复制输入样本,并将每个副本与不同的样本相结合,生成一组受干扰的样本。如果样本是良性的,则期望扰动样本的预测结果是随机的,即具有高熵。而如果是有毒数据,则他的目标标签的出现几率会高于正常值,即表现为低熵(集中于目标标签)。因此依据此法可以检验训练数据是否存在毒性。

基于模型的防御:本质为检查模型是否包含后门。如ABS,一种基于在线模型的防御,它利用脑电刺激(EBS)扫描目标模型,以确定它是否是后门。又如neuralcleanup (NC),它是通过创建触发器来排查触发器的方法。它通过为每个预设类创建一个触发器,若有个别类创建触发器的训练远远小于其他,那么可以认定该类下存在触发器。其他的还有MNTD,SCAn在此不过多赘述。

problem scope and threat model

本文的考虑场景:供应商攻击者在集中学习场景中发起的有针对性的后门攻击。

攻击者能力:攻击者能控制训练过程,知道模型结构、参数和超参数。攻击者无法控制客户端用来测试接收到的模型的验证数据集(因此模型应该具有高的干净数据准确性来通过测试)。

攻击目标:模型各方面尽可能与良性模型相似,但在触发时进行错误预测(返回目标标签)。

attack methodology

图中所展示的即为作者设计的攻击方法。

1.后门攻击框架

后门攻击的两个关键组成部分是触发生成和后门注入。首先,根据干净的模型生成与模型相关的触发器。然后,通过用触发器中毒的数据样本重新训练模型注入后门。

生成触发器的过程相当于在给定掩码中寻找最优值分配。首先要找一个神经元作为桥梁。首先确定选择层级,作者没有选择卷积层或池化层,因为这些层中的神经元只与前一层和后一层中的少量神经元相连,因此对输入触发器的响应较弱,对输出结果的影响较小。所以,作者选择全连接层。而全连接层中以第一个影响最大,故取第一个全连接层。选定层级后,为了避开基于修剪的防御,作者认为目标是找到与后门触发器和目标标签都有强烈关联的神经元且要保证在良性样本中其具有一定活性。因此作者在给定目标标签的N组神经元中选取活性最高者并通过梯度下降使所选神经元的激活值最大化,生成触发器。

在获得后门触发δ后,从训练数据集中选择样本子集。对于每个选定的样本(x, y),构造一个中毒样本(xt, yt),其中xt = x⊗(1−M) + δ⊗M,⊗表示元素的乘积,yt是目标标签。将中毒样品与良性样品混合,再训练干净的FV模型进行后门注射,得到后门模型FA。

在攻击者能够操纵触发器和模型的情景下,后门攻击实质上是一种对后门模型不断优化的过程:

其中L(*)表示损失函数,我们有Lδ(xt, x) = ||xt−x||∞= ||δ||∞。ω和λ为常数参数,以平衡清洁数据的准确性和攻击成功率。第一项优化了清洁样本的预测精度。第二项和第三项优化了触发器强制样本的攻击成功率,同时约束了触发器可见性。

2.基于注意力机制的掩码选择

在构筑触发器前,我们要设计一个掩码,用于约束触发器的形状、大小和位置。

何谓掩码?掩码是一个矩阵,其行数和列数与原始图像样本的高度和宽度一致。矩阵中的元素的值要么为1(表示触发区域),要么为0(表示非触发区域)。

在现有的后门攻击中,触发器通常采用矩形、标志(如苹果标志)或水印的形状,触发器位置通常设置为图像的右/左下/上角。触发器越大产生的攻击成功率越高,但更容易被发现。因此,触发器大小通常被设置为整个图像大小的一小部分。不幸的是,这种相对随意设计触发器掩码的方法会限制触发器的有效性。

由于现行注意力机制是关注相同的关键特征,因此对重要像素的处理更容易使分类结果发生偏离。所以作者认为选择最显著的像素作为触发掩码并在此基础上生成强大的触发器能获得更好的攻击性能。

作者利用剩余注意网络(RAN)来获取注意地图。

(如下图,RAN是一个具有成堆注意模块的前馈CNN,在残差网络中提取特征进行分类。每个注意模块由中继支路T和掩码支路S组成。主干分支处理神经网络的特征,掩码分支通过模仿人类皮层路径来选择特征。RAN结合了自底向上和自顶向下的学习方法,在一个前馈过程中实现了快速前馈处理和自顶向下的注意反馈。)

在RAN中,不同的注意模块起着不同的作用。低层次注意模块减少了背景中不重要特征的影响,高层次注意模块选取了提高分类性能的重要特征。最终的注意模块输出为对应像素的注意权值的注意图。注意力权重表示模型对每个像素的关注程度,反映了每个像素对推动图像预测结果进入某一类的贡献。得到的注意地图的大小与RAN输出的大小相同,但可能与输入的大小不同。作者假设每个样本都有相同的发生概率,故选择最接近平均注意图的注意图来获得一般性结果:

其中Xt是目标标签yt的样本集,

其中Xt是目标标签yt的样本集,![]() 是平均注意地图。

是平均注意地图。

3.基于QoE的触发器

触发器的不可见性对于成功的后门攻击是至关重要的。为了平衡其透明度和攻击成功率,我们在损失函数中引入了QoE概念。

SSIM是一种常用的体验质量QoE指标,

SSIM是一种常用的体验质量QoE指标,

其中,A(x, x '), B(x, x ')和C(x, x ')量化了原始图像x与失真图像x '之间的亮度相似度、对比度相似度和结构相似度,α、β、γ为参数。

我们在损失函数中引入了SSIM:

其中η平衡了攻击成功率和中毒图像的QoE。根据我们大量的实验,我们经验地将η设为0.1。

其中η平衡了攻击成功率和中毒图像的QoE。根据我们大量的实验,我们经验地将η设为0.1。

implementation and evaluation

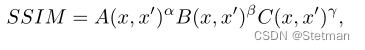

1.较于基线

如上表所示,ATTEQ-NN在所有六个数据集上都比基线具有更高的ASR,特别是在毒比例较小时。 与使用不可见触发器的HB相比,ATTEQ-NN在所有中毒比的所有数据集上实现了显著更高的ASR。对于高分辨率数据集,ATTEQ-NN在VGG-Flower-h和ImageNette上仅以5%和15%的毒比获得了88.82%和83.00%的ASR,远远高于基线。

(随着毒比的增加,ASR会增加,但ATTEQ-NN的CDA会波动,因此,需要根据攻击目标调整毒比。)

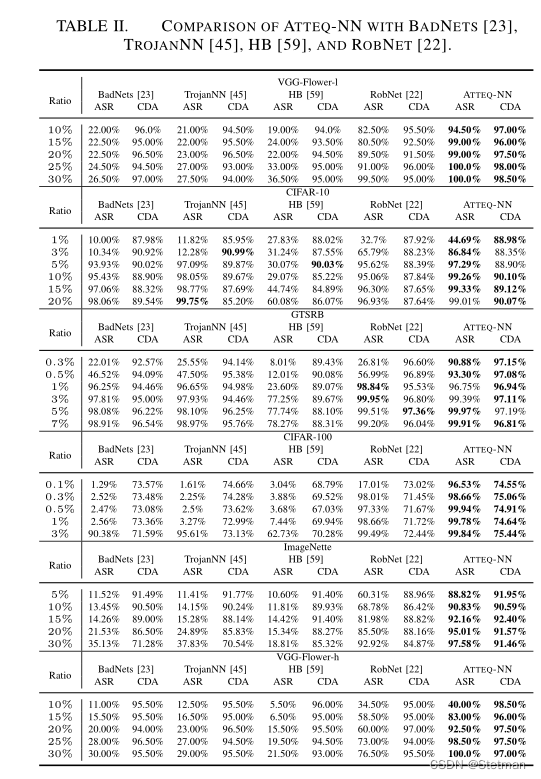

2.目标标签的影响

表III可以看出,ATTEQ-NN在不同目标标签下的攻击性能是稳健的。

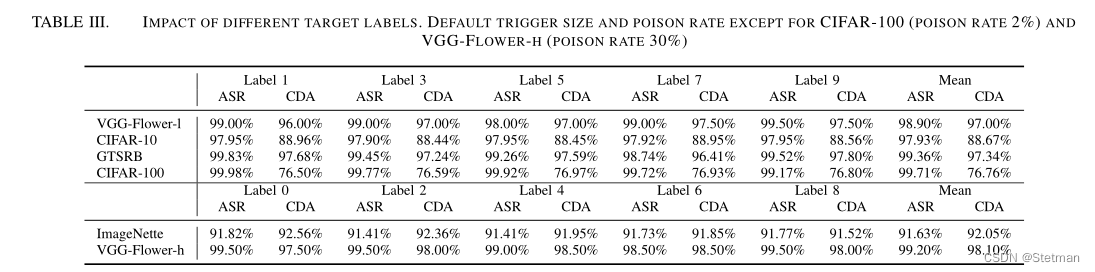

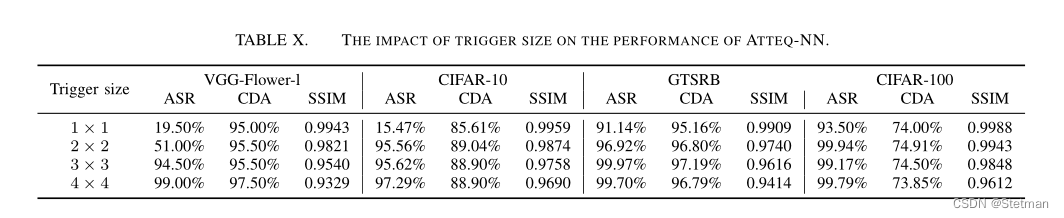

3.Impact of Trigger Size

在ATTEQ-NN中,触发器的像素是由注意机制选择的,因此不一定是连续的。我们可以看到,随着触发器尺寸的增大,ASR也会增大,但后门样本的SSIM值会减小。

4.Impact of Transparency Value

透明度值越高,触发器越难以察觉。随着透明度的增加,后门图像的ASR会降低,但其隐蔽性和QoE会增加。如果VGG-Flower-l、cifr -10、GTSRB、CIFAR100的透明度值设置为0.4 ~ 0.5,ImageNette和VGG-Flower-h的透明度值设置为0.6 ~ 0.7,人眼很难分辨出触发器。

1695

1695

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?