SIFT算法原理及SIFT于关键点匹配的应用

目录

SIFT算法简介

SIFT,即尺度不变特征变换(Scale-invariant feature transform,SIFT),是用于图像处理领域的一种描述,它是由David Lowe发明的。这种描述具有尺度不变性,可在图像中检测出关键点,是一种局部特征描述子。

SIFT算法特点

1.SIFT特征是图像的局部特征,其对旋转、尺度缩放、亮度变化保持不变性,对视角变化、仿射变换、噪声也保持一定程度的稳定性;

2.区分性好,信息量丰富,适用于在海量特征数据库中进行快速、准确的匹配;

3.多量性,即使少数的几个物体也可以产生大量的SIFT特征向量;

4.高速性,经优化的SIFT匹配算法甚至可以达到实时的要求;

5.可扩展性,可以很方便的与其他形式的特征向量进行联合。

SIFT算法可解决的问题

目标的旋转、缩放、平移(RST)

图像仿射/投影变换(视点viewpoint)

弱光照影响(illumination)

部分目标遮挡(occlusion)

杂物场景(clutter)

噪声

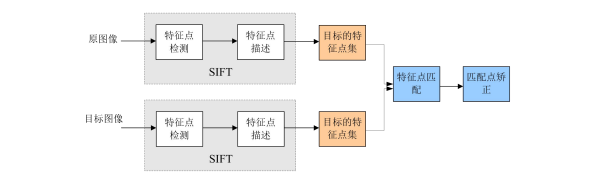

SIFT算法实现特征匹配三个流程

1、提取关键点

2、对关键点附加详细的信息(局部特征),即描述符

3、通过特征点(附带上特征向量的关键点)的两两比较找出相互匹配的若干对特征点,建立景物间的对应关系

SIFT算法的实质可以归为在不同尺度空间上查找特征点(关键点)的问题

基于python2.7的Vlfeat环境配置

在实现SIFT算法之前,我们需要对操作端进行VLfeat的安装,这样才能在上面运行代码。

1、在Vlfeat官网下载需要的安装包

2、解压到自己的anaconda安装路径下,找到Lib\site-packages\PCV\localdescriptors里面的sift.py文件,使用记事本打开。

3、将里面的cmmd路径修改为解压后的vlfeat路径下的sift.exe位置,即可完成安装。

SIFT算法检测感兴趣点与描述子匹配

检测感兴趣点

为了计算图像的SIFT特征,我们用开源工具包VLFeat来辅助检测。下面为sift与Harris对比的源代码。

# -*- coding: utf-8 -*-

from PIL import Image

from pylab import *

from PCV.localdescriptors import sift

from PCV.localdescriptors import harris

# 添加中文字体支持

from matplotlib.font_manager import FontProperties

font = FontProperties(fname=r"c:\windows\fonts\SimSun.ttc", size=14)

imname = '../data/empire.jpg'

sift.process_image(imname, 'empire.sift')

l1, d1 = sift.read_features_from_file('empire.sift')

figure()

gray()

subplot(131)

sift.plot_features(im, l1, circle=False)

title(u'SIFT特征',fontproperties=font)

subplot(132)

sift.plot_features(im, l1, circle=True)

title(u'用圆圈表示SIFT特征尺度',fontproperties=font)

# 检测harris角点

harrisim = harris.compute_harris_response(im)

subplot(133)

filtered_coords = harris.get_harris_points(harrisim, 6, 0.1)

imshow(im)

plot([p[1] for p in filtered_coords], [p[0] for p in filtered_coords], '*')

axis('off')

title(u'Harris角点',fontproperties=font)

show()

效果图如下所示:

为了将sift和Harris角点进行比较,将Harris角点检测的显示在了图像的最后侧。正如你所看到的,这两种算法选择了不同的坐标。

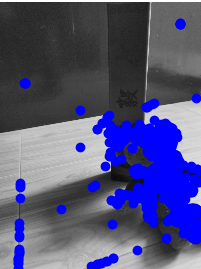

通过实拍的8张小场景数据集,给定图片,计算每张图片的SIFT特征值并提取,并展示特征点:

剩下几张不再赘述。。。。。

描述子匹配

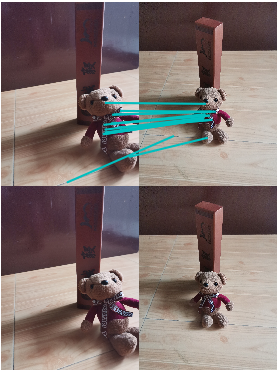

此例展示使用Sift算法进行描述子匹配,使用的是生活中的对相同场景的不同采景。源代码如下所示。

from PIL import Image

from pylab import *

import sys

from PCV.localdescriptors import sift

if len(sys.argv) >= 3:

im1f, im2f = sys.argv[1], sys.argv[2]

else:

# im1f = '../data/sf_view1.jpg'

# im2f = '../data/sf_view2.jpg'

im1f = '../data/crans_1_small.jpg'

im2f = '../data/crans_2_small.jpg'

# im1f = '../data/climbing_1_small.jpg'

# im2f = '../data/climbing_2_small.jpg'

im1 = array(Image.open(im1f))

im2 = array(Image.open(im2f))

sift.process_image(im1f, 'out_sift_1.txt')

figure()

gray()

subplot(121)

sift.plot_features(im1, l1, circle=False)

sift.process_image(im2f, 'out_sift_2.txt')

l2, d2 = sift.read_features_from_file('out_sift_2.txt')

subplot(122)

sift.plot_features(im2, l2, circle=False)

#matches = sift.match(d1, d2)

matches = sift.match_twosided(d1, d2)

print '{} matches'.format(len(matches.nonzero()[0]))

figure()

gray()

sift.plot_matches(im1, im2, l1, l2, matches, show_below=True)

show()

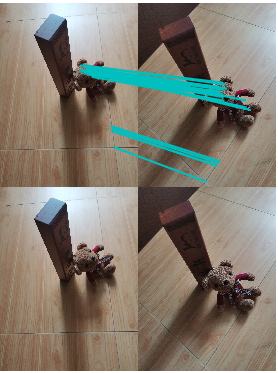

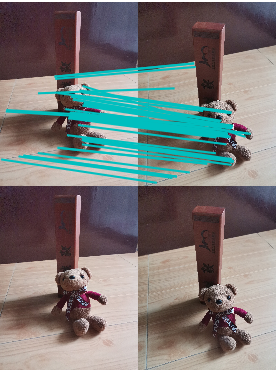

通过实拍的8张小场景数据集,给定两张图片,计算其SIFT特征匹配结果:

可得以下几组对比图:

由于图片过多这里不再一一列出,但是从图中还是可以发现虽然大致匹配正确,但是依旧有一部分没能完全匹配。同时限于电脑配置,无法运行大型图片。

关键点检测的相关概念

哪些点是SIFT中要查找的关键点(特征点)

这些点是一些十分突出的点不会因光照、尺度、旋转等因素的改变而消失,比如角点、边缘点、暗区域的亮点以及亮区域的暗点。既然两幅图像中有相同的景物,那么使用某种方法分别提取各自的稳定点,这些点之间会有相互对应的匹配点。

根据归纳,我们可以看出SIFT特征点希望选出具有下述不变性的点:

尺度、方向、位移、光照

什么是尺度空间(scale space )

尺度空间理论最早于1962年提出,其主要思想是通过对原始图像进行尺度变换,获得图像多尺度下的空间表示。从而实现边缘、角点检测和不同分辨率上的特征提取,以

满足特征点的尺度不变性。

关键点检测的相关概念尺度空间中各尺度图像的模糊程度逐渐变大,能够模拟人在距离目标由近到远时目标在视网膜上的形成过程。尺度越大图像越模糊。

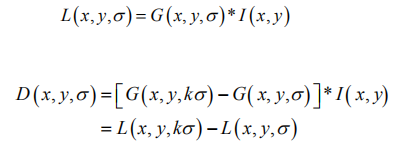

高斯核是唯一可以产生 多尺度空间的核,一个图像的尺度空间,L(x, y, σ) ,定义为原始图像 I(x, y)与一个可变尺度的2维高斯函数G(x, y, σ) 卷积运算。

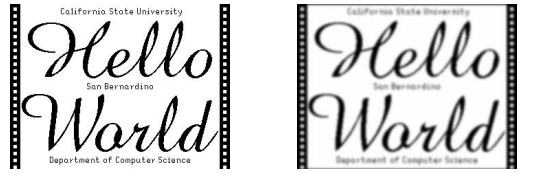

高斯模糊

高斯模糊是在Adobe Photoshop等图像处理软件中广泛使用的处理效果,通常用它来减小图像噪声以及降低细节层次。这种模糊技术生成的图像的视觉效果是好像经过一个半透明的屏幕观察图像。

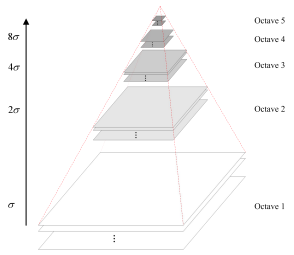

高斯金字塔

高斯金子塔的构建过程可分为两步:

(1)对图像做高斯平滑;

(2)对图像做降采样。

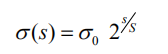

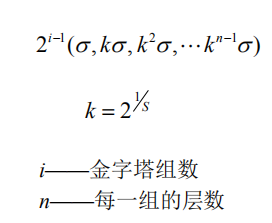

为了让尺度体现其连续性,在简单下采样的基础上加上了高斯滤波。一幅图像可以产生几组(octave)图像,一组图像包括几层(interval)图像。

高斯图像金字塔共o组、s层,则有:

关键点检测的相关概念

σ——尺度空间坐标;

s——sub-level层坐标;

σ0——初始尺度;

S——每组层数(一般为3~5)

最后可将组内和组间尺度归为:

关键点检测——DOG

DoG(Difference of Gaussian)函数

DoG在计算上只需相邻高斯平滑后图像相减,因此简化了计算!

DoG高斯差分金字塔

对应DOG算子,需构建DOG金字塔可以通过高斯差分图像看出图像上的像素值变化情况。(如果没有变化,也就没有特征。特征必须是变化尽可能多的点。)DOG图像描绘的是目标的轮廓。

DOG局部极值检测

DoG的局部极值点

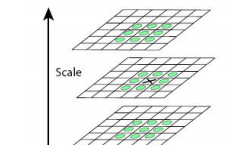

特征点是由DOG空间的局部极值点组成的。为了寻找DoG函数的极值点,每一个像素点要和它所有的相邻点比较,看其是否比它的图像域和尺度域的相邻点大或者小。

中间的检测点和它同尺度的8个相邻点和上下相邻尺度对应的9×2个点共26个点比较,以确保在尺度空间和二维图像空间都检测到极值点。

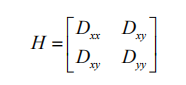

去除边缘响应

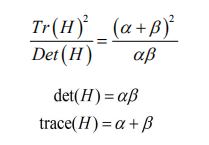

由于DoG函数在图像边缘有较强的边缘响应,因此需要排除边缘响应。DoG函数的峰值点在边缘方向有较大的主曲率,而在垂直边缘的方向有较小的主曲率。主曲率可以通过计算在该点位置尺度的2×2的Hessian矩阵得到,导数由采样点相邻差来估计:

Dxx 表示DOG金字塔中某一尺度的图像x方向求导两次

D的主曲率和H的特征值成正比。令 α ,β为特征值,则

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?