什么是梯度下降法?

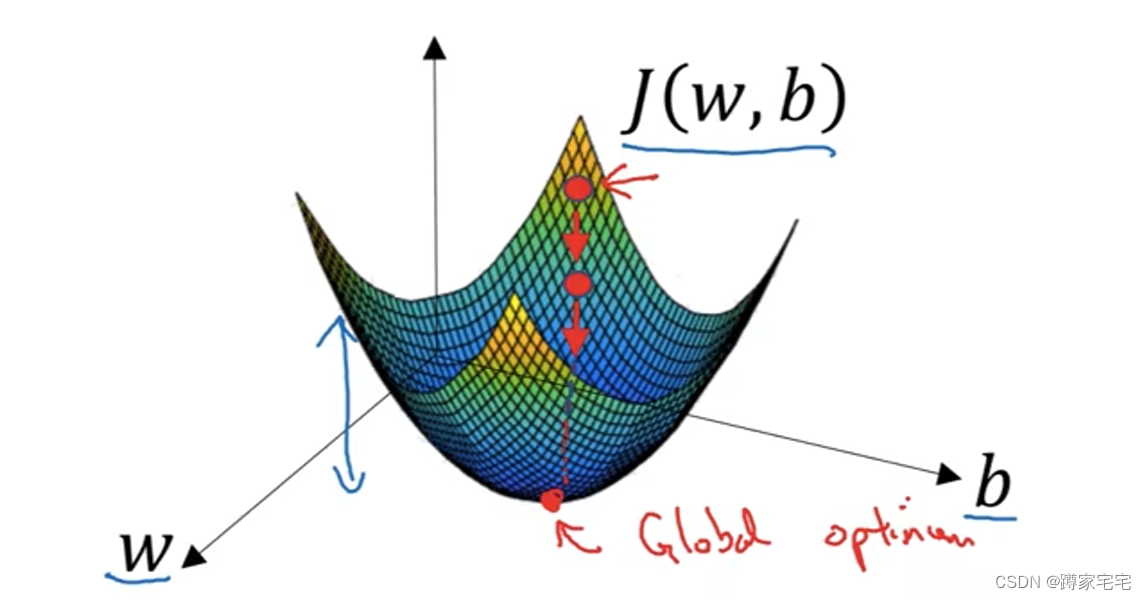

梯度下降法是用来求解成本函数cost函数中使得J(w,b)函数值最小的参数(w,b)

梯度下降法的实现

通过对参数w,b的不断更新迭代,使J(w,b)的值趋于局部最小值或者全局最小值

如何进行更新?

以w为例:迭代公式 ww-

,其中

表示学习速率(learning rate)

当导数为负值时,w不断增大;当导数为正值时,w不断减小,最终都会趋于凹点(满足条件)

实际上只是适用于一个变量,当有多个变量时,应该写为

从低维到高维

当每个变量都进行迭代,则会在每个维度都趋近凹点,最终实现全局或局部最小cost值

5144

5144

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?