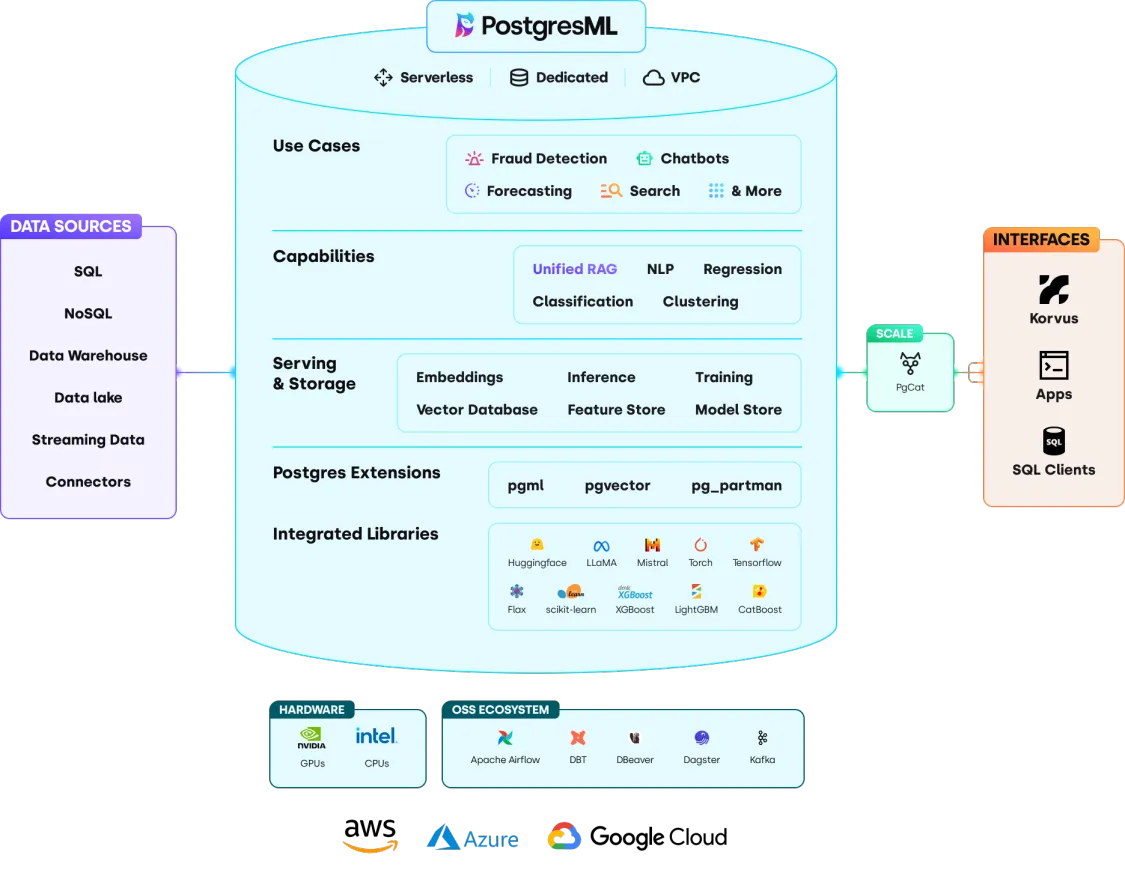

架构总览

特性:

● 支持数据库中进行的ai和ml分析

● 支持gpu加速

● 集成多种开源llm和rag框架

● 支持传统的机器学习模型

使用方法

云端试用

官方提供了云服务试用,根据要求注册账号即可: 注册地址

本地部署

官方提供了docker镜像,执行如下命令即可安装

docker run \

-it \

-v postgresml_data:/var/lib/postgresql \

-p 5433:5432 \

-p 8000:8000 \

ghcr.io/postgresml/postgresml:2.7.12 \

sudo -u postgresml psql -d postgresml

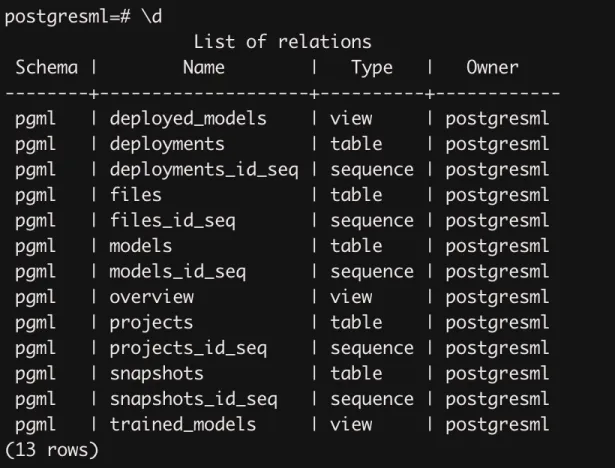

进入容器后,可选发现预先定义好一些表,同时已经安装了pgvector和pgml插件

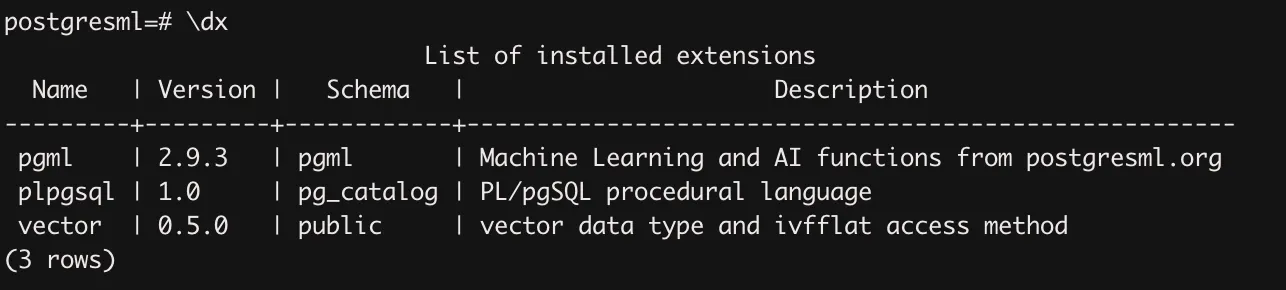

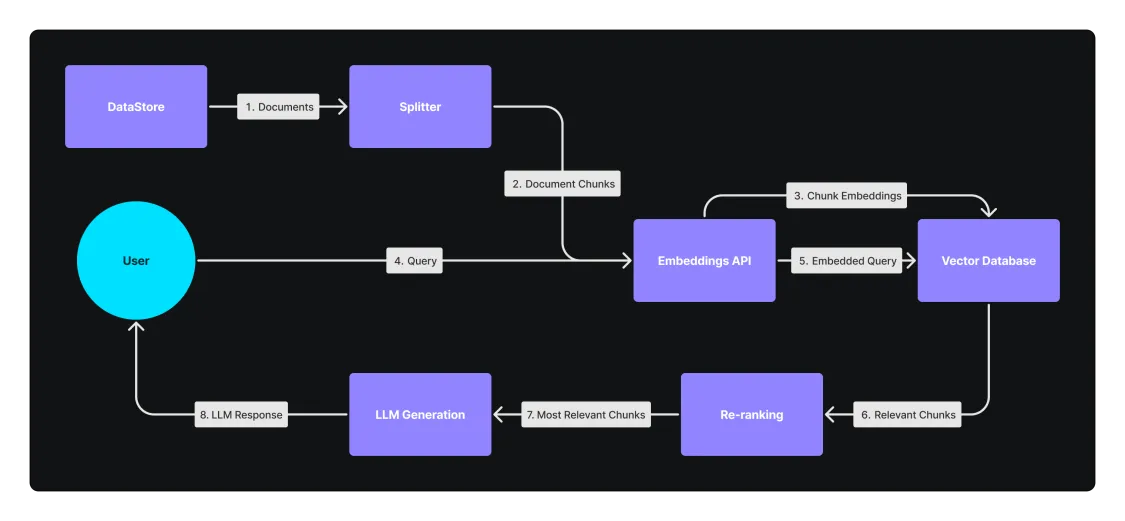

一体化RAG框架

PGML的一体化RAG是针对传统RAG进行改进的解决方案。一体化的RAG不再依赖分散的模块来处理嵌入、检索、重排和文本生成,而是将它们组合在一项服务下。PGML提供了如下RAG基本步骤:

- 文档切分模块:用于把完整文档按照不同的切分策略进行切分

- 向量化模块:支持使用开源向量模型对文本块进行向量化表示

- 检索模块:用于对输入向量和文档向量进行相似性检索或者重排序

- 答案生成模块:支持使用开源的LLM对答案进行总结生成

文档切分

# 算子为pgml.chunk

# pgml.chunk(

# splitter TEXT, -- splitter name

# text TEXT, -- text to embed

# kwargs JSON -- optional arguments

# )

# 实际例子如下

SELECT pgml.chunk('recursive_character', content, '{"chunk_size": 250}') FROM documents;

切分策略与langchain基本差不多,recursive_character是最常用的。此外还支持latex、markdown、ntlk、python、spacy等切分策略。

文档向量化

# 算子为pgml.embed

# pgml.embed(

# transformer TEXT,

# "text" TEXT,

# kwargs JSONB

#)

# 实际例子如下

SELECT pgml.embed('mixedbread-ai/mxbai-embed-large-v1', chunk) from chunks;

检索和重排序

# 算子为pgml.rank

# pgml.rank(

# transformer TEXT,

# query TEXT,

# documents TEXT[],

# kwargs JSONB

# )

# 实际例子如下

SELECT pgml.rank('mixedbread-ai/mxbai-rerank-base-v1', 'How do I write a select statement with pgml.transform?', array_agg("chunk"), '{"return_documents": false, "top_k": 6}'::jsonb || '{}') AS rank

文本生成

# 算子为pgml.transform

# SELECT pgml.transform(

# task => TEXT OR JSONB, -- Pipeline initializer arguments

# inputs => TEXT[] OR BYTEA[], -- inputs for inference

# args => JSONB -- (optional) arguments to the pipeline.

# )

# 实际例子如下

SELECT *

FROM pgml.transform(

task => 'text-generation',

inputs => ARRAY['In a galaxy far far away']

);

完整应用方案

第一步 创建一张表,用于存储文档切分的结果

CREATE TABLE chunks(id SERIAL PRIMARY KEY, chunk text NOT NULL, chunk_index int NOT NULL, document_id int references documents(id));

INSERT INTO chunks (chunk, chunk_index, document_id)

SELECT

(chunk).chunk,

(chunk).chunk_index,

id

FROM (

SELECT

pgml.chunk('recursive_character', document, '{"chunk_size": 250}') chunk,

id

FROM

documents) sub_query;

第二步 创建向量表,把chunk进行embedding并存储

CREATE TABLE embeddings (

id SERIAL PRIMARY KEY, chunk_id bigint, embedding vector (1024),

FOREIGN KEY (chunk_id) REFERENCES chunks (id) ON DELETE CASCADE

);

INSERT INTO embeddings(chunk_id, embedding)

SELECT

id,

pgml.embed('mixedbread-ai/mxbai-embed-large-v1', chunk)

FROM

chunks;

前两步可以在直接在一张表中创建两个字段保存即可,无需创建两个表

第三步 输入执行向量化,并按照对数据库中的向量进行检索排序

WITH embedded_query AS (

SELECT

pgml.embed('mixedbread-ai/mxbai-embed-large-v1', 'How do I write a select statement with pgml.transform?', '{"prompt": "Represent this sentence for searching relevant passages: "}')::vector embedding

)

SELECT

chunks.id,

(

SELECT

embedding

FROM embedded_query) <=> embeddings.embedding cosine_distance,

chunks.chunk

FROM

chunks

INNER JOIN embeddings ON embeddings.chunk_id = chunks.id

ORDER BY

embeddings.embedding <=> (

SELECT

embedding

FROM embedded_query)

LIMIT 6;

第四步 对数据库中的相似片段进行总结生成

# 省略上述检索步骤

SELECT

pgml.transform (

task => '{

"task": "conversational",

"model": "meta-llama/Meta-Llama-3.1-8B-Instruct"

}'::jsonb,

inputs => ARRAY['{"role": "system", "content": "You are a friendly and helpful chatbot."}'::jsonb, jsonb_build_object('role', 'user', 'content', replace('Given the context answer the following question: How do I write a select statement with pgml.transform? Context:\n\n{CONTEXT}', '{CONTEXT}', chunk))],

args => '{

"max_new_tokens": 100

}'::jsonb)

FROM

context;

transform改成transform_stream即变成流式输出

总结分析

优点:

● 一体化的RAG框架,集成了多种开源模型和langchain的组件,可以直接在数据库中进行RAG构建

● 支持多种机器学习算法,可以实现数据库内一站式的机器学习和数据分析

● 全程SQL操作即可,适合传统数据分析人员或者对框架和其他编程语言不熟悉的人

缺点:

● 镜像内不含模型,实时拉取模型会比较慢

● 不支持单独部署成一个服务,但是可以结合官方提供的Python和JS的SDK进行二次封装

● 由于数据库的安全问题不支持直接接入闭源模型,需要手工调整工作流程

如何系统的去学习大模型LLM ?

大模型时代,火爆出圈的LLM大模型让程序员们开始重新评估自己的本领。 “AI会取代那些行业?”“谁的饭碗又将不保了?”等问题热议不断。

事实上,抢你饭碗的不是AI,而是会利用AI的人。

继科大讯飞、阿里、华为等巨头公司发布AI产品后,很多中小企业也陆续进场!超高年薪,挖掘AI大模型人才! 如今大厂老板们,也更倾向于会AI的人,普通程序员,还有应对的机会吗?

与其焦虑……

不如成为「掌握AI工具的技术人」,毕竟AI时代,谁先尝试,谁就能占得先机!

但是LLM相关的内容很多,现在网上的老课程老教材关于LLM又太少。所以现在小白入门就只能靠自学,学习成本和门槛很高。

针对所有自学遇到困难的同学们,我帮大家系统梳理大模型学习脉络,将这份 LLM大模型资料 分享出来:包括LLM大模型书籍、640套大模型行业报告、LLM大模型学习视频、LLM大模型学习路线、开源大模型学习教程等, 😝有需要的小伙伴,可以 扫描下方二维码领取🆓↓↓↓

一、LLM大模型经典书籍

AI大模型已经成为了当今科技领域的一大热点,那以下这些大模型书籍就是非常不错的学习资源。

二、640套LLM大模型报告合集

这套包含640份报告的合集,涵盖了大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。(几乎涵盖所有行业)

三、LLM大模型系列视频教程

四、LLM大模型开源教程(LLaLA/Meta/chatglm/chatgpt)

LLM大模型学习路线 ↓

阶段1:AI大模型时代的基础理解

-

目标:了解AI大模型的基本概念、发展历程和核心原理。

-

内容:

- L1.1 人工智能简述与大模型起源

- L1.2 大模型与通用人工智能

- L1.3 GPT模型的发展历程

- L1.4 模型工程

- L1.4.1 知识大模型

- L1.4.2 生产大模型

- L1.4.3 模型工程方法论

- L1.4.4 模型工程实践

- L1.5 GPT应用案例

阶段2:AI大模型API应用开发工程

-

目标:掌握AI大模型API的使用和开发,以及相关的编程技能。

-

内容:

- L2.1 API接口

- L2.1.1 OpenAI API接口

- L2.1.2 Python接口接入

- L2.1.3 BOT工具类框架

- L2.1.4 代码示例

- L2.2 Prompt框架

- L2.3 流水线工程

- L2.4 总结与展望

阶段3:AI大模型应用架构实践

-

目标:深入理解AI大模型的应用架构,并能够进行私有化部署。

-

内容:

- L3.1 Agent模型框架

- L3.2 MetaGPT

- L3.3 ChatGLM

- L3.4 LLAMA

- L3.5 其他大模型介绍

阶段4:AI大模型私有化部署

-

目标:掌握多种AI大模型的私有化部署,包括多模态和特定领域模型。

-

内容:

- L4.1 模型私有化部署概述

- L4.2 模型私有化部署的关键技术

- L4.3 模型私有化部署的实施步骤

- L4.4 模型私有化部署的应用场景

这份 LLM大模型资料 包括LLM大模型书籍、640套大模型行业报告、LLM大模型学习视频、LLM大模型学习路线、开源大模型学习教程等, 😝有需要的小伙伴,可以 扫描下方二维码领取🆓↓↓↓

178

178

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?