1、图像处理面试题

1.1 常用图像空间

https://blog.csdn.net/jiang_ming_/article/details/82534722

1. 1.1HSV空间优点应用及与RGB的区别

https://blog.csdn.net/qq_26271655/article/details/88406140

1.2 常用传统图像增强方法

1.2.1 直方图均衡

https://blog.csdn.net/qq_15971883/article/details/88699218

1.2.2 对比度增强(gama变换)

1.3 常用边缘检测算子

1.3.1 边缘检测算子

Robrets

Sobel

Laplace

LOG(Lapulacin of Gaussian)

1.3.2 一阶导数图像与二阶的区别

https://blog.csdn.net/Du_Shuang/article/details/82932546

1.3.2 Canny边缘检测算法

1.3.3 霍夫变换检测算法

1.4 常用特征检测算子

1.5常用图像平滑滤波器

1.6常用阈值分割方法

1.7数学方法

2、机器学习面试题

2.1 激活函数

2.2 L1,L2正则化的区别

https://blog.csdn.net/weiyongle1996/article/details/78161512

https://www.zhihu.com/question/26485586

2.3 交叉熵损失函数

2.3 K-means聚类

3、深度学习面试题

3.1 CNN

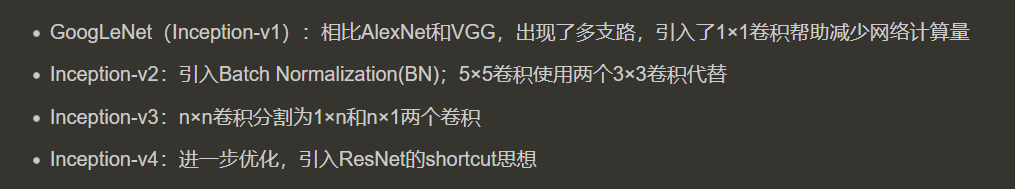

ResNet

mobilenetv1-v2以及参数量、计算量、模型存储空间等计算

特征图大小计算

深度可分离卷积

最大池化平均池化的选择

3.1.1 注意力机制

3.2 卷积层感受野计算

3.3 卷积层参数计算

3.4 BN

深度神经网络主要就是为了学习训练数据的分布,并在测试集上达到很好的泛化效果,但是,如果我们每一个batch输入的数据都具有不同的分布,显然会给网络的训练带来困难。BN的核心思想不是为了防止梯度消失或者防止过拟合,其核心是通过对系统参数搜索空间进行约束来增加系统鲁棒性,这种约束压缩了搜索空间,约束也改善了系统的结构合理性,这会带来一系列的性能改善,比如加速收敛,保证梯度,缓解过拟合等。

BN具体操作

https://blog.csdn.net/weixin_42137700/article/details/91488889

https://blog.csdn.net/donkey_1993/article/details/81871132

BN训练和测试时的区别

BN,LN,IN,GN

3.5 Batch size的理解与选择

https://blog.csdn.net/qq_42380515/article/details/87885996

2676

2676

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?