信息论(Information Theory)是概率论与数理统计的一个分枝。用于信息处理、信息熵、通信系统、数据传输、率失真理论、密码学、信噪比、数据压缩和相关课题。本文主要罗列一些基于熵的概念及其意义,注意本文罗列的所有 loglog 都是以 2 为底的。

信息熵

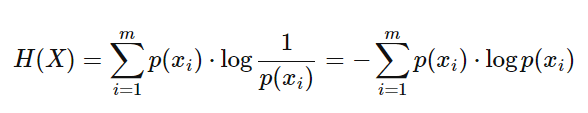

在物理界中熵是描述事物无序性的参数,熵越大则越混乱。类似的在信息论中熵表示随机变量的不确定程度,给定随机变量 X ,其取值 x1,x2,⋯,xmx1,x2,⋯,xm ,则信息熵为:

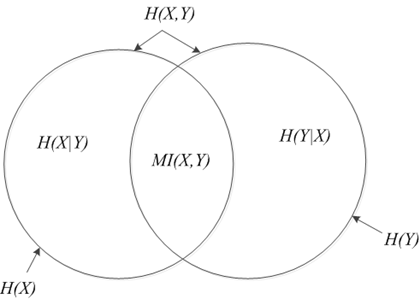

这里有一张图,形象的描述了各种各样的熵的关系!

条件熵

设 X ,Y 为两个随机变量,X 的取值为 x1,x2,...,xmx1,x2,...,xm ,Y 的取值为 y1,y2,...yny1,y2,...yn ,则在X 已知的条件下 Y 的条件熵记做 H(Y|X) :

本文介绍了信息熵的基础知识,包括信息熵、条件熵、联合熵、相对熵(KL距离)、互信息和交叉熵的概念。信息熵是衡量随机变量不确定性的参数,而相对熵则用于评估两个概率分布的差异。此外,互信息描述了随机变量之间的关联,并讨论了信息增益在特征选择中的作用。

本文介绍了信息熵的基础知识,包括信息熵、条件熵、联合熵、相对熵(KL距离)、互信息和交叉熵的概念。信息熵是衡量随机变量不确定性的参数,而相对熵则用于评估两个概率分布的差异。此外,互信息描述了随机变量之间的关联,并讨论了信息增益在特征选择中的作用。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

4974

4974

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?