激光相机在线标定新SOTA

在线标定的难点

现有的激光雷达和相机间外参标定(LiDAR-Camera Extrinsic Calibration, LCEC)方法主要分为基于目标和无目标两类,取决于算法是否需要来自RGB图像和LiDAR点云的预定义特征:

-

基于目标的方法: 最先进的LCEC方法通常是离线的,依赖于定制的标定目标(通常是棋盘格),这些目标可以提供明确、可识别的特征,可以在LiDAR和相机数据中轻松识别。但是,对定制目标的依赖和额外设置的需求使其在机器人在动态变化的环境中操作时显得不切实际。

附赠自动驾驶最全的学习资料和量产经验:链接 -

无目标的方法:主要有基于线/边缘特征的方法(通过在LiDAR点云和RGB图像中提取线或边缘特征,并匹配这些跨模态的边缘特征来确定两个传感器之间的相对位姿)、基于点特征的方法(依赖于2D图像像素和3D LiDAR点在强度或深度上的显著变化进行特征匹配)、基于语义特征的方法(利用深度学习从RGB图像和LiDAR点云中提取语义特征进行匹配,如车辆、车道、杆和停车标志等)、基于深度学习的端到端方法(深度神经网络进行端到端的特征提取和外参参数估计)。无目标的优点是环境适应性强、灵活性高、自动化程度高;缺点也很明显:特征依赖性强、鲁棒性不足、匹配困难、视场对齐问题、语义一致性问题等。

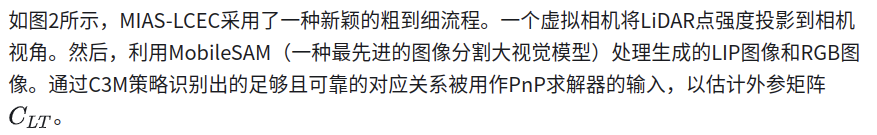

为了解决以上问题,MIAS-LCEC[1]充分发挥最先进的图像分割LVM MobileSAM[2]的潜力,采用了一种新颖的粗到细策略,以精确估计LiDAR-相机外参参数。整体思路为:

-

引入了虚拟相机,通过迭代姿态更新来投影给定的LiDAR点云,生成一个LiDAR强度投影(LIP)图像。

-

将LIP和RGB图像均使用MobileSAM进行分割。

-

然后,这些分割结果通过一种新颖的跨模态掩码匹配(C3M)算法进行处理,能够生成稀疏但可靠的匹配,并传播到目标掩码进行密集匹配。

-

最后PnP求解外参矩阵。

LCEC提供一个多功能的工具箱,带有交互式可视化界面,能够进行在线、无目标标定、离线、基于目标的标定和手动标定。

标定方法

算法整体概览

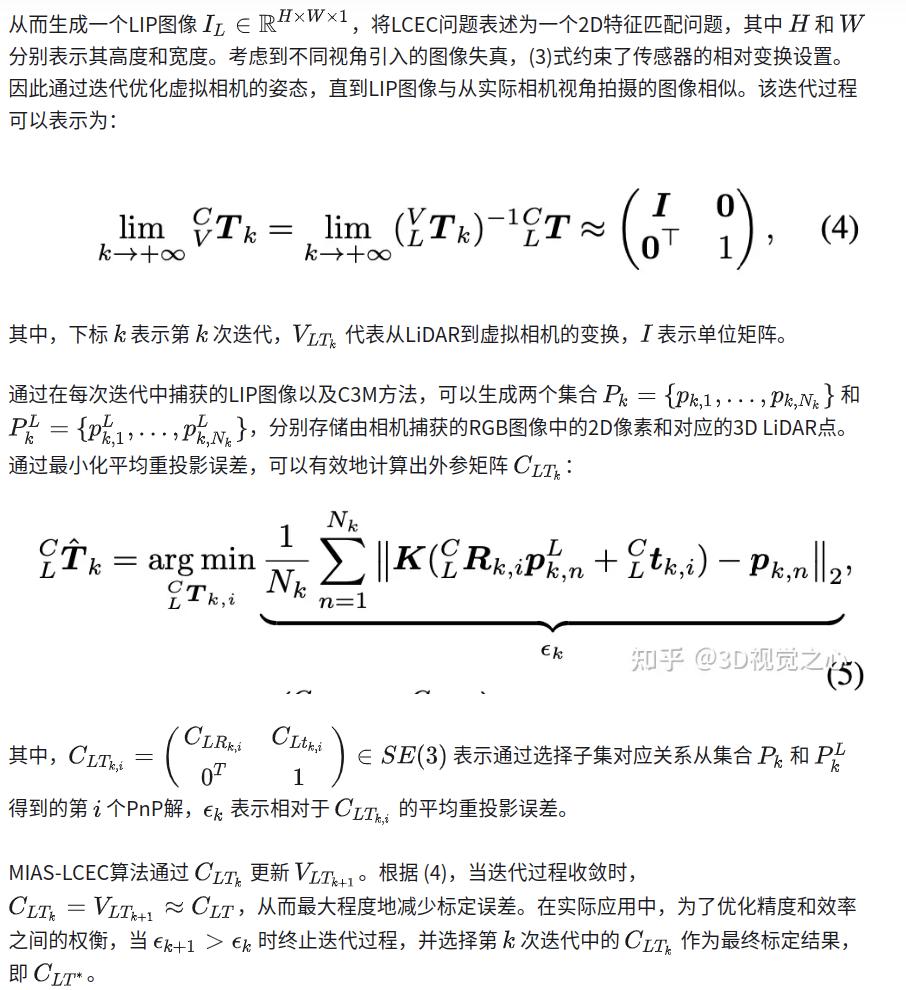

先前的研究通常将虚拟相机设置为具有如下LiDAR相对变换的形式:

跨模态掩码匹配

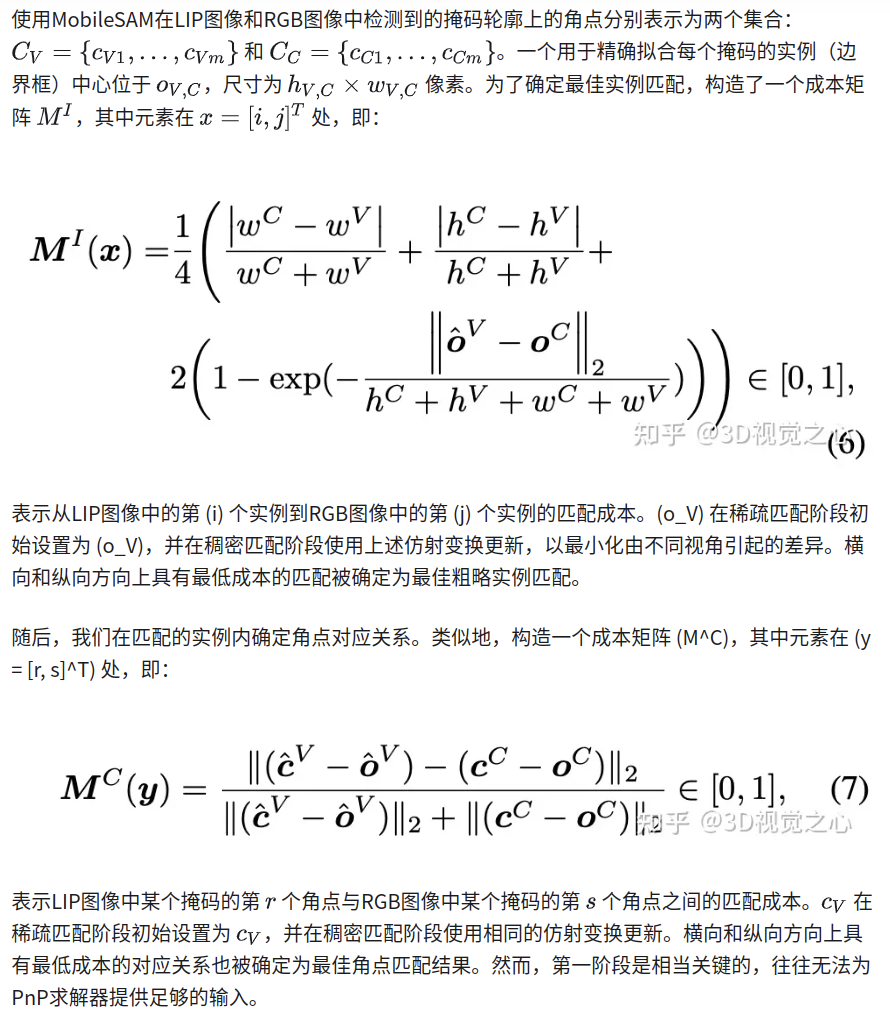

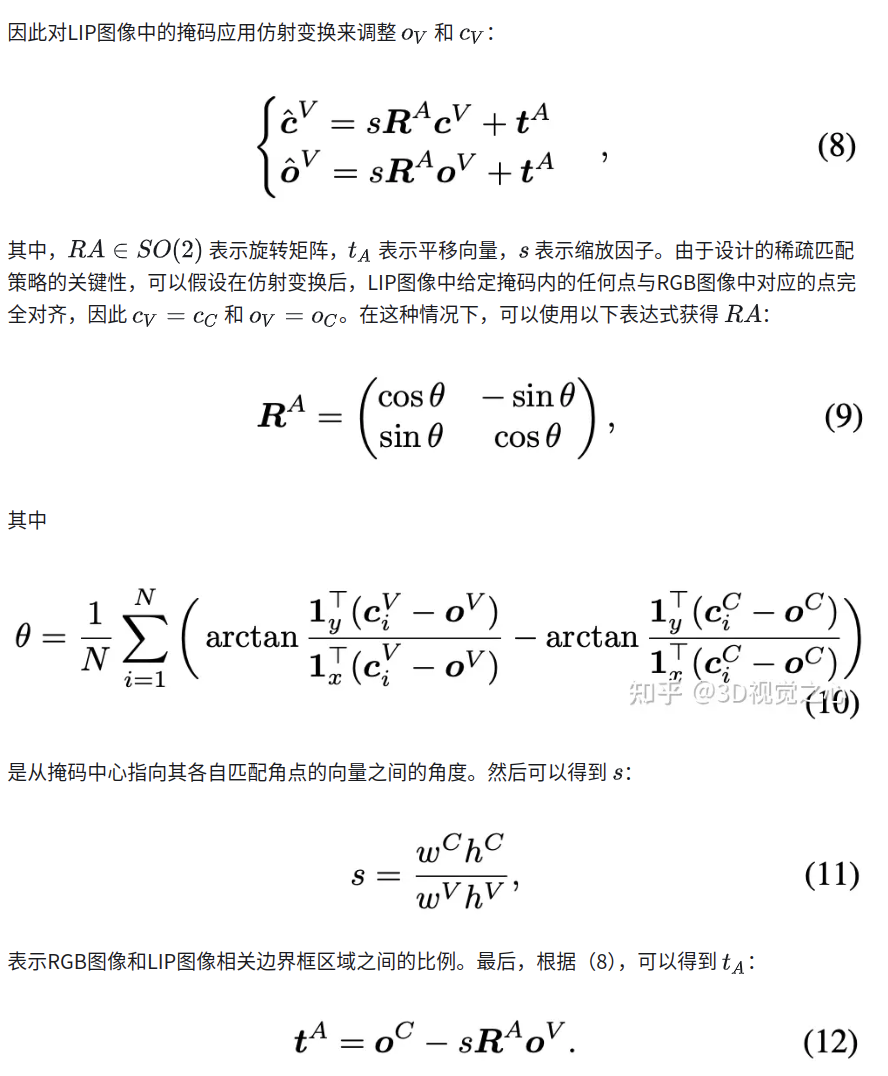

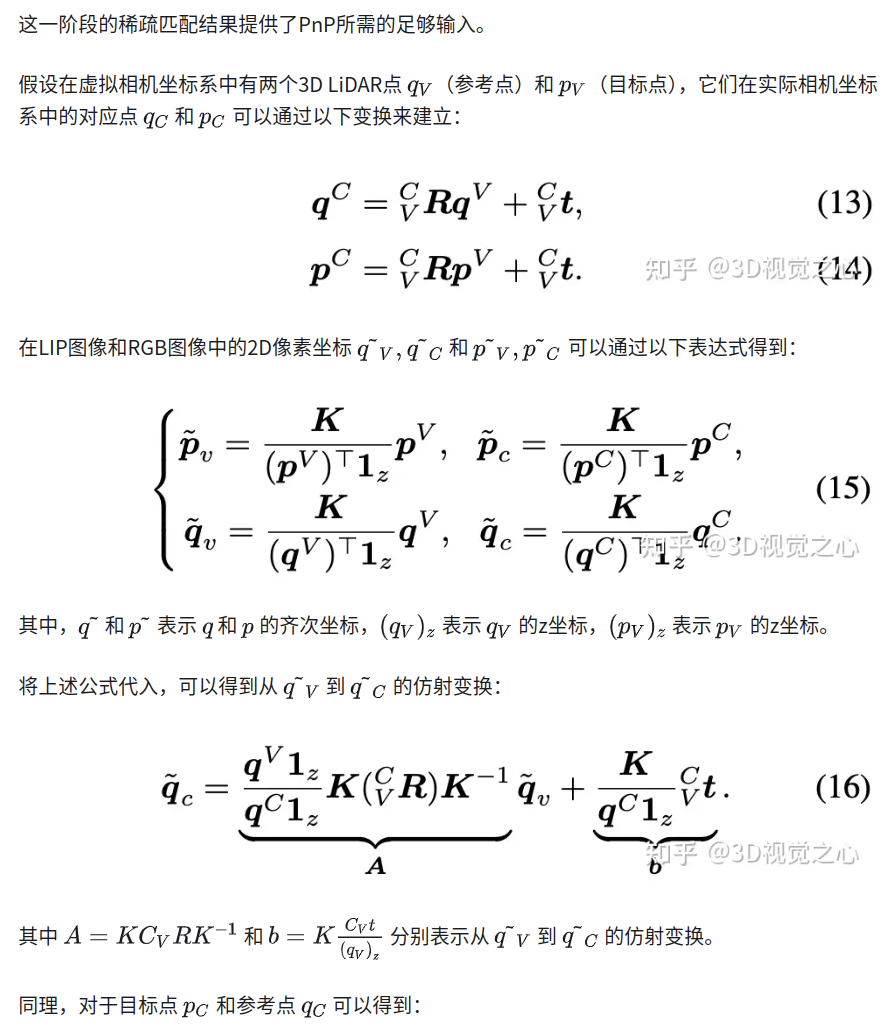

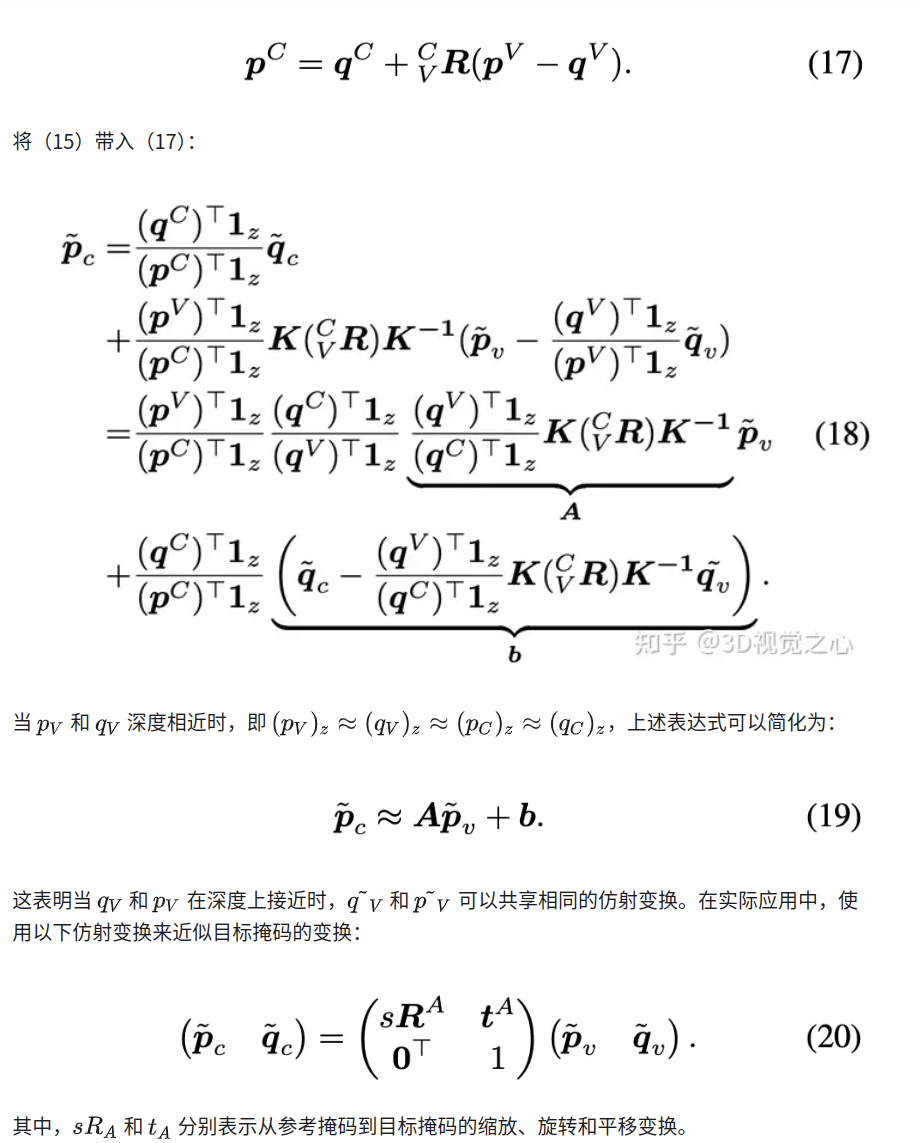

采用两阶段策略来实现跨模态掩码匹配,如算法1所述。每个阶段都包括顺序的粗略实例匹配和细粒度的角点匹配。

-

第一阶段生成可靠但稀疏的匹配,从中推导出仿射变换的参数,用于更新LIP图像中的掩码。

-

在第二阶段,通过将获得的可靠参考匹配传播到目标掩码,实现稠密掩码匹配。这些稠密匹配最终用作PnP求解器的输入,以获得外参矩阵 ¥C_{LT}¥。

实验对比

总结一下

MIAS-LCEC是一种基于最先进的大视觉模型开发的全在线、无目标的LiDAR-相机外参标定方法。与现有技术相比,本方法在跨模态特征匹配方面更具能力,并且优于现有的最先进算法。作者设计了一个带有交互式可视化界面的标定工具箱。在三个真实世界数据集上进行了大量实验,全面评估了MIAS-LCEC的性能。效果表明:

-

MIAS-LCEC无需任何目标即可实现鲁棒且精确的LiDAR-相机外参标定

-

通过引入带有迭代姿态更新的虚拟相机生成更精确的LiDAR强度投影,表现出对各种挑战场景的高度适应性

-

最先进的图像分割LVM成功应用于该特定任务,通过检测不同模态下的可区分和可匹配的掩码。

缺陷是实时性能仍需改进。

参考

[1] Online, Target-Free LiDAR–Camera Extrinsic Calibration via Cross-Modal Mask Matching

[2] Faster Segment Anything: Towards lightweight sam for mobile applications

66

66

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?