点击下方卡片,关注“CVer”公众号

AI/CV重磅干货,第一时间送达

扫码加入CVer学术星球,可以获得最新顶会/顶刊上的论文idea和CV从入门到精通资料,以及最前沿项目和应用!发论文搞科研,强烈推荐!

在CVer微信公众号后台回复:论文,即可下载论文pdf和代码链接!快学起来!

一句话总结

本文提出一种新颖的四边形注意力(QA)方法,进而提出QFormer:一种视觉新主干,仅需少量代码修改和忽略不计的额外成本,在分类/检测/分割/姿态估计等视觉任务上性能表现出色!代码将开源!

论文信息

Vision Transformer with Quadrangle Attention

单位:悉尼大学(陶大程团队)

论文:https://arxiv.org/abs/2303.15105

代码:https://github.com/ViTAE-Transformer/QFormer

研究背景

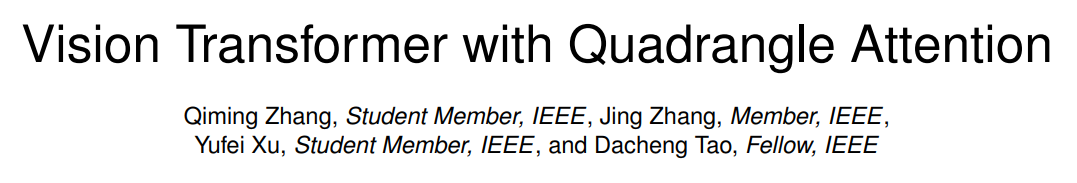

基于窗口的注意力因其优越的性能、较低的计算复杂度和更少的内存占用而成为视觉转换器的流行选择。然而,手工制作的窗口的设计与数据无关,限制了Transformer适应不同大小、形状和方向的对象的灵活性。

算法细节

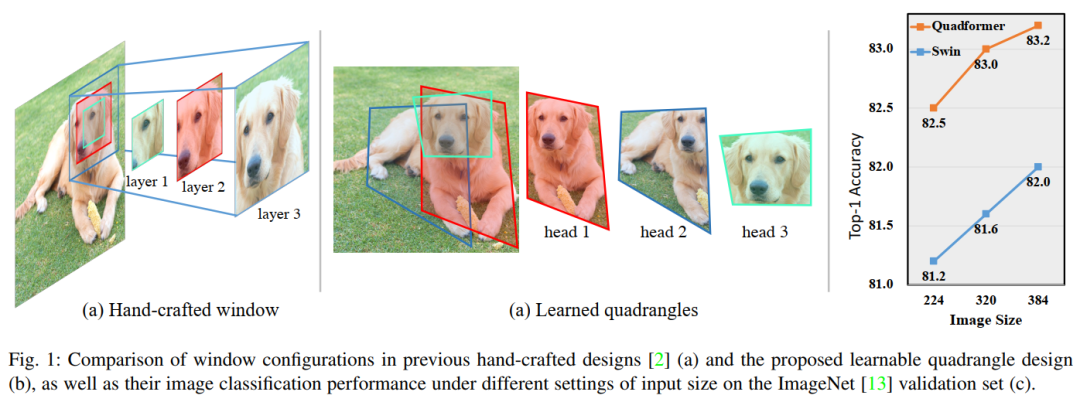

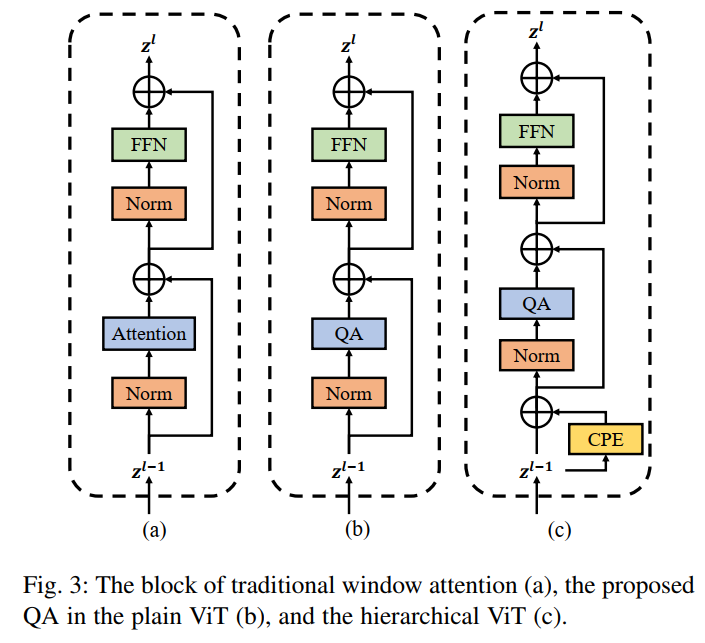

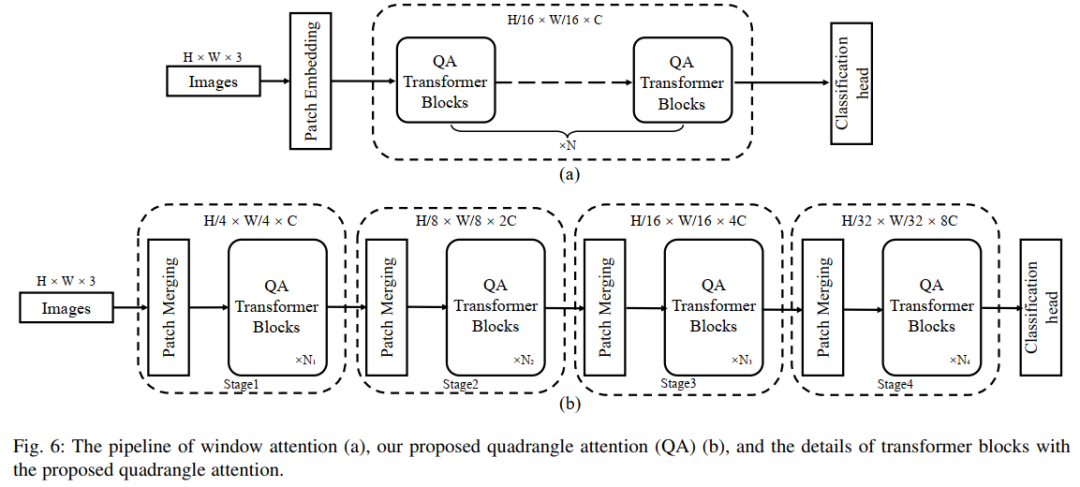

为了解决这个问题,本文提出了一种新颖的四边形注意力(QA)方法,将基于窗口的注意力扩展到一般的四边形公式。

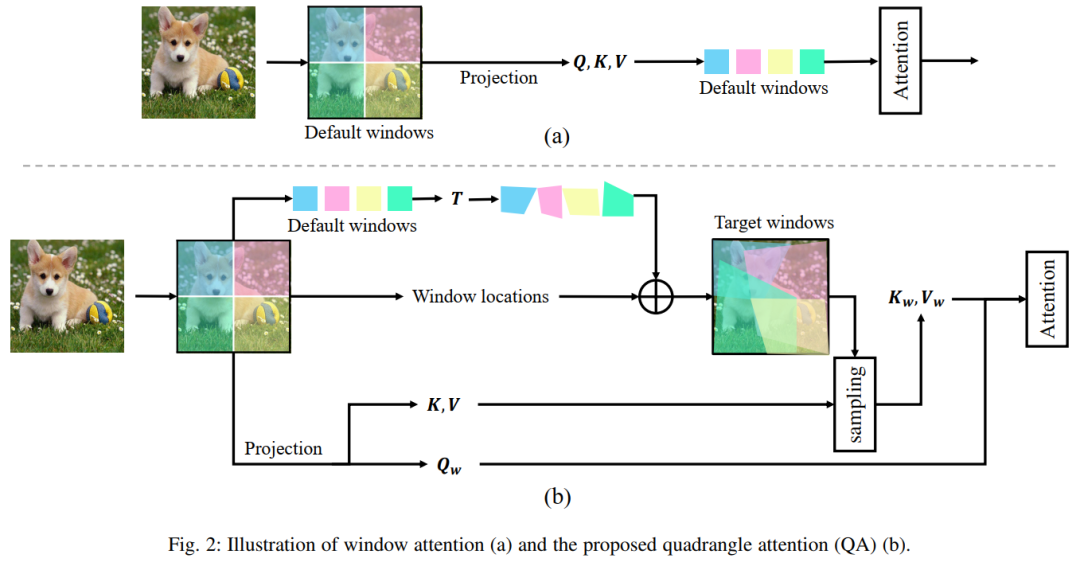

我们的方法采用端到端可学习四边形回归模块,该模块预测转换矩阵,将默认窗口转换为目标四边形以进行标记采样和注意力计算,使网络能够对具有不同形状和方向的各种目标进行建模并捕获丰富的上下文信息。

我们将 QA 集成到普通和分层视觉Transformer中,以创建一个名为 QFormer 的新架构,它提供了少量的代码修改和可以忽略不计的额外计算成本。

实验结果

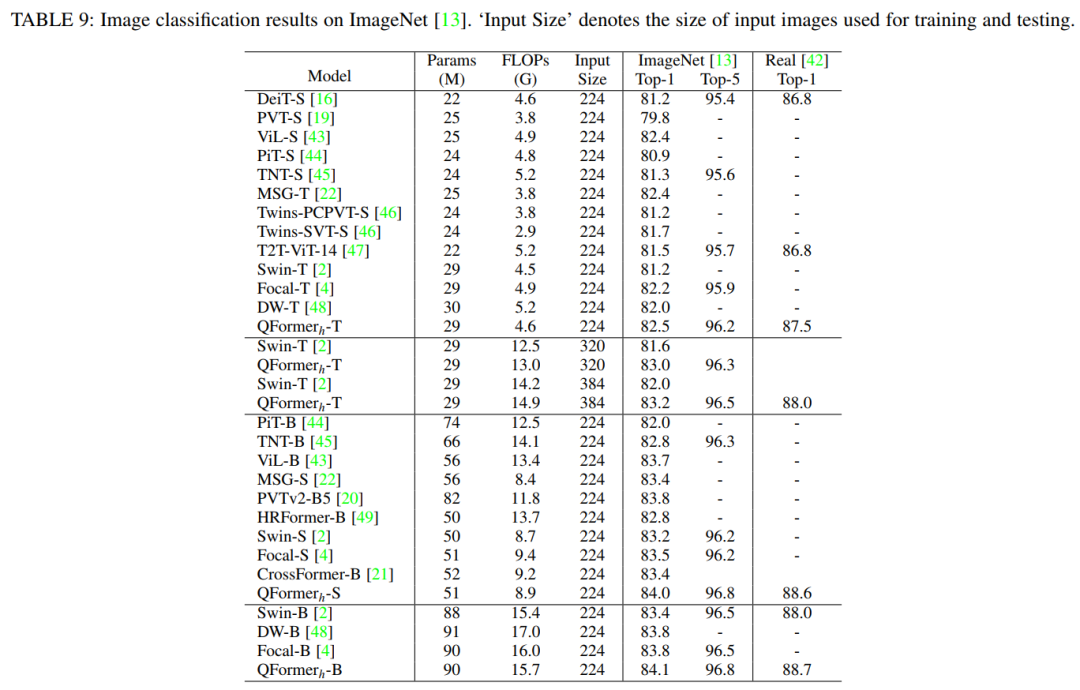

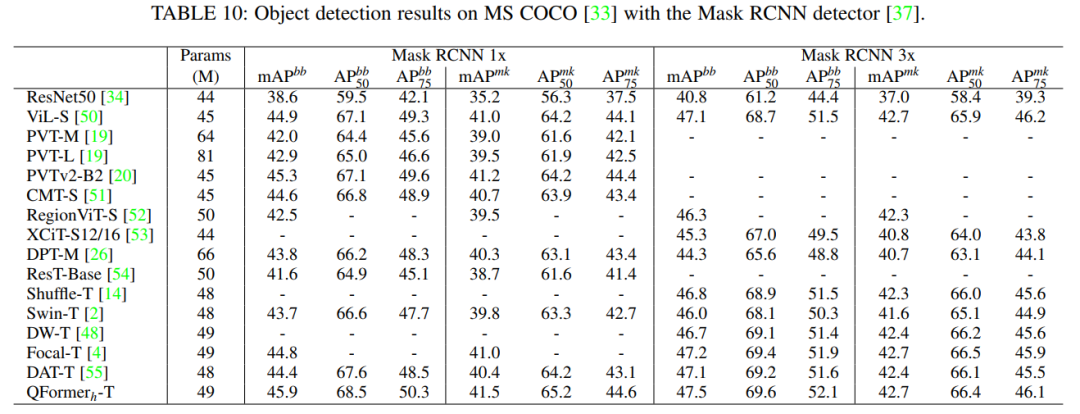

对公共基准的大量实验表明,QFormer 在各种视觉任务上都优于现有的代表性视觉Transformer,包括分类、目标检测、语义分割和姿势估计。

图像分类性能表现:

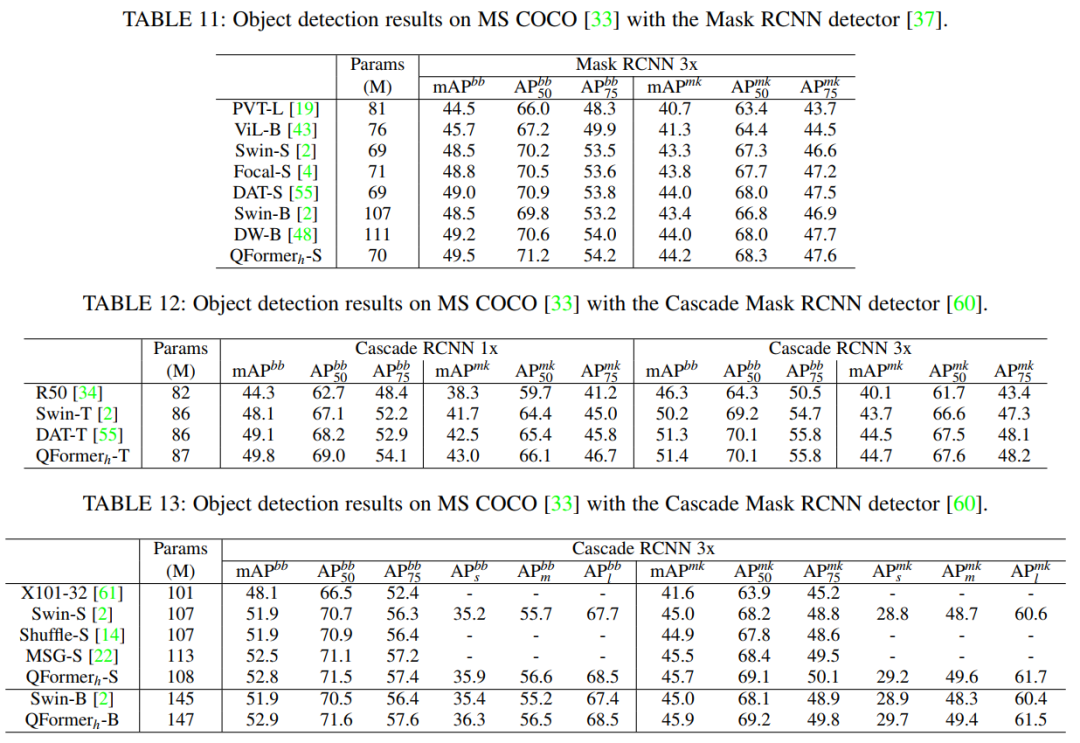

目标检测性能表现:

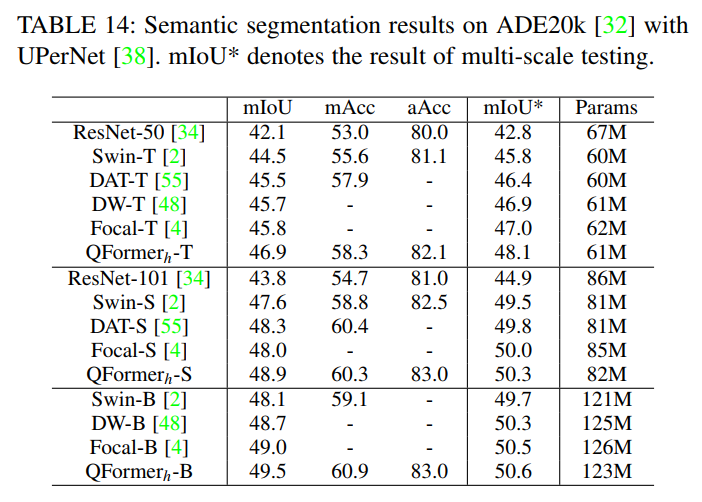

语义分割性能表现:

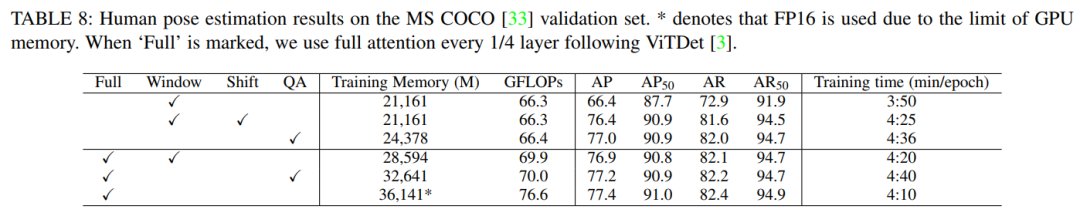

姿态估计性能表现:

在CVer微信公众号后台回复:论文,即可下载论文pdf和代码链接!快学起来!

Transformer交流群成立

扫描下方二维码,或者添加微信:CVer444,即可添加CVer小助手微信,便可申请加入CVer-Transformer微信交流群。另外其他垂直方向已涵盖:目标检测、图像分割、目标跟踪、人脸检测&识别、OCR、姿态估计、超分辨率、SLAM、医疗影像、Re-ID、GAN、NAS、深度估计、自动驾驶、强化学习、车道线检测、模型剪枝&压缩、去噪、去雾、去雨、风格迁移、遥感图像、行为识别、视频理解、图像融合、图像检索、论文投稿&交流、PyTorch、TensorFlow和Transformer、NeRF等。

一定要备注:研究方向+地点+学校/公司+昵称(如Transformer+上海+上交+卡卡),根据格式备注,可更快被通过且邀请进群▲扫码或加微信号: CVer444,进交流群

CVer计算机视觉(知识星球)来了!想要了解最新最快最好的CV/DL/AI论文速递、优质实战项目、AI行业前沿、从入门到精通学习教程等资料,欢迎扫描下方二维码,加入CVer计算机视觉(知识星球),已汇集近万人!

▲扫码加入星球学习▲点击上方卡片,关注CVer公众号

整理不易,请点赞和在看

78

78

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?