点击下方卡片,关注“CVer”公众号

AI/CV重磅干货,第一时间送达

添加微信:CVer5555,小助手会拉你进群!

扫描下方二维码,加入CVer学术星球!可以获得最新顶会/顶刊上的论文idea和CV从入门到精通资料,及最前沿应用!发论文/搞科研/涨薪,强烈推荐!

[CVPR'24 Highlight] RobustSAM: 只需小型网络模块,SAM模型在低质量图像上也能有良好的切割表现!

科研机构:Snap Research, 台湾大学

论文:https://arxiv.org/abs/2406.09627

项目:https://robustsam.github.io/

简介

Segment Anything Model (SAM)是专用于图像分割的基础模型。SAM能快速识别和分割照片中的元素,支持用户通过输入提示(prompt)的方式,进而选择感兴趣区域进行分割。SAM借鉴了自然语言处理领域的Foundation Model理念,使用提示学习来适应不同的分割任务,展示了零样本学习(zero-shot learning)的能力。

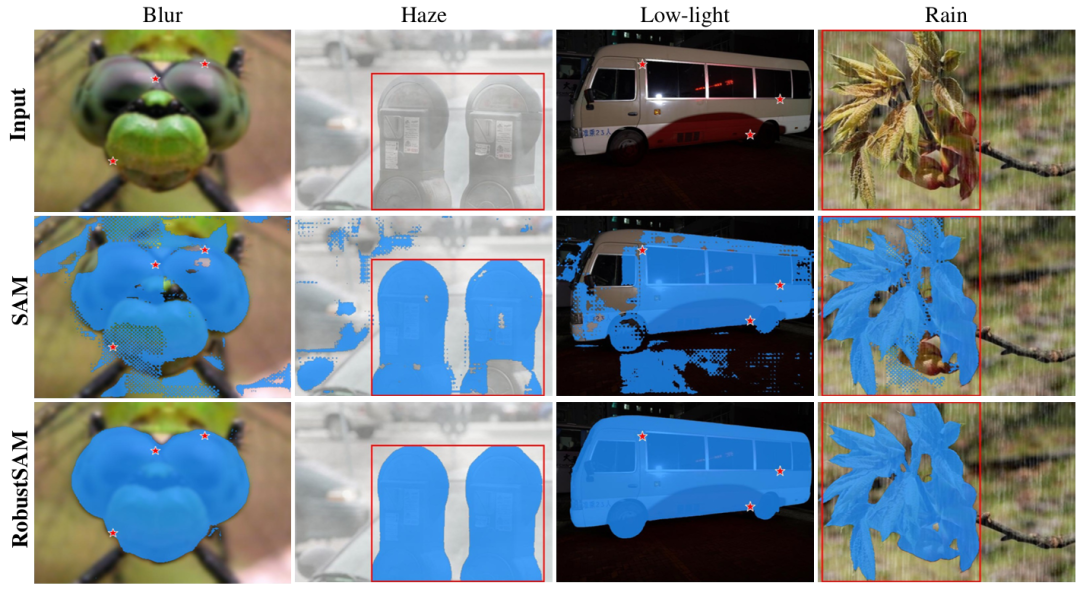

然而,虽然SAM有强大的图像切割能力,但其在处理恶劣天气或低光源下所拍摄的图像时,性能却会有显著的下降:

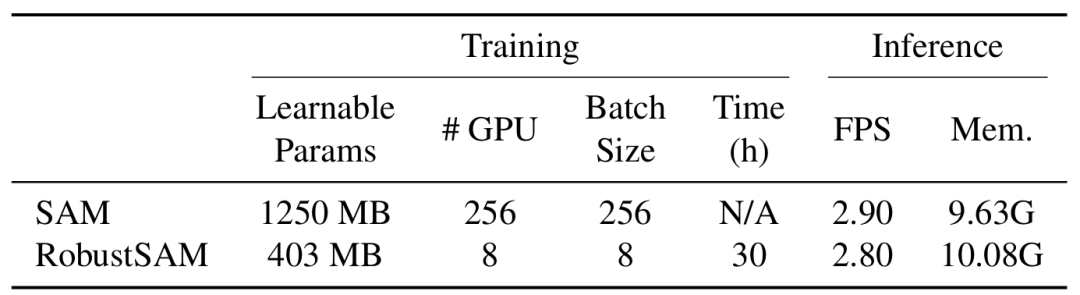

因此,本论文的目的在于提升SAM模型面对低质量图像时的鲁棒性。我们提出了RobustSAM的模型,在维持SAM模型强大的零样本学习能力的前提下,以少量的额外参数量显着提升了在低质量图像上的切割表现。以下表格显示了SAM和RobustSAM在可学习参数量及运算资源上的差异:

方法

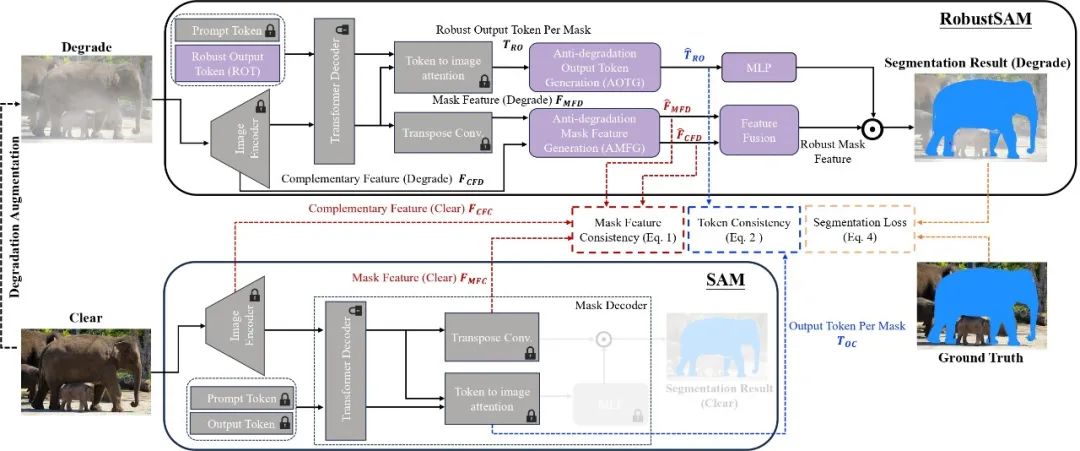

Overview of RobustSAM

上图显示了大致的训练流程,总共可分为两部分:SAM和RobustSAM。RobustSAM包含原始SAM模型的模块和预训练参数,在上图中以灰色模块表示,在训练过程中不会被更新。同时,在RobustSAM中引入了新的网络模块(以紫色模块表示),这些模块则会在训练过程中被更新。

在训练的一开始,会先将清晰(clear)图像通过人工合成的方式生成一张低质量(degrade)图像。接着,将清晰图像输入SAM并获得mask feature以及token feature,它们将用来生成最终的分割结果。此外,本篇的方法也同时提取了图像编码器的low-level feature,并且会与前述的mask feature以及token feature一起参与consistency loss的计算。

接下来,会将一开始合成的低质量图像输入到RobustSAM模型,并同样获得对应的feature。由于此时的输入为低质量图像,因此可以预期输出feature中会包含许多影响分割任务的degradation信息。为了去除这些degradation信息,本文使用了两个模块:AMFG模块和AOTG模块。通过降低SAM所输出feature和RobustSAM所输出feature之间的一致性损失,这两个模块将会得到有效的训练。

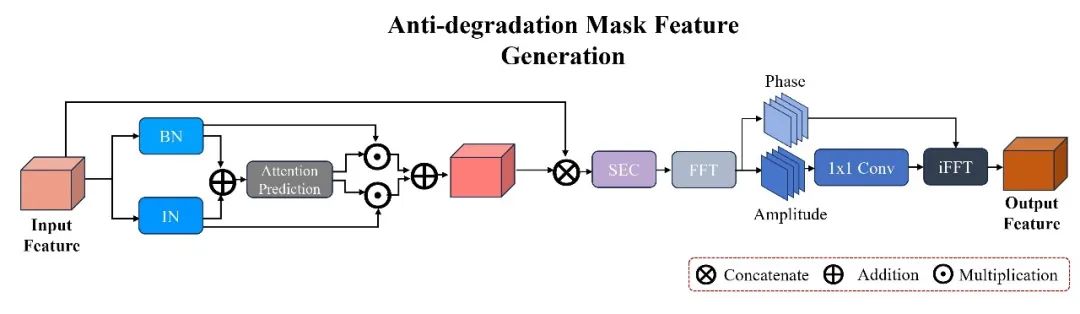

Anti-Degradation Mask Feature Generation (AMFG)

该模块的目的在于移除mask feature中有关degradation的信息。我们可以将该阶段的处理流程分成两部分来说明。

第一部分称为适应性的特征整合(Adaptive Feature Integration)。由于可以将degradation信息视为风格信息,因此会使用实例正则化(Instance Normalization, IN)来处理输入特征并移除degradation信息。为了补偿IN可能造成的细节损失,作者还使用了批次正则化(Batch Normalization, BN)。不同正则化所输出的特征会经过一个注意力模块来决定其重要性,进而融合出最终的输出特征。

为了进一步精炼图像特征,AMFG模块的第二部分使用了傅里叶变换来将特征从空间域投射至频率域。有鉴于风格或degradation信息通常隐藏在振幅分量中,因此此处使用了卷积网络来进行处理。经过卷积处理的振幅分量会与原始的相位分量融合在一起,并通过逆傅里叶变换得到输出特征。

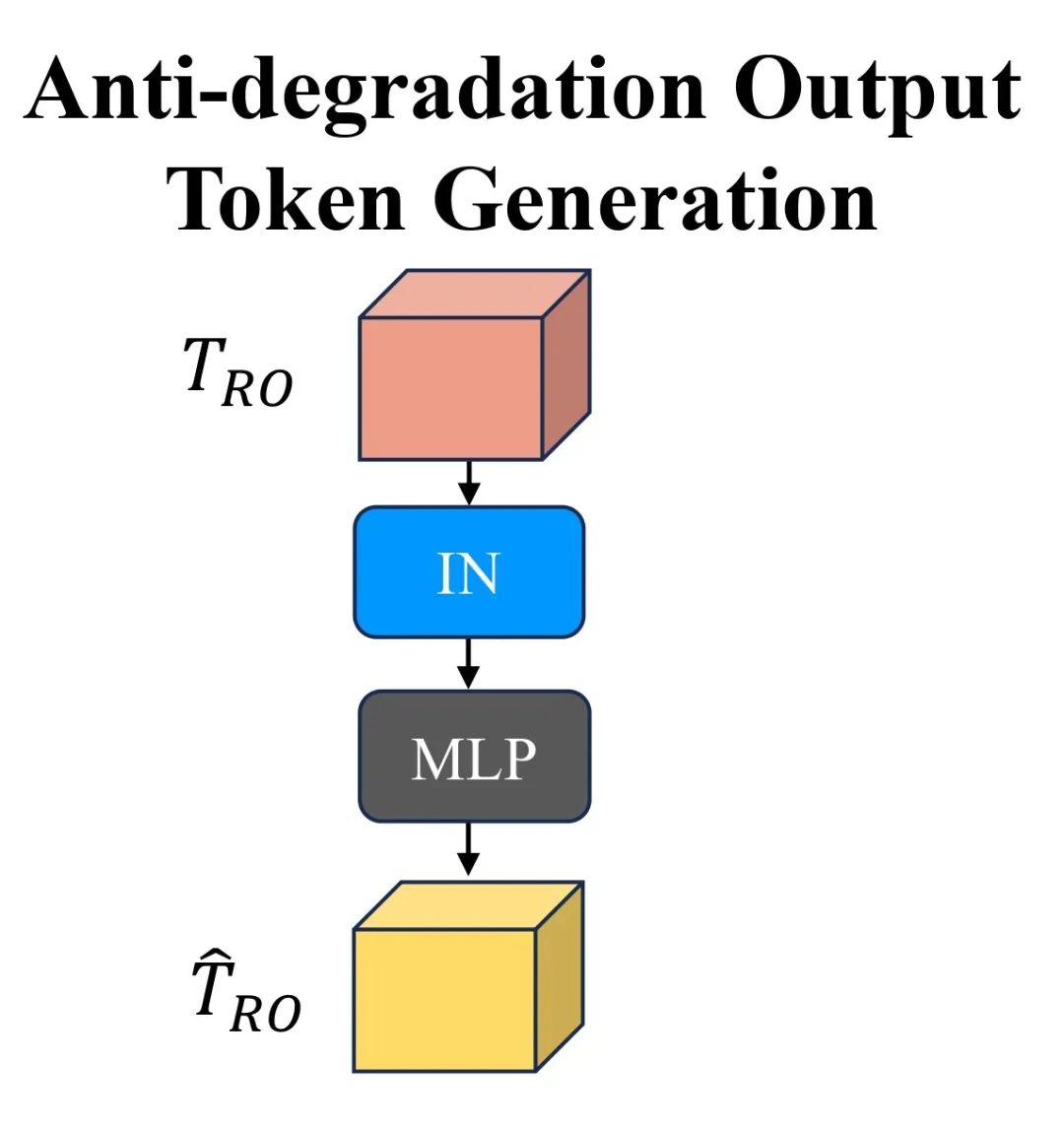

Anti-Degradation Output Token Generation (AOTG)

为了有效的还原输出token的特征,AOTG模块使用了由IN层和多层感知器(MLP)层所组成的轻量模块。由于token feature的维度远远小于mask feature的维度,因此该轻量模块已足以有效的移除token中的degradation信息。

实验结果

此篇论文做了许多实验来证明其有效性。

量化比较(Quantitative Comparison)

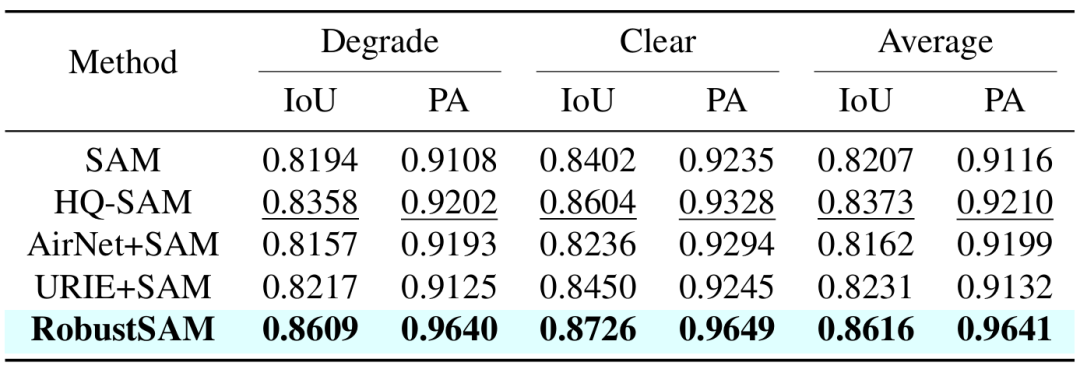

Seen dataset with synthetic degradation

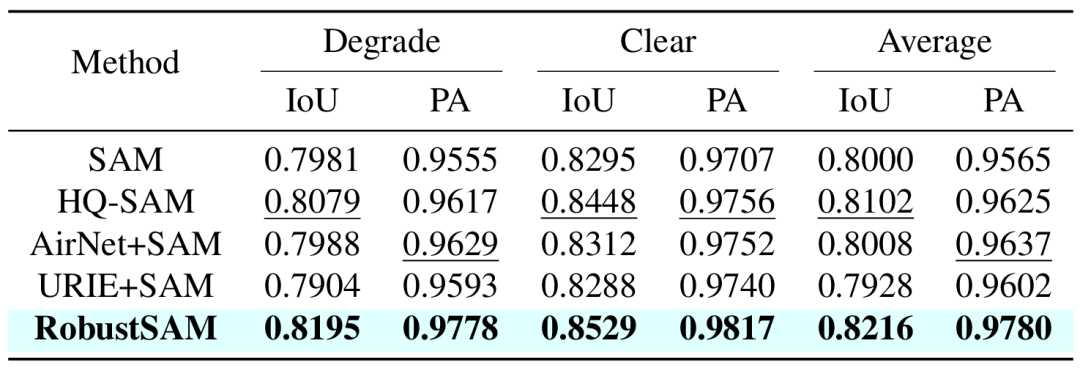

Unseen dataset with synthetic degradation

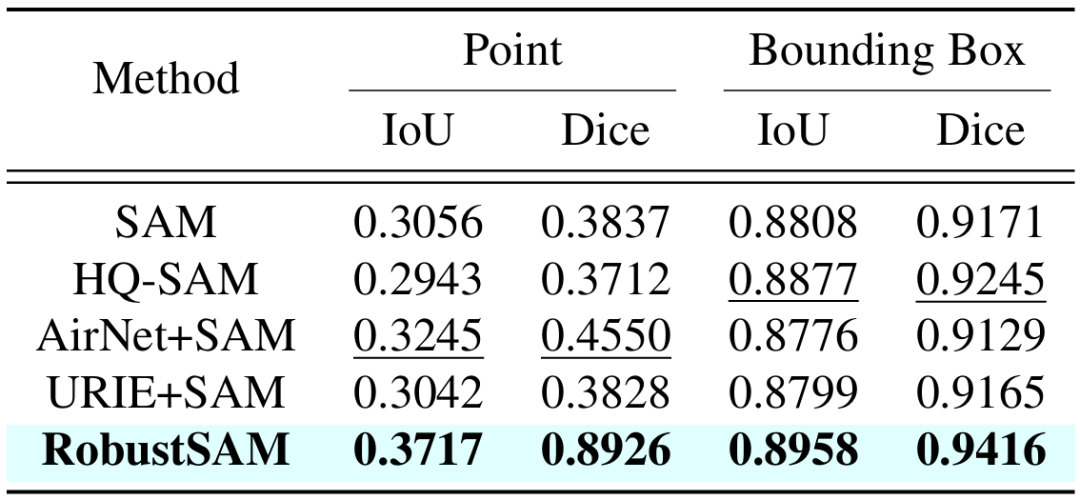

Unseen dataset with real degradation

从以上的结果可以得知,无论处理合成的degradation又或是现实世界中的degradation,RobustSAM都取得了优于其它方法的表现。

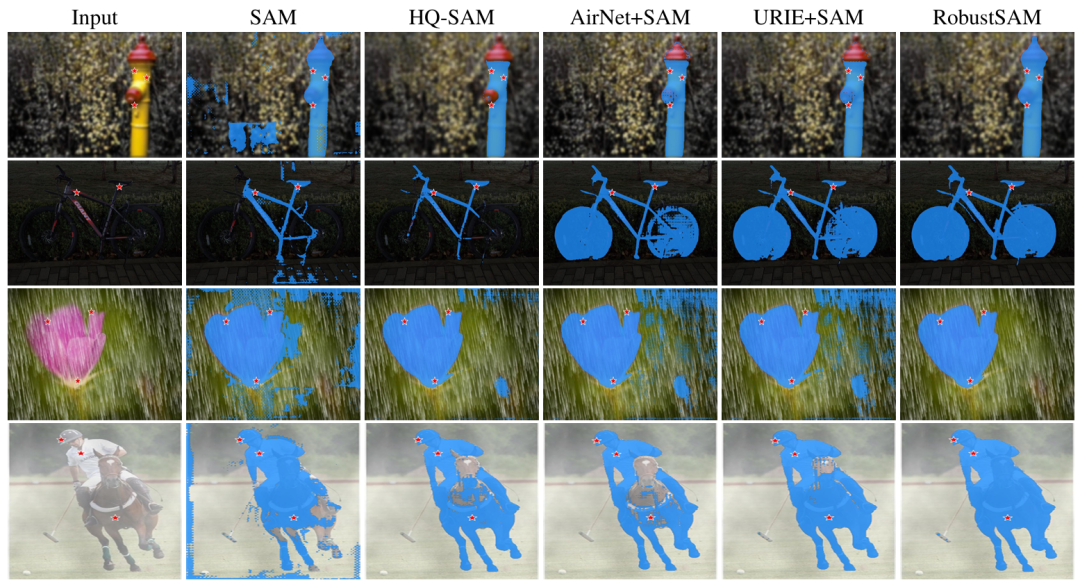

可视化结果分析(Qualitative Comparison)

上述结果清楚显示了比起其它现有的图像还原方法,RobustSAM在分割表现上有着显着的提升。

基于SAM模型的下游任务

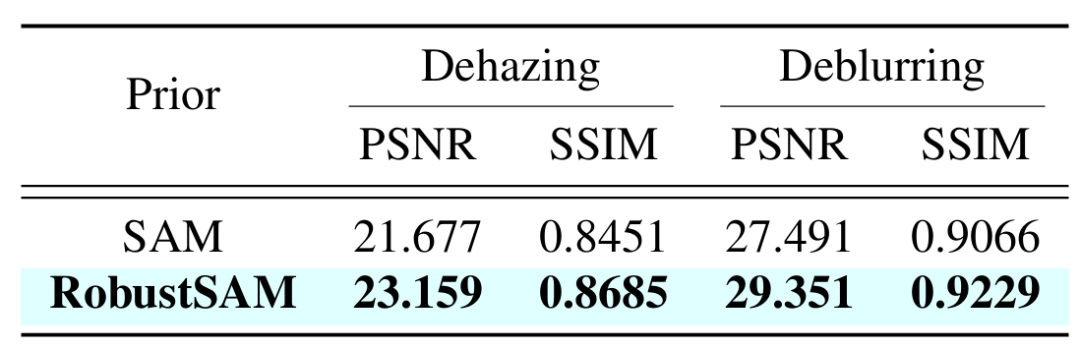

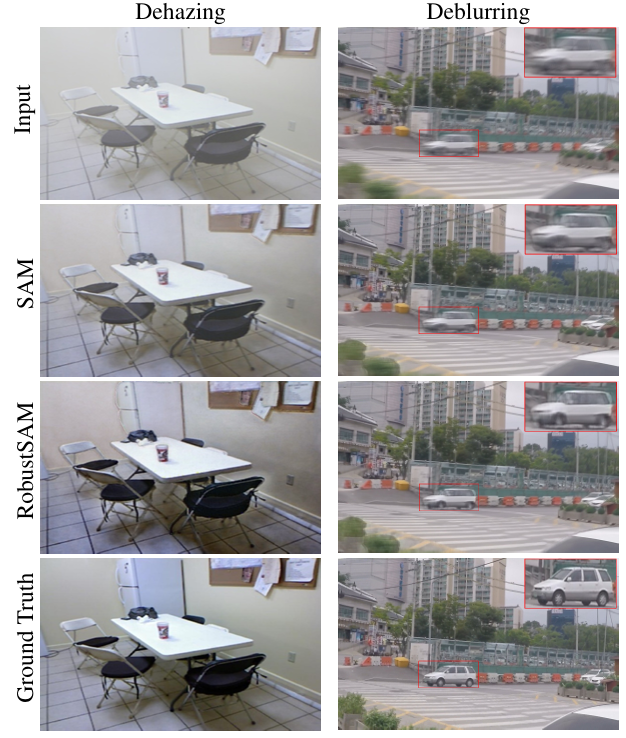

本文中同时也比较了SAM及RobustSAM在下游任务(除雾及去模糊)上的增强效果:

由此可见,在使用分割结果作为下游任务的额外先验信息时,RobustSAM对于最终的增强效果是高于SAM的。

消融实验(Ablation Study)

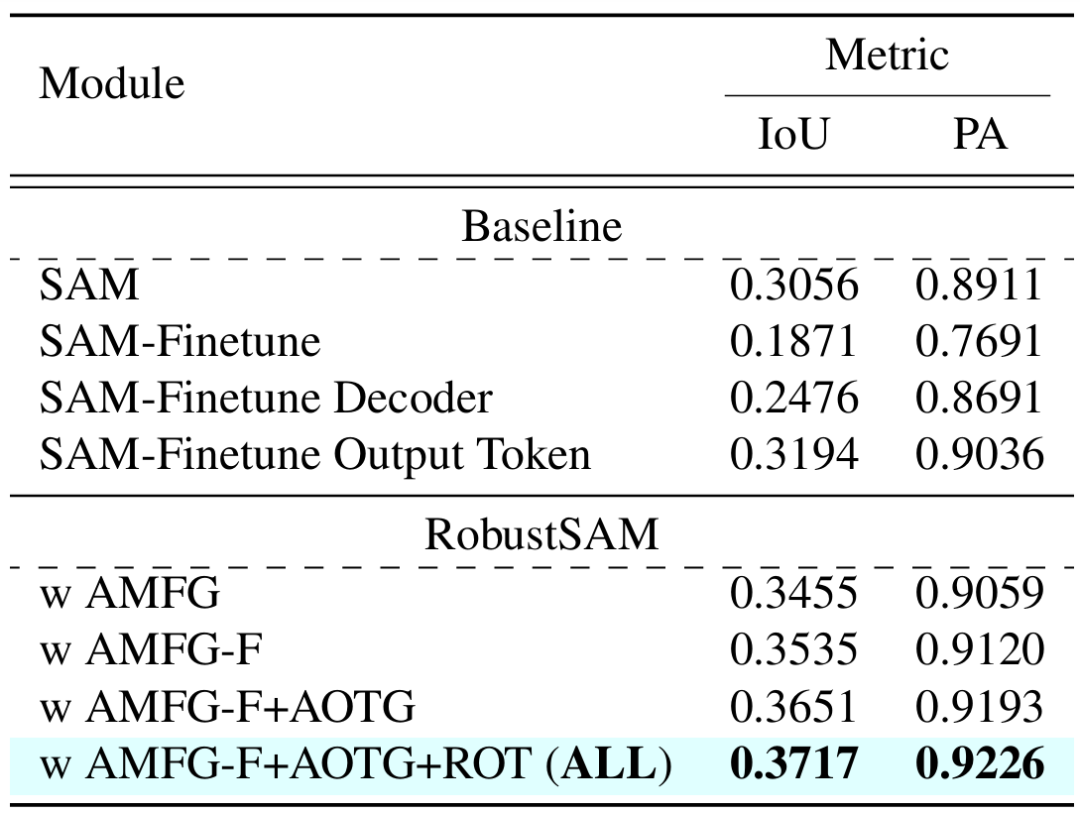

SAM模块的微调分析 & RobustSAM 架构有效性分析

从消融实验结果中可以得到以下结论:

直接微调SAM模型中的模块参数反而会导致表现比原本来得差,微调的参数量越大,表现就降低得越多。这是由于灾难性遗忘(catastrophic forgetting)所致,在学习新数据的同时,之前学到的有用信息也却被覆盖了。

RobustSAM中新增的不同模块对最终表现均有一定的提升帮助,通过这种冻结原有SAM模型参数,仅更新额外模块参数的训练方式,成功进一步提升分割表现。

结语

本文提出了RobustSAM模型用以改善原本SAM在低质量图像上,分割表现不佳的问题。通过额外新增小型的网络模块,RobustSAM大大提升了其分割能力的鲁棒性,同时也保留了SAM零样本分割的能力。

何恺明在MIT授课的课件PPT下载

在CVer公众号后台回复:何恺明,即可下载本课程的所有566页课件PPT!赶紧学起来!CVPR 2024 论文和代码下载

在CVer公众号后台回复:CVPR2024,即可下载CVPR 2024论文和代码开源的论文合集Mamba、多模态和扩散模型交流群成立

扫描下方二维码,或者添加微信:CVer5555,即可添加CVer小助手微信,便可申请加入CVer-Mamba、多模态学习或者扩散模型微信交流群。另外其他垂直方向已涵盖:目标检测、图像分割、目标跟踪、人脸检测&识别、OCR、姿态估计、超分辨率、SLAM、医疗影像、Re-ID、GAN、NAS、深度估计、自动驾驶、强化学习、车道线检测、模型剪枝&压缩、去噪、去雾、去雨、风格迁移、遥感图像、行为识别、视频理解、图像融合、图像检索、论文投稿&交流、PyTorch、TensorFlow和Transformer、NeRF、3DGS、Mamba等。

一定要备注:研究方向+地点+学校/公司+昵称(如Mamba、多模态学习或者扩散模型+上海+上交+卡卡),根据格式备注,可更快被通过且邀请进群▲扫码或加微信号: CVer5555,进交流群

CVer计算机视觉(知识星球)来了!想要了解最新最快最好的CV/DL/AI论文速递、优质实战项目、AI行业前沿、从入门到精通学习教程等资料,欢迎扫描下方二维码,加入CVer计算机视觉(知识星球),已汇集近万人!

▲扫码加入星球学习▲点击上方卡片,关注CVer公众号

整理不易,请赞和在看

1317

1317

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?