前言:点云分类和分割方向文章–ICCV2019 oral

page:[here]

ShellNet: Efficient Point Cloud Convolutional Neural Networks using Concentric Shells Statistics

引言

基于点(point-based)的点云处理方法在pointNet(纯全局特征)基础上,需要探索局部和全局特征,并平衡好网络复杂度、训练速度与准确性。先前的方法PointNet++, SpiderCNN, PointCNN分别 有着,网络复杂,训练时间长,收敛速度慢的缺点。

而我们提出了一种方法,shellNet,解决了这些缺点。

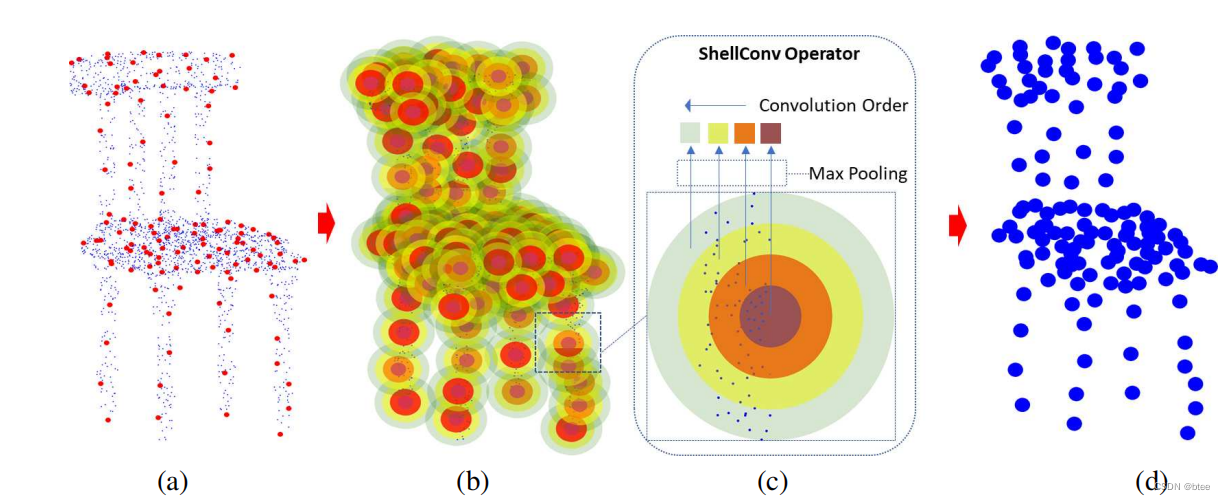

shellNet通过设计了一个同心球壳,通过球壳内的统计特征来将无序点变成有方向,从而可以进行带方向的卷积而不是无方向的mlp。

同时由于同心球壳可大可小,可以控制感受野,不用增加网络层数也能达到较大的感受野

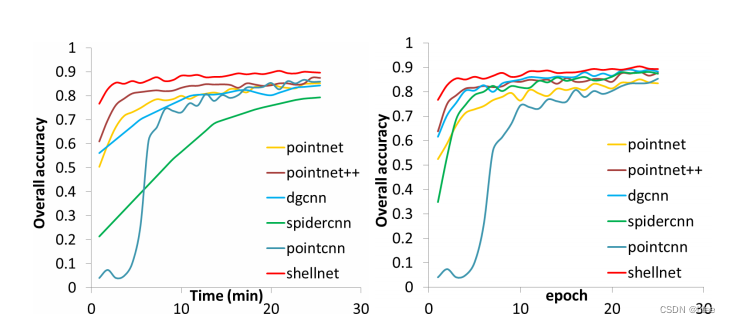

这是shellNet方法在点云分类的取得的效果与训练时间和迭代次数之间的关系

方法

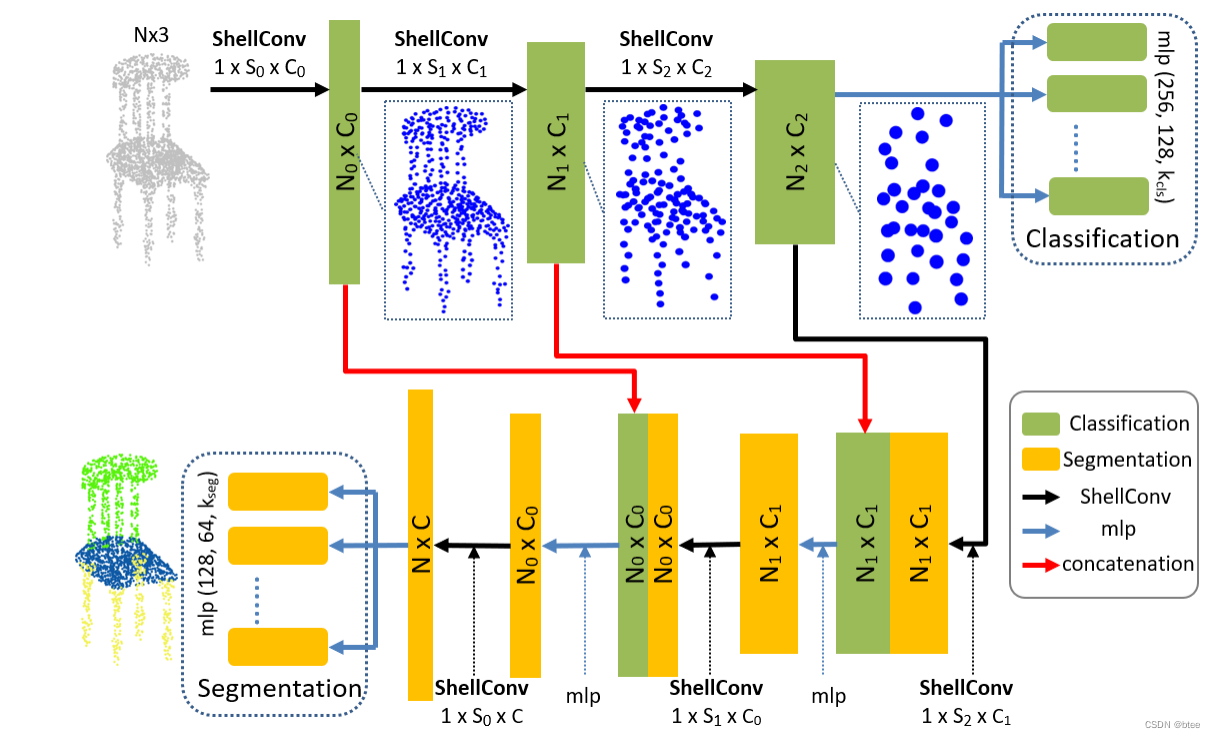

shellnet的网络架构如下

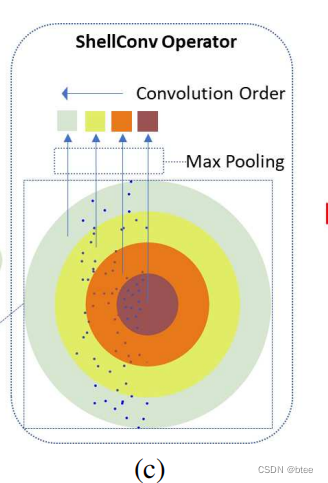

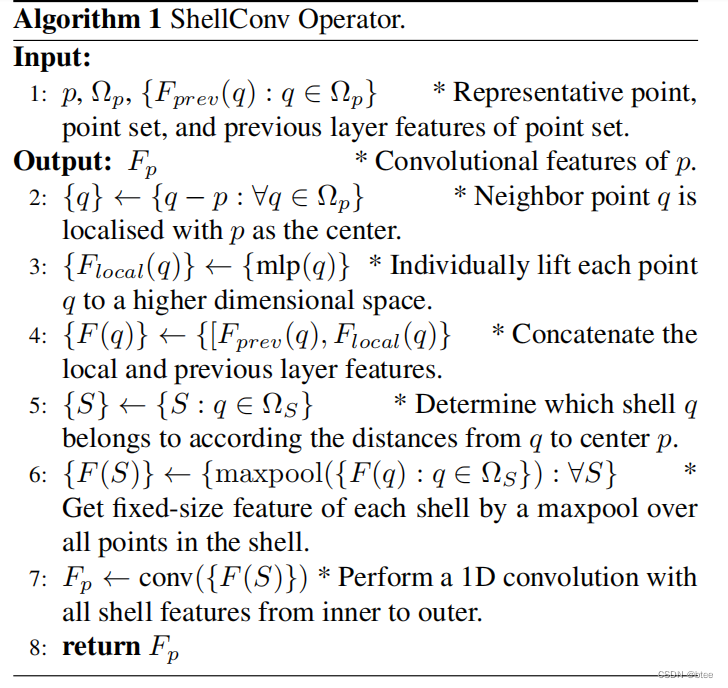

其中最核心的设计,也就是基于点的shellconv是怎么实现的

问题引入

对点云的处理需要提取它的全局和局部特征

同时,点云是无序的,且不同区域密度不同

我们需要提出一种卷积来同一解决这种特点的点数据

问题分析

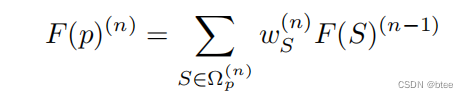

通常对于第n层的点云特征,提取某个点的局部特征,则集合邻域特征对其卷积就行

然而,这里的卷积是带有方向的,w只分配给固定位置的点。

即,权值必须适合于训练,即w必须离散成一个固定大小的可训练参数向量。为每个点定义w是不实际的,因为这些点不是有序的。原文如下:

The weights have to be suitable for training, i.e., w has to be discretized into a fixed size vector of trainable parameters. Defining w for each point is not practical because the points are not ordered.

为了让无序的点分配上有序的卷积权重,这里利于邻域来划分区域,即利用同心球划分区域,然后用一个固定的统计特征替代同一同心球中的特征,这样得到的特征就是有序的

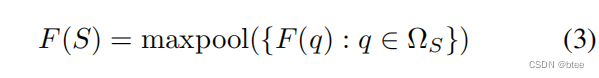

而同一同心球中的统计特征由最大池化得到

因此,shellconv的实现可由下图所示

问题解决

最后,在实现上,通过计算邻点之间的距离,对所有邻点进行排序。并根据它们到中心的距离,从内到外,将点分配到壳上。我们给每个壳分配一个固定数量的点,也就是说,每个壳分配n个点,首先从中心长一个球体,直到n个点落在球体内部。这是最里面的外壳。然后球体继续生长,收集另n个点形成第二个壳,以此类推。

这样的操作也很容易实现,而且开销也很低。

实验

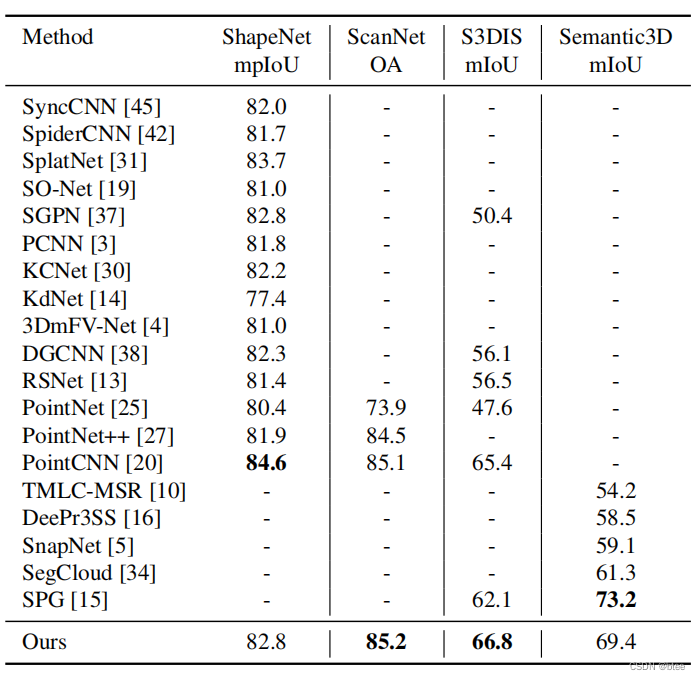

ModelNet40分类结果

不同数据集分割结果

参数量和计算量,训练推理时间比较

结论

文章写得很清晰,虽说代码也是tensorflow实现的,但是光看文章已经可以理解怎么实现的了

573

573

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?