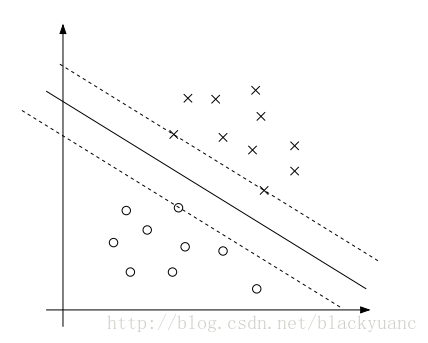

通过前三章的讨论,当我们拿到一给定数据集时第一要务是寻找一条分界线时分界线两边的点到线的(几何)间隔最大,达到这一要求即认为这是个好的分类器。这样的分类器会在正负样本间画出一个断层(几何间隔)。

现在我们又一个线性可分的训练集(即存在一超平面将正负样本分开),如何找到有最大几何间隔的分类器呢?用数学语言描述该问题:

我们要最大化数据集的最小几何间隔 γ ,该间隔小于等于数据集中所有点几何间隔。解决这个问题就是确定一组 (w,b) 使得几何间隔最大。需要注意 ∥w∥=1 是一个非凸约束,标准的最优化方法难以解决,我们需要转换成更易求解的形式:

现在我们要优化这个参数 γ^/∥w∥ ,且保证所有样本函数间隔都小于 γ^ 。通过公式转化我们摆脱了 ∥w∥=1 的条件要求,但是 γ^/∥w∥ 依然是一个非凸目标函数还需继续转换。之前我们提到通过缩放 (w,b) 可以改变 γ^ 的值,我们现在令 γ^=1 ,那么 γ^/∥w∥=1/∥w∥ ,又 1/∥w∥ 的最大值就是 ∥w∥2 的最小值,公式改写为:

至此问题转化为一个凸二次目标函数在线性约束下的求解问题。求解的结果就是最优间隔分类器。最优分类器的第一部分即到此为止,接下来我们会讨论拉格朗日对偶性,这可以帮助推导问题的对偶形式,转化为对偶形式后就可使用核方法将样本映射到高维空间,大大提高模型的可用性。

3428

3428

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?