©PaperWeekly 原创 · 作者 | 段成真

单位 | 小米AI Lab

研究方向 | 自然语言处理

论文标题:

DABERT: Dual Attention Enhanced BERT for Semantic Matching

论文链接:

https://arxiv.org/abs/2210.03454

论文动机

短文本语义匹配一直是一个非常热门的方向,广泛应用在工业界搜索、推荐、广告等领域的召回排序模块。虽然 BERT 等基于 Transformer 的预训练语言模型在语义句子匹配方面取得了显著成果。但是现有匹配模型一直有很严重的问题,那就是模型存在捕捉细微差异的能力不足的问题,这就给引擎在长冷相关性判断上带来了很大的挑战,如果识别出文本对中的细微差异,可以为用户提供更好的用户体验。

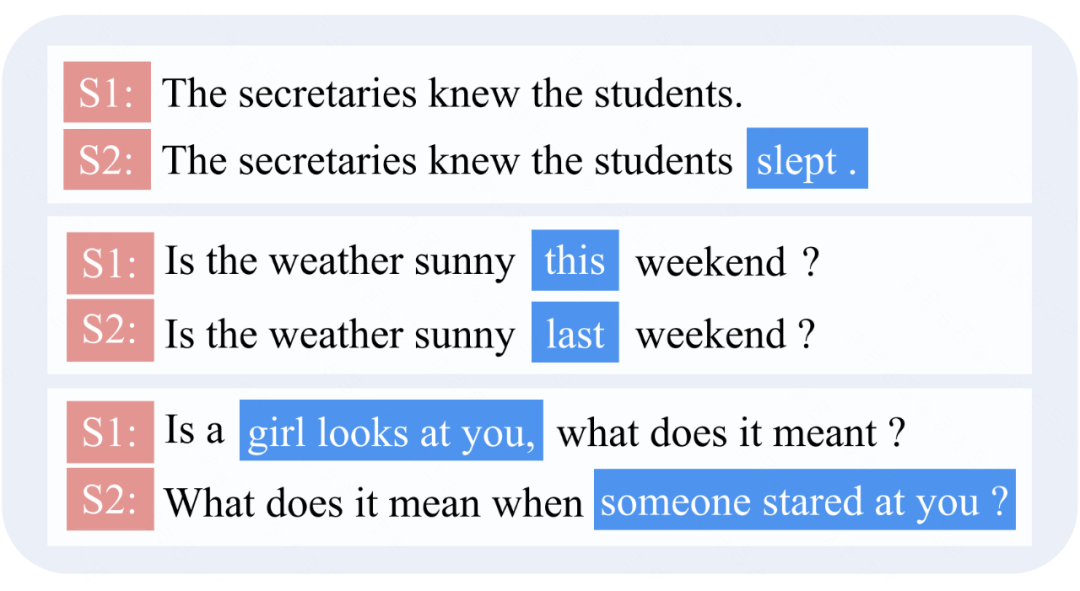

例如下图的例子,诸如单词的添加,删除和修改句子之类的细微改动可能会导致语义预测错误。尽管图中的句子对在语义上有所不同,但它们在字面上过于相似,以至于那些预先训练好的语言模型无法准确区分。

那么这个时候如何让模型感知到这些差异,增强模型对文本的理解?这就是本文要解决的问题。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

8805

8805

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?