近日,中山大学人机物智能融合实验室(HCP-Lab)团队的论文 Cross-Modal Causal Relational Reasoning for Event-Level Visual Question Answering(基于跨模态因果关系发现的事件级问答推理)被人工智能领域的国际顶级学术期刊 IEEE Transactions on Pattern Analysis and Machine Intelligence(TPAMI)接收。

TPAMI 是中国计算机学会(CCF)推荐的人工智能领域 A 类期刊,也是目前计算机类别中影响因子最高(影响因子 24.314)的期刊之一。下面带来该论文的详细解读。

简介

论文标题:

Cross-Modal Causal Relational Reasoning for Event-Level Visual Question Answering

论文作者:

刘阳,李冠彬,林倞

论文链接:

https://arxiv.org/abs/2207.12647

代码链接:

https://github.com/HCPLab-SYSU/CMCIR

因果驱动的视觉-语言推理开源框架Causal-VLReasoning:

https://github.com/HCPLab-SYSU/Causal-VLReasoning

研究动机

跨模态事件级问答推理建立在基于视频的事件理解基础上,要求推理模型需要同时具备多模态视觉语义理解、时空表征学习、自然语言理解与生成和因果关系发现能力,实现对真实事件的深度理解,达到人机协同的自然交互,具有广泛的应用前景:包括聊天机器人 ChatGPT、智慧教育机器人、人机交互系统、医疗问诊系统等。

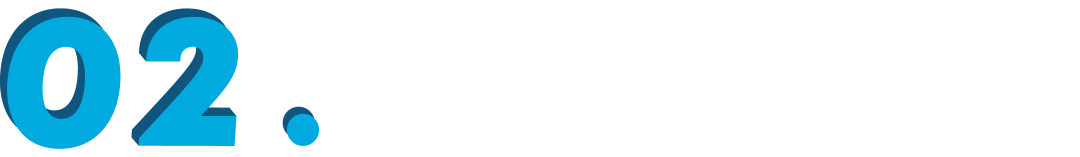

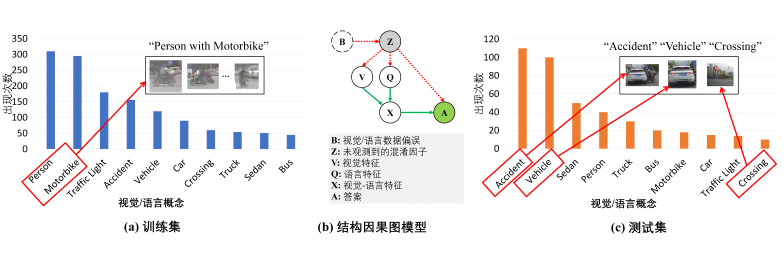

▲ 图1:事件级反事实问答推理任务示例

首先,现有的问答方法通常关注相对简单的事件,比如电影、TV-show 或者是合成视频,在这些视频类型中,时域理解和因果发现可能并不需要表现得很好。但是,这些方法却忽略了更复杂并且更具挑战性的事件,这些事件需要深入的因果、时空动态和语言关系的理解。

如图 1 所示,给定一个视频和一个相关问题,对于人类来说,一个典型的推理过程是先记住每个视频帧出现的相关目标和它们之间的交互关系(比如,车在路上行驶、人骑摩托车,穿过马路),然后根据这些记忆的视频内容推断出对应的答案。

然而,图 1 中的事件级反事实视觉问答任务需要得到特定假设条件下给定视频没有发生的事件对应的结果(比如,当人没有骑摩托车穿过马路时)。如果我们仅仅简单地将这些相关的视觉内容关联起来,而忽略其中隐含的时空和因果关系,我们可能得不到正确的推理结果。为了准确地在反事实条件下推理得到设想事件的答案,我们需要模型同时拥有层次化的关系推理能力和充分挖掘视觉语言内容包含的因果、逻辑和时空动态结构能力。

▲ 图2:示例:为何缺乏因果推理的跨模态问答推理模型会学习到浅层关联?(a)训练集中包含视觉和语言偏误, person和motorbike两个概念出现频次很高,(b)结构因果图模型(structured causal model)展示了混淆因子(confounders)是如何给事件级问答推理任务带来浅层关联(spurious correlation)的,绿色路径表示了无偏误的问答推理过程(包含真正的因果关系),红色路径表示混淆因子导致的有偏误问答推理过程,(c)当在测试集给一些 vehicle 和 accident 高度相关的样本时,模型可能不会利用真正的问题语义和显著的视觉线索来推理出正确答案。

其次,现有的跨模态问答推理方法通常捕捉的是混淆因子(confounders)带来的浅层(spurious)的语言或者视觉关联,而不是真正的因果结构和因果驱动的跨模态表征,这会导致不鲁棒且不可信赖的推理过程,无法捕捉视频中跨事件的时间性、因果性和动态性,如图 2 所示。

图灵奖得主 Judea Pearl 提出因果学习的三个层次(即关联,干预和反事实),并指出现有基于深度学习的大数据模型倾向于基于关联性去刻画数据背后的信息,学到的只是低层次的关联关系,这种建模方式难以得到数据背后的因果关系,其可解释性和鲁棒性在复杂应用场景下无法得到保证。

因此,本工作关注的重点是:1)如何设计有效的跨模态因果干预方法,对视觉和语言样本的共通推理路径进行聚类、归纳,来缩小视觉和语言模态的数据偏误?2)如何设计事件级因果发现方法,在时空层面挖掘复杂事件的潜在因果逻辑链条和关系变量,并建立基于多层因果推理结构的跨模态因果关系?

研究方法

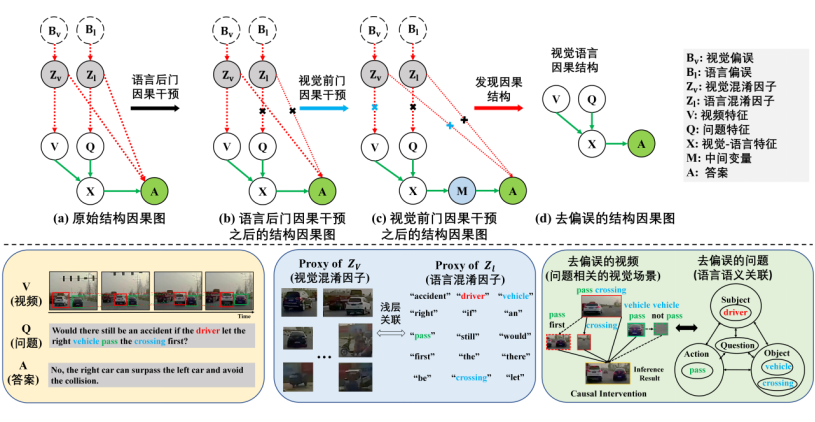

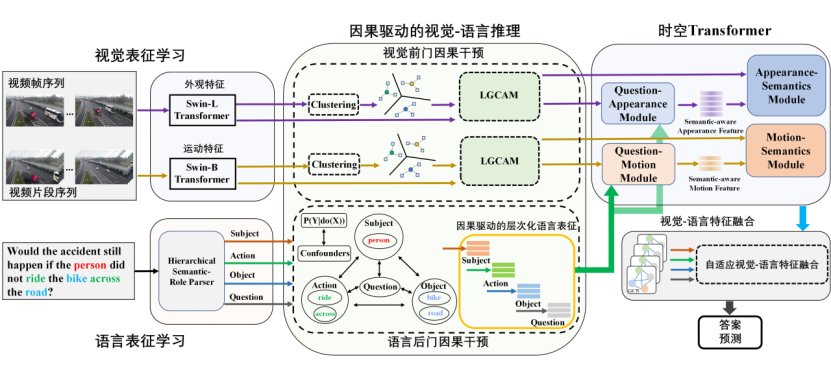

为了实现上述两个目标,我们提出了一个跨模态因果关系推理的框架(CMCIR)。具体而言,我们基于因果关系图对问答推理过程进行了建模,如图 3 所示,并引入了一系列因果干预操作,来发现视觉和语言模态之间的潜在因果结构。

我们的跨模态因果关系推理框架(CMCIR)包括三个模块:i)因果感知的视觉-语言推理(CVLR)模块,通过因果前门和因果后门干预的协同来减弱视觉和语言的虚假相关性;ii)时空 Transformer(STT)模块,用于捕捉视觉和语言语义之间的细粒度交互;iii)视觉-语言特征融合(VLFF)模块,自适应地学习全局语义感知的视觉-语言表征。

我们在四个事件级问答推理数据集 SUTD-TrafficQA, TGIF-QA, MSVD-QA, 和 MSRVTT-QA 上进行了的大量实验,证明了我们的 CMCIR 在发现视觉-语言因果结构和实现鲁棒问答推理方面的优越性。

该工作的主要贡献是:

◆ 该工作首次在事件级问答推理任务中实现了跨模态因果结构发现。提出了一种因果驱动的事件级视觉问答框架 CMCIR,通过对视觉和语言模态的因果干预,来发现真实的因果结构,并实现鲁棒的的事件级问答推理。

◆ 提出了一个由语言语义关系引导的语言后门因果干预模块,以减弱语言偏误并挖掘语言模态内部的因果关系。为了减弱视觉的虚假相关性,我们提出了一个局部-全局因果注意力模块(LGCAM),通过前门因果干预来聚合局部和全局的视觉表示。

◆ 构建了一个时空 Transformer 模块(STT),用于建模视觉和语言知识之间的多模态交互关系,挖掘语义、空间和时间表征之间的细粒度交互关系。

▲ 图3:所提出的视觉-语言因果干预的因果结构图。绿色路径表示无偏的视觉问答,即真实的因果效应。红色路径显示由混淆因子引起的有偏视觉问答,也被称为后门路径。图的底部部分通过视觉-语言因果干预对一个真实的VideoQA样本进行直观解释。

因果感知的视觉-语言推理(CVLR)

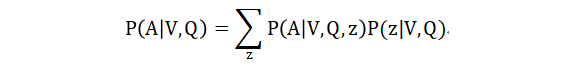

对于事件级视觉问答,我们采用 Pearl 的结构因果图(SCM)来建模视频-语言对和答案之间的因果关系,如图 3 所示。节点表示变量,边表示因果关联。我们希望能够训练一个视频问答模型来学习真正的因果关系:模型应该基于视频特征和问题特征来推理得到答案,而不是利用由混淆因子和带来的浅层关联(例如,过分利用视觉和语言概念的共生关系)。在 SCM 模型中,一个未干预的预测模型可以用贝叶斯公式表示:

然而,上述目标不仅能学到主要的因果关系,还会学习到来自未被阻断的后门路径带来的浅层关联。我们将对的干预表示为,该操作断开了的连接从而阻断了后门路径。通过这种方式,模型可以学习到真正的因果关系。

事实上,计算有两种方式,分别是后门干预和前门干预。后门干预在混淆因子可以观测时有效。然而,在事件级视觉问答任务上,视觉和语言模态的混淆因子并不总是可观测的。因此,本论文基于视觉-语言模态的特点,同时采用后门因果干预和前门因果干预方法来挖掘视觉-语言跨模态因果结构。

(1)语言后门因果干预

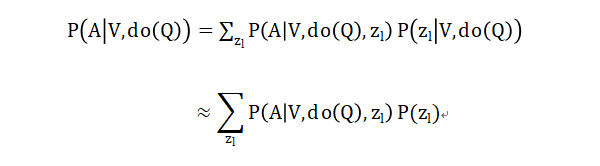

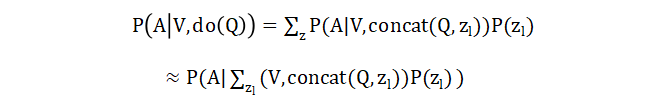

为了减少混淆因子带来的数据偏误并挖掘语言模态背后的因果结构,我们设计了一种基于语言层次化关系结构的后门调整策略来近似混淆因子分布。隐含的混淆因子集合可以由层次化问题组合近似得到。如图 3(b)所示,如果将后门路径阻断,可以使得有公平的机会将因果相关的因素考虑进来。基于后门干预的分布可以表示为:

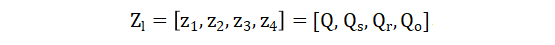

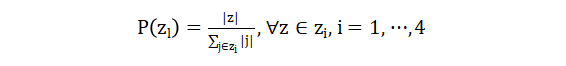

为了计算上述公式,我们将混淆因子集合 Z1 近似为 verb 为中心的关联字典集合

先验概率可以基于数据库统计计算得到:

其中 zi 表示其中的一个关联字典集,|z| 表示 z 中的样本数目,| j | 表示短语 j 出现的次数。由于 P(A|V, do(Q)) 是由 softmax 计算得到的,我们可以采用 Normalized Weighted Geometric Mean (NWGM) 方法来近似:

(2)视觉前门因果干预

后门干预需要我们提前知道混淆因子。然而,在视觉模态,数据偏误往往十分复杂,导致我们很难知道并区分不同的混淆因子。现有的方法通常将混淆因子定义为视觉特征的平均,事实上,由于复杂异质时空数据本身的特点,平均特征不能正确地表示特定的混淆因子。当我们不能显式地表示混淆因子时,前门干预提供了一种可行的方式来计算 P(A|V, do(Q))。

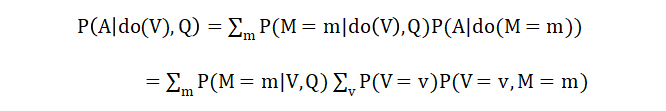

如图 3(c)所示,为了实现前门干预,我们需要在 X 和 A 之间添加一个额外的中间特征 M,从而构建前门路径 V→X→M→A 来传输知识。对于视觉-语言问答任务,一个基于注意力的模型 P (A|V, Q) = Σm P (M = m | V, Q) P (A | M = m) 能够基于问题 Q 从视频 V 中选取一些区域来预测答案 A ,其中 m 表示从 M 选取的知识。然后,答案预测器可以由两部分组成:一个特征提取器 V→X→M 和一个答案预测器 M→A 。因此,干预概率可以表示为:

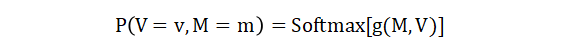

为了在深度学习框架实现视觉前门干预,我们将 P ( V = v , M = m ) 参数化为网络 g ( · ) :

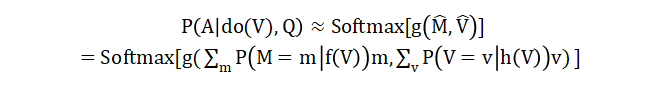

可以看出,M 和 V 都可以被采样然后输入到网络来实现 P(A | do(V) , Q ) 。然后,将所有样本都输入到前向网络代价是高昂的,为此,我们采用 Normalized Weighted Geometric Mean (NWGM) 方法来近似公式:

其中 M (hat) , V (hat) 表示 M 和 V 的估计, h ( · ) 和 f ( · ) 表示网络映射函数。

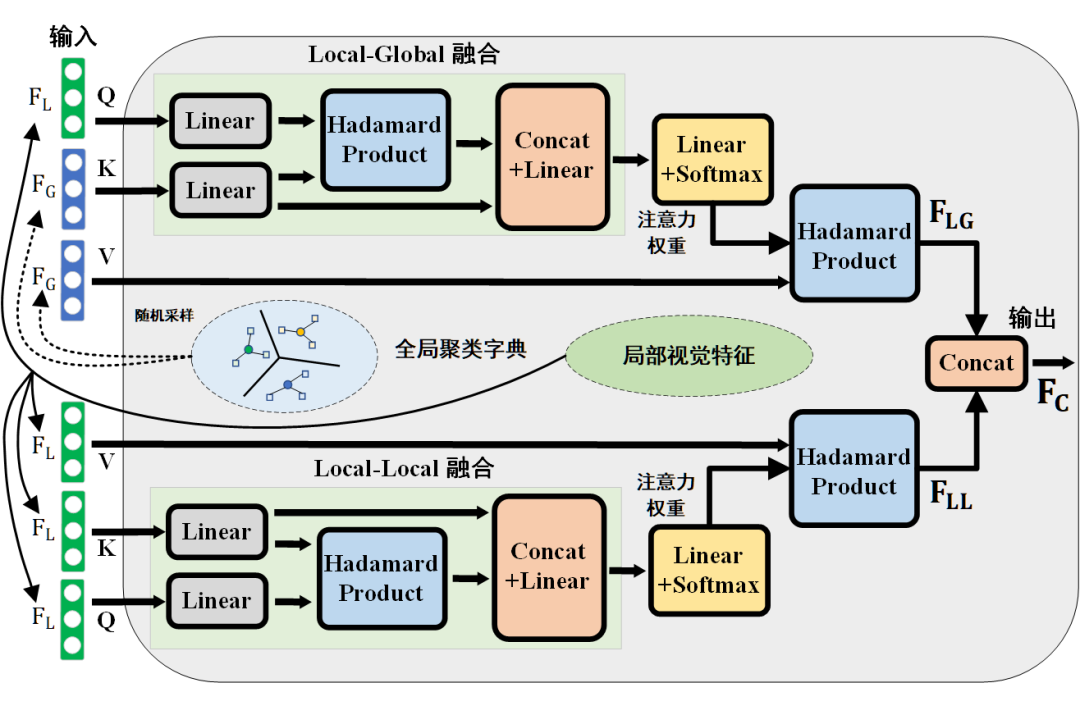

▲ 图4. 局部-全局(Local-Global)因果注意力(Causal Attention)模块

事实上,M (hat) 和 V (hat) 都可以用注意力网络来计算。M (hat) = Σm P (M = m | f(V)) m 可以通过计算 local-local 视觉特征 F_LL 得到,V (hat) = Σv P (V = v | h(V)) v 可以通过计算 local-global 特征 F_LG 得到。因此,我们提出一个全新的局部-全局因果注意力模块(Local-Global Causal Attention Module, LGCAM)来联合估计 M (hat) 和 V (hat),从而提升视觉特征的因果表征能力。

这里,我们以 F_LG 的计算为例说明 LGCAM,如图 4 上半部分所示。具体的,我们首先计算 F_L = f (V) 和 F_G = h (V),然后作为 LGCAM 的输入,其中 f ( · ) 表示视觉特征提取器,h ( · ) 表示基于 K-means 的视觉特征选择器。因此,F_LG 的计算如下:

类似的,当设置 Q = K = V = F_L,F_LL 可以用同样的方式计算得到。最终,我们将 F_LL 和 F_LG 串联得到最终的 P(A | do(V) , Q ) 估计结果。

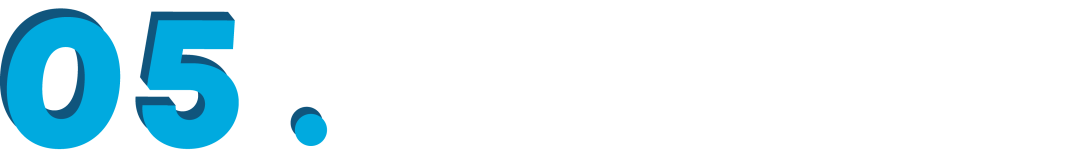

时空Transformer

为了挖掘语言和时空表征之间的细粒度关联,我们构建了一种时空 Transformer 模块,该模块包含四个子模块,分别是问题-外观(Question-Appearance, QA),问题-运动(Question-Motion, QM),外观-语义(Appearance-Semantics, AS),和运动-语义(Motion-Semantics,MS)模块,如图 5(a)所示。

QA 和 QM 模块各自包含 R-层多模态(Multi-modal)Transformer Block (MTB),如图 5(b)所示,MTB 的目的是建立问题和外观(运动)特征之间的多模态交互关系。类似的,AS 和 MS 模块同样采用 MTB 来基于问题语义推理出外观和运动信息。具体信息请参阅原论文。

▲ 图5. 时空Transformer模块示意图(图(a)),和多模态Transformer模块(图(b))

结合视觉表征学习模块、多模态语言和视觉时空结构多层次关系建模模块、视觉-语言跨模态因果结构发现模块、时空 Transformer 和视觉语言特征融合模块,我们构建了一个统一的鲁棒可信赖的细粒度事件级视觉问答框架 CMCIR,该框架能够对时空视觉关联、语言语义关联和视觉-语言因果关系进行细粒度的理解,并高效融合跨模态视觉语言语义关联和因果关联关系,实现鲁棒可信赖的细粒度事件级视觉问答,如图 6 所示。

▲ 图6. 基于跨模态因果关系推理的事件级视觉问答框架

总结

该工作首次在事件级问答推理任务中探索了跨模态因果关系发现的可能性,在结构因果图(Structural Causal Model, SCM)的视角下,创新性地引入了视觉因果前门干预和语言后门因果干预模型,以增强事件级问答推理模型的鲁棒性和可信性。该研究的重要意义在于为未来探索如何利用因果范式提升多模态大模型的鲁棒性、可解释性和可信性提供了思路和启发。

中山大学 HCP 团队长期致力于鲁棒、可信、可解释人工智能的研究,基于多模态大模型的认知推理任务,以一种因果驱动的方式来实现鲁棒可信的高阶语义推理,在人机对话、视觉导航、图像/视频生成、图像/视频标注、医学影像报告生成等任务上开展了持续而深入的研究工作,并建立了因果驱动的视觉-语言推理开源框架Causal-VLReasoning:

https://github.com/HCPLab-SYSU/Causal-VLReasoning

中山大学 HCP 团队在多模态人工智能领域有深厚的研究基础,以融合领域知识和语义信息的深度表达学习为主线,从感知单模态大模型到认知多模态大模型,逐步构建认知启发和因果推理引导的视觉计算与推理理论及方法体系。

更多阅读

#投 稿 通 道#

让你的文字被更多人看到

如何才能让更多的优质内容以更短路径到达读者群体,缩短读者寻找优质内容的成本呢?答案就是:你不认识的人。

总有一些你不认识的人,知道你想知道的东西。PaperWeekly 或许可以成为一座桥梁,促使不同背景、不同方向的学者和学术灵感相互碰撞,迸发出更多的可能性。

PaperWeekly 鼓励高校实验室或个人,在我们的平台上分享各类优质内容,可以是最新论文解读,也可以是学术热点剖析、科研心得或竞赛经验讲解等。我们的目的只有一个,让知识真正流动起来。

📝 稿件基本要求:

• 文章确系个人原创作品,未曾在公开渠道发表,如为其他平台已发表或待发表的文章,请明确标注

• 稿件建议以 markdown 格式撰写,文中配图以附件形式发送,要求图片清晰,无版权问题

• PaperWeekly 尊重原作者署名权,并将为每篇被采纳的原创首发稿件,提供业内具有竞争力稿酬,具体依据文章阅读量和文章质量阶梯制结算

📬 投稿通道:

• 投稿邮箱:hr@paperweekly.site

• 来稿请备注即时联系方式(微信),以便我们在稿件选用的第一时间联系作者

• 您也可以直接添加小编微信(pwbot02)快速投稿,备注:姓名-投稿

△长按添加PaperWeekly小编

🔍

现在,在「知乎」也能找到我们了

进入知乎首页搜索「PaperWeekly」

点击「关注」订阅我们的专栏吧

·

·

134

134

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?