大型语言模型(LLM)例如最近开发的 ChatGPT,可以撰写文件、创建可执行代码,并回答问题,常常具备类似人类的能力。随着这些系统越来越普遍,存在着它们可能被用于恶意目的的风险。这些风险包括利用社交媒体平台上的自动化机器人进行社会工程和选举操纵活动,制造假新闻和网络内容,以及使用 AI 系统在学术写作和编程任务中作弊。

此外,网络上合成数据的增多使得未来数据集创建工作变得复杂,因为合成数据通常不如人类内容,必须在模型训练之前检测和排除。出于多种原因,能够检测和审计机器生成文本的能力成为减少大型语言模型潜在危害的关键原则。

LM-Watermarking

论文标题:

A Watermark for Large Language Models

论文链接:

https://arxiv.org/abs/2301.10226

代码链接:

https://github.com/jwkirchenbauer/lm-watermarking

本文研究了语言模型输出的水印技术。水印是一种隐藏于文本中对人类来说不可察觉的模式,但却可以通过算法识别为合成文本。本文提出了一种高效的水印技术,可以从较短的文本片段(仅需 25 个 token)中检测到合成文本,而假阳性(将人类文本标记为机器生成)的概率极低。

水印检测算法可以公开使用,使第三方(例如社交媒体平台)能够自行运行,也可以保持私有并在 API 后台运行。我们希望水印具有以下特性:水印可以在没有任何模型参数知识或访问语言模型 API 的情况下进行算法检测。这个特性使得即使模型不公开,检测算法也可以开源。这也使得检测变得廉价和快速,因为不需要加载或运行 LLM。

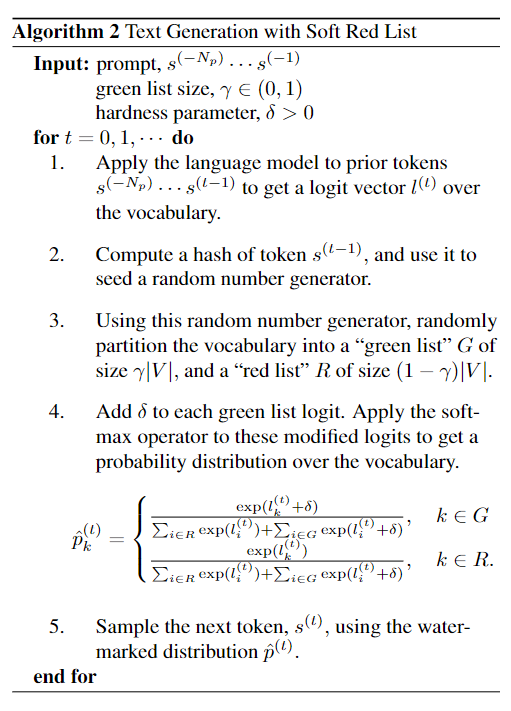

Method:提出了一种水印技术,在保持文本质量的同时,向生成的文本中嵌入唯一的水印。水印被设计为可以从很短的 token 中检测出来,并且可以使用高效的开源算法来识别。该方法涉及在生成单词之前随机选择一组“绿色”标记,并在文本生成过程中推广使用这些绿色标记。提出了一种用于水印检测的统计检验方法,提供了可解释的 p 值。

此外,给出了一个信息论框架来分析水印的敏感性。水印主要的点就在于如何划分绿色标记或者红色标记,具体算法如下所示,每次通过上一个 token 来选择一个 seed,划分标记,然后提升绿色 token 可能会被选择的概率。最终需要检测时只需要检查绿色标记出现的频率即可。

除非之外,文章还有一些有趣的实验现象

水印强度和文本质量之间的权衡:本文探索了不同水印参数下的水印强度(通过 z-score 衡量)和文本质量(困惑度)之间的权衡。实验结果表明,较小的绿色列表大小和较大的绿色列表偏差可以在对文本质量影响最小的情况下实现较强水印。

安全考虑:讨论了对水印技术的潜在攻击,如文本插入、删除和替换。针对这些攻击提出了缓解策略,以保证水印的安全性。

DIPPER

论文标题:

Paraphrasing evades detectors of AI-generated text, but retrieval is an effective defense

论文链接:

https://arxiv.org/abs/2303.13408

代码链接:

https://github.com/martiansideofthemoon/ai-detection-paraphrases

这篇论文的主要目的是探讨 AI 生成文本 Paraphrasing 的攻击,并提出一种基于检索的有效防御方法。研究人员首先训练了一个 11B 参数的偏义词生成模型(DIPPER),该模型可以对段落进行 Paraphrasing,并可选地利用上下文信息

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

5061

5061

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?