2024年11月,MCP横空出世,以破竹之势重新定义AI与外部世界的交互方式。自Anthropic公司推出MCP以来,MCP便迅速成为科技界万众瞩目的焦点,更在2025年一跃成为AI应用开发的新宠,引领人机协作新风尚!

Anthropic创始团队是GPT系列产品的早期开发者。2020年6月,OpenAI发布第三代大语言模型GPT-3。半年之后,负责OpenAI研发的研究副总裁达里奥·阿莫迪和安全政策副总裁丹妮拉·阿莫迪就决定离职,创立了一家与OpenAI有着不同价值观的人工智能公司——Anthropic。

▲达里奥·阿莫迪和丹妮拉·阿莫迪

Part.1

MCP协议就是AI界的“万能社交达人”

MCP以统一协议打破AI模型与外部工具的交互壁垒,通过标准化接口实现天气查询、数据库调用、智能设备联动等跨平台协同,同时支持上下文持久化存储,让AI对话具备连续记忆能力。

谷歌、OpenAI、阿里、百度等科技巨头已将MCP纳入技术战略,通过它提升AI服务的兼容性、扩展性与智能化水平,开发者可依托其开放生态快速构建插件化应用,企业亦能借此降低AI集成成本,加速业务创新。作为AI交互领域的关键基础设施,MCP正推动技术生态从“碎片化”走向“一体化”,为智能应用的规模化落地提供核心支撑。

2025年4月9日,阿里云 AI 势能大会在北京召开,阿里云百炼上线业界首个全生命周期 MCP 服务,无须用户管理资源、开发部署、工程运维等工作,5分钟即可快速搭建一个连接MCP服务的 Agent(智能体)。

作为云上托管 MCP 服务的最佳运行时,函数计算 FC 为阿里云百炼 MCP 提供弹性调用能力,用户只需提交 npx 命令即可“零代码”将开源 MCP Server 部署到云上,函数计算FC 会准备好计算资源,并以弹性、可靠的方式运行 MCP 服务。

如今,从智能客服到自动驾驶,从智能家居到医疗健康,MCP协议正以前所未有的速度渗透到各个行业领域。以旅行规划为例,借助MCP协议,AI能够实时获取天气、交通、景点信息,为用户量身定制最贴心的旅行方案。在办公场景中,MCP更能助力团队高效协作,实现文档自动生成、数据可视化、会议流程优化等智能化操作,让工作效率飙升!

面对MCP这一新兴而强大的技术,你是否也渴望快速掌握其精髓,成为AI时代的弄潮儿?没有技术背景,又想化身“AI六边形战士”?怎么破局呢?别担心,《MCP极简开发:轻松打造高效智能体》正是你不可多得的学习伙伴!

本书由资深AI开发者倾力打造,力求以“极简”方式让读者快速了解MCP的基本概念、核心技术、平台工具,并辅以30余个应用案例,帮助读者轻松打造个性化Agent。

▼点击下方,即可购书

Part.2

为什么选择MCP?

标准化交互,开发更轻松。MCP定义了统一的交互规则,就像给AI模型和外部工具提供了一套“通用语言”。无论你是开发AI助手、智能客服还是自动化工具,都不需要再为每个工具定制开发接口,从而大大降低了开发门槛和成本。

效率翻倍,迭代更迅速。传统的AI开发往往需要在工具集成和调试上花费大量时间。而MCP通过标准化交互,让你能够快速集成各种工具和数据,开发周期缩短50%以上,助力你更快地迭代产品,抢占市场先机。

生态共赢,创新无极限。MCP的开放性促进了AI工具生态的繁荣。越来越多的工具和数据源开始支持MCP协议,这意味着你可以轻松调用各种资源,激发无限创新可能,构建更加丰富、强大的AI应用。

Part.3

为什么选择这本书?

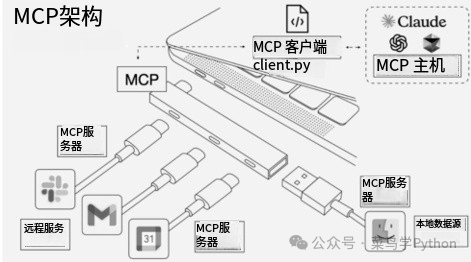

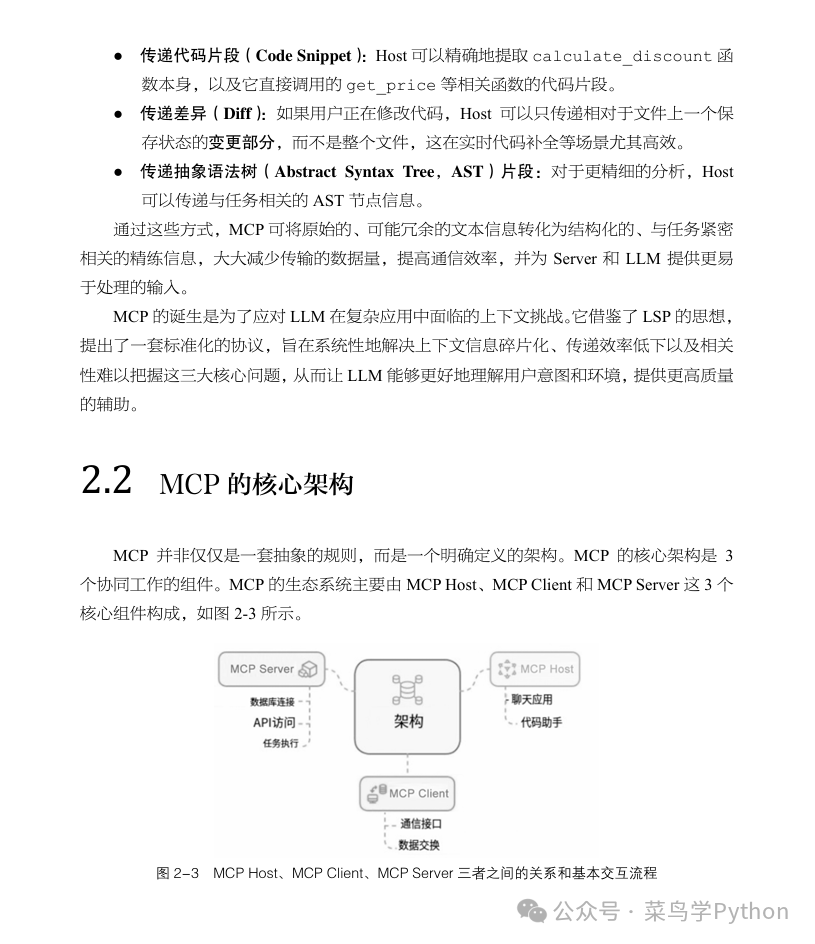

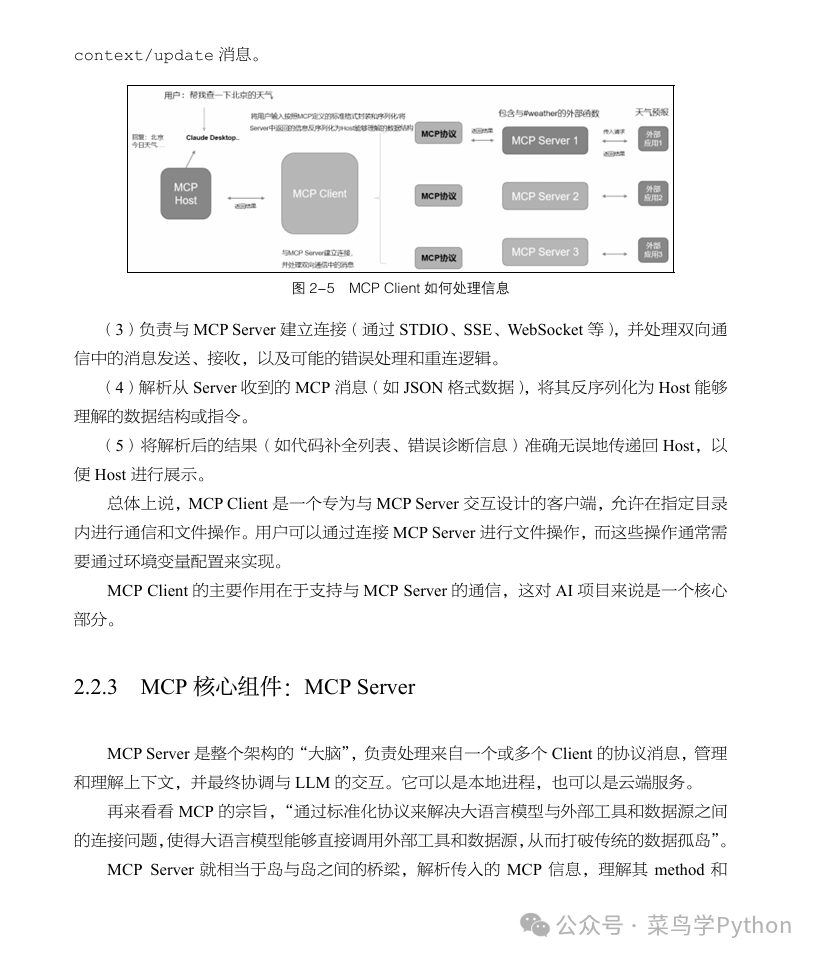

核心组件全解析。本书深入剖析MCP Host、MCP Client、MCP Server三大核心组件,让你了解它们如何协同工作来打造高效开发流水线。从上下文感知到意图识别,从请求管理到响应处理,每一个环节都清晰明了。

通信机制大揭秘。本书详细讲解MCP支持的多种通信方式,如STDIO、SSE,以及基于JSON-RPC2.0的消息格式。你将了解到如何构建高效、可靠的通信链路,确保AI模型与外部工具之间的顺畅交互。

Part.4

IDE开发神器、生活类智能体、个人效率类智能体,实战案例,即学即用。

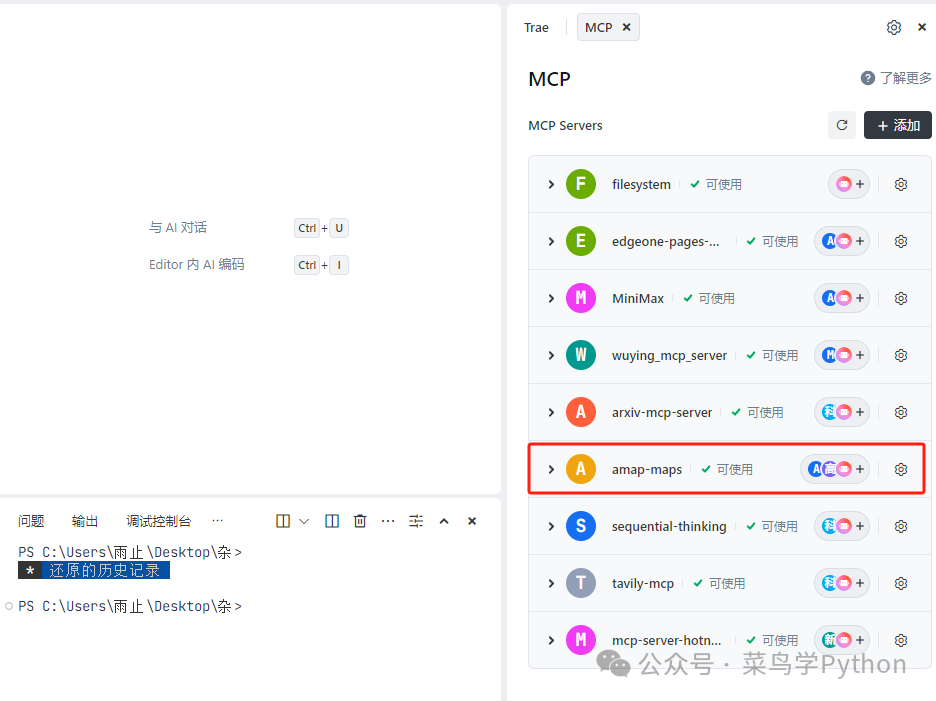

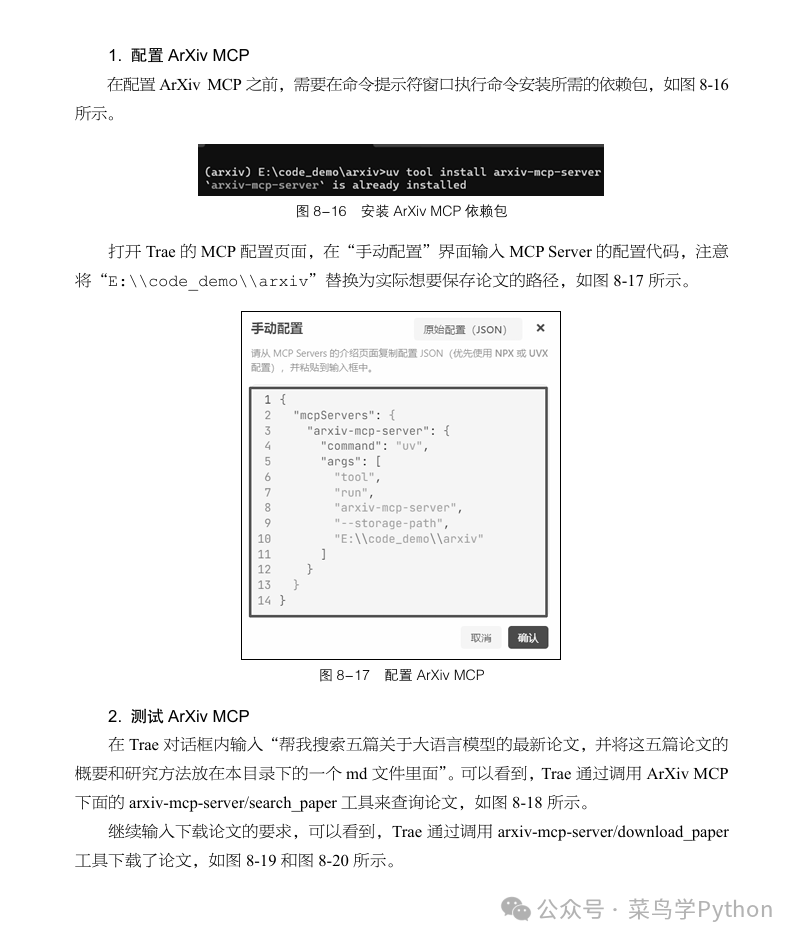

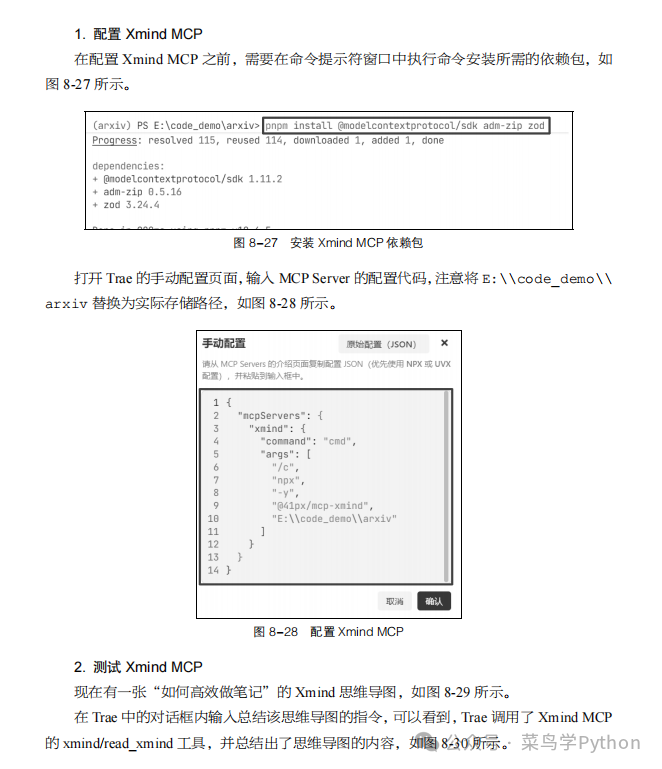

在Cline中集成GitHub MCP,实现仓库的高效查询与管理;集成Figma MCP,快速完成UI/UX原型设计;在Trae中配置ArXiv MCP,实现论文的搜索、读取和下载。MCP将协助你提升IDE开发效率,让你事半功倍。

利用高德MCP Server和Cursor构建旅行规划智能体,为你提供详细的旅行规划,包括天气预报、行程安排等;构建约会助手智能体,根据你输入的两个地点,推荐周边适合约会的地方;构建每日天气推送智能体,根据你的地理位置,提供实时天气信息、穿搭建议和出行建议。MCP将成为你的生活智能“催化剂”,让你拥有更加智能、便捷的生活。

构建网页生成部署智能体,通过EdgeOne Pages MCP服务,实现网页的一站式生成和部署;构建数据图表生成智能体,利用QuickChart MCP服务,快速生成专业图表,支持数据可视化;

构建结构化思考智能体,通过Sequential Thinking MCP服务,促进复杂问题的结构化思考和解决;构建自动配图智能体,利用Wanx文生图MCP服务,将文本描述转换为相应的图像,提升视觉内容创作效率。MCP将成为你职场的得力助手,助你构建效率飙升的利器。

Part.5

登上AI技术快车,MCP就是你的“头等舱票”!

求职时,在简历上甩出“精通MCP”,直接让你在一众竞争者中脱颖而出;技术讨论会上,打开你的MCP专题PPT,立刻就能在技术圈抢占C位!选择《MCP极简开发:轻松打造高效智能体》,解锁智能体开发全链路能力。本书有以下六大特色:

循序渐进:从基础概念到实战应用,通过案例对比直观展示 MCP 的优势,让读者快速了解 MCP 的价值。

原理清晰:详细剖析 MCP 的核心架构、通信机制和工作原理,并配合大量图示,使复杂概念变得简单易懂。

实践导向:提供完整的开发环境搭建指南,手把手教你构建 MCP Server 和 MCP Client。

案例丰富:涵盖 IDE 集成、生活服务、个人效率和办公协作等多个应用场景中的实战案例,具有极强的实用性。

资源完备:整合优质的 MCP 相关资源,提供案例代码、PPT与讲解视频,助力读者持续学习。

服务支持:通过 QQ 学习群(826753316)、公众号(可学 AI)等多个渠道提供服务支持,确保学习过程畅通无阻。

立即下单,开启你的智能体开发之旅吧!

233

233

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?