这篇文章我们将从数理上对CorssEntropyCost进行讲解,同时附上实现的代码

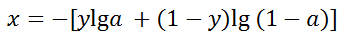

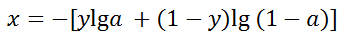

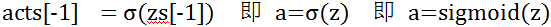

首先我们定义

因此在求得最后一层神经元

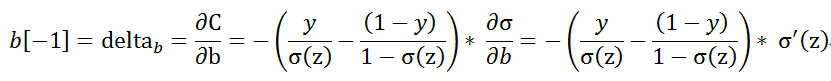

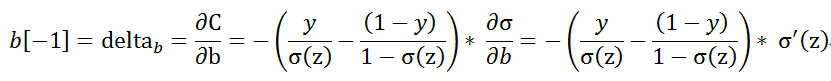

这时我们对最后一层的w,b求偏导数,

可以参考

机器学习(11.3)--神经网络(nn)算法的深入与优化(3) -- QuadraticCost(二次方代价函数)数理分析

首先我们定义

因此在求得最后一层神经元

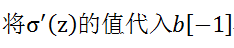

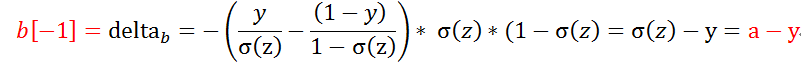

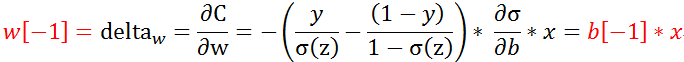

这时我们对最后一层的w,b求偏导数,

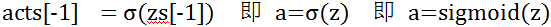

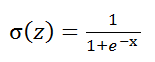

我们在sigmoid函数定义为

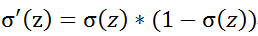

由这个我们可以推出

其中x在程序代码对应的是a[-2],

def itemData(item,layers,weights,biases):

'''单条记录的正反向计算'''

#正向计算

zs = []

acts = [item[0]]

for w,b in zip(weights,biases):

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?