在NLP相关的论文中,我们常常回看到含有 Global Information 字眼相关的论文;那么,这些文中提到的 Global Information, 到底是什么、与 local information 有什么不同、是如何计算得到的呢?; 基于这几个问题,小编以 EMNLP2019的若干篇论文为例,进行了一点点简单粗暴小小整理,希望能够淡淡地解开Global Information的神秘面纱~~~

Coupling Global and Local Context for Unsupervised Aspect Extraction

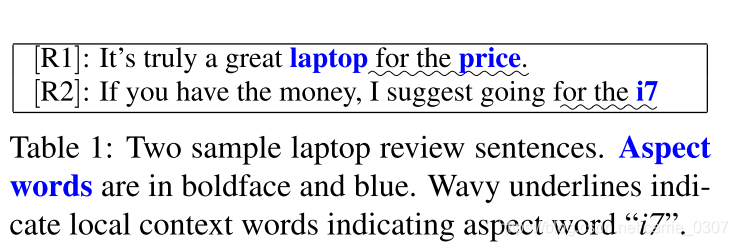

这是一篇以Aspect Extraction为任务的文章,其任务为,抽取出句子里表达观点情感的词,例如下图中的加粗的蓝色字体:

在图中的两个句子中,R1明显得出现了price的字样,而在R2中,虽然i7没有和其他aspect words同时出现,但是考虑到它的邻居词for the与R1类似,因此会猜测i7也是价格方面的观点词;且有相关的语言现象表明:

aspect words generally distinguish themselves from other words in their occurrence patterns within global and local context.

因此,本文对local和global的定义是:

- Local: What neighbors a word has;

- Global: How pairs of words co-occur with each other at sentence level;

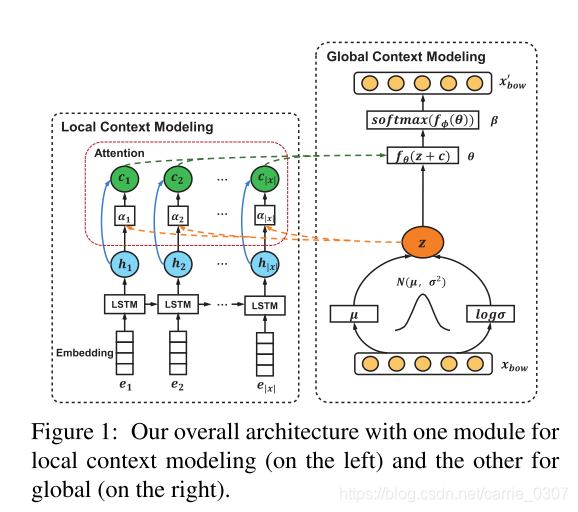

其中,二者的计算方法分别是:

- Local Context Modeling: 通过LSTM 得到句子中每个词包含local context 信息的表示;

- Global Context Modeling:

- 首先,得到每个句子在整个预料下的词袋模型表示 x b o w x_{bow} xbow

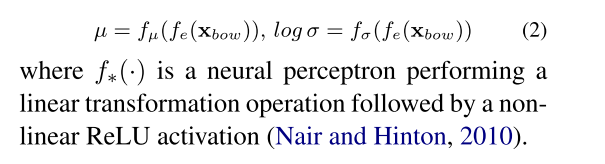

- 根据这篇论文由于 global context 中的词应当是满足高斯分布,通过encoder学习全局表示 z z z:

- Global 与 Local 的融合:

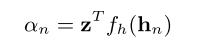

- 首先,基于 z z z 和每个词在LSTM下的表示 h n h_n hn计算每个词对应的attention值(从而更好地发现蕴含了观点信息的词):

- 然后,基于attn值的加权求和得到 globally-scoped local representation

- 首先,基于 z z z 和每个词在LSTM下的表示 h n h_n hn计算每个词对应的attention值(从而更好地发现蕴含了观点信息的词):

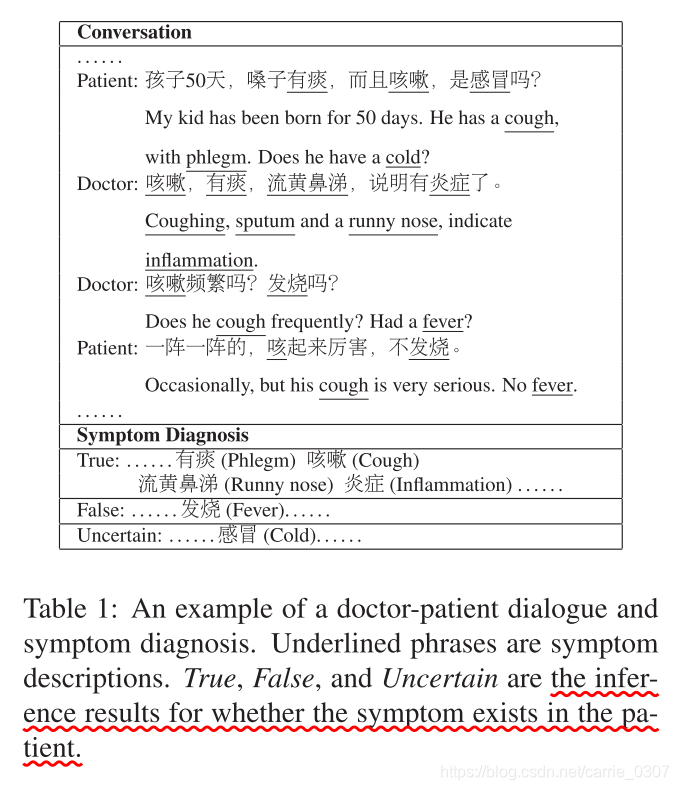

Enhancing Dialogue Symptom Diagnosis with Global Attention and Symptom Graph

本文的任务是做基于医患对话进行症状发现,即根据对话,判断出哪些症状是实际存在的:

完成这一任务,需要通过两个步骤进行: 一是症状识别,与NER任务类似,需要从医患对话中识别出存在哪些症状的名字;二是症状推理, 即判断某一症状是否真正存在。

在症状识别过程中,需要得到医患对话中每个词的表示,正是在这一阶段中,作者引入了Global Attention Mechanism来捕捉与症状描述有关的信息。Global Attention Mechanism具体包括两部分:

- Document Level Attention:我们将如Table1所示的一份完整对话称作是一份document, 一份Document由若干个句子 S 1 , S 2 , . . . {S_1, S_2, ...} S1,S2,... 构成, 每个句子 S p S_p Sp 又由若干个词组成 S p = w p 1 , w p 2 , . . . , S_p = {w_{p1}, w_{p2}, ..., } S

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

116

116

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?