Part 1:

Vision transformer

-

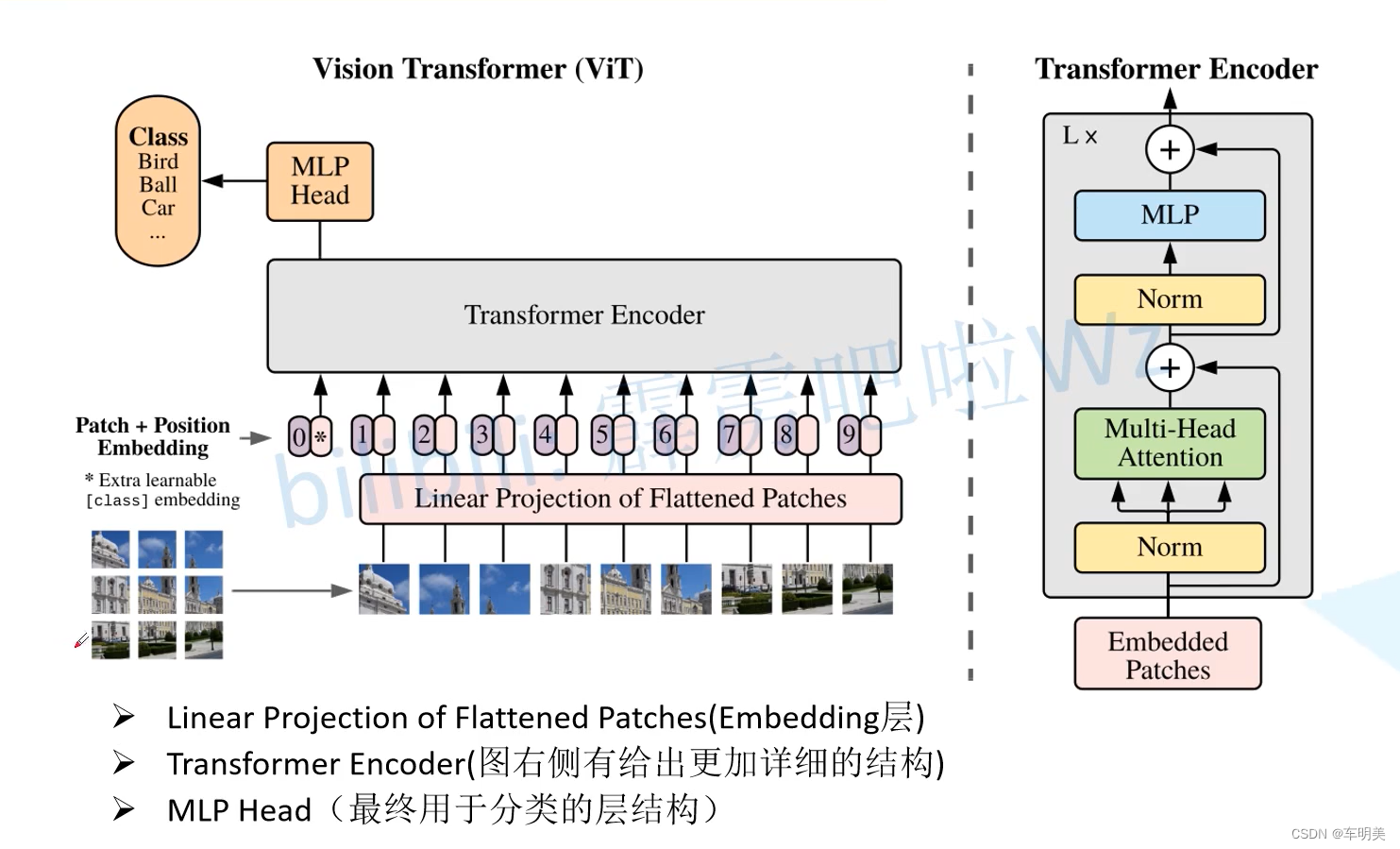

Vit模型(纯transformer模型):

- 把一整幅图切成一块一块的称为patches(如Vit-B/16的patch大小就是16*16)

- 把每个patch输入embedding层得到一个个向量(token)

- 在一系列token前面加入一个用于分类的class token以及一个位置信息position embeddi

- 输入transformer encoder

- 通过MLP head 得到最终分类结果

- Vit模型——embedding层

- 在代码实现中通过一个卷积层来实现patches的分割,如[224,224,3]的图像通过大小为16*16,维度为768的卷积核,经过步长为16的卷积后得到的图像尺寸为[14,14,768],将14*14二维展平变为[196,768]->这就是token=[num_token,token_dim]

- 在token前拼接一个class tocken,变为[197,768]

- 通过相加的形式叠加position embedding,变为[197,768](它可以明显提高准确率,位置编码的差异其实区别不明显,默认用1D)

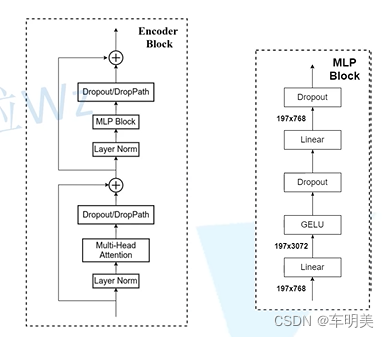

- Vit模型——transformer encoder层

- 在此之前有一个dropout层,后有一个layernorm层

- drop path可能效果更好

- MLP block第一个全连接层会把节点个数变为4倍,第二个全连接层会把节点个数还原为原来的大小

- MLP head层

- 训练image net21k时是由:全连接+tanh激活函数+全连接组成的

- 迁移到image net1K上或者自己的数据集上只有一个全连接层

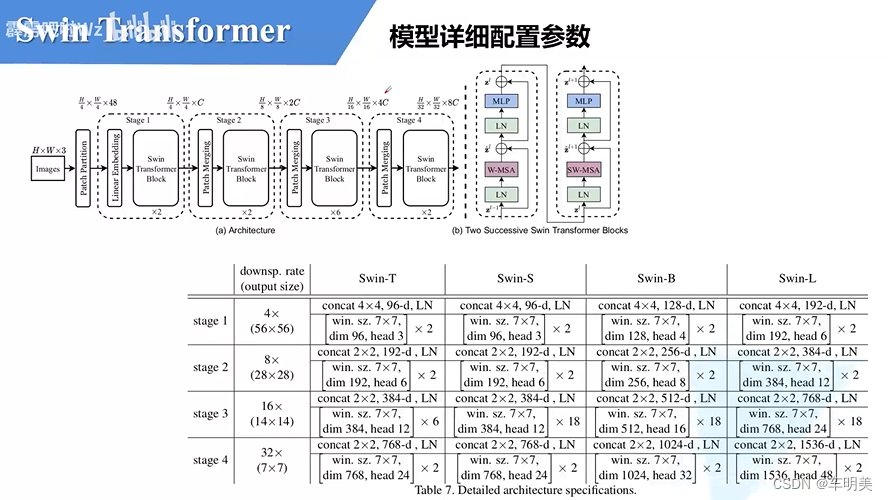

Swin Transformer

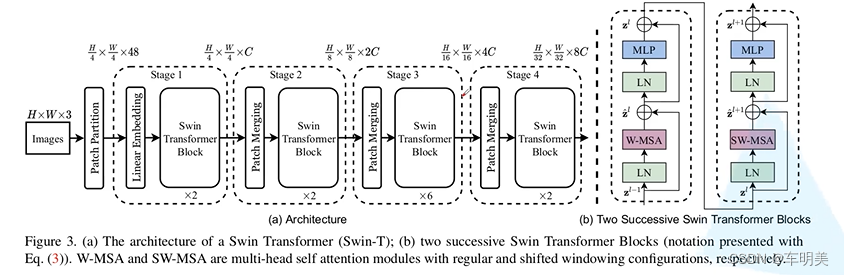

- 网络整体框架

- 首先将图片输入到Patch Partition模块中进行分块,即每4x4相邻的像素为一个Patch,然后在channel方向展平(flatten)。假设输入的是RGB三通道图片,那么每个patch就有4x4=16个像素,然后每个像素有R、G、B三个值所以展平后是16x3=48,所以通过Patch Partition后图像shape由 [H, W, 3]变成了 [H/4, W/4, 48]。然后在通过Linear Embeding层对每个像素的channel数据做线性变换,由48变成C,即图像shape再由 [H/4, W/4, 48]变成了 [H/4, W/4, C]。其实在源码中Patch Partition和Linear Embeding就是直接通过一个卷积层实现的,和之前Vision Transformer中讲的 Embedding层结构一模一样。

- 然后就是通过四个Stage构建不同大小的特征图,除了Stage1中先通过一个Linear Embeding层外,剩下三个stage都是先通过一个Patch Merging层进行下采样(后面会细讲)。然后都是重复堆叠Swin Transformer Block注意这里的Block其实有两种结构,如图(b)中所示,这两种结构的不同之处仅在于一个使用了W-MSA结构,一个使用了SW-MSA结构。而且这两个结构是成对使用的,先使用一个W-MSA结构再使用一个SW-MSA结构。所以你会发现堆叠Swin Transformer Block的次数都是偶数(因为成对使用)。

- 最后对于分类网络,后面还会接上一个Layer Norm层、全局池化层以及全连接层得到最终输出。图中没有画,但源码中是这样做的。

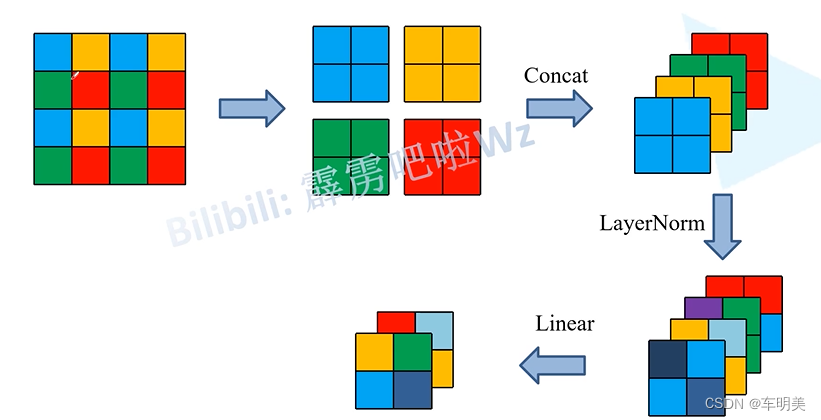

- Patch merging

- 假设输入Patch Merging的是一个4x4大小的单通道特征图(feature map),Patch Merging会将每个2x2的相邻像素划分为一个patch,然后将每个patch中相同位置(同一颜色)像素给拼在一起就得到了4个feature map。接着将这四个feature map在深度方向进行concat拼接,然后在通过一个LayerNorm层。最后通过一个全连接层在feature map的深度方向做线性变化,将feature map的深度由C变成C/2。通过这个简单的例子可以看出,通过Patch Merging层后,feature map的高和宽会减半,深度会翻倍。

- W-MSA

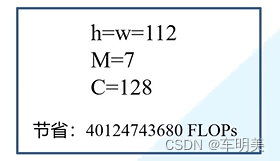

- 目的:减少计算量

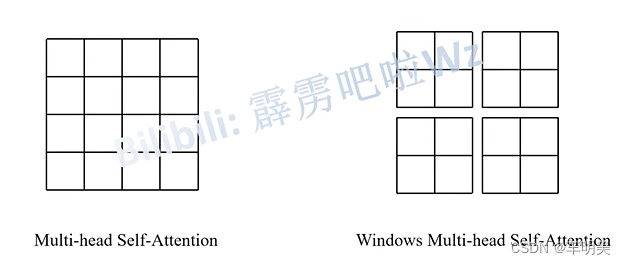

左侧使用的是普通的Multi-head Self-Attention(MSA)模块,对于feature map中的每个像素(或称作token,patch)在Self-Attention计算过程中需要和所有的像素去计算。但在图右侧,在使用Windows Multi-head Self-Attention(W-MSA)模块时,首先将feature map按照MxM(例子中的M=2)大小划分成一个个Windows,然后单独对每个Windows内部进行Self-Attention。

缺点:窗口之间无法进行信息交互

- SW-MSA

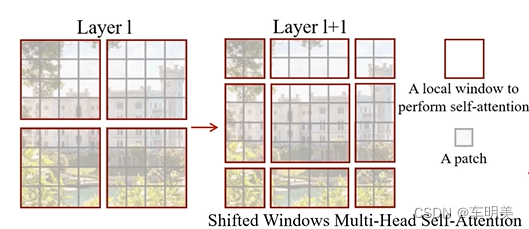

- 目的:实现不同window之间的信息交互

- 这样会出现计算量增加,为了解决这个问题,提出了如下方法:

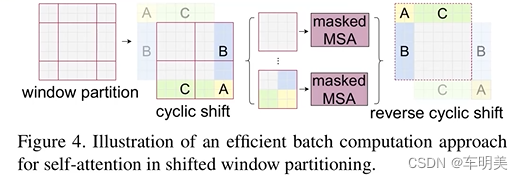

Efficient batch computation for shifted configuration

经过移动后,又变成了4个window,更加高效了,为了防止在移动拼接后信息乱窜,在实际计算中使用的是masked MSA即带蒙板mask的MSA,这样就能够通过设置蒙板来隔绝不同区域的信息了。计算过后再移回去

- Relative Position Bias

- 在Imagenet数据集上如果不使用任何位置偏执,top-1为80.1,但使用了相对位置偏执(rel. pos.)后top-1为83.3,提升还是很明显的。偏置B加在如下位置

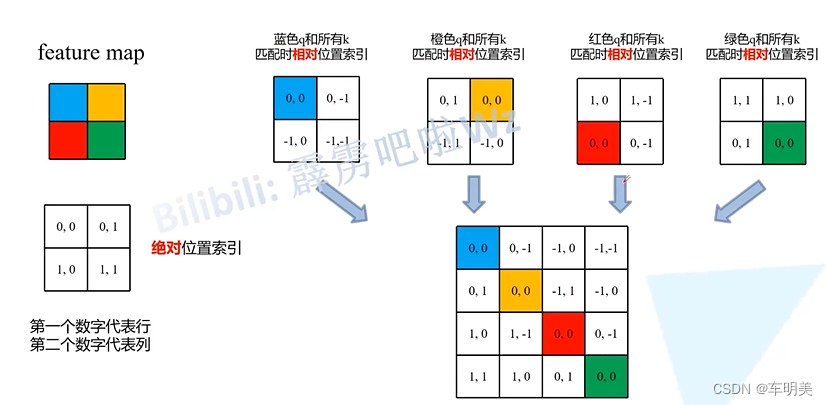

- 假设输入的feature map高宽都为2,那么首先我们可以构建出每个像素的绝对位置(左下方的矩阵),对于每个像素的绝对位置是使用行号和列号表示的。比如蓝色的像素对应的是第0行第0列所以绝对位置索引是( 0 , 0 ) (0,0)(0,0),接下来再看看相对位置索引。首先看下蓝色的像素,在蓝色像素使用q与所有像素k进行匹配过程中,是以蓝色像素为参考点。然后用蓝色像素的绝对位置索引与其他位置索引进行相减,就得到其他位置相对蓝色像素的相对位置索引。例如黄色像素的绝对位置索引是( 0 , 1 ) (0,1)(0,1),则它相对蓝色像素的相对位置索引为( 0 , 0 ) − ( 0 , 1 ) = ( 0 , − 1 ) (0, 0) - (0, 1)=(0, -1)(0,0)−(0,1)=(0,−1),这里是严格按照源码中来讲的,请不要杠。那么同理可以得到其他位置相对蓝色像素的相对位置索引矩阵。同样,也能得到相对黄色,红色以及绿色像素的相对位置索引矩阵。接下来将每个相对位置索引矩阵按行展平,并拼接在一起可以得到下面的4x4矩阵 。

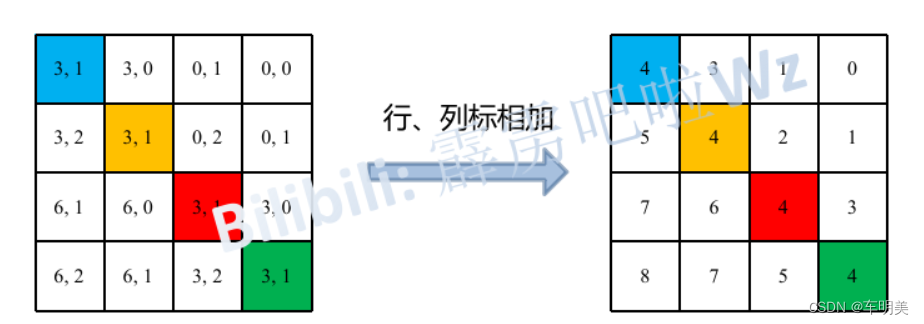

- 接着将所有的行标都乘上2M-1,最后将行标和列标进行相加。这样即保证了相对位置关系,而且不会出现上述0 + ( − 1 ) = ( − 1 ) + 0 0+(-1)=(-1)+00+(−1)=(−1)+0的问题了

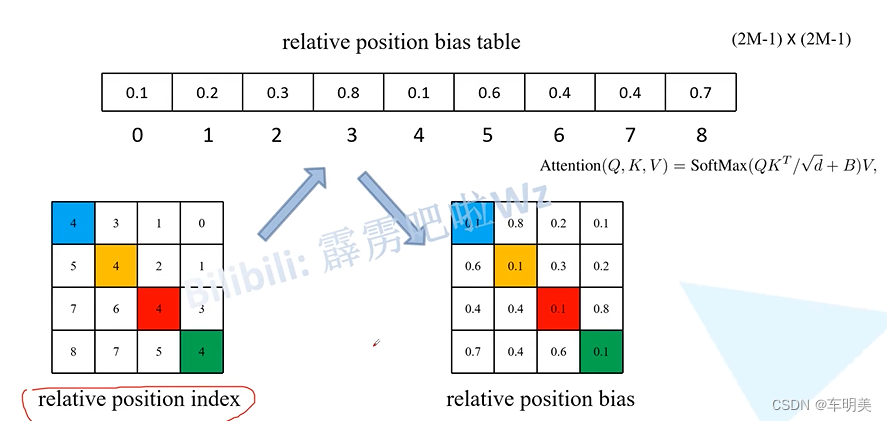

- 之前计算的是相对位置索引,并不是相对位置偏执参数。真正使用到的可训练参数B是保存在relative position bias table表里的,这个表的长度是等于( 2 M − 1 ) × ( 2 M − 1 ) (2M-1) \times (2M-1)(2M−1)×(2M−1)的。那么上述公式中的相对位置偏执参数B是根据上面的相对位置索引表根据查relative position bias table表得到的,如下图所示。

- 模型详细配置参数

Part 2:拓展学习

ConvNeXt网络讲解

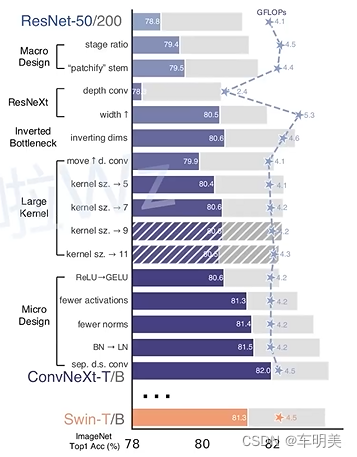

- Macro design

- Changing stage compute ratio,在原ResNet网络中,一般conv4_x(即stage3)堆叠的block的次数是最多的。如下图中的ResNet50中stage1到stage4堆叠block的次数是(3, 4, 6, 3)比例大概是1:1:2:1,但在Swin Transformer中,比如Swin-T的比例是1:1:3:1,Swin-L的比例是1:1:9:1。很明显,在Swin Transformer中,stage3堆叠block的占比更高。所以作者就将ResNet50中的堆叠次数由(3, 4, 6, 3)调整成(3, 3, 9, 3),和Swin-T拥有相似的FLOPs。进行调整后,准确率由78.8%提升到了79.4。

- Changing stem to “Patchify”,在之前的卷积神经网络中,一般最初的下采样模块stem一般都是通过一个卷积核大小为7x7步距为2的卷积层以及一个步距为2的最大池化下采样共同组成,高和宽都下采样4倍。但在Transformer模型中一般都是通过一个卷积核非常大且相邻窗口之间没有重叠的(即stride等于kernel_size)卷积层进行下采样。比如在Swin Transformer中采用的是一个卷积核大小为4x4步距为4的卷积层构成patchify,同样是下采样4倍。所以作者将ResNet中的stem也换成了和Swin Transformer一样的patchify。替换后准确率从79.4% 提升到79.5%,并且FLOPs也降低了一点

- ResNeXt-ify

接下来作者借鉴了ResNeXt中的组卷积grouped convolution,因为ResNeXt相比普通的ResNet而言在FLOPs以及accuracy之间做到了更好的平衡。而作者采用的是更激进的depthwise convolution,即group数和通道数channel相同,之前在讲MobileNet时由很详细讲解过,如果不了解的可以翻翻之前的文章。这样做的另一个原因是作者认为depthwise convolution和self-attention中的加权求和操作接着作者将最初的通道数由64调整成96和Swin Transformer保持一致,最终准确率达到了80.5%。

- Inverted Bottleneck

作者认为Transformer block中的MLP模块非常像MobileNetV2中的Inverted Bottleneck模块,即两头细中间粗。作者采用Inverted Bottleneck模块后,在较小的模型上准确率由80.5%提升到了80.6%,在较大的模型上准确率由81.9%提升到82.6%。

- Micro Design

- Replacing ReLU with GELU,在Transformer中激活函数基本用的都是GELU,而在卷积神经网络中最常用的是ReLU,于是作者又将激活函数替换成了GELU,替换后发现准确率没变化。

- Fewer activation functions,使用更少的激活函数。在卷积神经网络中,一般会在每个卷积层或全连接后都接上一个激活函数。但在Transformer中并不是每个模块后都跟有激活函数,比如MLP中只有第一个全连接层后跟了GELU激活函数。接着作者在ConvNeXt Block中也减少激活函数的使用,如下图所示,减少后发现准确率从80.6%增长到81.3%。

- Fewer normalization layers,使用更少的Normalization。同样在Transformer中,Normalization使用的也比较少,接着作者也减少了ConvNeXt Block中的Normalization层,只保留了depthwise conv后的Normalization层。此时准确率已经达到了81.4%,已经超过了Swin-T。

- Substituting BN with LN,将BN替换成LN。Batch Normalization(BN)在卷积神经网络中是非常常用的操作了,它可以加速网络的收敛并减少过拟合(但用的不好也是个大坑)。但在Transformer中基本都用的Layer Normalization(LN),因为最开始Transformer是应用在NLP领域的,BN又不适用于NLP相关任务。接着作者将BN全部替换成了LN,发现准确率还有小幅提升达到了81.5%。

- Separate downsampling layers,单独的下采样层。在ResNet网络中stage2-stage4的下采样都是通过将主分支上3x3的卷积层步距设置成2,捷径分支上1x1的卷积层步距设置成2进行下采样的。但在Swin Transformer中是通过一个单独的Patch Merging实现的。接着作者就为ConvNext网络单独使用了一个下采样层,就是通过一个Laryer Normalization加上一个卷积核大小为2步距为2的卷积层构成。更改后准确率就提升到了82.0%。

感想:

通过ConvNeXt网络我发现在学习的过程中要广泛的阅读相关论文,积极的进行尝试与探索,其它方向上表现优秀的方法框架很有可能在本方向上也会有优秀的表现。

本文深入探讨了VisionTransformer和SwinTransformer的网络结构,包括patch划分、embedding层、transformerencoder层以及MLPhead的设计。同时,介绍了SwinTransformer中的PatchMerging、W-MSA和SW-MSA机制。此外,文章还分析了ConvNeXt的改进策略,如改变stage计算比例、采用patchify、ResNeXt-ify、InvertedBottleneck等,展示了如何将Transformer的优化思想应用于卷积网络,最终提升模型性能。

本文深入探讨了VisionTransformer和SwinTransformer的网络结构,包括patch划分、embedding层、transformerencoder层以及MLPhead的设计。同时,介绍了SwinTransformer中的PatchMerging、W-MSA和SW-MSA机制。此外,文章还分析了ConvNeXt的改进策略,如改变stage计算比例、采用patchify、ResNeXt-ify、InvertedBottleneck等,展示了如何将Transformer的优化思想应用于卷积网络,最终提升模型性能。

990

990

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?