论文动机

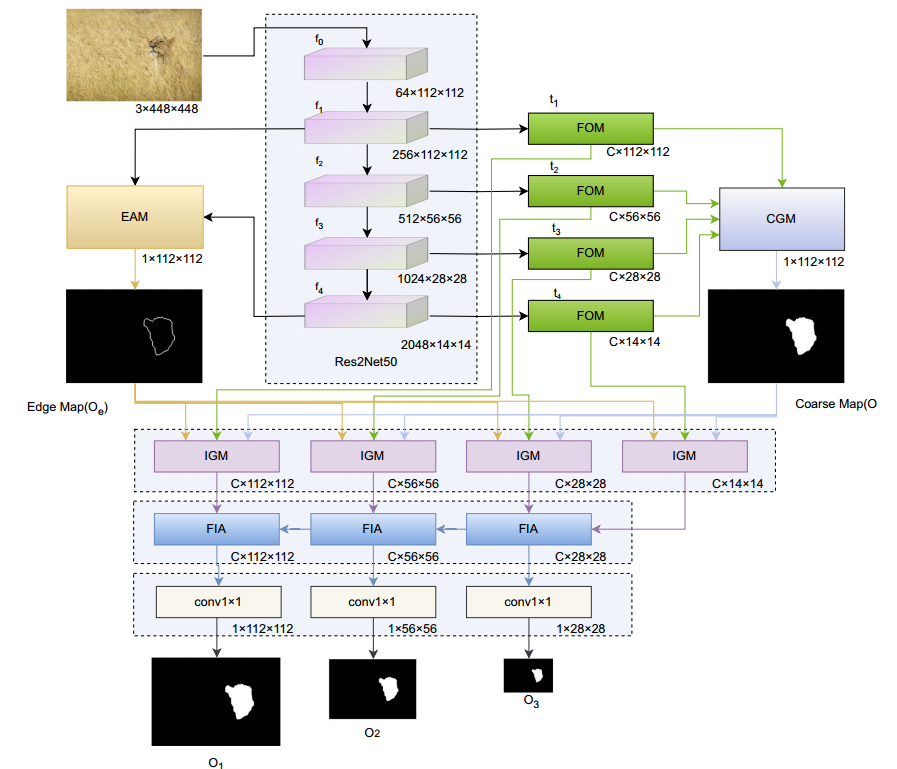

Camouflaged Object Detection (COD) 的任务是识别图像中与背景融为一体的对象。现有的许多 COD 方法并未全面考虑对象的整体区域和边缘提供的信息。这种不足导致了对象边界细节的分割较为粗糙或整体对象分割性能欠佳。为了弥补这一缺陷,本文提出了一种基于粗略图和边缘图的双引导联合网络 (TJNet),旨在同时利用对象的整体信息和边缘信息来引导网络,从而提升 COD 的性能。

创新点

- 双引导联合网络 (TJNet):该网络不仅能够精细地分割对象的边缘,还注重对象的整体信息(粗略图),通过同时利用边缘图和粗略图来引导分割过程,提升了 COD 的性能。

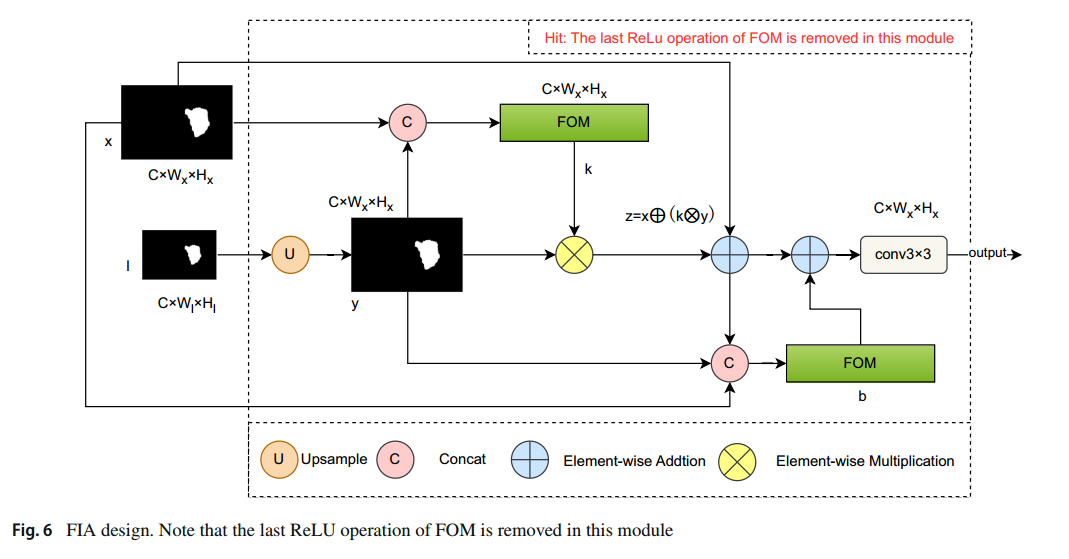

- 全图注意机制 (FIA):设计了一种全新的全图注意机制,通过将深层特征融合到浅层特征中,实现了粗略图和最终输出的预测。

- 边缘感知模块 (EAM):引入了一个简单有效的边缘感知模块,用于检测对象的边缘。

- 信息引导模块 (IGM):设计了信息引导模块,使得网络能够充分利用粗略图和边缘图提供的信息。

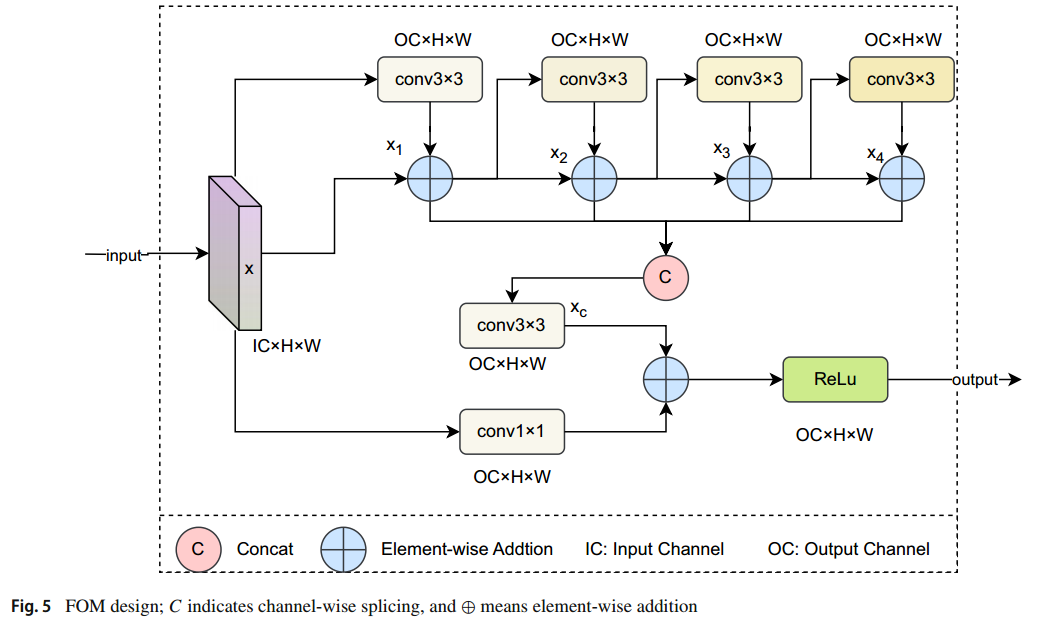

- 特征观察模块 (FOM):设计了一个特征观察模块,通过跳跃连接和多尺度感知来捕捉多尺度的图像细节和结构。

贡献

- 新颖网络结构:提出了一个新颖的双引导联合网络 TJNet,通过同时利用粗略图和边缘图来引导分割过程,有效平衡了对象的边缘和整体信息,提升了 COD 的性能。

- 特征观察模块 (FOM):设计了一个新的特征观察模块,增强了特征的感受野并调整了通道数量,作为观察者从输入特征中提取有价值的信息。

- 全图注意机制 (FIA):设计了一种全新的全图注意机制,灵感来自于人类处理高分辨率图像时参考低分辨率图像丰富注释信息的方法,独特地将深层特征融合到浅层特征中。

- 信息引导模块 (IGM):提出了一个新的信息引导模块,灵感来自传统图像增强技术,有效地从边缘图和粗略图中提取有意义的信息并注入到其他网络特征中。

通过这些创新和贡献,本文所提出的 TJNet 网络在三个著名数据集上的表现显著优于现有的最先进模型,在细节边缘分割和整体对象区域搜索方面取得了显著的改进。

就是双分支网络,EAM模块生成边缘预测图,FOM模块的作用是调整通道数和获取同一层内多尺度特征,将FOM输出的特征流向2个去向:1. CGM模块利用FOM输出的特征通过逐层融合深层和浅层特征,最终生成粗略图 (Oc),尺寸为 1×112×112。粗略图用于指导网络进行对象的初步定位,2.FOM输出的特征和边缘预测图和粗略预测图同时传入给IGM模块,IGM 用于将边缘图 (Oe) 和粗略图 (Oc) 中的信息注入到网络特征中。图中的 EAM 直接参考引用 IJCAI 2022 那篇论文提出的模块。

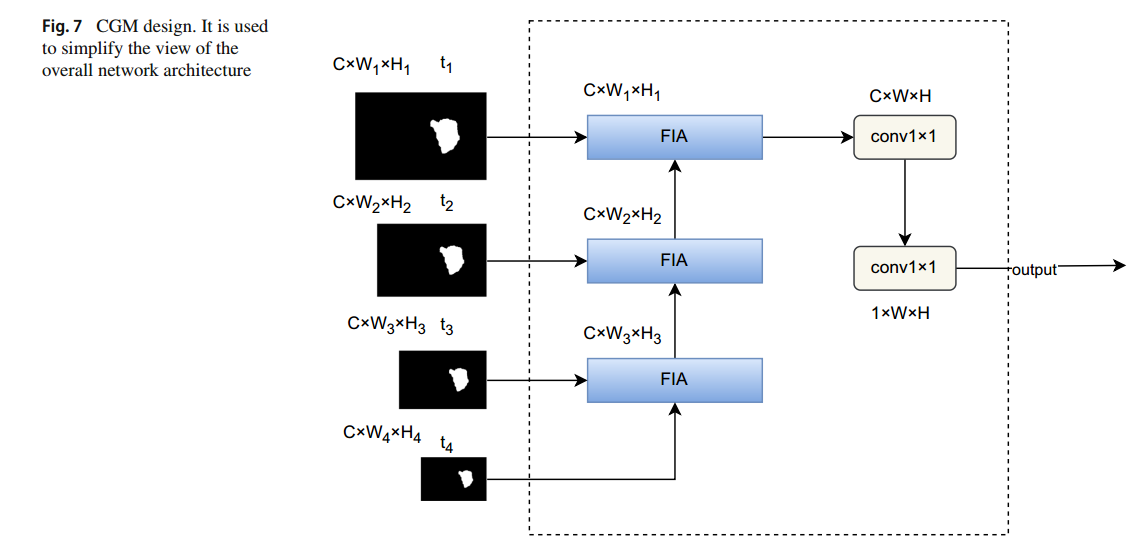

全图注意机制 (FIA)模块将深层的特征与浅层的特征进行融合,然后利用 1*1卷积分别生成不同层的最终分割结果

FOM 模块结构

四个卷积层的卷积核都是33,但是由于是串联结构,所以特征图 x 1 , x 2 , x 3 , x 4 x1,x2,x3,x4 x1,x2,x3,x4 的感受野分别是 3 , 9 , 27 , 81 3,9,27,81 3,9,27,81,这里使用了残差连接,输入特征和经过33卷积模块的输出进行Element-Wise Addition,然后将这4个特征图进行通道拼接,再使用一个3*3卷积核恢复通道数为OC,为什么Element-Wise Addition?因为图像级增强操作中,加法操作可以凸显出对应区域,Element-Wise Addition 使得不同感受野捕获的不同尺度的目标得以在原图中得到增强。最下面使用1个 1 ∗ 1 1*1 1∗1 调整原始输入 x 的通道,然后将原始输入的特征 x 和增强之后的特征 xc 进行元素级加法增强,再经过 ReLu 激活之后,得到最终输出的特征图

主要是利用堆叠的4个3*3卷积层来获得不同感受野捕获的不同尺度的特征图,并且将这些特征图利用残差连接结构(Element-wise Addition)和通道拼接融合并调整通道之后再次Element-wise Addition得到多尺度特征融合增强的特征图,同时也能调整输出的通道数量

FIA 全图注意力 模块结构

I 经过上采样之后,和 x 进行通道拼接之后,送入 FOM 模块进行通道数调整操作得到输出的特征 k,然后 k 和经过上采样的 y 进行 element-wise multiplication 操作,之所以是和经过上采样的 y 进行element-wise multiplication,是因为 y 的语义信息更强,和 y 进行element-wise multiplication 之后得到一个分割结果 (k ⊗ y), 这个分割结果再和细节更强的 x 进行 element-wise addition 之后得到 z,此时 z 和 x 和 y 经过通道拼接之后再利用 FOM 调整通道,得到输出 b,b 最后再和 z 进行 element-wise addition 经过一个 3 * 3 卷积得到输出的特征图

之所以叫 attention 模块,主要是因为和深层语义信息更强的特征图上采样之后的 y 进行 element-wise multiplication ,然后和细节更强的浅层 x 进行元素级加法,此时 z 就是经过注意筛选的特征图,

CGM 模块结构 粗略图生成模块

利用 FIA 全图注意力模块中,结合深层较强语义信息的特征图来对浅层高分辨率细节信息应用注意力之后再叠加,从深到浅得到增强的特征,然后利用 1 * 1卷积得到粗略的预测图

图像增强算法

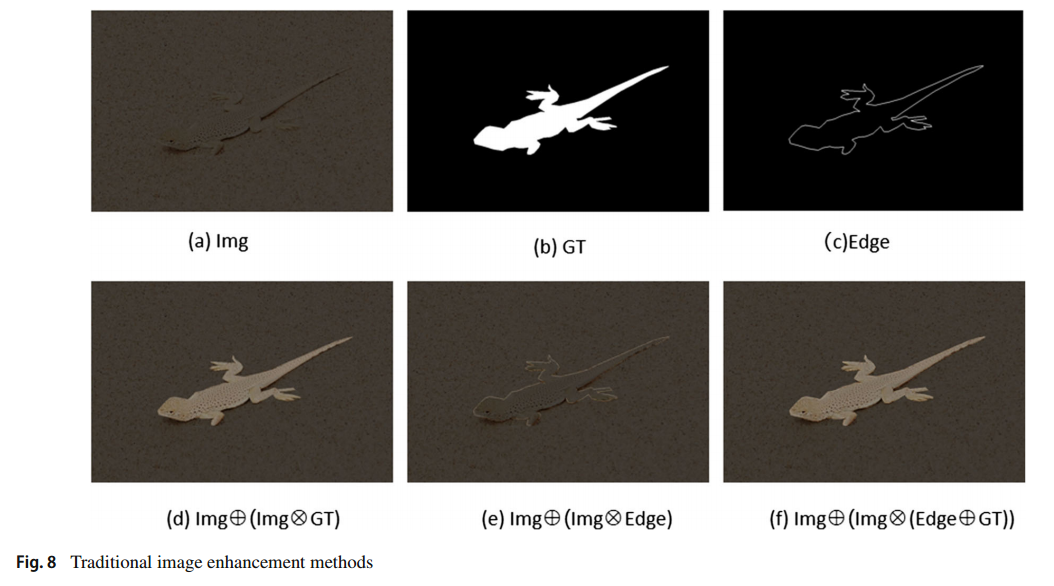

这张图展示了传统图像增强方法在处理伪装物体检测时的效果。具体来说,该图通过不同的操作展示了原始图像、目标区域和边缘信息在增强图像时的效果。以下是对每个子图的详细解释:

子图说明

-

(a) Img:

- 原始输入图像,显示了一只伪装在背景中的蜥蜴。

-

(b) GT (Ground Truth):

- 地面实况图像,即标注的真实伪装物体区域(蜥蜴)。

-

© Edge:

- 边缘图,显示了蜥蜴的边缘信息。

图像增强方法

-

(d) Img⊕(Img⊗GT):

- 公式解释:将原始图像 Img 与地面实况图像 GT 进行逐元素相乘(⊗),然后将结果与原始图像进行逐元素相加(⊕)。

- 结果:增强了伪装物体(蜥蜴)的整体区域,使得蜥蜴在图像中更加突出。

-

(e) Img⊕(Img⊗Edge):

- 公式解释:将原始图像 Img 与边缘图 Edge 进行逐元素相乘(⊗),然后将结果与原始图像进行逐元素相加(⊕)。

- 结果:增强了伪装物体的边缘,使得蜥蜴的轮廓更加明显。

-

(f) Img⊕(Img⊗(Edge⊕GT)):

- 公式解释:首先将边缘图 Edge 与地面实况图像 GT 进行逐元素相加(⊕),然后将结果与原始图像 Img 逐元素相乘(⊗),最后将结果与原始图像进行逐元素相加(⊕)。

- 结果:同时增强了伪装物体的整体区域和边缘,使得蜥蜴在图像中更加突出且轮廓更加清晰。

总结

这张图通过展示不同的图像增强方法,说明了如何利用地面实况图像和边缘信息来提升伪装物体的检测效果。具体来说:

- (d) 通过增强整体区域,使伪装物体在背景中更容易被识别。

- (e) 通过增强边缘信息,使伪装物体的轮廓更加明显。

- (f) 结合了整体区域和边缘信息的增强效果,使伪装物体更加突出且边缘清晰,是最有效的增强方法之一。

这些传统图像增强方法为本文提出的信息引导模块 (IGM) 提供了设计灵感,IGM 利用类似的思想,从边缘图和粗略图中提取有意义的信息,并注入到网络特征中,增强特征的表达能力,从而提升伪装物体检测的性能。

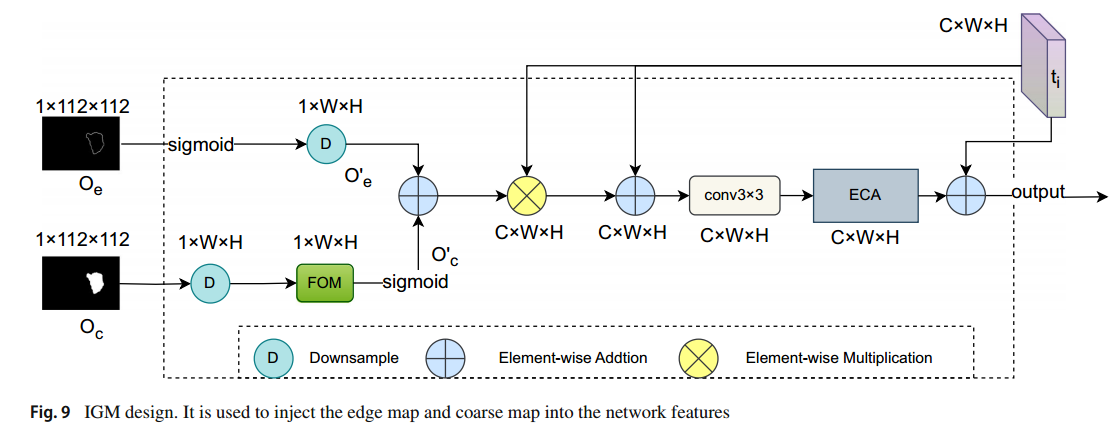

IGM 结构

目的是将边缘图和粗略图注射融合到网络特征中,来对特征进行增强,ECA 是通道注意力模块

信息引导模块 (IGM) 设计与传统图像增强方法的关系

这张图展示了信息引导模块 (IGM) 的具体设计,用于将边缘图 (Oe) 和粗略图 (Oc) 中的信息注入到网络特征中,从而增强特征表示能力。IGM 的设计灵感来自于图像增强方法,如图8所示。以下是对这张图的详细解释以及与传统图像增强方法的关系:

IGM 模块结构

-

输入特征:

- 边缘图 (Oe):尺寸为 1×112×112

- 粗略图 (Oc):尺寸为 1×112×112

- 网络特征 (ti):尺寸为 C×W×H

-

处理步骤:

-

边缘图处理:

- 对边缘图 (Oe) 进行下采样 (D) 操作,将尺寸调整为 1×W×H。

- 经过 Sigmoid 激活函数得到处理后的边缘图 (O′e)。

-

粗略图处理:

- 对粗略图 (Oc) 进行下采样 (D) 操作,将尺寸调整为 1×W×H。

- 通过特征观察模块 (FOM) 提取有用信息,再经过 Sigmoid 激活函数得到处理后的粗略图 (O′c)。

-

特征融合:

- 将处理后的边缘图 (O′e) 和粗略图 (O′c) 进行逐元素相加 (⊕)。

- 将上述结果与输入特征 (ti) 进行逐元素相乘 (⊗)。

- 将上述乘积结果与输入特征 (ti) 再次进行逐元素相加 (⊕)。

-

卷积和注意力机制:

- 经过 3×3 卷积操作将特征进行处理。

- 使用通道注意力机制 (ECA) 增强特征的通道间信息交互,最终得到输出特征。

-

图像增强方法与 IGM 的关系

传统图像增强方法通过结合原始图像、地面实况图像 (GT) 和边缘信息 (Edge) 来增强图像质量,使伪装物体更加明显。具体操作如图8所示,包括逐元素相加和逐元素相乘的操作。

IGM 的设计借鉴了这些传统方法的思想,通过以下步骤实现类似的效果:

-

信息提取:

- IGM 从边缘图 (Oe) 和粗略图 (Oc) 中提取关键信息,类似于传统方法中使用 GT 和 Edge 提取伪装物体的区域和边缘信息。

-

特征融合:

- IGM 将提取的信息注入到网络特征 (ti) 中,使用逐元素相加和逐元素相乘的操作,类似于图8中的增强方法 (d)、(e) 和 (f)。

-

增强特征表示:

- 通过卷积和通道注意力机制 (ECA),IGM 增强了特征的表达能力,使得伪装物体在特征图中更加突出且边缘清晰。

总结

IGM 模块通过借鉴传统图像增强方法的思想,设计了一种能够将边缘和整体信息有效注入到网络特征中的机制。通过这种设计,IGM 能够显著提升伪装物体检测的性能,使得检测结果更加准确和鲁棒。

895

895

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?