stanford cs231学习笔记(一)

1,先是讲到了机器学习中的kNN算法,然后因为kNN分类器的一些弊端,引入了线性分类器。

kNN算法的三大弊端:

(1),计算量大,当特征比较多时表示性差

(2),训练时耗时少,且计算需求低,反而是对测试数据分类时,计算需求量大。

(3),衡量两幅图像之间的差异时,衡量方式单一,例如L1,L2距离。且仅有的这两种方法效果都不理想。

2,引入线性分类器

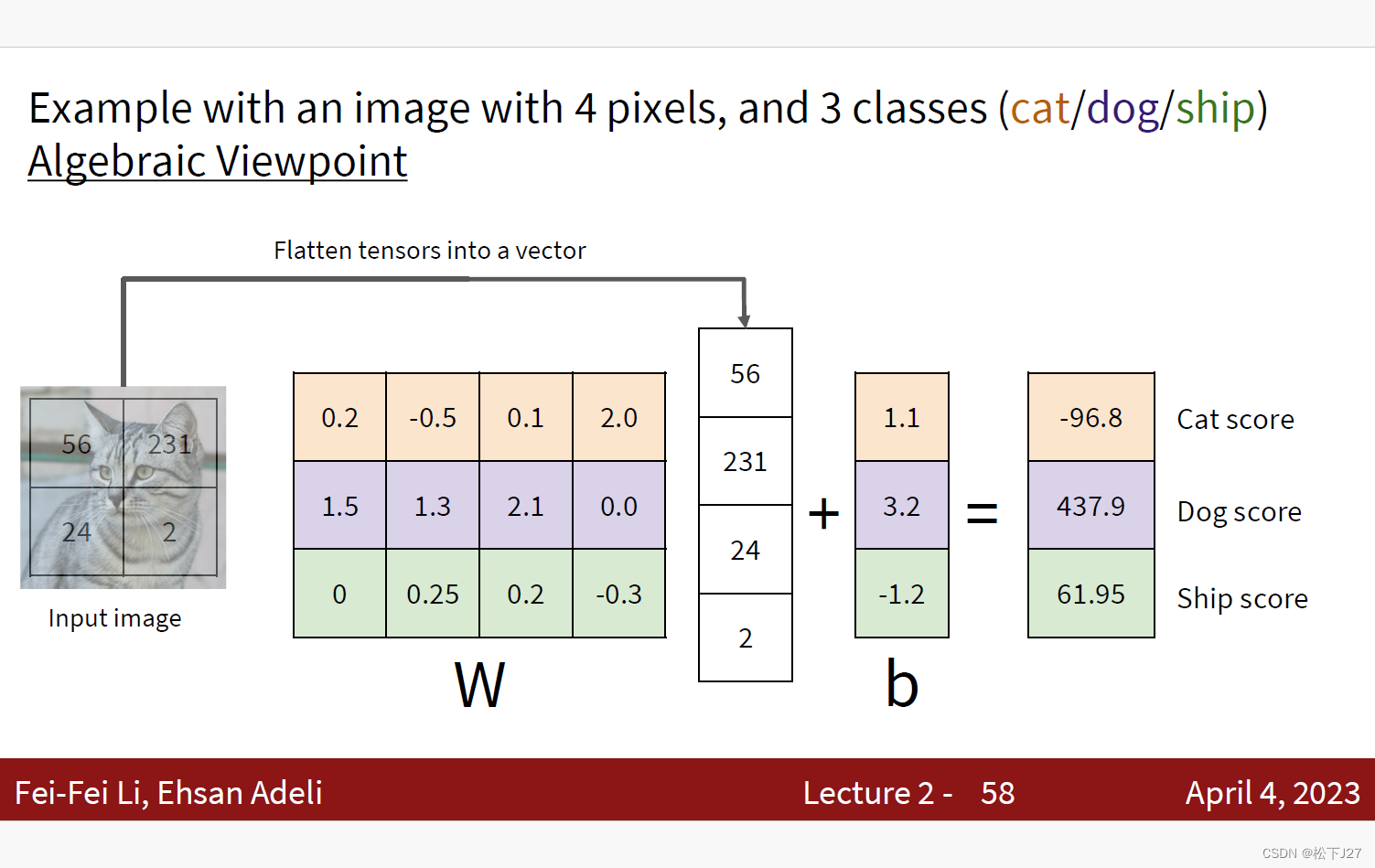

把图像的二维矩阵拉成一长条,变成一个向量x。令向量中的每个元素都乘以一个权重系数W,然后再把这些结果加到一起得到某个分类的得分。也就是说,如果有10个类别的话,权重矩阵W就应该有10行。如果x的长度是1000的话,权重矩阵W就应该有1000列。W是一个10x1000的矩阵,即10行1000列。

权重系数矩阵W中的每一行对应了一个种类,比如说第一行对应的是猫的权重系数,那么第一行乘以x后再求和,得到的值就是猫的得分。第二行是人,第二行乘以x后,就能得到对人的打分。依此类推,最终会得到10个类别各自的打分。

上图为一个简化模型,假设图像只有4个像素,他先是被拉伸成一个只有4个元素的向量x。然后乘以权重函数W,因为总共分了3类,所以权重函数共有3行,但权重函数的列数应与输入图像的像素个数相同。最后加上偏置项b,其中图中最右边的向量是“小猫”这张图在每个类别下的打分结果。可以看得出,这个打分结果是错误的,Dog的得分最高。而cat反而得了最低分。后续程序会根据这个打分结果调整W,是的Cat score的得分最高。

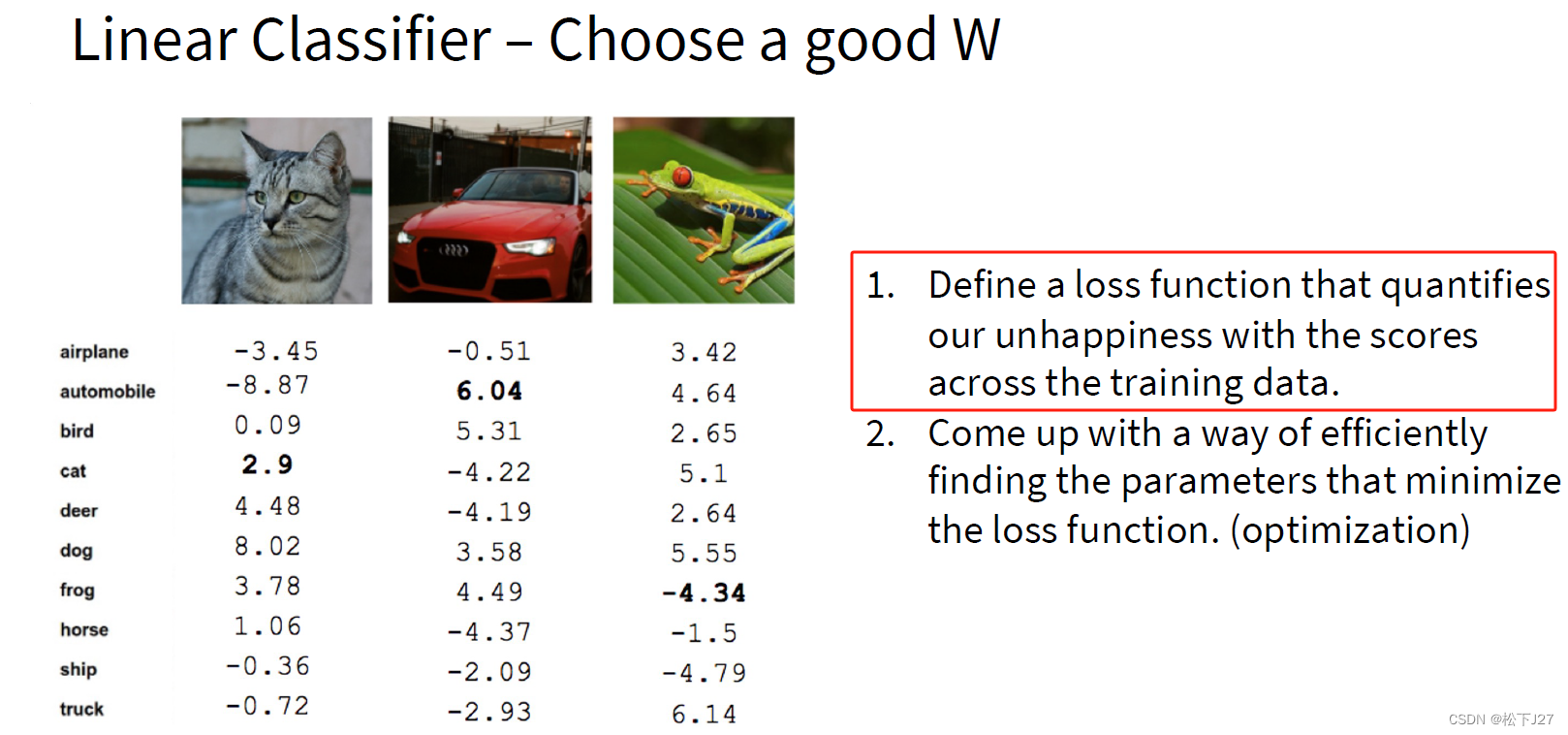

3,如何选择正确的W,才能让输入图像在对应类别上打分最高而在其他类型上打低分?答案就是损失函数Loss function,用于衡量正对当前所使用的W矩阵分类的打分结果,有多么的unhappy不满意。

损失函数有很多种,ppt中介绍了两种,一种是SVM loss(也叫hinge loss),一种是softmax(也叫cross-entropy loss)。损失函数的总体思路是在score向量中,用对应于输入图像类别的分数和其余类别的分数进行比较。如果比其他的都高,就说明打对了,如果不是则需要调整W。但如何科学的衡量有多正确就需要借助loss function。

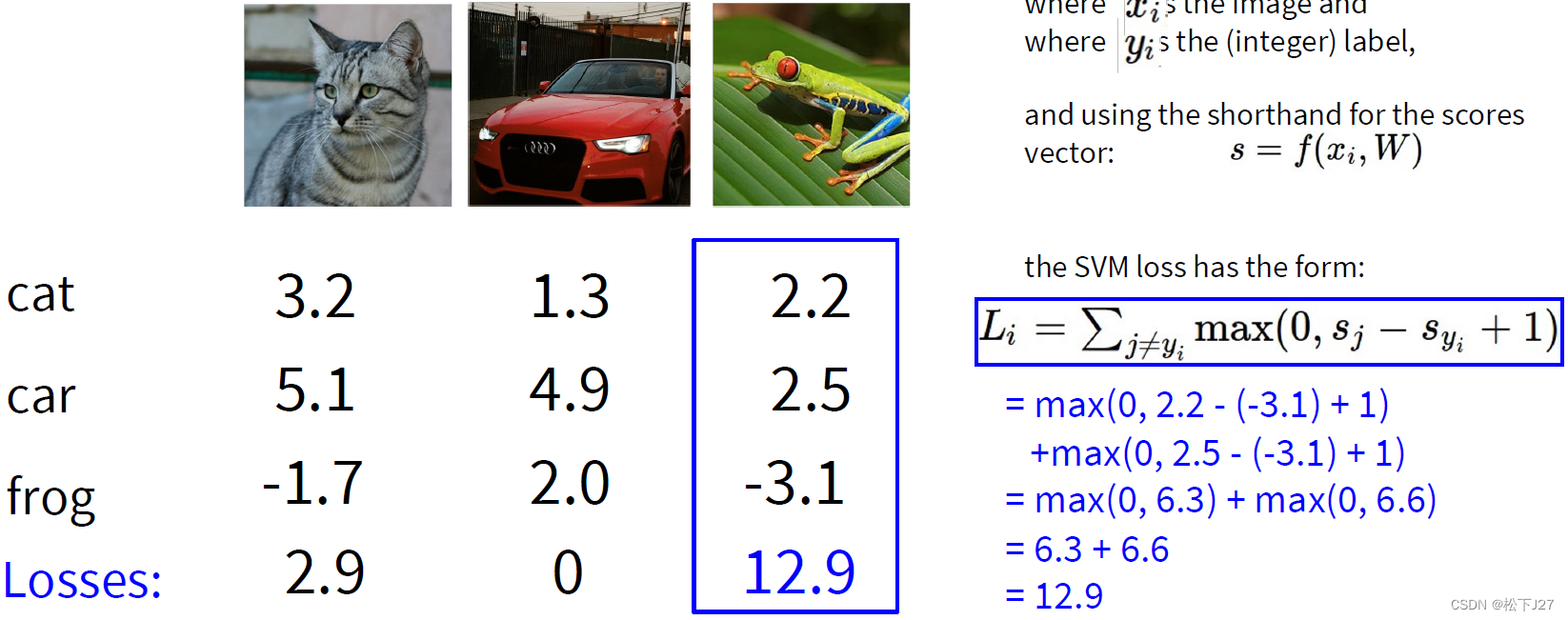

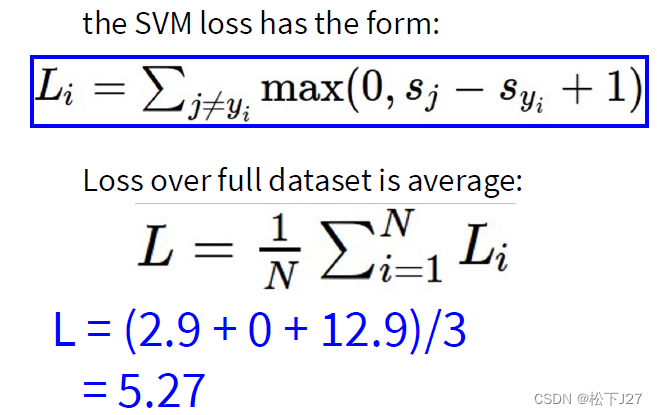

3,1,SVM loss(也叫hinge loss)分数越高表示越unhappy,即越不满意。

这里的是其他种类的得分,

是score vector中正确种类的得分。score vector是经过Wx计算后的分数向量,根据hinge loss方式计算后得到的结果分别是:

最终得到L函数的均值,对svm loss而言,分数越高,说明分类结果越不好。

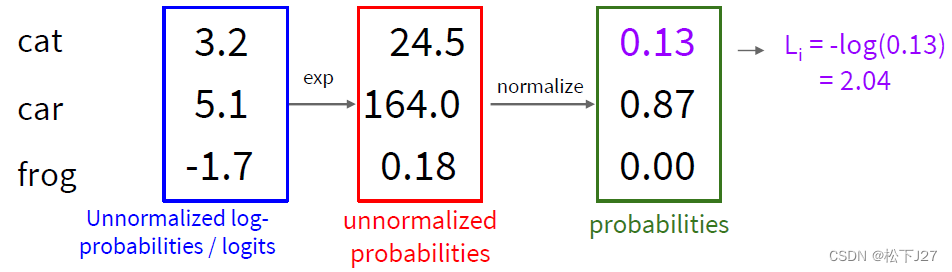

3,2,另一种损失函数叫softmax(也叫cross-entropy loss),他把分数转化成了概率函数,然后再对这个概率函数求了一个负自然对数。

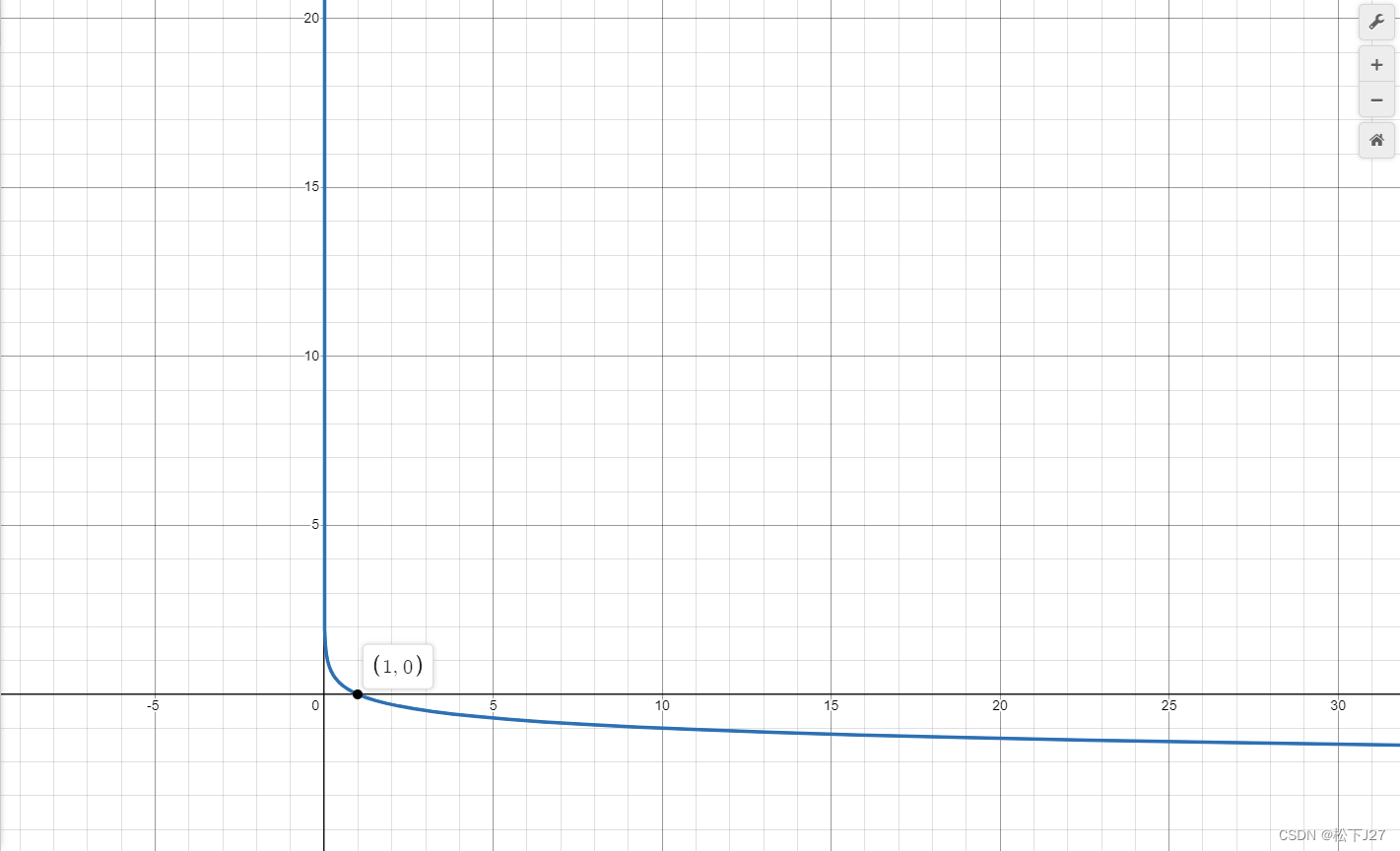

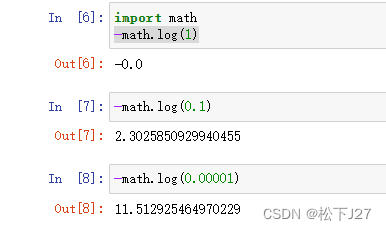

负自然对数函数的图像如下图所示,又因为概率函数的值域在0~1之间,因此,最终L函数的值域应该是在正无穷大到0之间。概率越低损失函数越大,概率越大,也就是越接近1,损失函数的值越接近0。

4,Loss function用于如何评估权重W的合理性,相当于是一个“体检指标”。指标高了,说明W有病了,如果指标越低,则说明W越健康。如何有效的利用Loss函数去优化W呢?这时optimization就出现了,也叫优化函数。

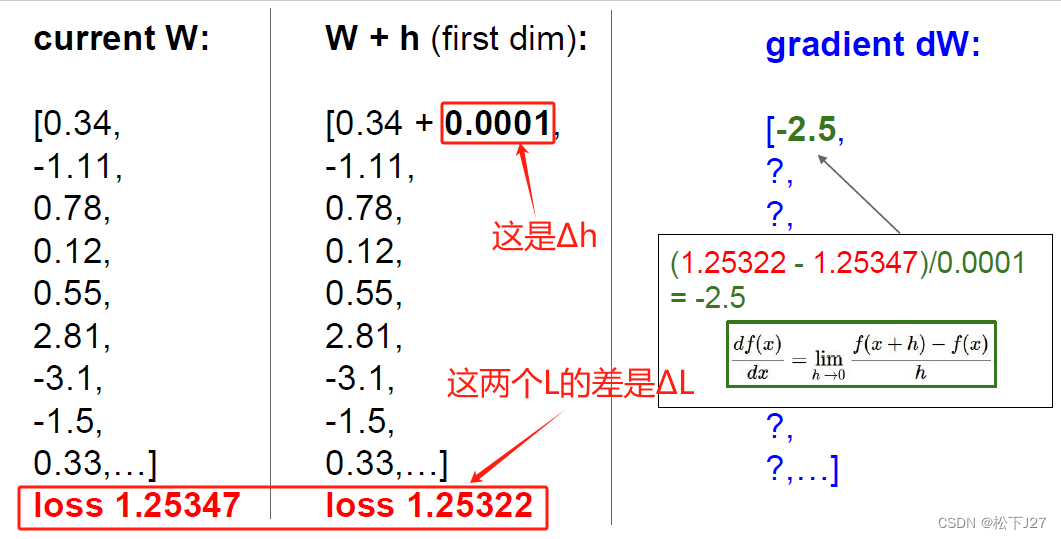

既然,我们的目标是让损失函数L最小化,我们就应该试着找到怎么改变W才能让L减小的最多。这里用到了求极限的概念,也就是通过让W增加一个很小的变化h,然后观察L值的变化。

5,改变W后L的变化有可能变大,也有可能变小。而我们的目的是希望找到让L减小最多的W。这时,就引出了optimization优化。

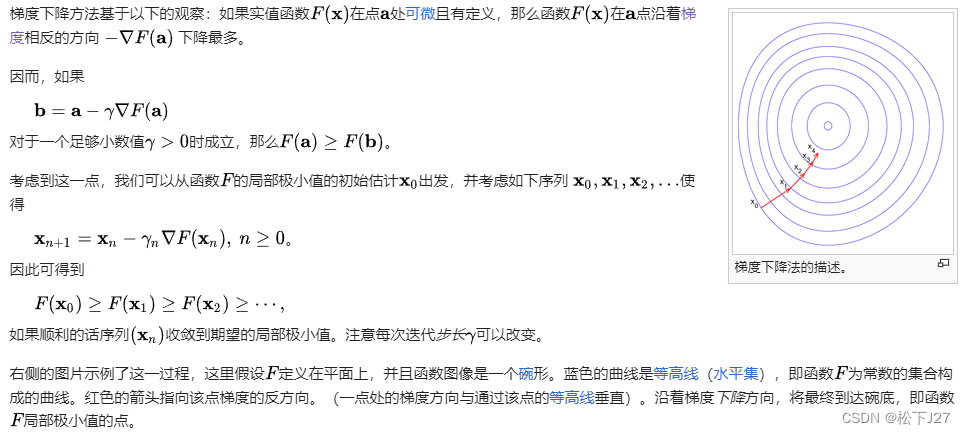

常见的优化方式是梯度下降法,梯度下降法的原理是源于函数f在点P处的梯度一定是函数f在P点处的所有方向导数中增加最大的方向导数。因此,我们要想让函数f减小的最多,我们只需让自变量x沿着这一方向变化即可。

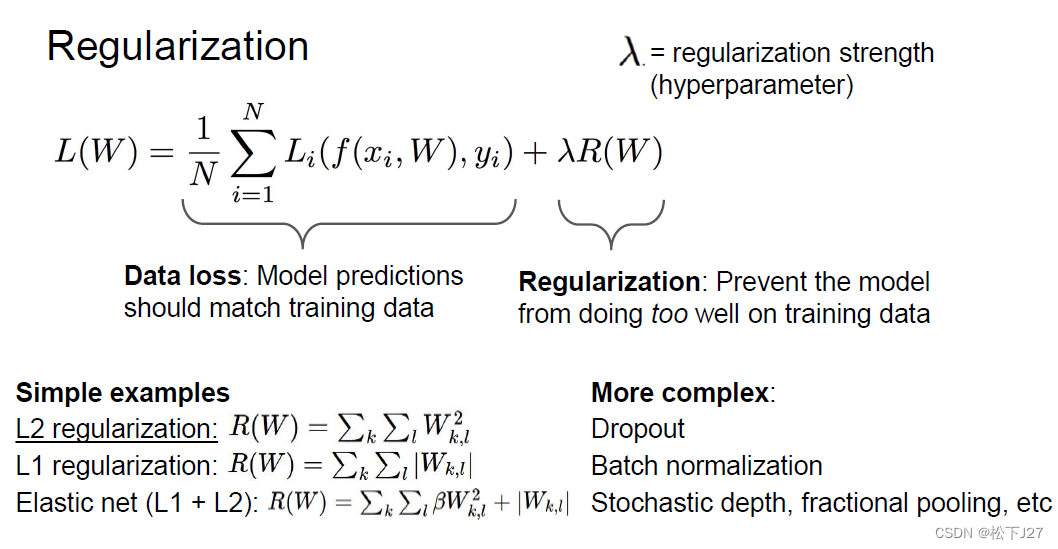

6,为了防止过拟合,在Loss函数中还可以加入Regularization正则化函数。

他能够使得拟合出来的函数尽可能的简单。

(全文完)

--- 作者,松下J27

参考文献(鸣谢):

1,Stanford University CS231n: Deep Learning for Computer Vision

2,https://zh.wikipedia.org/wiki/%E6%A2%AF%E5%BA%A6%E4%B8%8B%E9%99%8D%E6%B3%95

本文于2024/05/08对部分内容进行了修改。

(配图与本文无关)

版权声明:所有的笔记,可能来自很多不同的网站和说明,在此没法一一列出,如有侵权,请告知,立即删除。欢迎大家转载,但是,如果有人引用或者COPY我的文章,必须在你的文章中注明你所使用的图片或者文字来自于我的文章,否则,侵权必究。 ----松下J27

414

414

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?