在使用大型语言模型(llm)时,幻觉是一个常见的问题。LLM生成流畅连贯的文本,但往往生成不准确或不一致的信息。防止LLM产生幻觉的方法之一是使用提供事实信息的外部知识来源,如数据库或知识图谱。

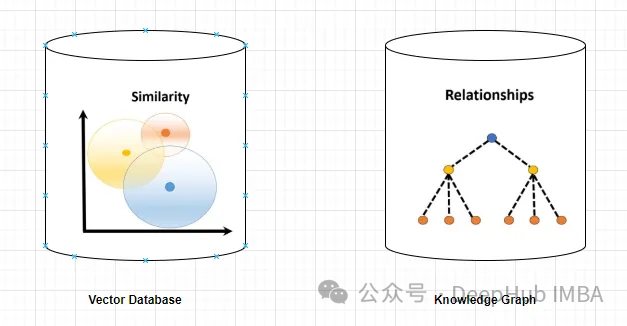

向量数据库和知识图谱

向量数据库

向量数据库是表示实体或概念(如单词、短语或文档)的高维向量的集合。数据库可用于测量不同实体或概念之间的相似性或相关性,基于它们的向量表示。

例如,一个向量数据库可以根据“巴黎”和“法国”的向量距离告诉你,“巴黎”和“法国”比“巴黎”和“德国”更相关。

查询向量数据库通常涉及搜索相似的向量或 检索基于特定标准的向量。下面是一个如何查询向量数据库的简单示例:

让我们假设有一个向量数据库,其中包含以高维向量表示的客户配置文件,并且您希望找到与给定参考客户相似的客户。

1、首先为参考客户定义一个向量表示。这可以通过提取相关特征或属性并将其转换为向量格式来实现。

2、使用合适的算法,如k近邻(k-NN)或余弦相似度,在向量数据库中执行相似度搜索。该算法将根据参考客户向量的相似度分数来识别最近邻。

3、检索与上一步中确定的最近邻向量相对应的客户配置文件。这些概要文件将根据定义的相似性度量表示与参考客户相似的客户。

4、向用户显示检索到的客户配置文件或相关信息,例如显示他们的姓名、人口统计数据或购买历史记录。

知识图谱

知识图谱是表示实体或概念及其关系(如事实、属性或类别)的节点和边的集合。基于它们的节点和边缘属性,可用于查询或推断关于不同实体或概念的事实信息。

例如,一个知识图可以根据边缘标签告诉你“巴黎”是“法国”的首都。

查询图数据库涉及遍历图结构并根据特定标准检索节点、关系或模式。

假设你有一个表示社交网络的图数据库,其中用户是节点,他们的关系表示为连接节点的边。如果为给定用户找到朋友的朋友(共同联系),那么我们应该进行如下操作:

1、在图数据库中标识表示参考用户的节点。这可以通过查询特定的用户标识符或其他相关标准来实现。

2、使用图查询语言,例如Cypher(在Neo4j中使用)或Gremlin,从参考用户节点遍历图。指定要探索的模式或关系。

MATCH (:User {userId: ‘referenceUser’})-[:FRIEND]->()-[:FRIEND]->(fof:User)

RETURN fof

这个查询从参考用户开始,沿着FRIEND关系找到另一个节点(FRIEND),然后沿着另一个FRIEND关系找到朋友的朋友(fof)。

3、对图数据库执行查询,根据查询模式检索结果节点(朋友的朋友),可以获得关于检索节点的特定属性或其他信息。

图数据库可以提供更高级的查询功能,包括过滤、聚合和复杂的模式匹配。具体的查询语言和语法可能会有所不同,但一般的过程涉及遍历图结构以检索符合所需标准的节点和关系。

知识图谱解决“幻觉”问题的优势

知识图谱比向量数据库提供更精确和具体的信息。向量数据库表示两个实体或概念之间的相似性或相关性,而知识图可以更好地理解它们之间的关系。例如知识图谱可以告诉你“埃菲尔铁塔”是“巴黎”的地标,而向量数据库只能表明这两个概念的相似程度,但是具体他们之间如何相关的却没有说明。

知识图支持比向量数据库更多样化、更复杂的查询。向量数据库主要可以回答基于向量距离、相似性或最近邻的查询,这些查询仅限于直接的相似性测量。而知识图可以处理基于逻辑运算符的查询,例如“具有属性Z的所有实体是什么?”或“W和V的共同范畴是什么?”这可以帮助LLM产生更多样化和有趣的文本。

知识图比向量数据库更能进行推理和推断。向量数据库只能提供存储在数据库中的直接信息。而知识图可以提供从实体或概念之间的关系派生的间接信息。例如,一个知识图谱可以根据“巴黎是法国的首都”和“法国位于欧洲”这两个事实推断出“埃菲尔铁塔位于欧洲”。这可以帮助LLM生成更具逻辑性和一致性的文本。

所以知识图谱是一个比向量数据库更好的解决方案。可以为LLM提供了更准确、相关、多样、有趣、合乎逻辑和一致的信息,使它们更可靠地生成准确和真实的文本。但这里的关键是文档文档之间需要有清晰的关系,否则知识图谱将无法捕捉到它。

但是,知识图谱的使用并没有向量数据库那么直接简单,不仅在内容的梳理(数据),应用部署,查询生成等方面都没有向量数据库那么方便,这也影响了它在实际应用中的使用频率。所以下面我们使用一个简单的例子来介绍如何使用知识图谱构建RAG。

代码实现

我们需要使用3个主要工具/组件:

1、LlamaIndex是一个编排框架,它简化了私有数据与公共数据的集成,它提供了数据摄取、索引和查询的工具,使其成为生成式人工智能需求的通用解决方案。

2、嵌入模型将文本转换为文本所提供的一条信息的数字表示形式。这种表示捕获了所嵌入内容的语义含义,使其对于许多行业应用程序都很健壮。这里使用“thenlper/gte-large”模型。

3、需要大型语言模型来根据所提供的问题和上下文生成响应。这里使用Zephyr 7B beta模型

下面我们开始进行代码编写,首先安装包

%%capture

pip install llama_index pyvis Ipython langchain pypdf

启用日志Logging Level设置为“INFO”,我们可以输出有助于监视应用程序操作流的消息

import logging

import sys

#

logging.basicConfig(stream=sys.stdout, level=logging.INFO)

logging.getLogger().addHandler(logging.StreamHandler(stream=sys.stdout))

导入依赖项

from llama_index import (SimpleDirectoryReader,

LLMPredictor,

ServiceContext,

KnowledgeGraphIndex)

#

from llama_index.graph_stores import SimpleGraphStore

from llama_index.storage.storage_context import StorageContext

from llama_index.llms import HuggingFaceInferenceAPI

from langchain.embeddings import HuggingFaceInferenceAPIEmbeddings

from llama_index.embeddings import LangchainEmbedding

from pyvis.network import Network

我们使用Huggingface推理api端点载入LLM

HF_TOKEN = "api key DEEPHUB 123456"

llm = HuggingFaceInferenceAPI(

model_name="HuggingFaceH4/zephyr-7b-beta", token=HF_TOKEN

)

首先载入嵌入模型:

embed_model = LangchainEmbedding(

HuggingFaceInferenceAPIEmbeddings(api_key=HF_TOKEN,model_name="thenlper/gte-large")

)

加载数据集

documents = SimpleDirectoryReader("/content/Documents").load_data()

print(len(documents))

####Output###

44

构建知识图谱索引

创建知识图谱通常涉及专业和复杂的任务。通过利用Llama Index (LLM)、KnowledgeGraphIndex和GraphStore,可以方便地任何数据源创建一个相对有效的知识图谱。

#setup the service context

service_context = ServiceContext.from_defaults(

chunk_size=256,

llm=llm,

embed_model=embed_model

)

#setup the storage context

graph_store = SimpleGraphStore()

storage_context = StorageContext.from_defaults(graph_store=graph_store)

#Construct the Knowlege Graph Undex

index = KnowledgeGraphIndex.from_documents( documents=documents,

max_triplets_per_chunk=3,

service_context=service_context,

storage_context=storage_context,

include_embeddings=True)

Max_triplets_per_chunk:它控制每个数据块处理的关系三元组的数量

Include_embeddings:切换在索引中包含嵌入以进行高级分析。

通过构建查询引擎对知识图谱进行查询

query = "What is ESOP?"

query_engine = index.as_query_engine(include_text=True,

response_mode ="tree_summarize",

embedding_mode="hybrid",

similarity_top_k=5,)

#

message_template =f"""<|system|>Please check if the following pieces of context has any mention of the keywords provided in the Question.If not then don't know the answer, just say that you don't know.Stop there.Please donot try to make up an answer.</s>

<|user|>

Question: {query}

Helpful Answer:

</s>"""

#

response = query_engine.query(message_template)

#

print(response.response.split("<|assistant|>")[-1].strip())

#####OUTPUT #####################

ESOP stands for Employee Stock Ownership Plan. It is a retirement plan that allows employees to receive company stock or stock options as part of their compensation. In simpler terms, it is a plan that allows employees to own a portion of the company they work for. This can be a motivating factor for employees as they have a direct stake in the company's success. ESOPs can also be a tax-efficient way for companies to provide retirement benefits to their employees.

可以看到,输出的结果已经很好了,可以说与向量数据库的结果非常一致。

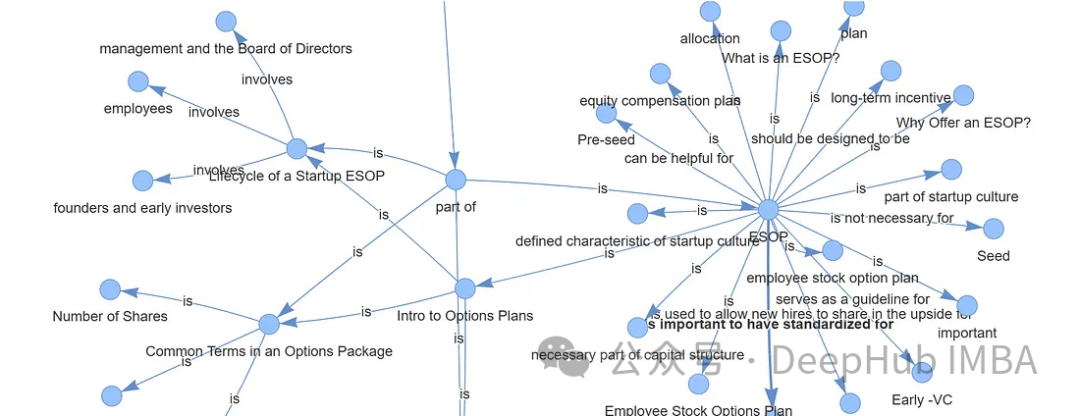

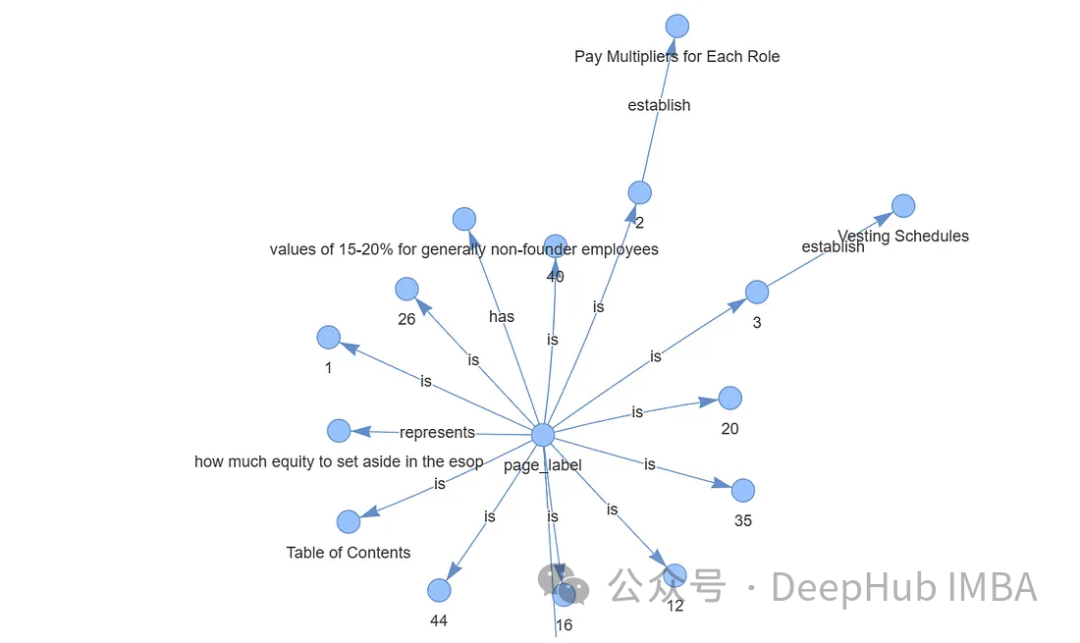

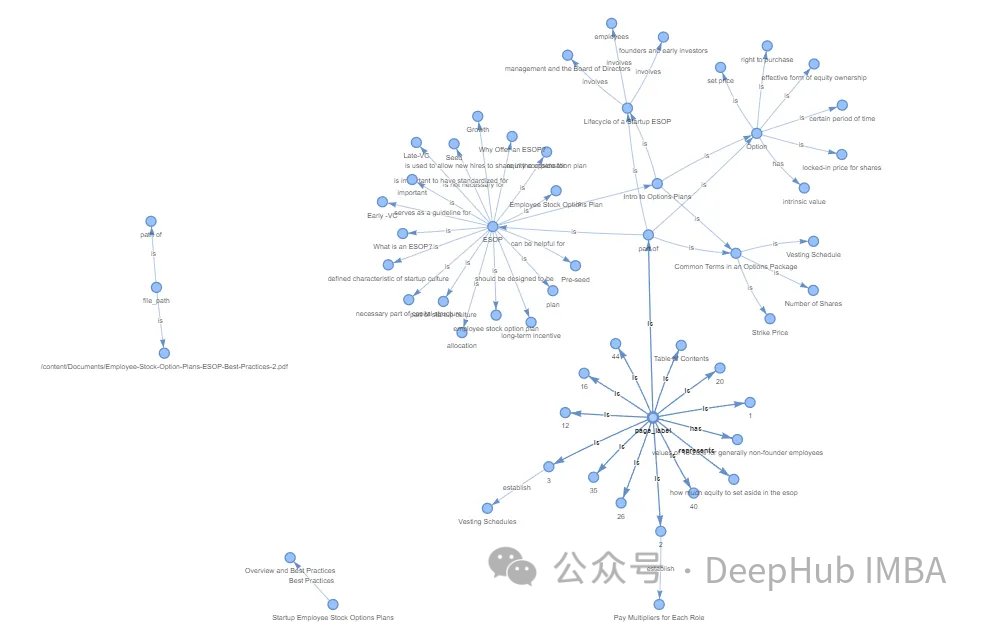

最后还可以可视化我们生成的图谱,使用Pyvis库进行可视化展示

from pyvis.network import Network

from IPython.display import display

g = index.get_networkx_graph()

net = Network(notebook=True,cdn_resources="in_line",directed=True)

net.from_nx(g)

net.show("graph.html")

net.save_graph("Knowledge_graph.html")

#

import IPython

IPython.display.HTML(filename="/content/Knowledge_graph.html")

通过上面的代码我们可以直接通过LLM生成知识图谱,这样简化了我们非常多的人工操作。如果需要更精准更完整的知识图谱,还需要人工手动检查,这里就不细说了。

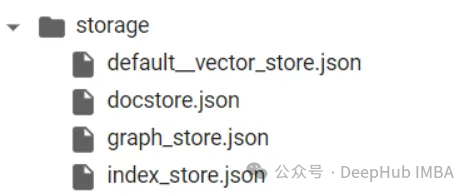

数据存储,通过持久化数据,可以将结果保存到硬盘中,供以后使用。

storage_context.persist()

存储的结果如下:

总结

向量数据库和知识图谱的区别在于它们存储和表示数据的方法。向量数据库擅长基于相似性的操作,依靠数值向量来测量实体之间的距离。知识图谱通过节点和边缘捕获复杂的关系和依赖关系,促进语义分析和高级推理。

对于语言模型(LLM)幻觉,知识图被证明优于向量数据库。知识图谱提供了更准确、多样、有趣、有逻辑性和一致性的信息,减少了LLM产生幻觉的可能性。这种优势源于它们能够提供实体之间关系的精确细节,而不仅仅是表明相似性,从而支持更复杂的查询和逻辑推理。

在以前知识图谱的应用难点在于图谱的构建,但是现在LLM的出现简化了这个过程,使得我们可以轻松的构建出可用的知识图谱,这使得他在应用方面又向前迈出了一大步。对于RAG,知识图谱是一个非常好的应用方向。

https://avoid.overfit.cn/post/d78d4b86f90f4065b3c08a73fc628a41

作者:Plaban Nayak

1092

1092

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?