盘点2024 Arxiv高引用论文Top10,Deepseek Qwen LlaMA3入选 | AI大咖说

2024年,人工智能(AI)领域再次见证了前所未有的快速发展。世界各地的研究人员不断突破技术边界,发表了大量开创性的论文。其中,Arxiv作为AI研究的重要平台,收录了大量具有影响力的论文。本文将介绍2024年在Arxiv上引用次数最高的10篇AI论文,并探讨它们的重要意义。

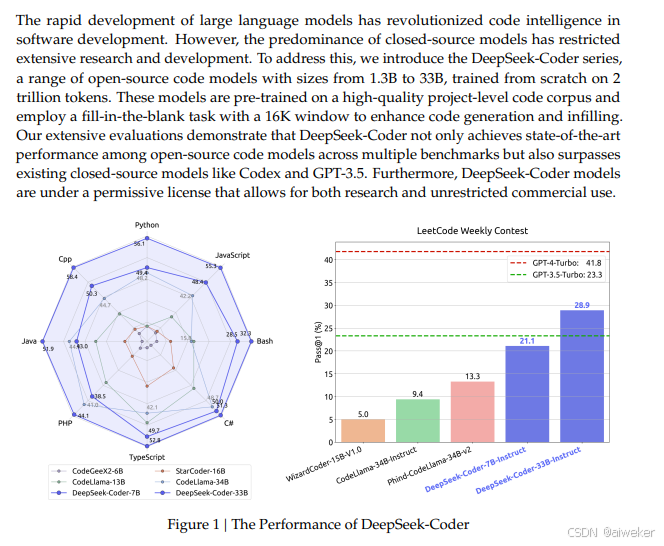

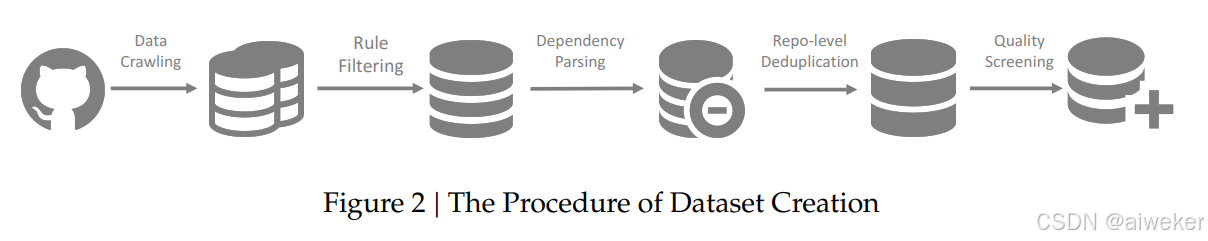

10. Deep Seek Coder: Transparent and State-of-the-Art Code-Specific Pre-Training

该论文由DeepSeek-AI团队发表,被引用301次。论文重点介绍了Deep Seek Coder模型的强大功能,该模型通过对包含两万亿个token的海量数据集进行广泛的代码预训练,在代码相关任务中取得了最佳结果,甚至超越了Codex和GPT-3.5等闭源模型。此外,论文还强调了训练过程的透明度,为研究界提供了宝贵的见解。Deep Seek Coder的推出,标志着代码智能领域取得了重大突破。

- https://arxiv.org/abs/2401.14196v2

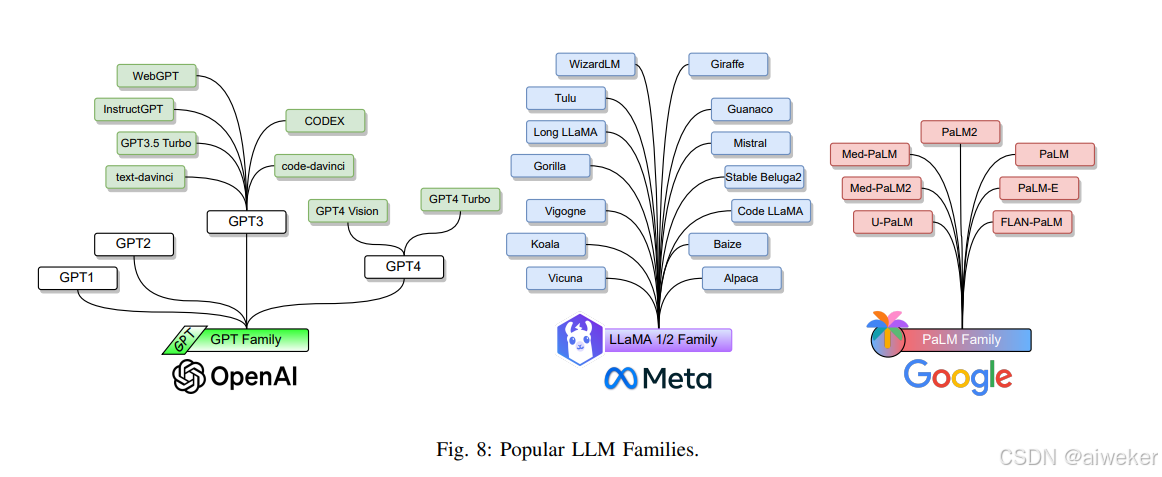

9. A Survey of Large Language Models

这篇论文全面概述了截至2024年2月的大型语言模型(LLM)研究状况,被引用392次。论文涵盖了LLM的基本概念、架构、培训技术和应用,为研究人员和从业人员提供了宝贵的资源。通过综合最新的研究,该论文对LLM的现状和未来发展方向提供了全面的了解,有助于推动LLM技术的进一步发展。

- https://arxiv.org/pdf/2402.06196v2

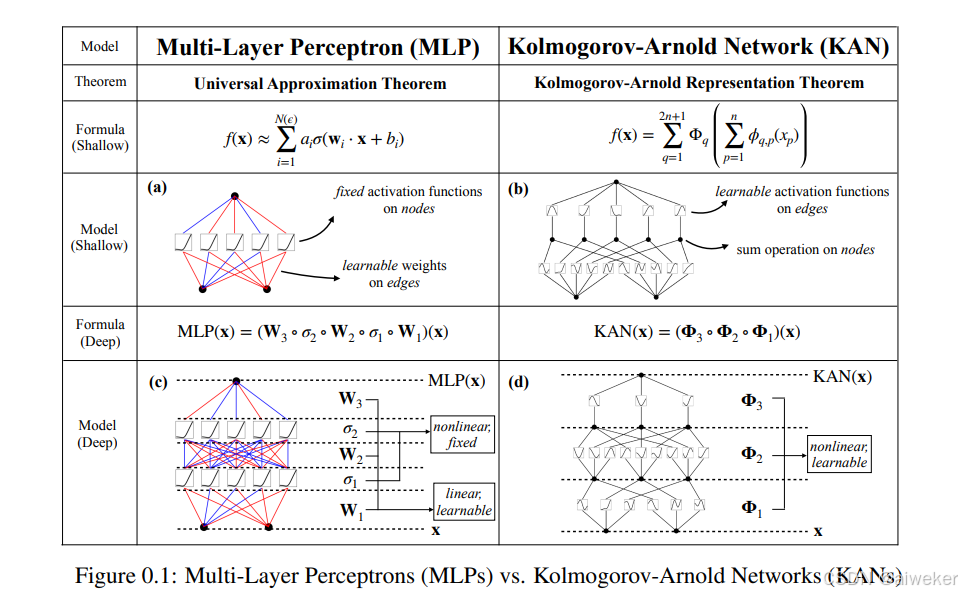

8. KAN: Kolmogorov-Arnold Networks

由麻省理工学院发表的这篇论文,介绍了一种有争议但前景光明的新技术——KAN(Kolmogorov-Arnold Networks)。尽管在发表时,KAN架构的基线尚未经过适当的训练,但其潜力已受到广泛关注。KAN论文已成为2024年最受欢迎的新型架构之一,展示了这种新机器学习方法的巨大潜力。

- https://arxiv.org/pdf/2404.19756v4

7. The Qwen 2 Model Series: Scaling Up Mixture of Experts

阿里巴巴发表的这篇论文详细介绍了Qwen 2模型系列,包括一系列开源大型语言模型和多模态模型,参数范围从0.5亿到720亿。论文重点阐述了混合专家架构的使用,该方法涉及通过不同的神经网络路由输入,以更好地存储和处理信息。Qwen 2模型系列的推出,有助于推动大型语言模型和多模态模型的应用和发展。

- https://arxiv.org/pdf/2407.10671v4

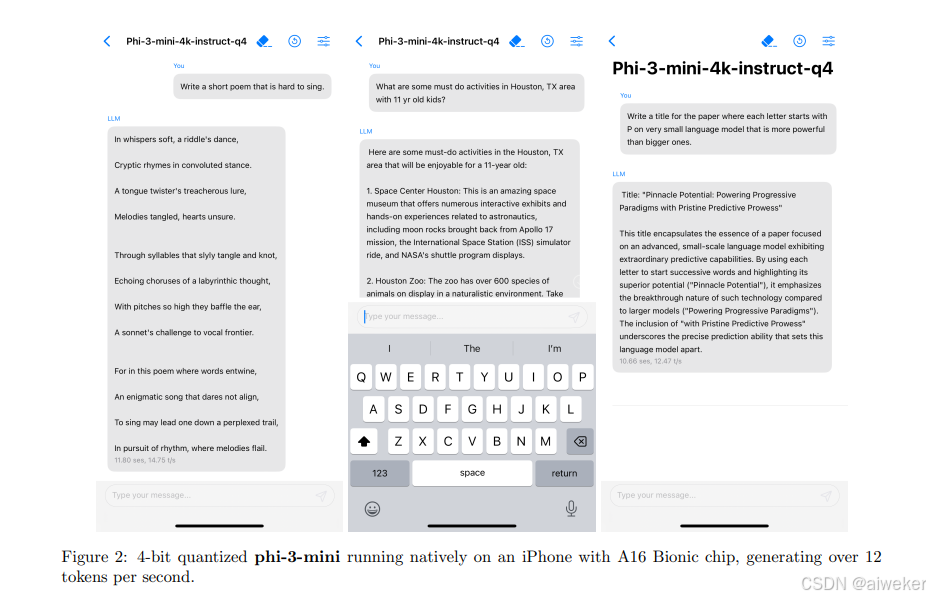

6. The Phi-3 Model Series: Tiny Yet Capable

微软的Phi-3模型系列技术报告论文以558次引用排名第六。该论文展示了微软在开发高性能但紧凑的语言模型方面的持续努力。Phi-3模型系列以高质量的预训练数据为基础,具有超小型但功能强大的特点,对于在资源受限的设备或边缘计算场景中部署尤其有用。

- https://arxiv.org/pdf/2404.14219v4

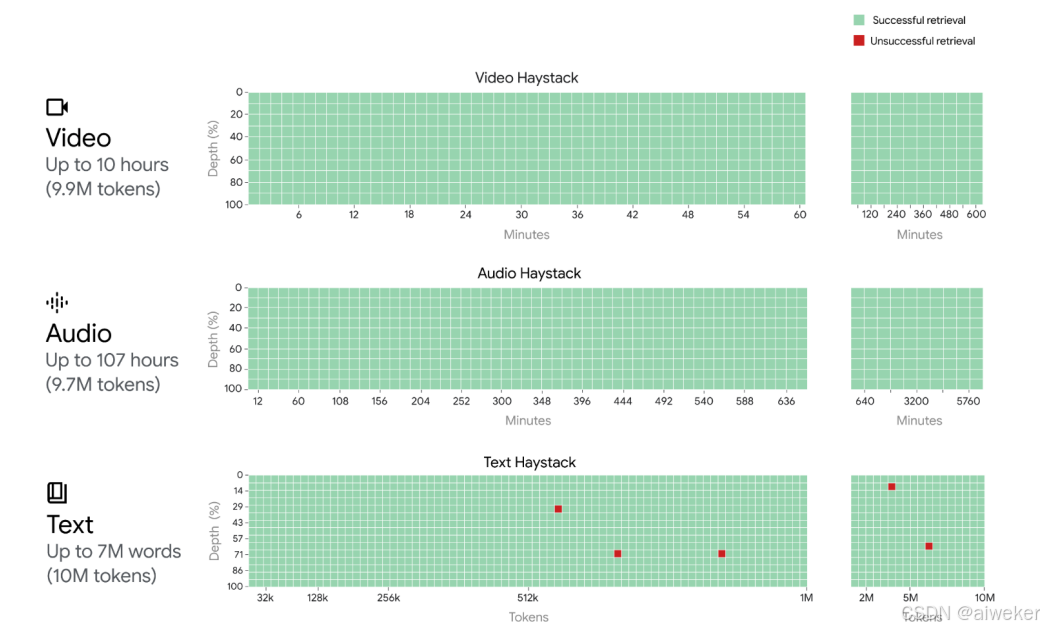

5. Gemini 1.5: Unlocking multimodal understanding across millions of tokens of context

谷歌发表的“Gemini 1.5”论文以731次引用排名第五。该论文的一大亮点是Gemini 1.5模型能够处理前所未有的1000万个token的上下文长度,以及令人印象深刻的生成速度。这一突破震惊了整个行业,展示了谷歌在大型语言模型领域的持续领导地位。

- https://arxiv.org/abs/2403.05530v4

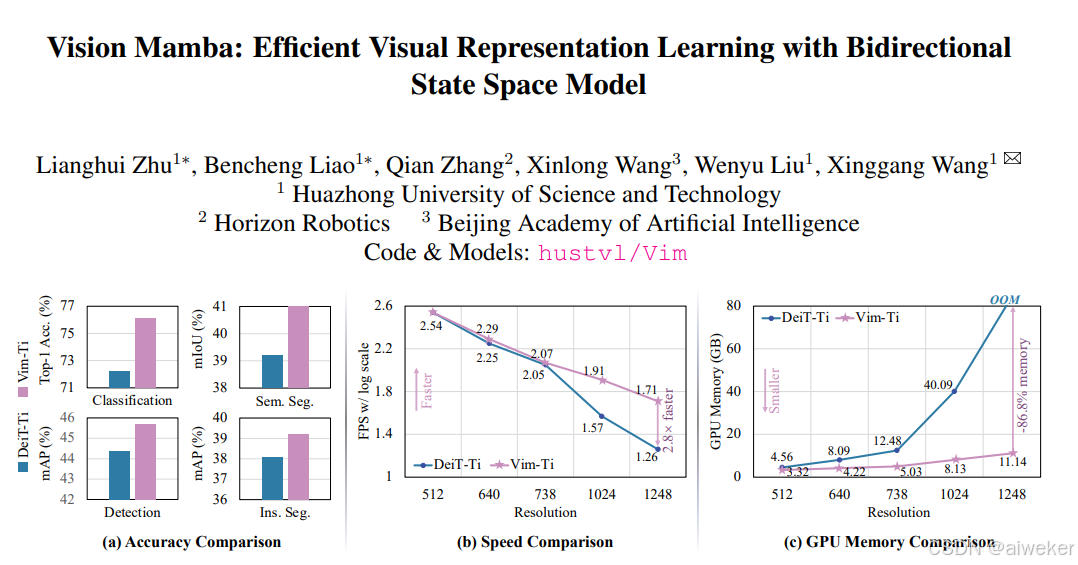

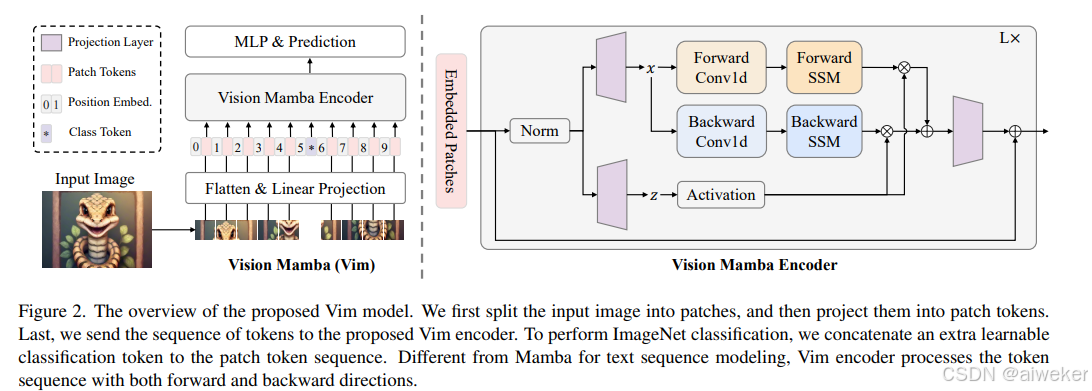

4. Vision Mamba: Efficient Visual Representation Learning with Bidirectional State Space Model

这篇论文以765次引用排名第四,探讨了Mamba架构在视觉任务中的应用。Mamba架构是一种线性复杂度的注意力语言建模替代方案,有可能彻底改变处理计算机视觉问题的方式。Vision Mamba论文的发表,标志着计算机视觉领域取得了重要进展。

- https://arxiv.org/pdf/2401.09417v2

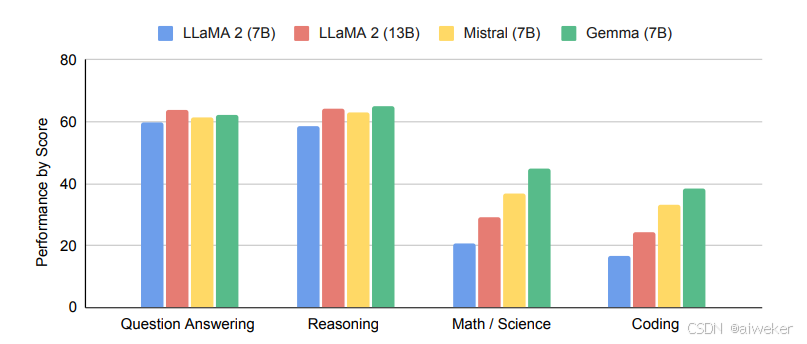

3. Gemma: Open Models Based on Gemini Research and Technology

谷歌发表的“Gemma”论文以677次引用排名第三,重点介绍了该公司为解决AI安全问题所做的努力。Gemma是一个20亿和70亿参数的开源模型,源自谷歌的Gemini模型,强调AI安全性和一致性。该论文的成功发表,引起了研究界的极大关注,为人工智能安全和负责任开发的讨论做出了宝贵贡献。

- https://arxiv.org/pdf/2403.08295v4

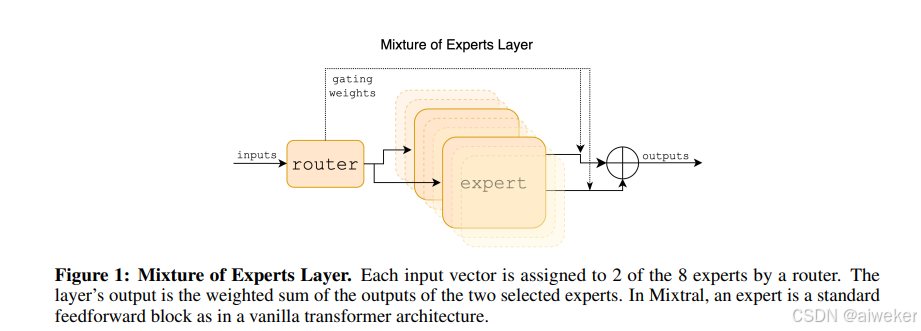

2. Mixtral of Experts

由Mistral AI团队发表的这篇论文以1,350次引用排名第二。论文全面概述了专家混合技术,该技术涉及通过不同的神经网络路由输入,以更好地存储和处理信息。随着MrAI发布Mixr A7B模型,该论文已成为2024年的主流技术之一。混合专家方法的广泛采用,标志着人工智能领域的一项重大发展。

- https://arxiv.org/pdf/2401.04088v1

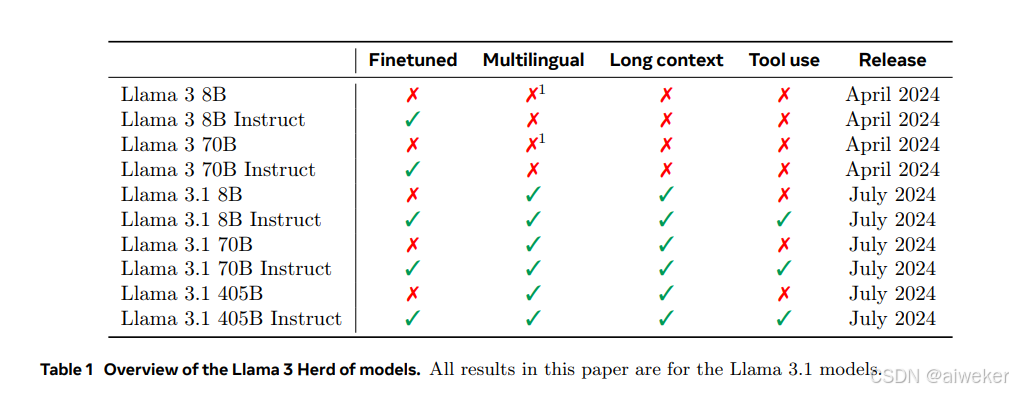

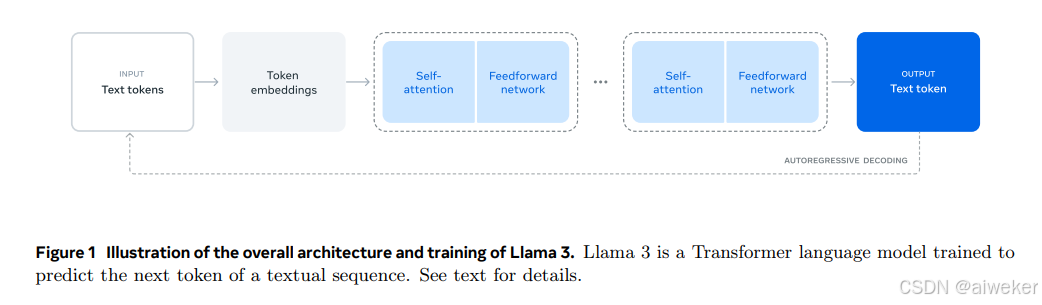

1. The Llama 3 Herd of Models

截至2024年11月,Meta发表的“Llama-3”论文以惊人的1,719次引用位居榜首。这篇长达92页的论文为训练大规模语言模型提供了详细的蓝图,涵盖了硬件优化、预训练技术甚至安全对齐等广泛主题。Meta分享了创建多达450亿个参数的最先进的语言模型的确切步骤,使得这篇论文成为任何对大型语言模型最新进展感兴趣的人的必读之作。Llama-3论文的发表,无疑将对AI领域产生深远影响。

- https://arxiv.org/pdf/2407.21783v2

综上所述,2024年在Arxiv上引用次数最高的10篇AI论文涵盖了代码智能、大型语言模型、新型机器学习架构、混合专家方法以及计算机视觉等多个领域。这些论文的发表不仅推动了AI技术的快速发展,也为未来的研究提供了宝贵的参考和启示。

693

693

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?