批次梯度下降

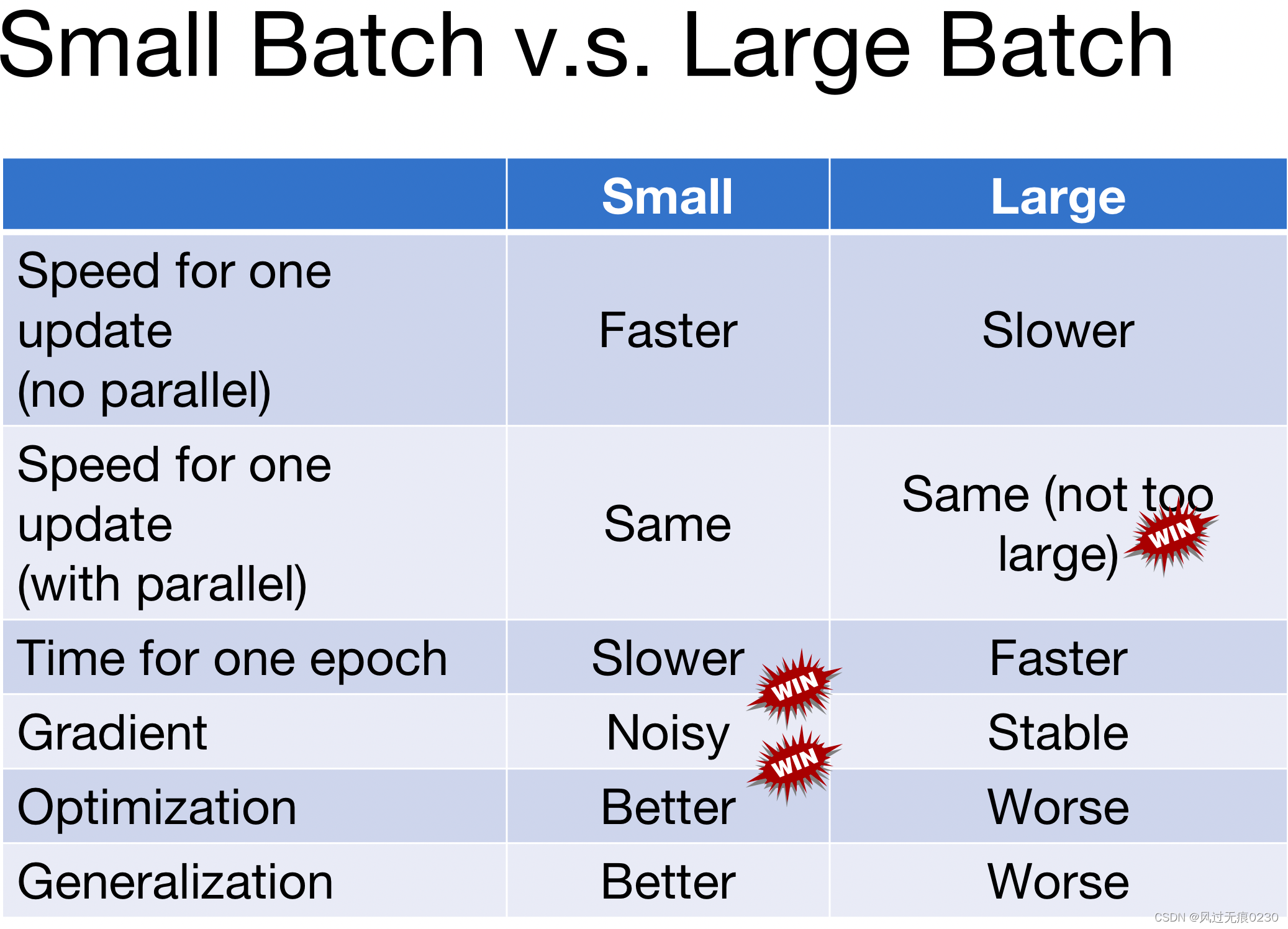

- 在GPU可以并行计算的情况下,小批次相对于大批次来说一次update的时间几乎相同(除非是大批次过大),没有优势

- 由于一次update时间几乎相同,小批次一次epoch的update次数多于大批次,所以小批次的一次epoch训练时间明显大于大批次

- 小批次梯度下降波动大,大批次梯度相对平稳

- 小批次在训练时更不容易陷入局部最小值,因此训练表现好于大批次

- 小批次在测试集上的泛化效果也要好于大批次

总的来说就是,小批次训练比较慢,但表现更好。

动量梯度下降

梯度下降不仅是当前梯度,也受到之前梯度移动的影响。

梯度下降加动量的好处是可以帮助逃离临界点,而且梯度下降更加平稳。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?