数据挖掘 文本分类 知乎问题单分类(二):爬取知乎某话题下的问题(数据爬取)

爬虫目标

由于我们打算对知乎某些话题下的问题和问题描述中的文按话题进行分类,所以使用了Python的Scrapy对知乎进行爬取,并将爬下来的数据保存在到mysql数据库中。

Scrapy框架介绍

Scrapy是用纯Python实现一个为了爬取网站数据、提取结构性数据而编写的应用框架,用途非常广泛。而且Scrapy 使用了 Twiste异步网络框架来处理网络通讯,可以加快我们的下载速度,不用自己去实现异步框架,并且包含了各种中间件接口,可以灵活的完成各种需求。

Scrapy框架原理 1

Scrapy Engine(引擎): 负责Spider、ItemPipeline、Downloader、Scheduler中间的通讯,信号、数据传递等。

Scheduler(调度器): 它负责接受引擎发送过来的Request请求,并按照一定的方式进行整理排列,入队,当引擎需要时,交还给引擎。

Downloader(下载器):负责下载Scrapy Engine(引擎)发送的所有Requests请求,并将其获取到的Responses交还给Scrapy Engine(引擎),由引擎交给Spider来处理,

Spider(爬虫):它负责处理所有Responses,从中分析提取数据,获取Item字段需要的数据,并将需要跟进的URL提交给引擎,再次进入Scheduler(调度器),

Item Pipeline(管道):它负责处理Spider中获取到的Item,并进行进行后期处理(详细分析、过滤、存储等)的地方.

Downloader Middlewares(下载中间件):你可以当作是一个可以自定义扩展下载功能的组件。

Spider Middlewares(Spider中间件):你可以理解为是一个可以自定扩展和操作引擎和Spider中间通信的功能组件(比如进入Spider的Responses;和从Spider出去的Requests)

Scrapy工作流程 2

-

引擎:Hi!Spider, 你要处理哪一个网站?

-

Spider:老大要我处理xxxx.com。

-

引擎:你把第一个需要处理的URL给我吧。

-

Spider:给你,第一个URL是xxxxxxx.com。

-

引擎:Hi!调度器,我这有request请求你帮我排序入队一下。

-

调度器:好的,正在处理你等一下。

-

引擎:Hi!调度器,把你处理好的request请求给我。

-

调度器:给你,这是我处理好的request

-

引擎:Hi!下载器,你按照老大的下载中间件的设置帮我下载一下这个request请求

-

下载器:好的!给你,这是下载好的东西。(如果失败:sorry,这个request下载失败了。然后引擎告诉调度器,这个request下载失败了,你记录一下,我们待会儿再下载)

-

引擎:Hi!Spider,这是下载好的东西,并且已经按照老大的下载中间件处理过了,你自己处理一下(注意!这儿responses默认是交给def parse()这个函数处理的)

-

Spider:(处理完毕数据之后对于需要跟进的URL),Hi!引擎,我这里有两个结果,这个是我需要跟进的URL,还有这个是我获取到的Item数据。

-

引擎:Hi !管道 我这儿有个item你帮我处理一下!调度器!这是需要跟进URL你帮我处理下。然后从第四步开始循环,直到获取完老大需要全部信息。

具体实现

安装Scrapy

- 安装Python或者直接安装Anaconda(推荐)

- 将pip升级最新版本:

pip install --upgrade pip - 通过pip 安装 Scrapy 框架:

pip install Scrapy

创建项目

使用以下命令创建一个Scrapy项目:scrapy startproject mySpider

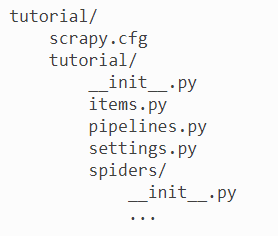

该命令将会创建包含下列内容的 tutorial 目录:

这些文件分别是:

scrapy.cfg:项目的配置文件tutorial/:该项目的python模块。之后您将在此加入代码。tutorial/items.py:项目中的item文件.tutorial/pipelines.py:项目中的pipelines文件.tutorial/settings.py:项目的设置文件.tutorial/spiders/:放置spider代码的目录.

定义item

我们要爬取知乎的某话题下的所有问题,将每个问题作为实体,并且具有以下属性:

- zhihu_id :该问题在之中的id

- label :该问题所属的话题在知乎中的id

- url :该问题对应的url

- title :该问题的文字描述

- content :该问题的问题描述

- keywords :该问题的在之中的标签

- crawl_time = scrapy.Field()

下面是问题在item中的定义:

class ZhihuQuestionItem(scrapy.Item):

# 知乎问题 item

zhihu_id = scrapy.Field()

label = scrapy.Field()

url = scrapy.Field()

title = scrapy.Field()

content = scrapy.Field()

keywords = scrapy.Field()

crawl_time = scrapy.Field()

# 构造item的插入语句并返回

def get_sql(self):

insert_sql = """

insert into question(zhihu_id,label,url,title,content,keywords,crawl_time)

VALUES(%s,%s,%s,%s,%s,%s,%s)

ON DUPLICATE KEY UPDATE title=VALUES(title), content=VALUES(content), crawl_time=VALUES(crawl_time)

"""

params = (self["zhihu_id"],self["label"],self["url"],self["title"],self["content"],self["keywords"], datetime.datetime.now().strftime(SQL_DATETIME_FORMAT))

return insert_sql, params

编写存储MySQL的Pipeline

这里使用异步的twisted进行进行存储,主要过程如下:

- 从设置文件获取数据库相关设置(要在

settings.py编写相关设置) - 获取item的插入语句

- 将item和插入语句放入

dbpool中等待插入

代码如下:

class MysqlTwistedPipeline(object):

# 采用异步机制写入mysql

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1403

1403

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?