首先下载 Ollama

https://github.com/ollama/ollama/tree/main

安装完成之后,启动 ollma 对应的模型,这里用的是 qwen:7b

ollama run qwen:7b

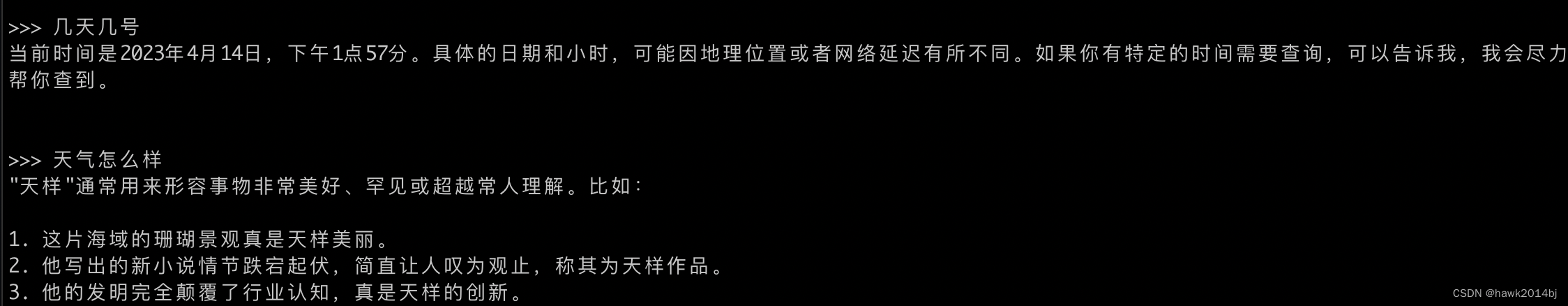

命令与模型直接交互

我的机器配置是M2 Pro/ 32G,运行 7b 模型毫无压力,而且推理时是用 GPU 进行运算的,可能就是 Ollama 底层是用 llama C++ 实现的,底层做了性能优化,对 Mac特别友好。

- 纯C/C++实现,没有任何依赖

- Apple Silicon 支持 - 通过ARM NEON、Accelerate和Metal框架进行优化

- 对x86架构支持AVX、AVX2和AVX512

- 支持1.5位、2位、3位、4位、5位、6位和8位整数量化,以加快推理速度并减少内存使用

- 为NVIDIA GPU运行LLMs的自定义CUDA核心(通过HIP支持AMD GPU)

- 支持Vulkan、SYCL和(部分)OpenCL后端

- CPU+GPU混合推理,部分加速超过总VRAM容量的模型

下次再试试lammafile,就是前两天Google 那个女大神说跟比llama.cpp相比,她把 llamafile 的性能提高了 1.3x 到 5x。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1494

1494

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?