文章目录

摘要

论文链接:https://arxiv.org/pdf/2301.01146.pdf

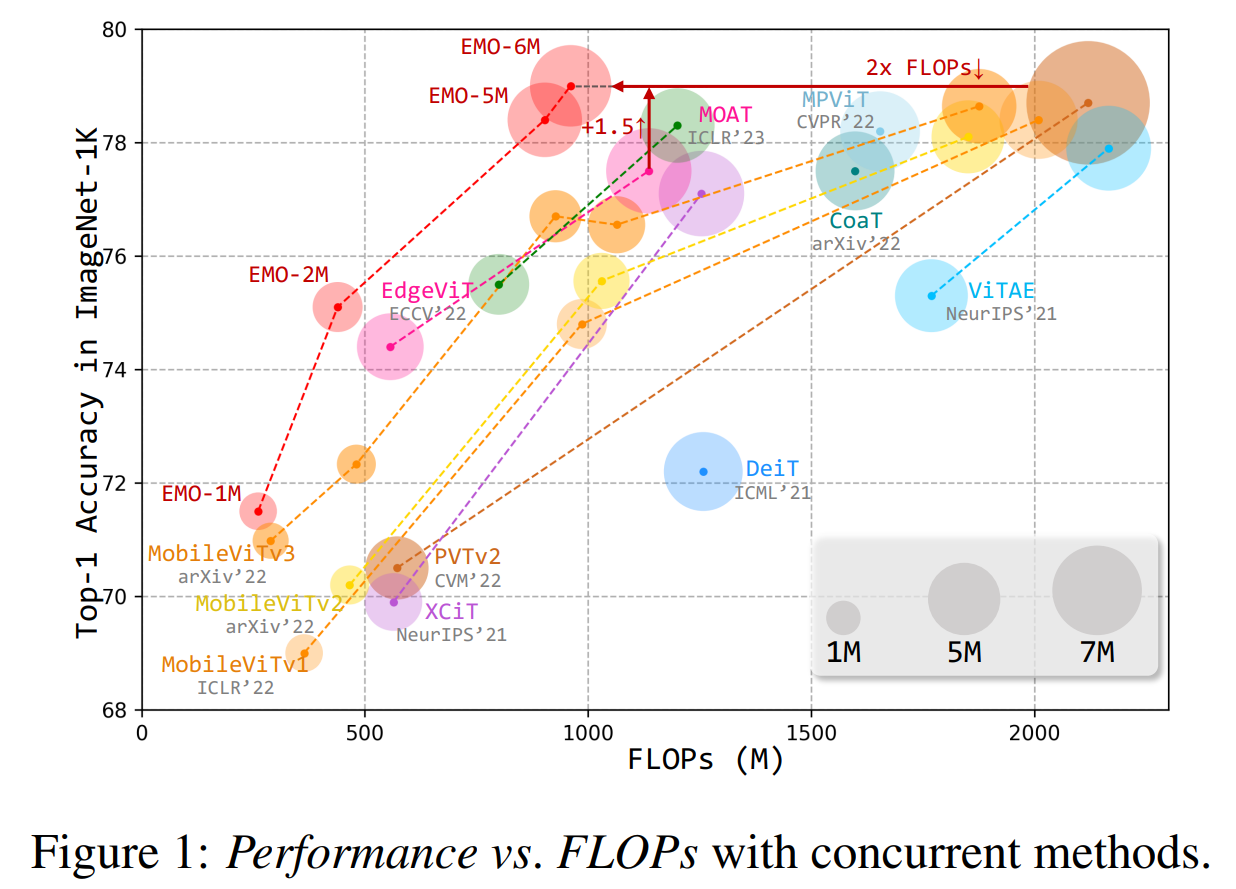

本文的重点是在权衡参数、FLOPs和性能的同时,为密集预测开发现代、高效、轻量级的模型。倒立残差块(IRB)是轻量级CNN的基础结构,但在基于注意力的研究中还没有相应的基础结构。本文从高效IRB和Transformer的有效组件的统一角度重新思考轻量级基础架构,将基于CNN的IRB扩展到基于注意力的模型,并抽象出一个用于轻量级模型设计的单残留元移动块(MMB)。根据简单而有效的设计准则,我们推导出了一种现代的反向残差移动块(iRMB),并构建了一个只有iRMB的类ResNet高效模型(EMO)用于下游任务。在ImageNet-1K, COCO2017和ADE20K基准测试上的大量实验证明了我们的EMO优于SOTA的方法,例如,EMO- 1m /2M/5M达到71.5,75.1和78.4 Top-1,超过了等阶CNN /基于注意力的模型,同时很好地权衡了参数,效率和精度:运行速度比iPhone14上的EdgeNeXt快2.8-4.0倍。代码是可用的。

1、介绍

随着近年来存储/计算受限应用需求的增加

本文提出了一种名为EMO的新型高效模型,它基于元移动块(MMB)重新思考了基于注意力的移动块设计。通过引入倒置残差移动块(iRMB),EMO在保持轻量级的同时,融合了深度卷积和注意力机制,从而在图像分类、物体检测和语义分割等任务上展现出优于现有SOTA模型的性能。EMO在保持较低参数和FLOPs的同时,实现了与更复杂模型相当甚至更好的精度,展示了其在移动设备上的优越效率。

本文提出了一种名为EMO的新型高效模型,它基于元移动块(MMB)重新思考了基于注意力的移动块设计。通过引入倒置残差移动块(iRMB),EMO在保持轻量级的同时,融合了深度卷积和注意力机制,从而在图像分类、物体检测和语义分割等任务上展现出优于现有SOTA模型的性能。EMO在保持较低参数和FLOPs的同时,实现了与更复杂模型相当甚至更好的精度,展示了其在移动设备上的优越效率。

订阅专栏 解锁全文

订阅专栏 解锁全文

1562

1562

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?