WSDM 2024接收的论文已经公布,全部收录的论文可前往地址

网址:https://www.wsdm-conference.org/2024/accepted-papers/

其中推荐系统相关论文三十余篇,下文列举了部分论文的标题以及摘要,更多内容欢迎关注公众号【深度学习推荐算法】

1、Mixed Attention Network for Cross-domain Sequential Recommendation(卡耐基梅隆,快手)【跨域序列推荐的混合注意力网络】

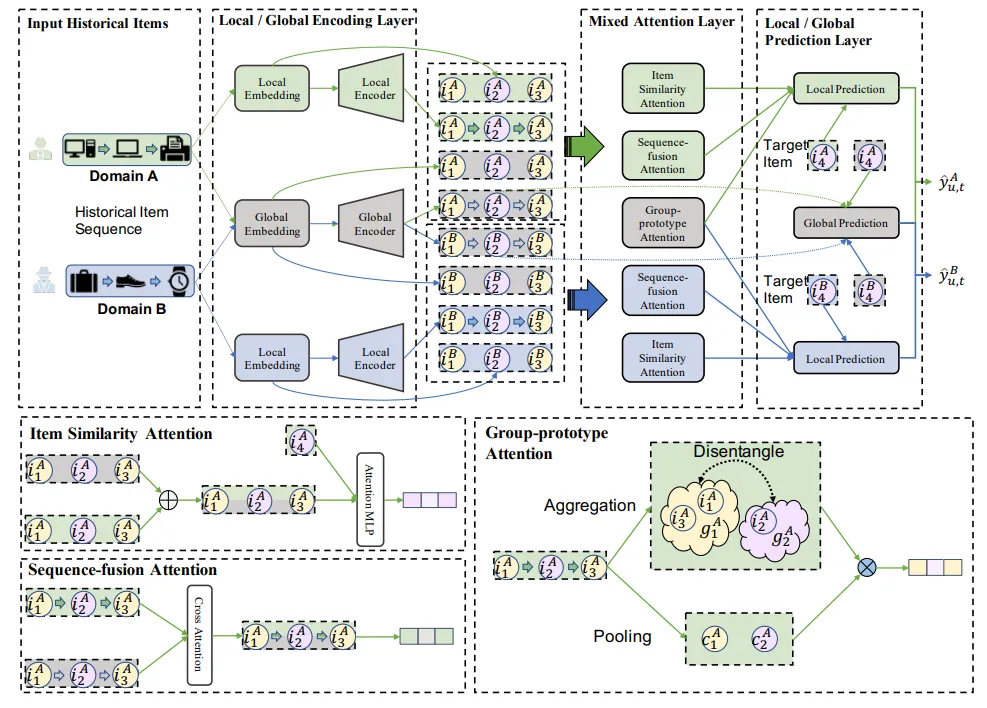

在现代推荐系统中,顺序推荐利用按时间顺序排列的用户行为来提供有效的下一项目建议,但这种方法存在数据稀缺问题,尤其是对新用户而言。跨领域推荐是一项很有前景的工作,它利用多个领域的数据训练模型,以提高数据稀缺领域的性能。最近提出的跨领域顺序推荐模型(如 PiNet 和 DASL)有一个共同的缺点,即严重依赖不同领域的重叠用户,这限制了它们在实际推荐系统中的应用。在本文中,我们提出了一种具有本地和全局注意力模块的混合注意力网络(M ixed A ttention N etwork,MAN),以提取特定域和跨域信息。首先,我们提出了一个本地/全局编码层来捕捉特定领域/跨领域的序列模式。然后,我们提出了一个混合注意力层,包括项目相似性注意力、序列融合注意力和群体原型注意力,分别用于捕捉本地/全局项目相似性、融合本地/全局项目序列和提取不同领域的用户群体。最后,我们提出了一个局部/全局预测层,以进一步发展和结合特定领域和跨领域的兴趣。在两个真实世界数据集(每个数据集有两个领域)上的实验结果表明了我们提出的模型的优越性。进一步的研究还表明,我们所提出的方法和组件与模型无关,并且可以在不同领域中使用。进一步的研究还表明,我们提出的方法和组件分别与模型无关,而且非常有效。代码和数据可在网站上获取。

https://github.com/Guanyu-Lin/MAN

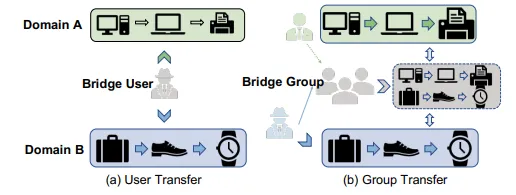

图 1:(a) 依赖重叠用户的用户转移学习和(b) 无用户重叠假设的群体转移学习示意图

图 2:我们提出的城域网模型示意图。(1) 项目序列首先被输入本地/全局编码层,该层为每个项目建立本地和全局嵌入,并对其进行编码,以提取本地和全局序列模式;(2) 在混合注意层中,项目相似性注意被输入本地和全局项目嵌入,以捕捉项目级模式。在混合注意层中,项目相似性注意利用本地和全局项目嵌入来捕捉项目级关系;序列融合注意融合编码的本地和全局序列表示来捕捉序列级关系;组原型注意利用共享的组原型来捕捉组级关系。在此,我们以领域 A 为例,详细说明所提出的各个注意力组件。(4) 聚合嵌入将分别输入局部预测层和全局预测层,进行最终预测。

2、Knowledge Graph Context-Enhanced Diversified Recommendation(伊利诺伊)【知识图谱上下文增强的多样化推荐】

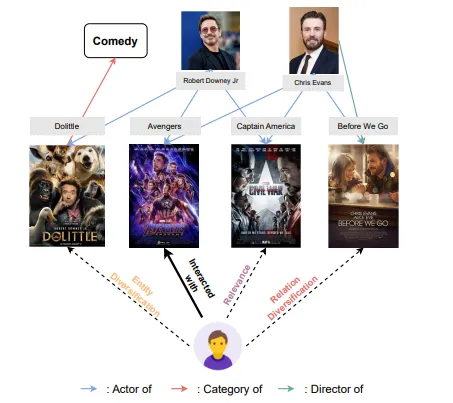

推荐系统(RecSys)领域已被广泛研究,以利用用户的历史互动来提高准确性。然而,对准确性的不懈追求往往会削弱多样性,最终导致众所周知的 “回音室 ”现象。多元化 RecSys 作为一种对策应运而生,它将多样性与准确性相提并论,赢得了学术界和行业从业者的广泛关注。本研究在错综复杂的知识图谱(KG)背景下探索多元化 RecSys。这些知识图谱是有关实体和项目的相互关联信息的存储库,通过纳入具有洞察力的上下文信息,为扩大推荐多样性提供了有利途径。我们的贡献包括引入了一个创新指标–实体覆盖率和关系覆盖率,该指标可有效量化 KG 领域内的多样性。此外,我们还引入了多样化嵌入学习(DEL)模块,该模块经过精心设计,能够制定出具有与生俱来的多样性意识的用户表征。与此同时,我们还引入了一种名为 “条件对齐和一致性”(CAU)的新技术。它在保持上下文完整性的同时,还能巧妙地对 KG 项目嵌入进行编码。总之,我们的贡献标志着在以 KG 为基础的 RecSys 范例中,在增强推荐多样性全景方面取得了重大进展。

图 1:带有知识图谱的多元化 RecSys。

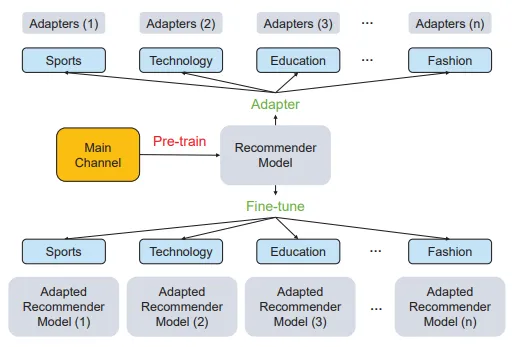

3、Exploring Adapter-based Transfer Learning for Recommender Systems: Empirical Studies and Practical Insights(西湖大学)【基于适配器的推荐系统迁移学习探索:实证研究与实践启示】

适配器是一种具有可调参数的插件式神经网络模块,它是一种参数高效的迁移学习技术,可将预先训练好的模型适配到下游任务中,尤其适用于自然语言处理(NLP)和计算机视觉(CV)领域。同时,直接从原始项目模式特征(如 NLP 的文本和 CV 的图像)中学习推荐模型,可以实现有效和可迁移的推荐系统(称为 TransRec)。有鉴于此,一个自然而然的问题出现了:基于适配器的学习技术能否实现参数高效、性能良好的 TransRec? 为此,我们进行了实证研究,以解决几个关键的子问题。首先,我们询问基于适配器的 TransRec 与基于标准全参数微调的 TransRec 的性能是否相当,是否适用于不同项目模式的推荐,例如文本 RS 和视觉 RS。如果是,我们将在项目推荐任务中对这些在 NLP 和 CV 任务中被证明有效的现有适配器进行基准测试。第三,我们仔细研究了基于适配器的 TransRec 的几个关键因素,即在哪里以及如何插入这些适配器?最后,我们通过扩大源训练数据或缩小目标训练数据来研究基于适配器的 TransRec 的效果。我们的论文为统一可转移推荐–一种研究较少的推荐方案–提供了重要见解和实用指导。我们在下列URL上发布了我们的代码和其他资料:

https://github.com/westlake-repl/Adapter4Rec/

图 1:大型工业 RS 平台通常有一个主推荐频道和多个垂直频道,如体育、教育、时尚等。我们必须通过标准微调的单独模型来维护每个频道的整个模型;相比之下,通过适配器微调只需要维护一小部分参数。

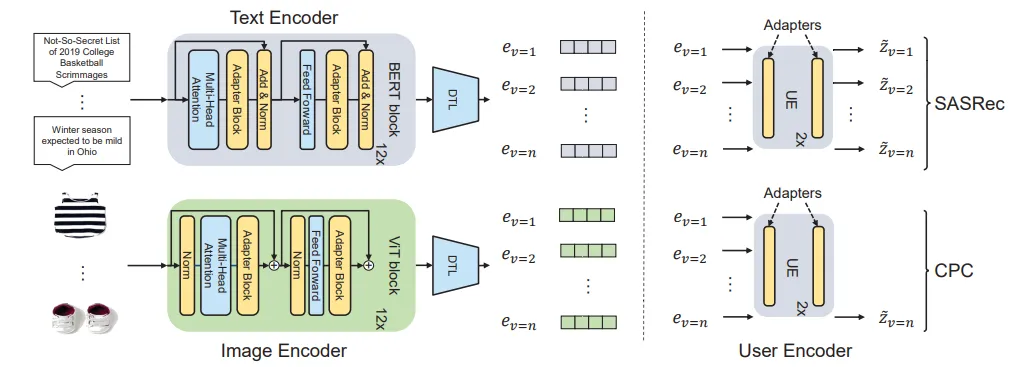

图 3:基于适配器的 TransRec 框架。TransRec 由一个用户编码器(UE)和多个项目编码器组成,以虚线划分。BERT 和 ViT 分别用作文本编码器和图像编码器的示例。SASRec 和 CPC(DSSM 变体)用于训练 UE。𝑍˜𝑣=1, …, 𝑍˜ 𝑣=𝑛 是由 UE 生成的向量,𝑒𝑣=1, …, 𝑒𝑣=𝑛 是由 ME 生成的向量。因此,在 UE 中注入适配器的方法与项目编码器的方法相同。

4、Diff-MSR: A Diffusion Model Enhanced Paradigm for Cold-Start Multi-Scenario Recommendation(香港城市大学,华为)【Diff-MSR:冷启动多场景推荐的扩散模型增强范式】

随着各种商业场景的爆炸式增长,关于多场景推荐(MSR)的研究也越来越多。MSR 利用多个场景的数据训练推荐系统,旨在同步提高所有这些场景的推荐性能。然而,由于各领域间的交互数量差异较大,多场景推荐模型通常会出现学习不足和负迁移的问题,尤其是在冷启动场景上,从而加剧了数据稀疏性问题。为了填补这一空白,我们在本研究中提出了一种新的扩散模型增强范式,该范式以数据驱动生成的方式为多场景推荐中的冷启动问题量身定制。具体来说,基于全域数据,我们将扩散模型与新设计的方差表和提出的分类器相结合,通过利用生成的高质量和信息嵌入,利用丰富的场景,明确提升冷启动场景的推荐性能。我们在豆瓣和亚马逊数据集上的实验证明了所提范式的两个优势:(i) 其有效性,在这两个数据集上的准确率分别显著提高了 8.5% 和 1%;(ii) 其与各种多场景骨干模型的兼容性。为便于复制,我们提供了实施代码。

https://github.com/Applied-Machine-Learning-Lab/Diff-MSR

https://github.com/mindspore-lab/models/tree/master/research/huawei-noah/Diff-MSR

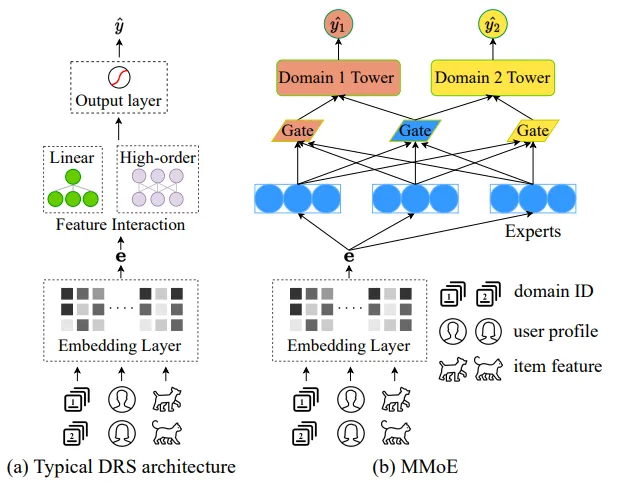

图 1:多场景推荐模型图解。蓝色代表共享参数,红色和黄色代表特定场景参数。

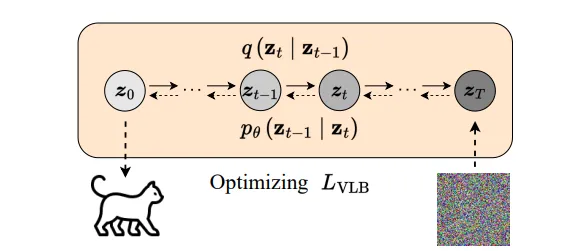

图 2:扩散模型示意图。上半部分 实线箭头的上半部分表示正向过程,而虚线箭头的下半部分表示反向过程。表示反向过程。

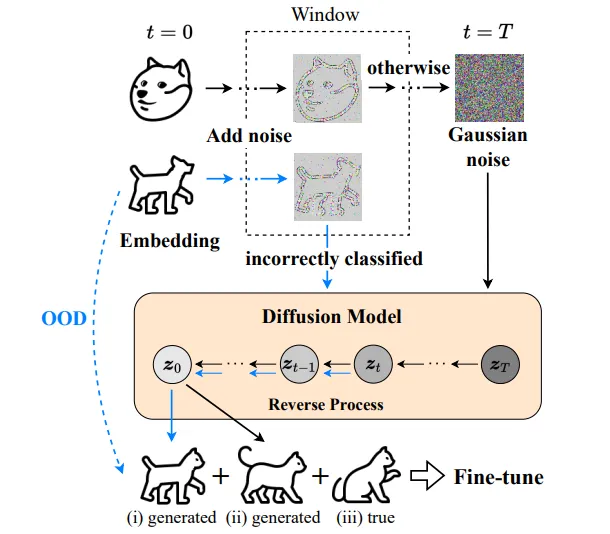

图 3:Diff-MSR 的图示,其中rich dog域用于帮助冷启动cat域的 OOD 生成。为简单起见,省略了用户配置文件。微调数据由 3.5 节中介绍的三部分组成。

5、AutoPooling: Automated Pooling Search for Multi-valued Features in Recommendations(腾讯)

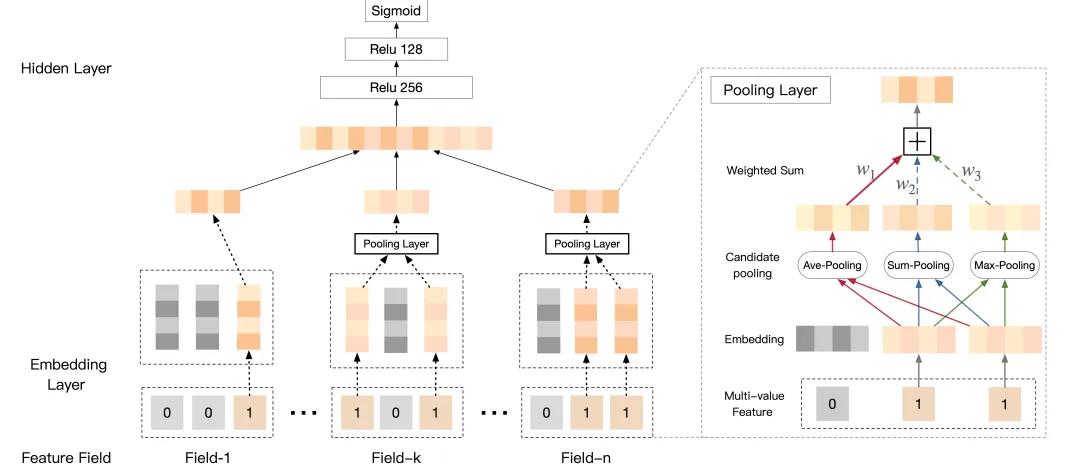

大规模推荐系统通常包含数百个多值特征字段,每个字段的值数量不同。为了便于传统固定形状神经网络的计算,池化算子被广泛用于将多值特征压缩为固定维度的向量。大多数现有工作为所有字段设置单一池化方法,但这会导致次优结果,因为不同的特征字段具有不同的信息分布,因此需要不同的池化方法。在这项工作中,我们提出了一个基于 AutoML 的框架,称为 AutoPooling,它可以自动高效地为每个多值特征搜索最佳池化算子。具体而言,可学习的权重被分配给每个特征字段中的所有候选池化算子。然后使用基于 AutoML 的算法来学习模型参数和字段感知权重。最后,可以根据相关权重获得最佳池化算子。我们在公共数据集和工业数据集上评估了所提出的框架。结果表明,AutoPooling 明显优于基准。进一步的实验结果表明,我们的方法在各种深度推荐模型和不同的搜索空间中都具有鲁棒性。

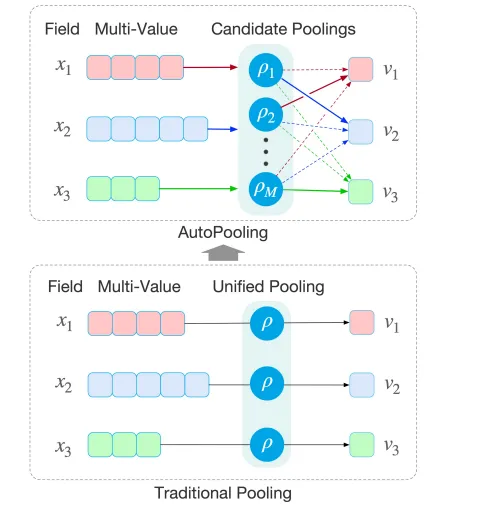

图 1:传统池化运算符和自动池化运算符。在自动池化过程中,不同颜色的线表示候选池化运算符的字段感知权重,实线表示每个特征的最佳池化。传统池化运算符为所有字段设置单个池化运算符。

图 2:所提出的 AutoPooling 框架概述。

6、C^ 2DR: Robust Cross-Domain Recommendation based on Causal Disentanglement(中南)【C^2DR:基于因果解耦的鲁棒跨域推荐】

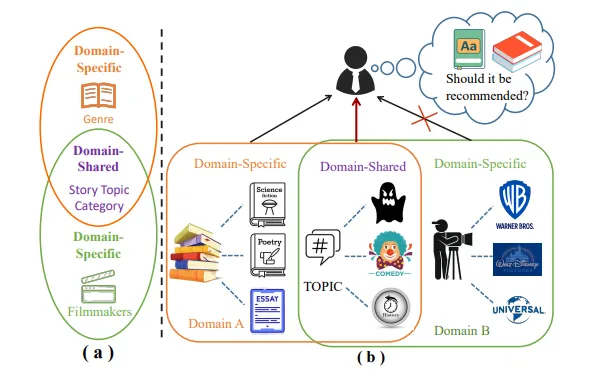

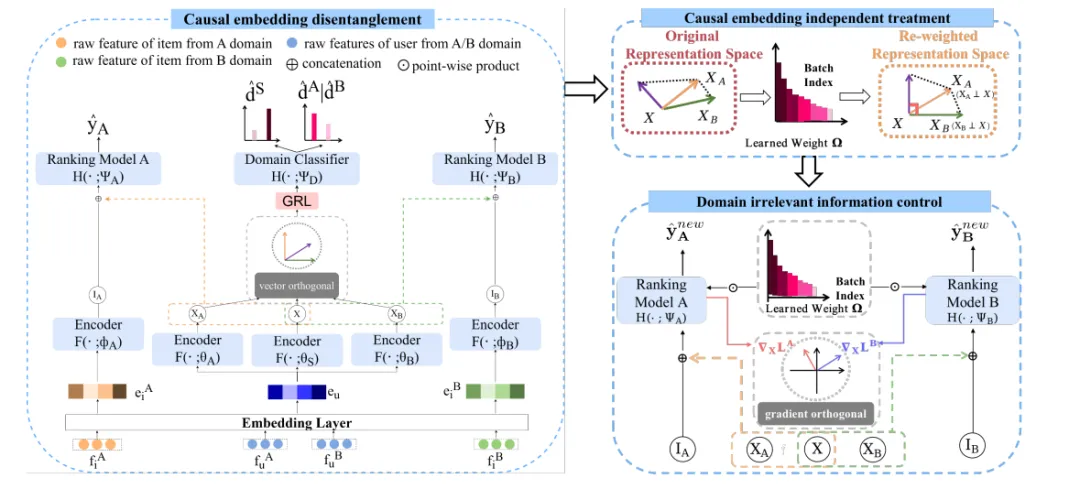

跨域推荐旨在利用异构信息将知识从数据充足的域(源域)转移到数据稀缺的域(目标域)。现有方法主要侧重于学习单域用户偏好,然后使用传输模块来获取跨域用户偏好,但忽略了对用户对项目的域特定偏好的建模。我们认为,从源域中引入域特定偏好将引入与目标域不相关的信息。此外,直接结合域共享和域特定信息可能会阻碍目标域的性能。为此,我们提出了 C^ 2DR,这是一种从因果角度解开域共享和域特定偏好的新方法。具体而言,我们制定因果图来捕捉基于底层推荐过程的关键因果关系,明确将域共享和域特定信息标识为因果无关变量。然后,我们引入解缠正则化项来学习因果图中遵循独立性约束的因果变量的不同表示。值得注意的是,我们提出的方法能够有效地干预和传输领域共享信息,从而提高推荐模型的稳健性。我们通过对三个真实数据集的大量实验来评估 C^ 2DR 的有效性,结果表明,与最先进的基线相比,C^2DR 有显著的改进。

图 1:(a):图书和电影领域中用户偏好的示例。(b):𝐶2𝐷𝑅 利用解开的领域共享信息和领域特定因素进行推荐。

图 3:𝐶2𝐷𝑅 的训练过程。1. 𝐶2𝐷𝑅 训练多个编码器并使用具有梯度反向层 (GRL) 的域分类器有效地提取域共享信息。2. 𝐶2𝐷𝑅 学习一个权重向量,该权重向量重新加权表示空间,以便独立处理因果变量。3. 𝐶2𝐷𝑅 通过在每个域中强制域共享信息 𝑋 与损失函数的梯度之间的正交性来减轻域无关信息的负面转移。

7、Unified Pretraining for Recommendation via Task Hypergraphs(伊利诺伊,Salesforce)【基于任务超图的推荐统一预训练】

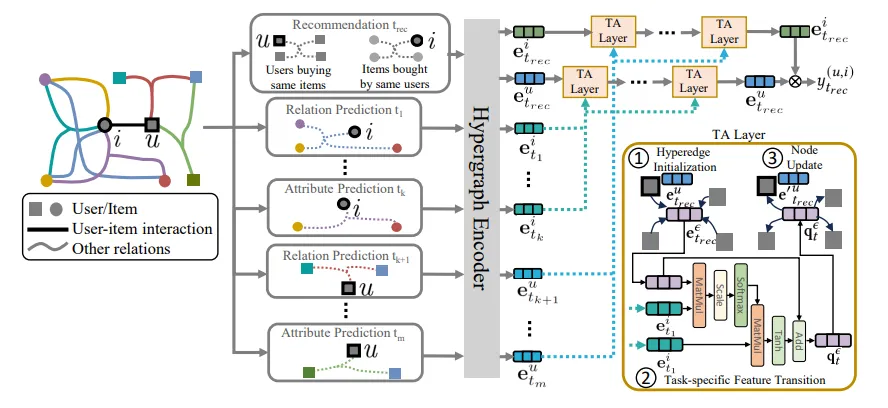

尽管预训练近年来引起了广泛关注和普及,但它在基于图的推荐系统中的应用相对有限。在广泛使用的 ID 相关数据集中通过预训练来利用先验知识是一项挑战。一方面,一个数据集中的用户-项目交互历史很难通过预训练转移到其他数据集,因为 ID 不同。另一方面,在同一数据集上进行预训练和微调会导致过拟合的风险很高。在本文中,我们提出了一种新的多任务预训练框架,即通过任务超图进行推荐的统一预训练。为了形成一个统一的学习模式来处理各种借口任务的不同要求和细微差别,我们设计了任务超图来将借口任务推广到超边预测。设计了一种新颖的过渡注意层来有区别地学习每个借口任务和推荐之间的相关性。在三个基准数据集上的实验结果验证了 UPRTH 的优越性。进行了额外的详细调查以证明所提框架的有效性。

图 2:(a) UPRTH 的整体框架;首先,我们根据不同的借口任务构建任务超图。接下来,我们应用超图编码器从任务超图中学习特定于任务的嵌入。最后,我们使用 TA 层将知识从辅助借口任务有区别地转移到推荐任务;(b) 过渡注意力 (TA) 层的图示。

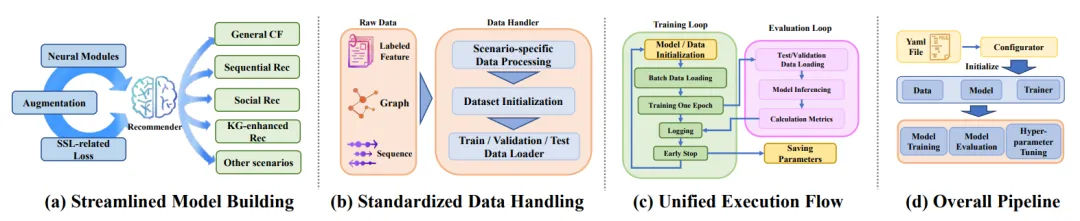

8、SSLRec: A Self-Supervised Learning Library for Recommendation(港大)【自监督推荐库】

近年来,自监督学习 (SSL) 作为一种解决推荐系统中稀疏和噪声数据所带来的挑战的解决方案,引起了人们的极大兴趣。尽管越来越多的 SSL 算法旨在在各种推荐场景(例如,图形协同过滤、顺序推荐、社交推荐、KG 增强推荐)中提供最先进的性能,但仍然缺乏集成不同领域推荐算法的统一框架。这样的框架可以作为自监督推荐算法的基石,统一现有方法的验证并推动新方法的设计。为了解决这一差距,我们推出了 SSLRec,这是一个新颖的基准平台,它提供了一个标准化、灵活和全面的框架来评估各种 SSL 增强推荐器。SSLRec 库具有模块化架构,允许用户轻松评估最先进的模型,以及一整套数据增强和自监督工具包,以帮助创建具有特定需求的 SSL 推荐模型。此外,SSLRec 简化了使用一致和公平的设置训练和评估不同推荐模型的过程。我们的 SSLRec 平台涵盖了一套适用于不同场景的先进 SSL 增强推荐模型,使研究人员能够评估这些前沿模型并推动该领域的进一步创新。SSLRec 框架可在源代码存储库中找到 :

https://github.com/HKUDS/SSLRec

图 1:SSLRec 的总体框架。

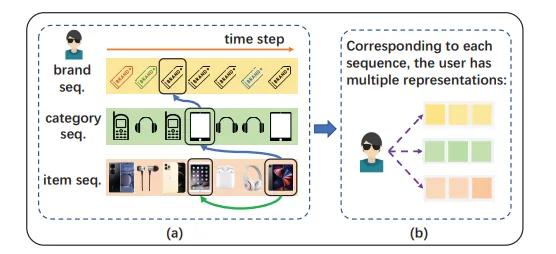

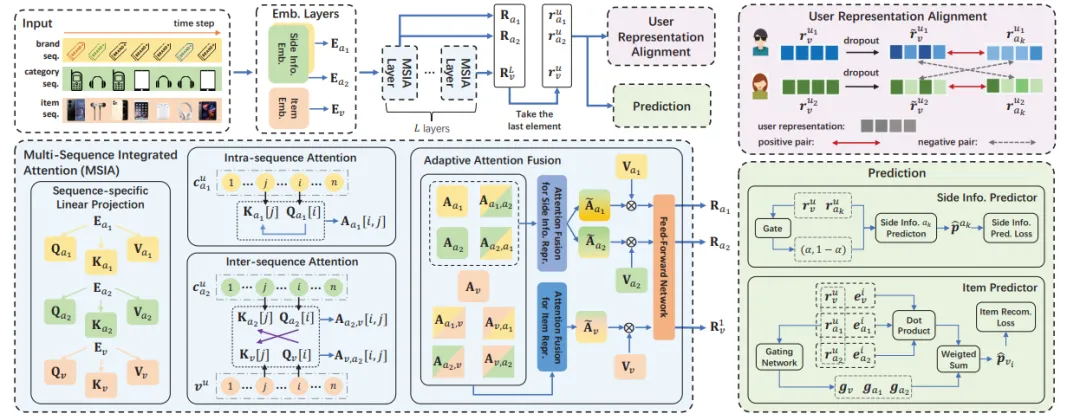

9、Multi-Sequence Attentive User Representation Learning for Side-information Integrated Sequential Recommendation(深圳大学,腾讯)【辅助信息集成序列推荐的多序列注意用户表征学习】

集成辅助信息的顺序推荐结合了补充信息以缓解数据稀疏性问题。最先进的工作主要利用一些辅助信息来改进注意力计算,以更准确地学习用户表示。然而,在这个主题中仍然存在一些限制需要解决。它们中的大多数仅仅在项目级别学习用户表示,而在计算注意力时忽略了项目序列和辅助信息序列的关联,从而导致用户表示的学习不全面。其中一些在项目和辅助信息级别学习用户表示,但它们仍然面临多个用户表示优化不足的问题。为了解决这些限制,我们提出了一个新模型,即多序列顺序推荐器(MSSR),它从不同的序列中学习用户的多个表示。具体来说,我们设计了一个多序列集成注意力层来学习比现有工作更多的注意力对,并自适应地融合这些对来学习用户表示。此外,我们的用户表示对齐模块构建了自监督信号来优化表示。随后,它们在训练过程中通过我们的边信息预测器进一步完善。对于项目预测,我们的 MSSR 额外考虑了候选项目的边信息,从而能够全面衡量用户的偏好。在四个公共数据集上进行的大量实验表明,我们的 MSSR 优于 11 个最先进的基线。可视化和案例研究也证明了我们的 MSSR 的合理性和可解释性。

图 1:用户对品牌、类别和商品序列的多重表征。(a) 用户的多重序列。绿色箭头表示当前商品的交互受到前一个商品的影响,而蓝色箭头表示它也受到相关类别和品牌的影响。(b) 用户的多重表征。

图 2:我们的 MSSR 概览。我们的 MSSR 将多个序列作为输入,并通过嵌入层获得嵌入矩阵。这些矩阵被输入到多序列集成注意层中,以学习用户的多个表示,这些表示由用户表示对齐模块进一步优化。最后,预测模块利用学习到的表示执行辅助信息预测(在训练期间)和项目预测。

10、LabelCraft: Empowering Short Video Recommendations with Automated Label Crafting(中科大,快手)【LabelCraft:通过自动标签制作实现短视频推荐】

短视频推荐通常会受到用户反馈质量的限制,因为用户反馈可能无法准确描述用户的兴趣。为了应对这一挑战,出现了一项新任务:从原始反馈中生成更可靠的标签。现有的标签生成方法依赖于手动规则,需要大量人力,并且可能与平台的预期目标不一致。为了超越这些限制,我们推出了 LabelCraft,这是一种新颖的自动标签生成方法,明确优化了平台成功的关键运营指标。通过将标签生成制定为高于推荐模型优化的更高级别的优化问题,LabelCraft 引入了一个可训练的标签模型,用于自动标签机制建模。通过元学习技术,LabelCraft 有效地解决了推荐和标签模型带来的双层优化障碍,从而实现了复杂标签生成机制的自动获取。对真实数据集的大量实验证实了 LabelCraft 在各种运营指标方面的卓越表现,包括使用时间、用户参与度和保留率。代码可从以下网址获取:

https://github.com/baiyimeng/LabelCraft

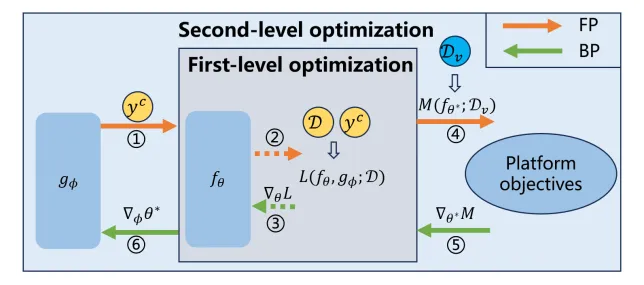

图 1:LabelCraft 概览,利用平台目标指导标签模型 𝑔𝜙 的学习,并以推荐模型 𝑓𝜃 作为中介桥梁

算法 1:LabelCraft 的训练

11、MONET: Modality-Embracing Graph Convolutional Network and Target-Aware Attention for Multimedia Recommendation(汉阳大学)【MONET:包含图卷积网络的模态和多媒体推荐的目标感知注意力】

在本文中,我们重点研究使用图卷积网络 (GCN) 的多媒体推荐系统,其中多模态特征以及用户-项目交互被一起使用。我们的研究旨在更有效地利用多模态特征,以准确捕捉用户对项目的偏好。为此,我们指出了现有基于 GCN 的多媒体推荐系统存在以下两个局限性:(L1) 虽然用户交互项目的多模态特征可以揭示她对项目的偏好,但现有方法使用的 GCN 仅专注于捕获协作信号,导致最终用户/项目嵌入中多模态特征的反映不足;(L2) 虽然用户通过考虑目标项目的多模态特征来决定是否喜欢目标项目,但现有方法无论目标项目的多模态特征如何,都将她表示为单个嵌入,然后利用她的嵌入来预测她对目标项目的偏好。为了解决上述问题,我们提出了一种新颖的多媒体推荐系统,名为 MONET,由以下两个核心思想组成:模态包容 GCN (MeGCN) 和目标感知注意力。通过使用四个真实数据集进行大量实验,我们证明了 i) MONET 明显优于七个最先进的竞争对手(与最佳竞争对手相比,召回率@20 的准确率高出 30.32%)和 ii) MONET 中两个核心思想的有效性。所有 MONET 代码均可在以下网址上找到:

https://github.com/Kimyungi/MONET

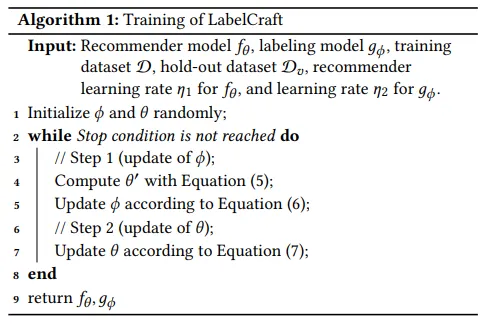

图 2:用户 𝑢 对目标商品 Pegasus 39 的兴趣玩具示例。箭头颜色越深,表示当用户 𝑢 决定是否购买 Pegasus 39 时,她对交互商品的兴趣考虑得越多。

图 4:MONET 概览,由三个关键组件组成:(a) 基于 MeGCN 的编码器;(b) 基于目标感知注意力的聚合器;© 利用用户的一般嵌入和面向目标的嵌入的预测器。

12、RecJPQ: Training Large-Catalogue Sequential Recommenders【RecJPQ:训练大型目录序列推荐】

顺序推荐是一种流行的推荐任务,它使用用户与项目交互的顺序来模拟不断变化的用户兴趣和行为的顺序模式。当前最先进的基于 Transformer 的顺序推荐模型(例如 BERT4Rec 和 SASRec)会生成序列嵌入并计算目录项目的分数,但目录大小的增加使得训练这些模型的成本很高。联合乘积量化 (JPQ) 方法最初是为段落检索提出的,它通过用有限数量的共享子嵌入替换段落嵌入,显著减少了检索索引的大小,而对模型有效性的影响却微乎其微。本文介绍了 RecJPQ,这是 JPQ 的一种新颖的顺序推荐改编,它取代了项目嵌入张量,并用有限数量的共享子嵌入的串联替换了项目嵌入,从而限制了可学习的模型参数的数量。RecJPQ 的主要思想是在训练主推荐模型之前将项目拆分为子项目实体,其灵感来自于将单词拆分为标记并在语言模型中训练标记器。我们将 RecJPQ 应用于三个大型序列数据集上的 SASRec、BERT4Rec 和 GRU4rec 模型。我们的结果表明,RecJPQ 可以显著减小模型大小(例如,Gowalla 数据集的模型大小减少了 48%,而效果没有降低)。RecJPQ 还可以通过正则化效果提高模型性能(例如,此 http URL 数据集的 NDCG@10 改进了 +0.96%)。总体而言,RecJPQ 允许在工业应用中训练最先进的 Transformer 推荐器,其中包含数百万个项目的数据集很常见。

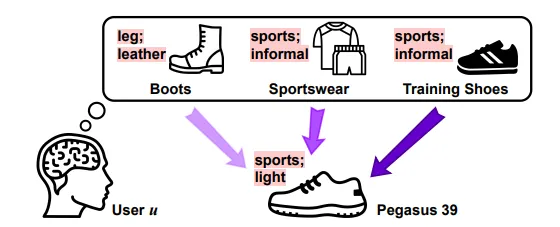

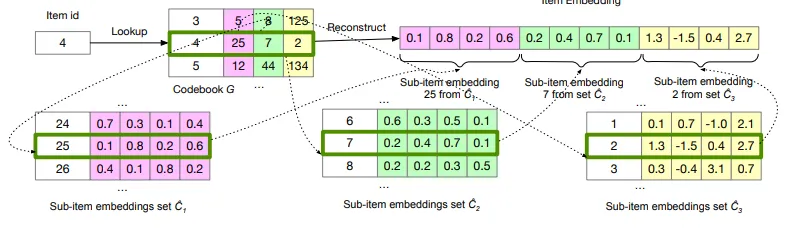

图 1:典型顺序推荐系统中的项目嵌入。这些项目嵌入有两种用途:(i) 获取序列表示和 (ii) 生成项目分数。嵌入张量需要 |𝐼 | · 𝑑 个可训练参数,其中 |𝐼 | 是项目目录大小,𝑑 是嵌入的大小。当目录大小 |𝐼 | 很大时,项目嵌入包含模型的大部分参数。

图 2:使用乘积量化重建项目嵌入:码本长度 𝑚 = 3,项目嵌入长度 𝑑 = 12,每个分割的子 ID 数量 𝑏 = 256。

13、On the Effectiveness of Unlearning in Session-Based Recommendation(山大)【基于会话的推荐中释放的有效性研究】

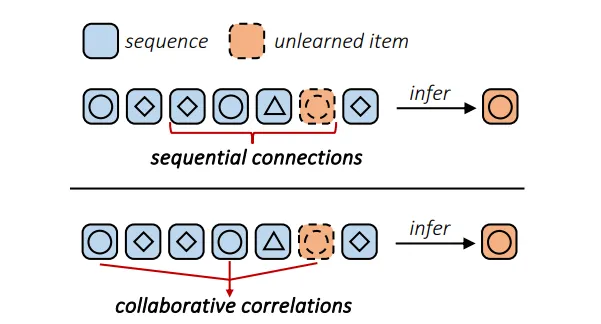

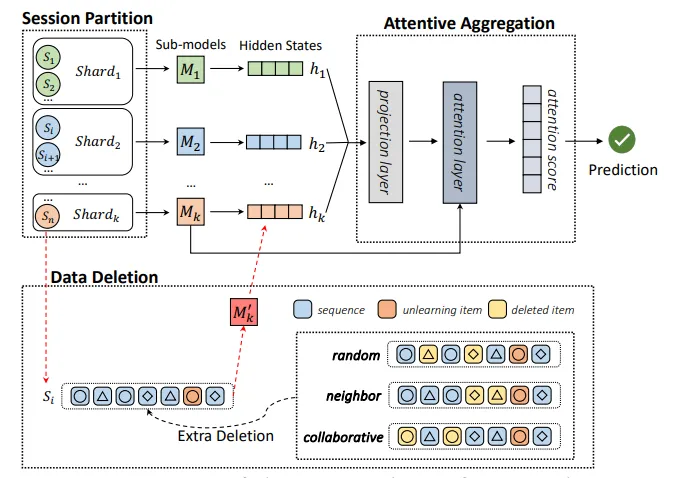

基于会话的推荐系统可以根据会话中的历史交互预测用户未来的兴趣。尽管可以记住历史样本,但出于用户隐私或模型保真度等原因,有时也会要求进行反学习,即消除某些训练样本的影响。然而,现有的反学习研究并不适用于基于会话的推荐系统。一方面,由于要反学习的项目与会话中剩余项目之间存在协同相关性和顺序连接,这些方法无法达到令人满意的反学习效果。另一方面,很少有研究对基于会话的推荐场景中的反学习效果进行验证。在本文中,我们提出了一个基于会话的推荐反学习框架SRU,该框架可以在基于会话的推荐中实现较高的反学习效率、准确的推荐性能和更好的反学习效果。具体来说,我们首先根据会话之间的相似性将训练会话划分为单独的子模型,然后利用基于注意机制的聚合层根据会话与子模型中数据集心之间的相关性融合隐藏状态。为了提高去学习效果,我们进一步提出了三种额外数据删除策略,包括协作额外删除(CED)、邻居额外删除(NED)和随机额外删除(RED)。此外,我们提出了一个评估指标,用于衡量数据删除后去学习样本是否可以推断出来,以验证去学习的有效性。我们用三个有代表性的基于会话的推荐模型实现了SRU,并在三个基准数据集上进行了实验。实验结果证明了我们方法的有效性。

图 1:精确的忘却学习很难实现。由于协作相关性和会话中项目之间的顺序连接,仍可以推断出未学习的项目。

图 2:所提出的 SRU 框架概述,SRU由会话分区、注意聚合和数据删除模块组成。

1477

1477

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?