回归预测 | MATLAB实现CNN-BiLSTM(卷积双向长短期记忆神经网络)多输入单输出

效果一览

基本介绍

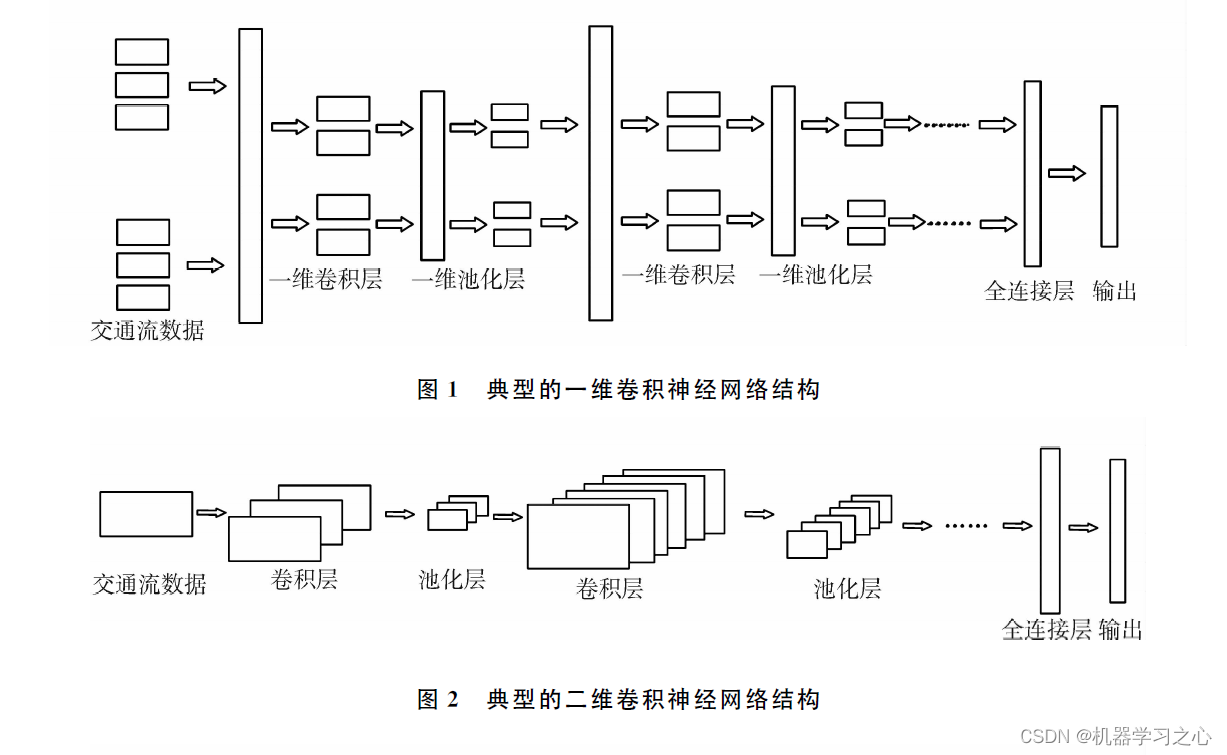

提出一种同时考虑时间与空间因素的卷积-双向长短期记忆(CNN-BiLSTM)模型,将具有空间局部特征提取能力的卷积神经网络(CNN)和具有能同时考虑前后方向长时间信息的双向长短期记忆(BiLSTM)相结合,将其用于预测更能体现随时空变化不断波动的交通流量。

研究回顾

- 目前已有大量关于交通流量预测的研究成果,早期的方法有传统线性预测法,线性预测方法简单易操作,但不能很好地反映不规律的交通流状态,为适应不断波动的交通流,又出现了传统非线性预测方法。后随着计算机技术的发展以及人们对准确实时交通的掌握,出现了现代智能预测方法,如基于机器学习和深度学习的预测方法。由于单个方法会出现或多或少的缺陷,近些年出现了组合预测方法,该方法是将不同预测方法组合,弥补单个预测方法的缺点,以达到更好的预测效果。

- A估算了无法获得交通数据的交通网络中所有路段的交通流量,但只能预测后短时交通流。

- D将时间序列分析问题转化为图像分析任务,提出的模型具有预测路网不完整流量数据的能力,但这些深层网络具有复杂的架构,且可解释性较弱。

- H分层时间记忆具有作为短期交通流量预测的有效工具潜力,其效果与LSTM相当,且在交通流量分布发生变化时得到改善,但不能很好地从模型输出中检测异常流量,并将其用于推断异常事件的存在。

- C将机器学习算法与统计模型相继连接,通过ARIMA分析对其进行后处理,从而显著提高预测的准确性,局限性在于机器学习算法只考虑了最简单的传统神经网络。

- M等将神经网络和模糊逻辑的互补功能相结合,在短期交通流量预测上取得了令人满意的成绩。

- L等提出了一种基于SAE模型提取交通流抽象和潜在特征的方法,但当交通流量较小时,观察流量与预测流量之间的微小差异会导致较大的相对误差。

程序设计

- 完整程序和数据下载方式1(资源处直接下载):CNN-BiLSTM(卷积双向长短期记忆神经网络)多输入单输出

- 完整程序和数据下载方式2(订阅《CNN-DL卷积深度学习模型》专栏,数据订阅后私信我获取):MATLAB实现CNN-BiLSTM(卷积双向长短期记忆神经网络)多输入单输出

模型结构

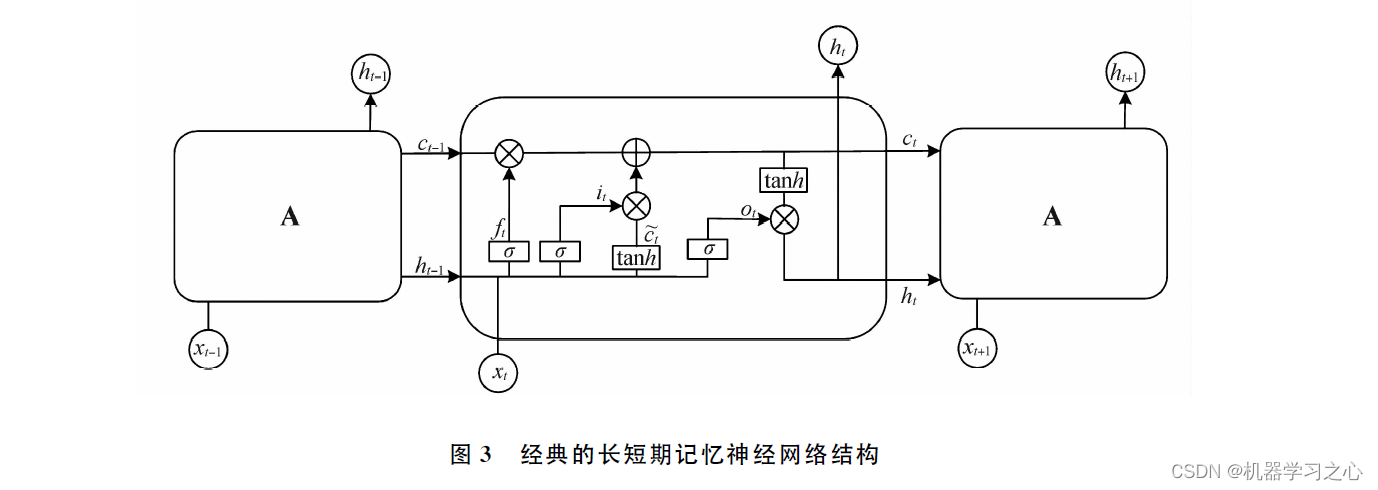

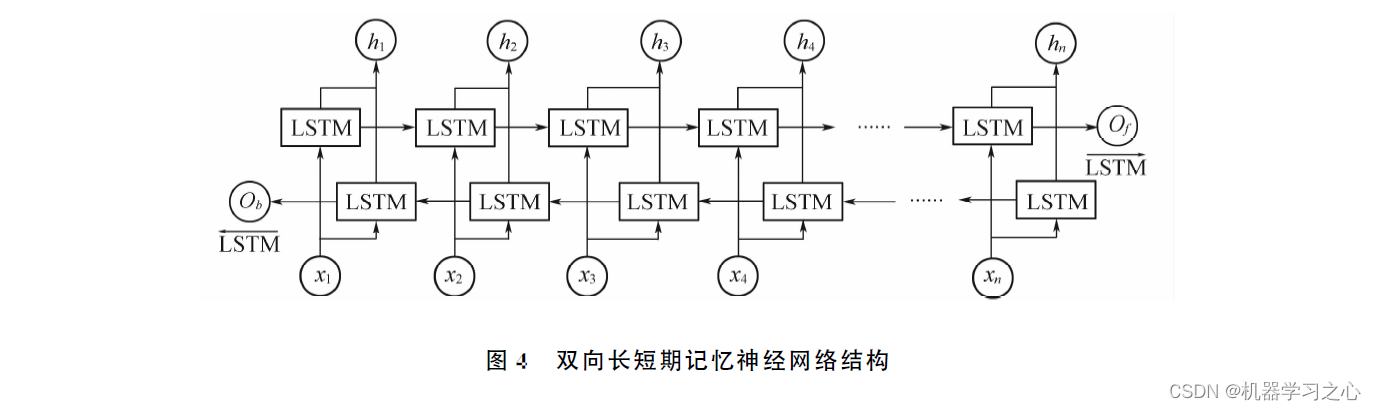

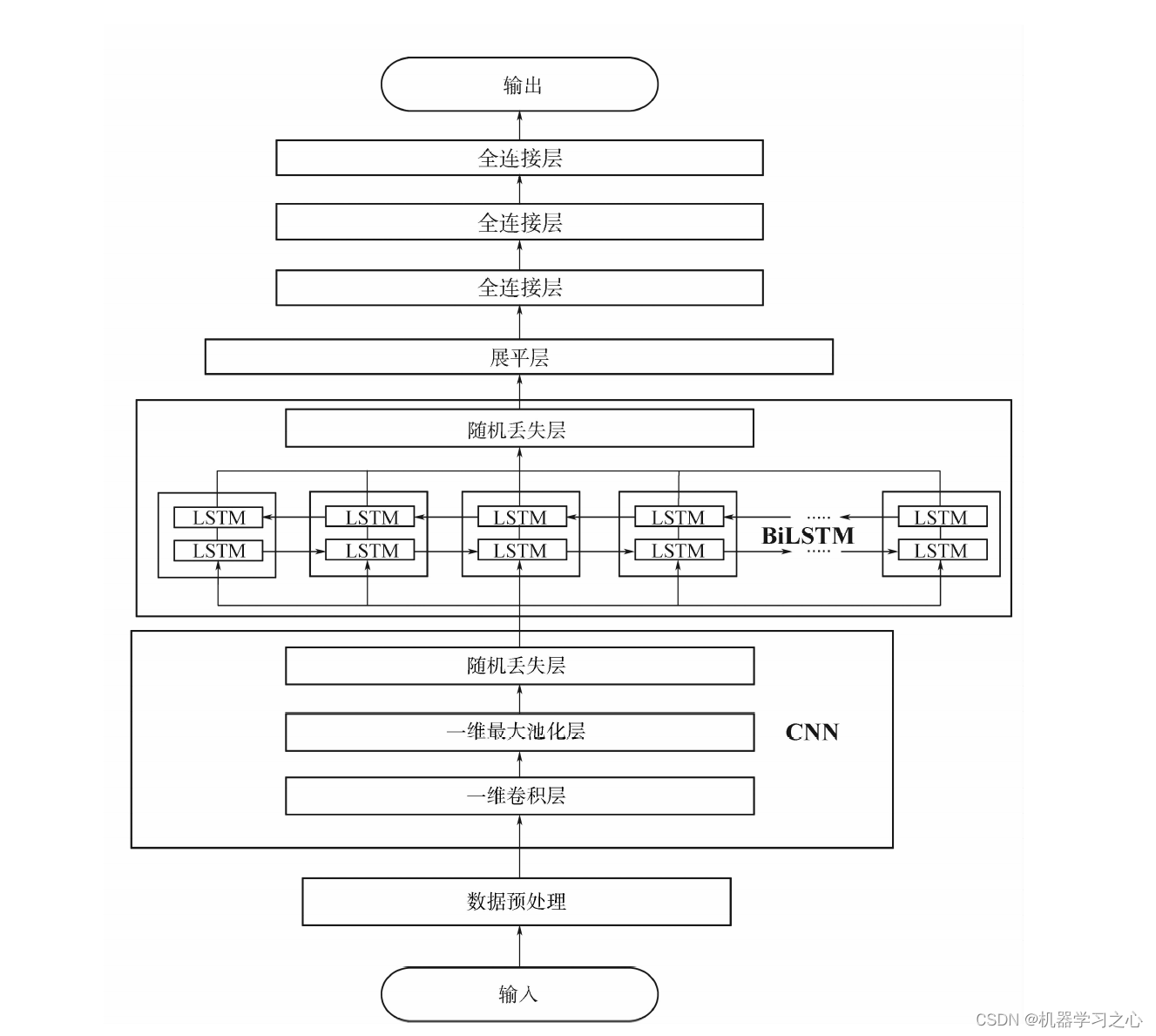

该模型由输入层、CNN层、BiLSTM 层、全连接层和输出层组成,CNN层由卷积层和最大池化层堆叠组成,BiLSTM层由一层BiLSTM堆叠成,分别在CNN层和BiLSTM 层的末尾加上Dropout层随机丢弃节点,以防止过拟合。LSTM模型解决了循环神经网络RNN的长期依赖问题,独特的“门”结构能够避免梯度爆炸和梯度消失,且具有长时记忆能力强的优点。BiLSTM在具备LSTM优势的同时,还能在时间维度上考虑前向和后向的双向时间序列信息,预测更加全面准确。CNN适合提取局部空间特征,BiLSTM兼顾双向时间序列信息结合,可以从时空特性上更周全地分析交通流量数据,使预测结果的拟合度更高。

学习总结

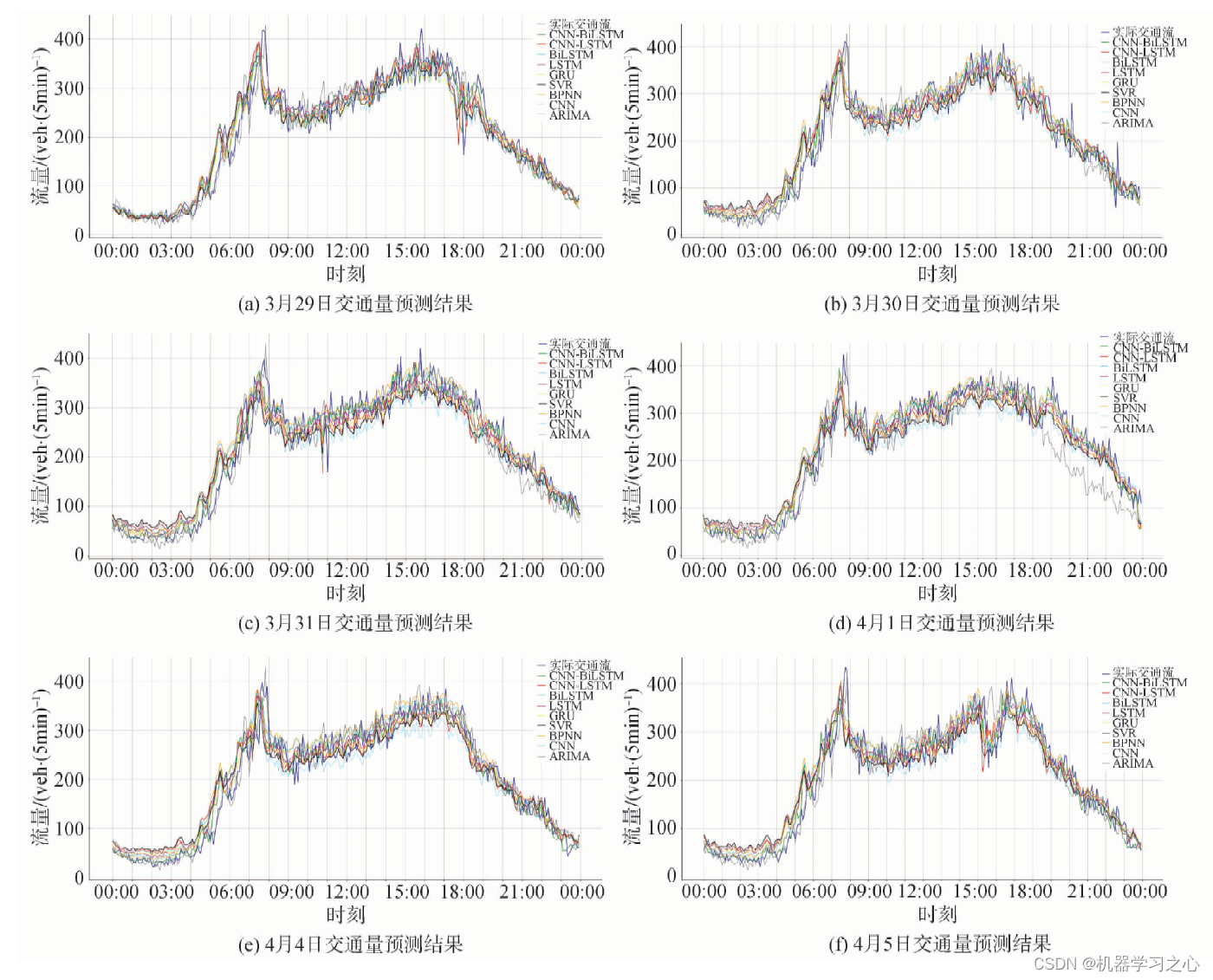

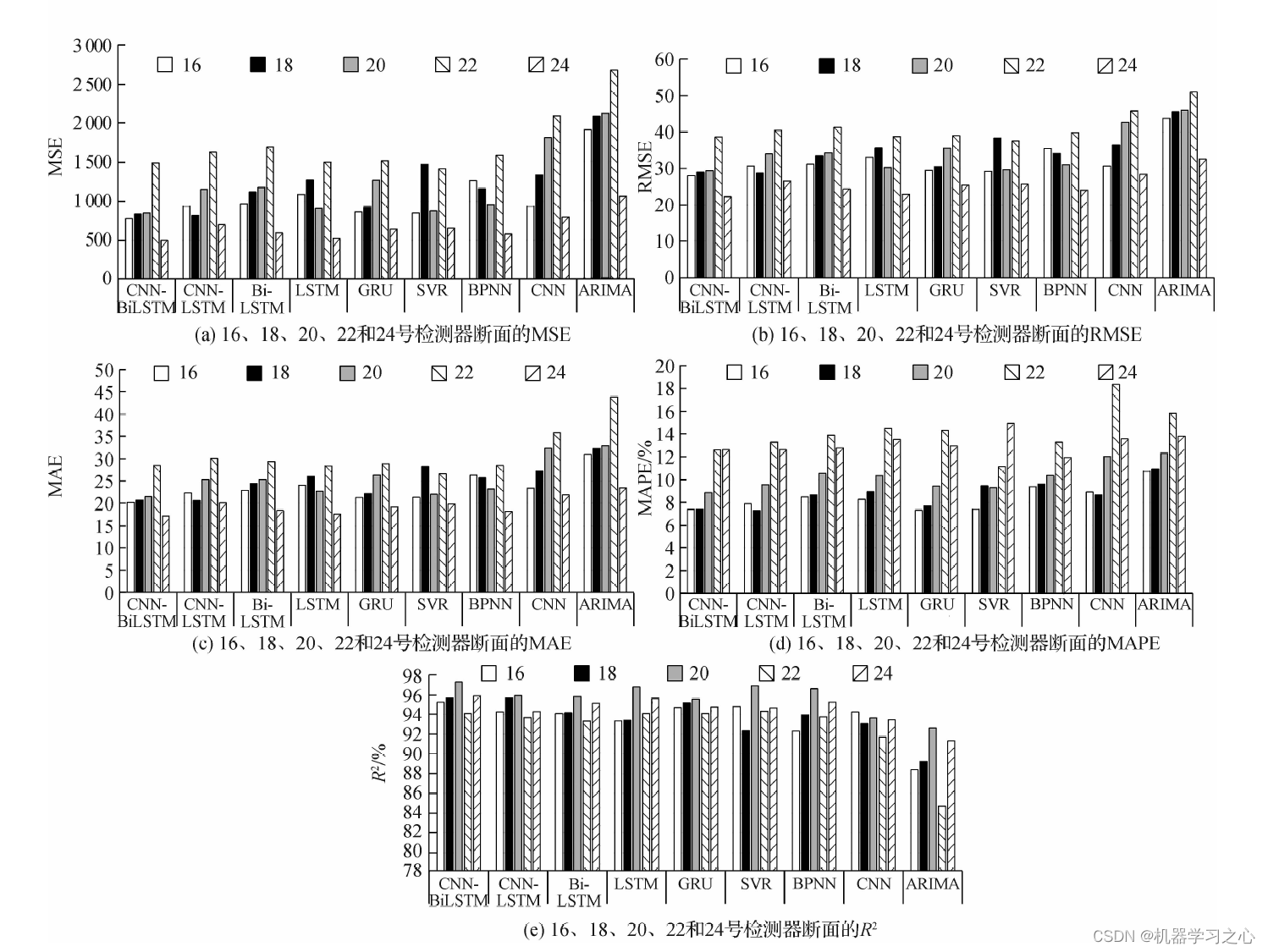

针对交通流量序列存在的时空相关性等特征,文中提出了一种结合CNN与BiLSTM 各自优点的CNN-BiLSTM 模型。CNN-BiLSTM 模型通过CNN和LSTM分别提取空间和时间特征,通过实例验证分析表明:相比于其他基准模型,文中的模型能够较好地适应不断波动的交通流量数据,早高峰和晚高峰预测的稳定性和精度均较高。

参考资料

[1] https://blog.csdn.net/kjm13182345320/article/details/127281969?spm=1001.2014.3001.5502

[2] https://blog.csdn.net/kjm13182345320/article/details/127261869?spm=1001.2014.3001.5502

[3] https://blog.csdn.net/kjm13182345320/article/details/127179100?spm=1001.2014.3001.5502

[4] https://download.csdn.net/download/kjm13182345320/85476987?spm=1001.2014.3001.5503

849

849

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?