Boosting原理

众做周知,boosting就是所谓的有多个弱分类器组成一个强分类器。而什么叫做弱分类学习和什么时候需要使用弱分类学习呢?

弱分类学习

弱分类学习:识别一组概念的正确率仅比随机猜的概率高一点。

同理,当需要分类的训练组具有上述特点时,可以优先考虑使用boosting算法。

Boosting的重要历史事件

- Kearns & Valiant (1984) : Boosting由来

- Kearns & Valiant (1989) : 证明了弱学习器和强学习器的等价问题。

- Schapire (1989) : 第一个提出了一个可证明的多项式事件的Boosting算法。

- Schapire ( 1993) : 第一次把Boosting算法思想用于实际应用(OCR)。

- Freund & Schapire (1995) : AdaBoost算法。

Boosting的原理

为了训练一系列弱分类器h1,h2,..hT,不断的对样本进行分类,每次分类后,主要关注错误的样本,计算本次分类的权重,然后将错误的样本进行下一次的分类器学习,如此类推。

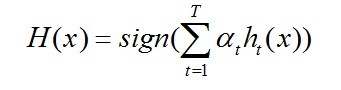

最终将所有弱分类器组合起来:

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

590

590

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?