| 论文 | Research on Student Classroom Behavior Detection Based on the Real-Time Detection Transformer Algorithm |

| 作者 | Lihua Lin , Haodong Yang , Qingchuan Xu , Yanan Xue ,Dan Li |

| 关键字 | artiffcial intelligence; student behavior detection; FSCB-dataset; MobileNetV3; learnedpositional encoding; dynamic upsampling |

| 期刊 | https://doi.org/ 10.3390/app14146153 |

摘要

随着人工智能和大数据技术的快速发展,智能教育系统已成为现代教育技术领域的重点研究热点。本研究旨在利用深度学习技术,准确检测学生在课堂中的行为,从而提升教育系统的智能化水平。我们提出了一种基于改进的RT - DETR(实时检测Transformer )目标检测算法的学生课堂行为检测方法。通过将实际课堂观察数据与人工智能生成的数据相结合,我们创建了一个全面而多样化的学生行为数据集(fscb数据集)。该数据集不仅更真实地模拟了课堂环境,而且有效地解决了数据集的稀缺性,降低了数据集构建的成本。该研究将MobileNetV3作为轻量级骨干网络引入,将模型参数减少到原始的十分之一,同时保持几乎相同的精度。此外,通过结合可学习的位置编码和动态上采样技术,该模型显著提高了识别小物体和复杂场景的能力。在fscb数据集上的测试结果表明,改进后的模型在实时性和计算效率方面都有显著提高。该轻量级网络也易于在移动设备上部署,证明了其在资源受限环境中的实用性。

1.引言/简介

随着人工智能和大数据的快速发展,新兴技术已经成为推动教育创新发展的核心力量。这些技术被广泛应用于辅助教学[1,2]、管理课堂、分析学生行为等。例如,像“雨课堂” 小程序这样的应用程序使考勤和提问更加方便,而先进的监控技术简化了课堂管理,并为教学评估提供了准确的数据。尤其是学生行为检测技术,通过深度学习模型,为理解课堂上的学生表现和教学质量提供了新的视角。尽管在大学环境中数据收集和技术应用方面存在挑战,但本研究在提高教育管理效率和教学质量方面具有巨大潜力和重要价值。未来该领域的研究有望将教育质量提升到新的水平[3,4]。

计算机视觉领域中物体检测技术的快速发展引起了学术界的广泛关注,尤其是基于深度学习的方法。这些方法大致可以分为三种类型:两阶段算法、单阶段算法和最近出现的基于transformer的算法。自从引入了带有ReLU激活函数和Dropout技术的AlexNet网络以来,深度学习在图像识别精度方面取得了重大进展,标志着该领域取得了重大突破。随后, OverFeat算法展示了卷积网络在物体检测方面的潜力。R-CNN[6]及其衍生算法Fast RCNN[7]和Faster R-CNN[8]的出现,通过将卷积神经网络与区域提议技术相结合,显著提高了目标检测的精度和速度,凸显了深度学习在目标检测中的应用。随后,Mask RCNN[9]、Cascade R-CNN[10]、Libra R-CNN[11]等算法进一步提高了实例分割精度和处理复杂场景的能力。在单阶段算法领域,YOLO序列[12-16]将检测任务转化为回归问题,实现了快速高效的目标检测。SSD[17]、RetinaNet[18]和EfficientDet[19]等算法采用了各种策略来提高检测性能,特别是在处理小对象和类不平衡问题方面。近年来, 基于transformer的目标检测算法,如DETR[20]及其改进版本,变形DETR[21]和条件 DETR[22],通过简化检测过程和优化训练效率,在处理全局信息和复杂场景方面表现 出强大的能力。特别是针对实时目标检测而设计的RT-DETR[23],通过优化计算复杂度和推理速度,提高了精度和速度的性能,非常适合复杂场景下学生课堂行为的检测。

近年来,学生课堂行为检测成为研究热点,主要集中在三种基于深度学习的方法上:传感器分析、骨架关键点检测、卷积网络检测。例如,传感器方法使用Kinect One 捕获2D和3D数据,并通过机器学习技术[24]评估学生的注意力。骨架关键点检测通过跟踪学生骨骼点的变化来识别特定行为,例如OpenPose模型识别举手行为[25-27]。卷积网络检测方法,如YOLO,通过算法增强提高了行为识别的准确性和速度[28-31]。 尽管在学生课堂行为检测方面取得了进展,但该领域仍然面临着多重挑战,如算法过时、检测效率不足、缺乏多样化的公共数据集等。学生行为的复杂性、不规则的座位安排、小物体识别困难以及照明和背景的变化等问题都需要解决。此外,现有的 研究往往无法涵盖不同年级和场景的学生行为,限制了模型的泛化和实际适用性。鉴于这些挑战,本研究提出使用RT-DETR算法进行学生课堂行为检测和分析。该算法旨在通过优化计算复杂度和推理速度来实现高效准确的目标检测,特别适合于复杂场景中的应用。

2.数据集

2.1.构建融合学生课堂行为数据集

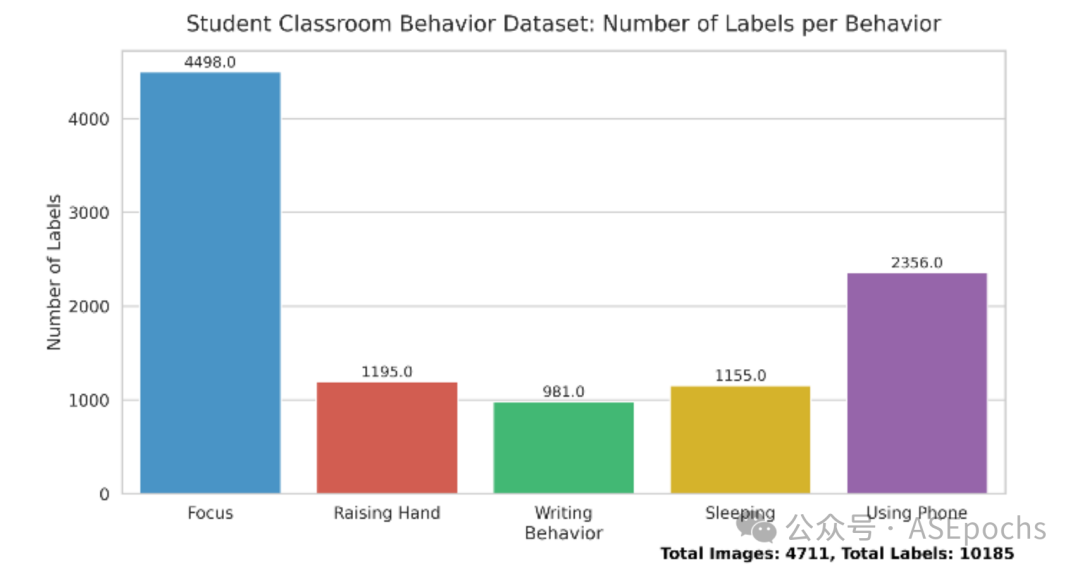

为了解决现有学生行为检测数据集在奇点和稀缺性方面的局限性,本研究提出了一种创新的数据构建策略——融合数据集方法(FSCB数据集)。通过将人工智能生成的 数据与实际学生课堂行为观察数据相结合,FSCB数据集使数据源多样化。这种方法类似于Shvetsova等人在产品设计概念选择中应用的质量功能部署(Quality Function Deployment)方法,有效地丰富了数据资源,为进一步的行为分析和教育干预[32]提供了强有力的支持。FSCB数据集包括4711张图像和10185个学生行为标签,包括集中注意力、举手、写作、睡觉和使用手机等行为。图1说明了FSCB数据集的具体内容和结构,突出了其在捕获和标记不同课堂行为方面的广泛范围和细节。这一融合数据集丰富了学生行为检测的数据资源,为进一步的行为分析和教育干预提供了强有力的支持。

这篇论文用的是有监督学习的图像识别方法。

这里提到的数据集创新融合方法是使用AI技术生成一部分学生的行为数据,再融合一部分实时观测的数据,这种数据集的应用算是这篇论文的一个创新点。FSCB数据集(融合数据集方法)可以被视为该论文的一个创新点。以下是几个理由:

数据集的多样性:FSCB数据集通过结合人工智能生成的数据和实际学生课堂行为观察数据,提供了多样化的数据源,这有助于提高数据集的代表性和可靠性。

数据集的规模:FSCB数据集包含大量的图像和行为标签,这为研究提供了丰富的数据资源,有利于进行更深入的行为分析。

数据集的详细程度:FSCB数据集能够捕获和标记多种不同的课堂行为,这表明数据集在细节上的丰富性,有助于更精确地分析学生行为。

方法的创新性:FSCB数据集的构建方法类似于质量功能部署(Quality Function Deployment, QFD)方法,这是一种在产品设计中常用的方法,将其应用于学生行为检测数据集的构建中,显示了方法论的创新。

对教育干预的支持:FSCB数据集为教育干预提供了强有力的支持,这可能意味着它能够对教育实践产生积极影响,这是研究的一个重要贡献。

Figure 1. Dataset distribution.

2.2.图像生成

在构建这个融合数据集的过程中,我们利用了尖端的文本到图像生成技术,特别是Stable Diffusion[33]和DALL-E 3[34]模型,来创建与实际学生行为数据密切匹配的模拟图像。这种方法不仅显著扩展了数据集的规模,还增强了数据集的多样性和覆盖范围。通过利用这些先进的图像生成技术,我们能够生成高度逼真的图像,准确地反映学生的行为模式和课堂环境。

尖端的文本到图像生成技术,特别是Stable Diffusion和DALL-E 3模型,是两种基于深度学习的先进模型,它们能够根据文本描述生成高质量的图像。以下是这两种技术的简要介绍:

Stable Diffusion(稳定扩散模型):

Stable Diffusion是一种潜在扩散模型(Latent Diffusion Model),能够从文本描述中生成详细的图像。它由三个主要部分组成:变分自编码器(VAE)、U-Net和一个文本编码器。在前向扩散过程中,高斯噪声被迭代地应用于压缩的潜在表征,每个去噪步骤都由U-Net架构完成,最终VAE解码器将表征转换回像素空间以生成输出图像。此外,Stable Diffusion的应用不局限于图像生成领域,它还被广泛应用于自然语言处理、音频视频等生成领域。DALL-E 3:

DALL-E 3是由OpenAI开发的突破性生成式AI工具,它能够根据文本提示生成真实且细腻的图像。DALL-E 3直接构建在ChatGPT语言模型架构之上,这种无缝集成允许用户利用ChatGPT生成DALL-E 3的提示,同时在生成多个图像时能够保持上下文的一致性。DALL-E 3的技术架构包含Transformer结构,作为GPT-3的核心技术,transformer结构在DALL·E 3中负责处理文本数据,确保了模型能够有效捕捉长距离的依赖关系。DALL-E 3在技术上实现了飞跃,它基于复杂的深度神经网络构建,这种网络能够理解和转化自然语言描述到视觉图像。该过程涉及文本理解、图像生成、优化与反馈等关键步骤DALL-E 3还采用了多项安全措施来防止生成有害内容,并为创作者提供对其艺术作品使用的控制。

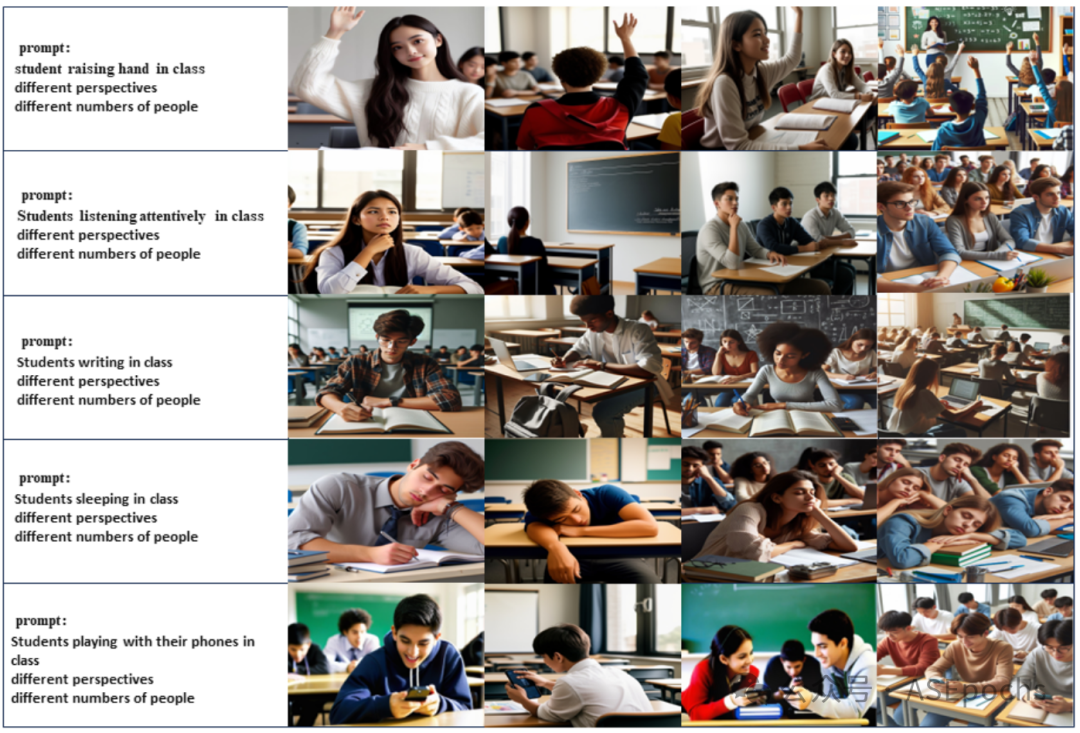

具体来说,Stable Diffusion和DALL-E 3模型通过先进的深度学习算法,生成了具有高度真实感的图像,描绘了课堂上的各种行为,如集中注意力、举手、写字、睡觉、 使用手机等。图2展示了这些生成图像的多样性和细节水平,展示了模型在不同场景 下准确再现学生行为的能力。

Figure 2. AI-Generated data.

这些模拟图像为研究提供了丰富的数据基础,极大地增强了数据集的深度和广度。这不仅有助于提高学生行为检测的准确性和效率,也为进一步的研究提供了有力的支持行为分析与教育干预。有了这种丰富的数据资源,我们可以更全面地了解和分析课堂上的学生行为模式,从而为改进教学方法、提升教育质量提供数据支持。

2.3.融合数据集的概括性分析

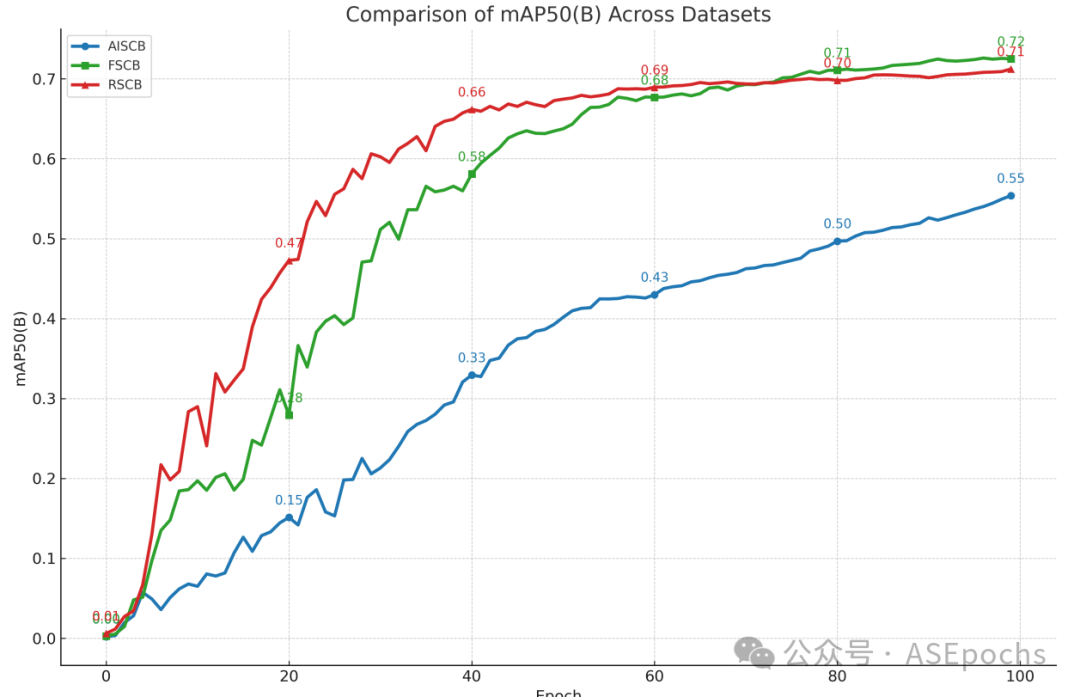

为了进一步增强数据集的实用性和应用范围,我们对三个不同的数据集进行了全面的对比分析:包含1200张纯实时捕获图像(RSCB)的数据集,包含1200张完全人工智能 生成图像(AISCB)的数据集,以及包含1200张人工智能生成图像和真实图像相结合的图像的融合数据集(FSCB)。每个数据集包括五种不同的学生行为,每种行为有300张图像。

如图3所示,实验结果表明,融合数据集显示出与纯实时捕获数据集相似的准确性 和可靠性。这一发现凸显了融合数据集在学生课堂行为检测中的高适用性,表明将人工智能生成的图像与真实图像相结合可以有效增强数据集的多样性和覆盖范围。

Figure 3. Dataset comparison experiment chart.

此外,融合数据集为数据集稀缺性、学生隐私保护、数据集快速构建等挑战提供了有效解决方案。传统的实景采集图像数据集往往受到数据采集成本高、采集时间长 以及隐私问题的限制。通过合并人工智能生成的图像,我们可以快速扩展数据集的规模,同时提供丰富的训练数据,而不会侵犯学生的隐私。

此外,融合数据集的高准确性和可靠性为后续的行为分析和教育干预奠定了坚实的基础。利用这样的多源数据集,使研究人员能够更全面地了解和分析课堂上的学生行为模式,从而为改进教学方法和提高教育质量提供关键的数据支持。这种创新的数据集构建方法展示了AI技术在教育领域的巨大潜力,为未来的教育技术研究和应用铺 平了道路。

3.方法

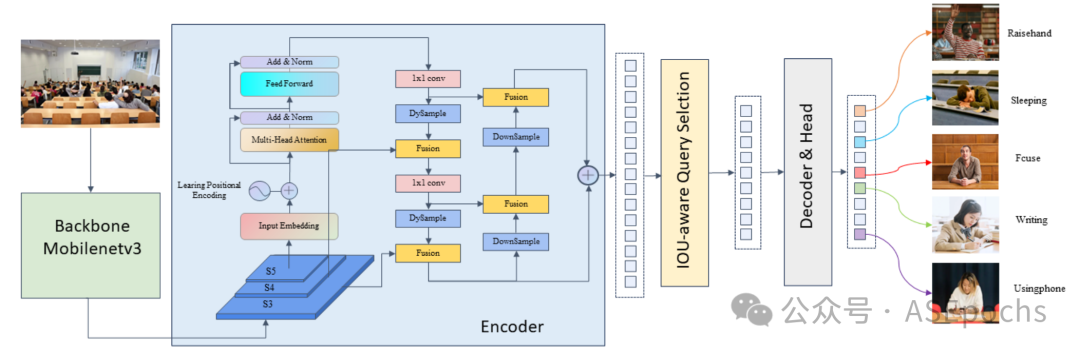

如图4所示,将FSCB数据集输入RT - DETR算法,RT - DETR算法对数据进行多步处理,以准确识别学生行为。首先,该算法使用骨干网络提取基础图像中的特征,确保有效捕获关键信息。接下来,编码器利用自关注机制和特征融合对提取的特征进行处理,增强特征表征的丰富性和多样性。最后,解码器通过对象查询合并和解释所有信息,实现图像中对象的准确定位和分类。通过这一系列的处理步骤,RT DETR算法可以准确识别学生在课堂上的五种行为,包括集中注意力、举手、 写作、睡觉和使用手机。

Figure 4. Flowchart of the improved RT DETE algorithm.

3.1.RT DETR算法的结构

RT DETR是一种实时目标检测模型,它结合了Transformer[35]和DETR [20] (detection Transformer)两种经典目标检测方法。Transformer是一种用于序列建模的神经网络架构,最初应用于自然语言处理,但在计算机视觉中被证明是有效的。DETR是一个端到端的对象检测模型,它将对象检测任务转换为对象查询问题,并使用Transformer来解决该问题。RT DETR采用DETR结构,并对其进行优化,实现实时目标检测。它由三个主要部分组成:主干、编码器和解码器。骨干网采用CNN网络提取图像特征。CNN网络强大的特征提取能力被广泛应用于图像处理任务中,为后续的目标检测任务提供必要的图像表示。基于Transformer结构的编码器处理主干输出的特征映射,并通过自关注机制捕获图像中的全局依赖项。与传统的DETR模型相比,RT DETR优化了编码器的设计,降低了计算复杂度,提高了处理速度。这些优化包括减少自注意层的数量和使用更高效的注意力计算方法,旨在保持高精度的同时实现快速推理。**编码器中的每个自注意层包括三个主要组成部分:多头自注意、前馈网络和层归一化的剩余连接。**这种设计使模型能够有效地捕捉图像内的远距离依赖关系,增强对复杂场景的理解。解码器组件接收编码器的输出和预定义的对象查询,通过交叉注意层和自注意层将它们结合起来,逐步改进对每个对象的位置和类别的预测。模型末端的预测头根据解码器的输出执行对象分类和边界盒回归。这些预测头简单高效,旨在快速生成准确的检测结果。分类头通常使用线性层,而边界盒回归头可能包含更复杂的网络结构, 以准确预测物体位置。

端到端的对象检测模型指的是一个完整的系统,它能够直接从输入的图像数据中自动学习特征并检测出图像中的对象,而不需要任何手动设计的特征提取步骤或中间的人工干预。 这种模型通常包括数据预处理、特征提取、对象定位和分类等步骤,所有这些步骤都在一个统一的框架内通过深度学习技术实现,并且可以通过反向传播算法进行联合优化。

端到端的对象检测模型的主要优点包括:

1.自动化特征学习:模型能够自动从数据中学习到有用的特征,而不需要人工设计特征提取器。

2.联合优化:模型中的所有组件(如特征提取网络、区域提议网络、分类器等)可以一起训练,以优化整个检测流程。

3.灵活性:模型可以适应不同的数据集和检测任务,而不需要对每个任务重新设计流程。端到端的对象检测模型中,常见的模型包括以下几种:

DETR(End-to-End Object Detection with Transformers):DETR模型引入了Transformer架构,并采用匈牙利损失(Hungarian loss)来实现一对一的匹配预测,从而消除了手工制作的组件和后处理步骤。

YOLO系列:YOLO(You Only Look Once)系列以其高速图像处理和实时能力而闻名。YOLOv4-v8版本在研究中被使用,每个后续版本都在准确性和对不同光照条件及噪声的鲁棒性方面进行了改进。

Faster R-CNN:Faster R-CNN因其在对象检测任务中的高准确性而被选中。该模型的主要优势在于使用区域提议网络(Region Proposal Network, RPN),显著加快了对象检测过程。

SSD(Single Shot MultiBox Detector):SSD因其专注于高速图像处理而被选中。该模型使用多个特征图来检测不同尺寸的对象,以实现高准确度和低延迟。

EfficientDet:EfficientDet是一个高效且准确的对象检测模型,它通过复合缩放方法在模型的宽度、深度和分辨率上进行缩放。

Deformable DETR:Deformable DETR利用多尺度可变形注意力模块来加速收敛速度。

DINO(DETR with Improved Denoising Anchor Boxes):DINO集成了对比去噪、混合查询选择和前瞻两次方案到DETRs中。

RT-DETR:RT-DETR进一步设计了高效的混合编码器,并提出了不确定性最小的查询选择,以提高准确性和延迟。

3.2. RT DETR算法的改进

本研究旨在通过对RT DETR模型进行多方面的增强,提高学生课堂行为识别的准确性和效率。首先,引入轻量级骨干网络MobileNetV3,减少模型参数数量和计算复杂度;其次,采用了学习位置编码(LPE)改进AIFI中的位置编码机制,增强模型在训练数据中学习位置关系的能力。最后, 将DySample的超轻和高效特性集成到CCFM上采样模块中,进一步提高RT DETR的性能。

这里对RT-DETR的改进就是本论文模型的创新点,以下是三个创新点的具体解释和分析:

1.引入轻量级骨干网络MobileNetV3:

创新点:为了减少模型参数数量和计算复杂度,论文引入了轻量级骨干网络MobileNetV3。具体做法:使用MobileNetV3作为模型的骨干网络,以降低模型的计算负担,同时保持检测性能。创新之处:MobileNetV3通过NAS(网络架构搜索)技术优化,集成了深度可分离卷积和SE通道注意力机制,提高了模型的效率和准确性。

2.采用学习位置编码(LPE)改进AIFI中的位置编码机制:

创新点:论文采用了学习位置编码(LPE)来改进AIFI(尺度内特征交互)中的位置编码机制,增强模型在训练数据中学习位置关系的能力。具体做法:通过动态生成的位置编码,模型能够更好地适应输入序列长度的变化,处理更高分辨率的图像,同时保持平移不变性。创新之处:LPE能够根据输入token的局部邻域为条件生成对应的位置编码,这有助于提高图像分类的性能,并使模型能够处理比训练时更长的序列。

这个改进是在编码器中实现的,因为位置编码通常是在Transformer架构的编码器部分使用的,用于提供序列中各个元素的位置信息。通过改进位置编码机制,模型能够更准确地捕捉和利用这些位置信息,从而提高对图像中对象位置的识别能力。这种改进对于对象检测模型来说是非常重要的,因为它直接影响到模型对图像中对象位置的预测准确性。

3.将DySample的超轻和高效特性集成到CCFM上采样模块中:

创新点:为了进一步提高RT DETR的性能,论文将DySample的超轻和高效特性集成到了CCFM(跨尺度特征融合模块)上采样模块中。具体做法:DySample是一种动态上采样方法,它通过学习采样点的位置,结合动态上采样,避免了动态卷积带来的复杂计算。DySample的核心思想是将上采样过程重新定义为点采样,通过学习输入特征图中的采样点坐标,生成内容感知的采样点来对特征图进行重新采样。创新之处:DySample不需要高分辨率的特征图作为引导,也不需要额外的CUDA包,具有更低的推理延迟、内存占用、浮点运算次数和参数数量。DySample在多个密集预测任务中表现优于其他上采样器,且其推理时间接近双线性插值。

第三个创新点的改进是在解码器的上采样模块中,通过集成DySample,提高了RT DETR模型的性能,特别是在解码器阶段的特征图上采样过程中。这种改进使得模型在保持高效率的同时,也能获得更好的性能。

3.2.1. 改进RT DETR算法的主干

MobileNet系列旨在解决传统卷积神经网络在移动和嵌入式设备上运行时需要过多内存和计算资源的问题。 2017年,MobileNet作为专为移动和嵌入式设备设计的轻量级CNN网络出现,旨在显着减少模型参数的数量和计算负载,同时最小化准确性的牺牲。通过引入最新的MobileNetV3,我们进一步提高了RT DETR模型骨干部分的效率和性能平衡。MobileNetV3建立在MobileNetV2和MobileNetV1的基础上,继承和增强了它们的优势,优化了模型,在快速处理和低资源消耗方面树立了新的标准。这一进步意味着更高效的模型可以更好地服务于实际应用场景,满足日益增长的移动计算需求[36-38]。

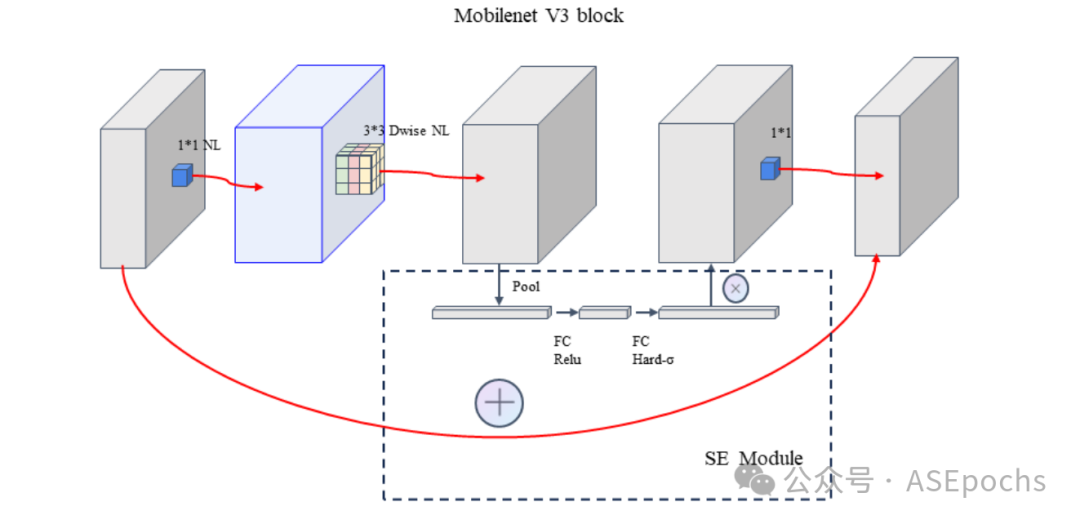

MobileNetV3的设计改进体现在瓶颈块的创新上。

1.这些瓶颈块现在嵌入了一个轻量级的注意力机制,称为挤压-激励(Squeeze-and-Excitation,SE)模块。这种机制通过精确校准每个特征通道的重要性来增强网络对关键信息的响应,同时自然地抑制不太重要的信息,从而在保持模型轻量级的同时提高准确性。

2.瓶颈块的更新还包括混合深度可分离卷积策略,该策略巧妙地结合了不同大小的卷积核。这不仅有效地捕获了图像中的多尺度信息,还优化了计算效率。图5显示了改进的瓶颈块的结构细节,揭示了其在执行多尺度特征提取方面的卓越性能。

如何进行优化的:

- Squeeze-and-Excitation (SE) 模块:

优化位置:瓶颈块内。

优化方法:通过引入SE模块,该模块利用全局平均池化(Squeeze操作)来聚合空间信息,并通过两个全连接层(Excitation操作)来学习通道间的依赖关系,从而对特征通道的重要性进行加权,增强模型对有用特征的关注。

- 混合深度可分离卷积策略:

优化位置:瓶颈块内。

优化方法:通过MixConv(混合深度可分离卷积),将不同大小的卷积核混合在单一的卷积操作中,这样可以更容易地捕获不同分辨率的模式,提高模型的准确性和效率。

Figure 5.CompactFusion block

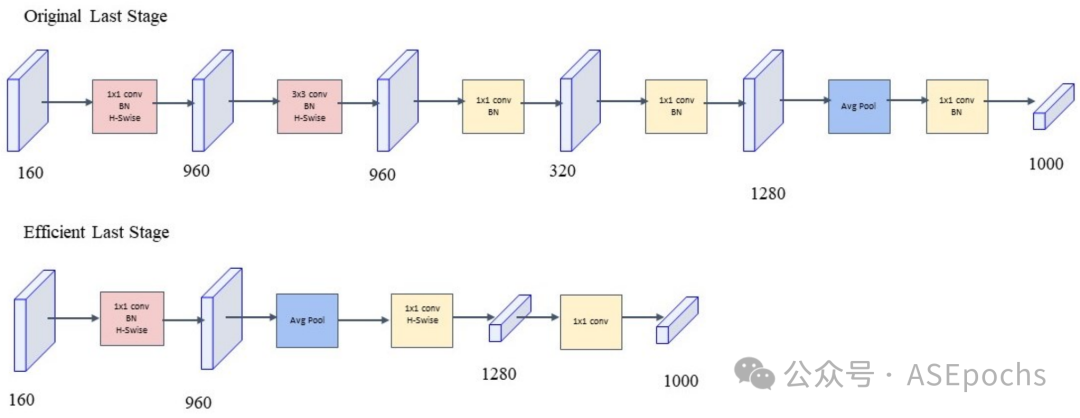

MobileNetV3重建和优化模型中计算最密集的层,以降低其计算成本,同时保持或提高模型精度。这包括优化模型的第一层和最后一层,这通常是许多深度学习架构中计算成本最高的部分。MobileNetV3的具体设计,如调整卷积核的大小、步幅和过滤器数量,旨在减少这些层的计算负担。图6展示了时间效率层的流线型设计。

MobileNetV3专注于优化模型中计算成本最高的层,以减少整体的计算需求。这通常涉及到模型的第一层(输入层)和最后一层(输出层),因为它们往往需要处理大量的数据,导致计算成本较高。

Figure 6.Streamlined Design of time-effcient layers

优化解释:计算量减少:通过在特征图通道数较高时引入平均池化层,减少了后续卷积层的计算量。参数减少:优化后的设计中,卷积层的数量减少,从而减少了模型参数。保持性能:尽管计算量和参数减少,但通过精心设计的卷积层和池化层,模型的准确性得以保持。

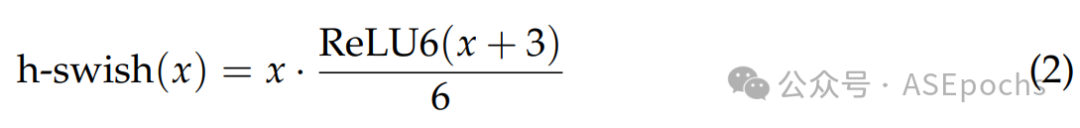

在MobileNetV3的设计中,研究人员重新设计了激活函数,以适应移动设备的计算限制,同时提高了性能,使用h-swish代替了swish函数。作为ReLU的替代方案,swish非 线性激活函数显著提高了神经网络的精度。它的定义如下:

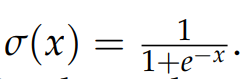

其中x为输入,σ(x)为输入x的sigmoid函数,定义为 。swish函数通过将 sigmoid函数乘以x来增加非线性,从而增强模型的表达能力。

。swish函数通过将 sigmoid函数乘以x来增加非线性,从而增强模型的表达能力。

虽然这种非线性提高了精度,但swish复杂的导数计算对量化过程并不友好。改进后 的h-swish函数定义如下:

其中,ReLU6(x)是分段线性函数,定义为ReLU6(x) = min(max(0, x), 6)。h-swish函数可 以实现为分段函数,减少内存访问,从而显著降低延迟成本。

将RT DETR模型的主干从ResNet替换为MobileNetV3可以显着将模型的计算负荷减少到原来的十分之一。同时,这种替换对检测精度的影响可以忽略不计,几乎不会降低模型的性能。

这里的优化把swish的式子简单化,减少了计算的复杂度。

3.2.2. 改进RT DETR算法AIFI模块中的位置编码

为了增强模型的位置信息编码能力,本研究采用学习位置编码(LPE)改进AIFI(尺度内特征交互)中的位置编码机制。在基于变压器的模型中,位置编码是维持序列数据顺序信息的重要机制。

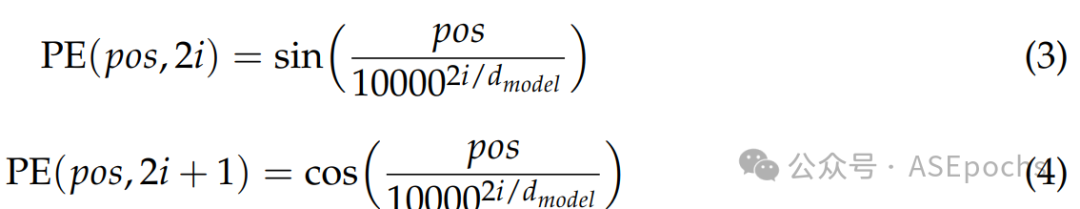

传统的固定位置编码采用固定位置编码(FPE),由公式(3)和式(4)计算得出:

其中dmodel为模型的维数,pos为位置,I为维数。这样,每个位置的位置编码是一个固定的向量,不随模型训练而改变。

与固定位置编码相比,学习位置编码(LPE)为位置信息的编码提供了一种更加灵活的方法。在这种机制中,posiTional编码是模型参数的一部分,是通过模型训练过程习得的,而不是预定义的。具体来说,每个位置编码在模型训练开始时随机初始化,并在训练过程中通过反向传播和梯度下降等优化算法进行调整。

位置信息在最开始是随机定义一个数,之后再经过梯度下降等算法,取得一个最优位置解,这个过程就是学习位置编码得到的过程。

在模型训练过程中获得学习位置编码(LPE),其中每个位置编码是模型参数的一部分,可以根据任务和数据进行动态调整。从根本上说,LPE增加了模型在编码位置信息方面的灵活性和适应性,使模型能够更好地捕获和利用序列数据中的位置信息。这可以提高性能,特别是在序列的结构或模式不是很规则的任务中,或者模型需要对位置信息有更细粒度的理解。

3.2.3. 改进RT DETR算法CCFM模块的上采样

在RT DETR算法中,CCFM(跨尺度特征融合模块)上采样模块起着至关重要的作用,它有效地恢复了特征图的空间分辨率,显著提高了目标检测任务的精度。该模块的上采样过程保证了低分辨率和高分辨率特征图在空间维度上的一致性,促进了多尺度特征的有效融合。

DySample代表了动态上采样技术的重大进步。通过避免动态卷积的复杂性,采用点采样策略,实现了高效的资源利用。与传统的动态上采样技术相比,该方法大大降低了计算负担,同时在目标检测任务中表现出更好的性能。其数学表示可以概括为以下几个步骤:

-

特征图表示:设输入的低分辨率特征为Flow∈RH×W×C,其中H、W、C分别表示高 度、宽度和通道。

-

采样点生成:DySample中的采样点生成器根据输入流动态选择采样点。设生成的采样点集合为S = {(xi, yi)}iN=1,其中N为采样点的个数,(xi, yi)为第i个采样点的坐标。

-

上采样操作:通过采样点S和相应的双线性插值等插值算法,从Flow中生成高分辨率特 征图Fhigh∈RH ′×W ′×C,其中H '和W '为目标高分辨率维度。

DySample的上采样技术显著提高了计算效率,并通过精细的采样点选择优化了高 分辨率特征图的恢复,有效提高了目标检测精度。此外,DySample技术不依赖于特定 的硬件加速,增加了其在学生课堂场景中的实用性和灵活性。

3.3. 实验环境配置、训练设置和数据增强

3.3.1. 实验环境配置

训练RT DETR模型的实验环境配置如下:操作系统为Ubuntu 20.04,编程语言为 Python 3.8,使用的深度学习框架为PyTorch 1.10.0, CUDA版本为11.3。硬件设置包括具 有24 GB内存的NVIDIA RTX 3090 GPU,具有12核@ 2.10 GHz的Intel Xeon® Platinum 8352V CPU和90 GB RAM。

3.3.2. Training Setup

学习率:初始学习率(lr0)设置为0.0001。在前2000次迭代中,它从0.1逐渐降低到0. 0001,以确保训练的稳定性。在这个热身阶段之后,学习率保持在0.0001不变,有利于稳定有效地学习数据特征。

优化器:使用Adam优化器,初始参数设置为:B1 = 0.9, B2 = 0.999, E = 1 ×10−8。选择 Adam是因为它在处理稀疏梯度和大型数据集方面表现出色

Batch size:训练时使用的Batch size为8。这个设置确保了高效的GPU内存利用率,同 时也有助于模型权重的稳定更新。

epoch数:模型在训练集上进行了总共100个epoch的训练。提前停止是通过监控验证集 上的性能来实现的,以防止过拟合。

损失函数:RT DETR模型的损失函数由几个关键组件组成,以优化检测性能。主要成 分包括盒回归损失(box loss,权重7.5),它使用均方误差(MSE)或交集比联合(IoU)损失来 衡量预测和真实边界盒之间的差异;分类损失(classification loss,权重0.5),它使用交叉熵损失来评估预测类概率的准确性;以及客观性损失(objectness loss, weight 1.0),它使用二元 交叉熵损失来评估预测的边界框的置信度。此外,还引入了分布焦点损失(distributed Focal Loss, DFL, weight 1.5)来提高边界盒预测的准确性。

3.3.3. Data Augmentation Techniques

在这项研究中,我们采用了各种数据增强技术来增强模型的泛化和鲁棒性。这些技 术包括HSV色彩空间增强(色调、饱和度和亮度的随机调整)、几何转换(旋转、平移、缩 放、剪切和透视转换)、翻转(水平和垂直翻转)以及复合增强技术(Mosaic和Mixup)。具体 参数设置如下:色调调整范围为0.015,饱和度调整范围为0.7,亮度调整范围为0.4;对于几 何变换,平移范围为±0.1,缩放范围为±0.5;水平翻转的概率为0.5。这些数据增强技术 在训练过程中生成了更加多样化的训练样本,从而显著提高了模型在实际应用中的性能。

4.实验与分析

4.1. scb - datasets - s上算法的比较实验

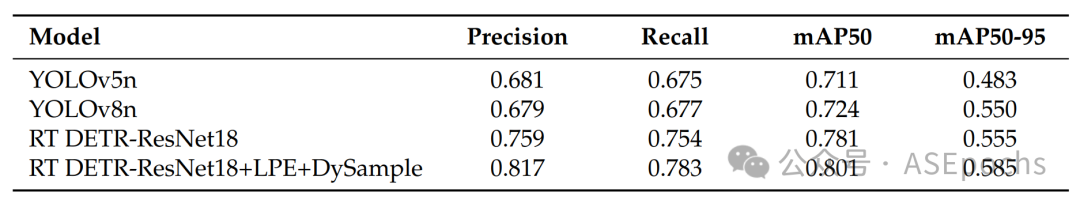

表1给出了不同算法在scb - datasets - s上的比较结果。scb - datasets - s是一个公开的真实学生课堂行为数据集,共包含5010张图片,并附有三种行为的注释:举手、阅读和写作。具体来说,该数据集包括10078个举手标签、5882个阅读标签和2539个写作标签。评估的 模 型 包 括 YOLOv5n、YOLOv8n、RT DETR-ResNet18 和 RT DETR-ResNet18+LPE+ dyssample。他们的表现是用四个标准的目标检测指标来评估的:精度、召回率、mAP50和 mAP50-95。结果如下:

Table 1. Comparison of algorithms on the SCB-Dataset-S.

四个判断标准的含义如下:

- 精确度(Precision):

- 精确度是指在所有被模型预测为正类别(即检测为对象)的样本中,真正为正类别的比例。计算公式为:精确度 = 真正例(TP)/ (真正例(TP)+ 假正例(FP))。高精确度意味着较少的误报。

- 召回率(Recall):

- 召回率是指在所有实际为正类别的样本中,被模型正确预测为正类别的比例。计算公式为:召回率 = 真正例(TP)/ (真正例(TP)+ 假负例(FN))。高召回率意味着较少的漏报。

- mAP50(mean Average Precision at IoU=0.5):

- mAP50 是在交并比(Intersection over Union, IoU)阈值为0.5时,所有类别的平均精确度的平均值。IoU 是衡量预测边界框与真实边界框重叠程度的指标,mAP50 评估了模型在不同类别上的性能。

- mAP50-95(mean Average Precision at IoU=0.5:0.95):

- **mAP50-95 是在IoU阈值从0.5到0.95(通常以0.05为步长)的范围内,计算每个IoU阈值下的平均精确度,然后取这些平均精确度的平均值。**这个指标更严格,因为它考虑了不同IoU阈值下模型的性能,能够更全面地反映模型的检测能力。

结果清楚地表明,RT DETR-ResNet18+LPE+dyssample模型在所有评估指标上都优于 其他模型,在目标检测方面表现出更高的精度、召回率和一致性。这突出了该模型在处 理复杂场景和检测小目标方面的增强能力,使其特别适合实际应用,如监控学生在教室 中的行为。

4.2. FSCB-Dataset上算法的比较实验

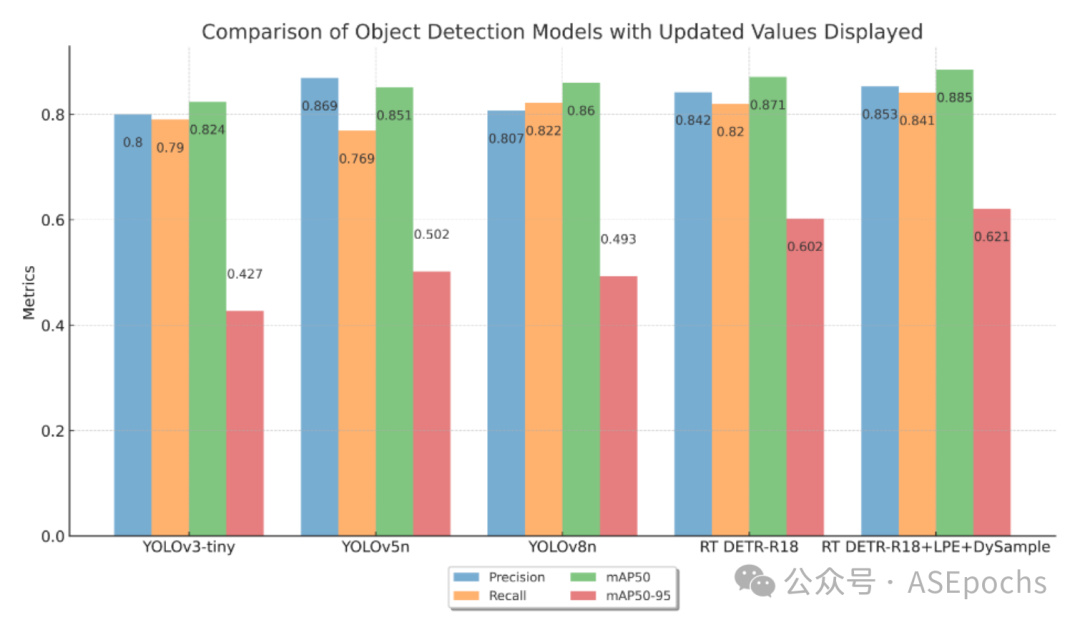

本节详细介绍了改进的RT DETR-18+LPE+ dyssample模型与现有目标检测模型 (YOLOv3-tiny、YOLOv5n、YOLOv8n)在fscb数据集上的对比实验结果。所有模型都在 相同的硬件配置和训练时间下进行训练,使用标准的目标检测指标来评估性能,包括精度、召回率、mAP50和mAP50-95。结果如图7所示。

Figure 7. Comparison of the detection performance of different models.

实验结果表明,改进的RT DETR-18+LPE+ dyssample模型在各种性能指标上表现优异。精密度提高到0.853,召回率为0.841,表明具有较强的阳性样本检测能力。mAP50 和mAP50-95指标分别达到0.885和0.621,在不同的IoU阈值中表现出一致性和高精度。这些优化显著增强了模型处理复杂场景和小目标检测的能力,适合学生课堂行为检测等实际应用。总体而言,优化策略的正确性及其潜在的应用价值得到了验证。

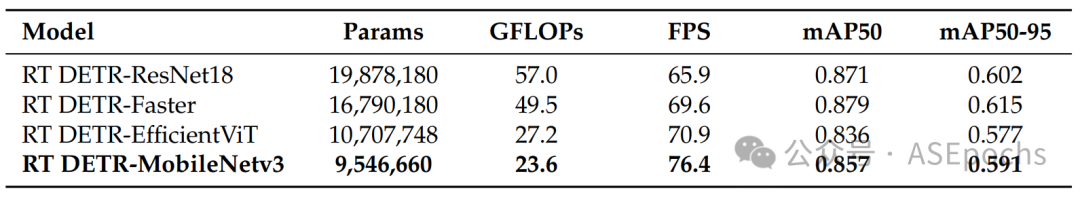

4.3. 骨干网改进实验

在本实验中,我们探讨了在RT DETR框架内更换不同骨干网对模型性能的影响。比较了四种配置:RT DETR-ResNet18、RT der - faster、RT der - efficientvit和RT der - mobilenetv3。我们根据总参数、GFLOPs(十亿次浮点运算)、FPS和两个精度指标mAP50和mAP50-95对这 些模型进行了评估,以评估它们在资源消耗、速度和精度方面的性能。

实验结果如表2所示,RT der - mobilenetv3的总参数最轻,为9,546,660个参数, GFLOPs为23.6,计算效率更高。在实时性能(FPS)方面,该型号以76.4的成绩排名第一。尽管参数较少,但mobienetv3版本表现出较强的性能,mAP50为0.857,超过RT der - efficientvit,接近RT der - faster的0.879。对于更全面的精度指标mAP50-95, RT der - mobilenetv3达到0.591,非常接近RT der - faster。这一结果证明了MobileNetv3在替换主 干时对整体模型性能的贡献,特别是在确保实时性能的同时保持高效率和良好的精度。

Table 2. The impact of different backbone networks on model performance.

三个指标的含义如下:

总参数量(Total Parameters):总参数量是指模型中所有可训练参数的总数,包括权重和偏置。参数越多,模型的容量越大,可能更复杂,但同时也可能需要更多的计算资源和数据来训练。

GFLOPs(Giga Floating Point Operations per Second):GFLOPs是一个衡量模型在进行前向传播时计算复杂度的指标,表示模型每秒可以进行的浮点运算次数(以十亿次为单位)。GFLOPs越高,意味着模型的计算成本越高,可能需要更强大的硬件来支持。

FPS(Frames Per Second):FPS是一个衡量模型处理速度的指标,表示模型每秒可以处理的帧数。在目标检测任务中,FPS越高,意味着模型能够更快地处理图像,对于实时应用来说非常重要。

4.4. 消融实验

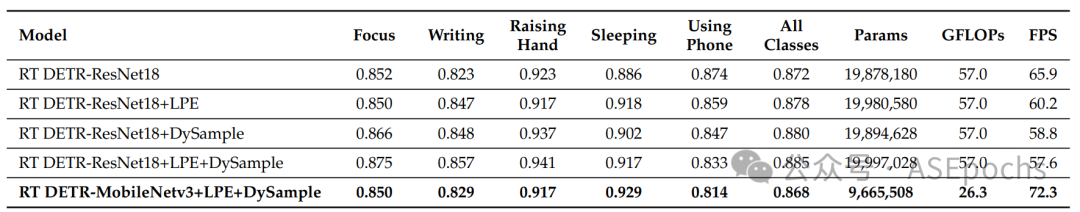

为了全面评估不同配置的RT-DETR模型在课堂行为检测中的有效性,我们进行了消纳实验,包括骨干网络替换、学习位置编码(LPE)和动态上采样(DySample) 等增强方法。表3总结了实验结果。

Table 3. Comparative analysis of the impact of different module enhancements on the RT DETR algorithm performance.

RT DETR-ResNet18作为基线模型,在各种行为分类中表现出显著的能力,总体准确率达到87.2%。学习位置编码(LPE)的引入提高了“写作”和“睡眠”等特 定类别的检测准确率,将整体准确率提高到87.8%,帧率提高到60.2 FPS,表明处 理效率显著提高。特别是,RT DETR-ResNet18+LPE+ DySample配置在检测“举手” 和“书写”行为方面的准确率最高,总体准确率为88.5%。该配置还展示了出色的 实时处理能力,记录了57.6 FPS的最高帧率。

最终的模型配置,RT DETR-MobileNetV3+LPE+DySample,虽然在精度上没 有完全超越其前身,但显著降低了计算资源消耗,只有9.67 M参数和26.3 GFLOPs。尽管帧率提高到72.3 FPS,但这种配置在计算效率至关重要的应用场景中显示出强 大的潜力,特别适合在资源有限的移动设备或嵌入式系统中部署。

消融研究强调了各种架构改进对RT-DETR模型性能的重大影响。具体来说, RT DETR-MobileNetV3+LPE+DySample配置有效地降低了模型的计算需求,提高 了处理速度,同时保持了合理的精度,为计算受限环境下的实时行为检测提供了 一种出色的解决方案。

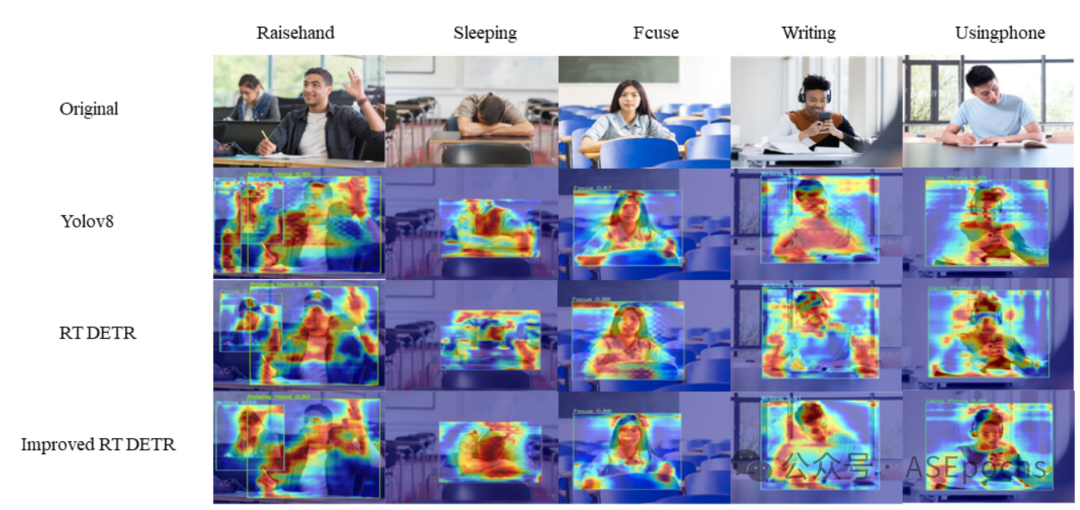

4.5. 可视化

在本研究中,我们通过热图可视化实验,对改进后的RT DETR模型在学生课 堂行为检测中的表现进行了深入分析。热图由模型预测的注意力权重生成,直观地表示了模型对图像某些区域的关注,如图8所示。这种可视化为理解和解释模型 的决策过程提供了直观的证据。

Figure 8. Heatmap visualization of different algorithms.

在实验中,我们首先捕捉了一系列具有代表性的课堂场景,涉及各种典型的学 生行为,比如举手、睡觉、分心、写作、使用手机。然后使用YOLOv8、原始RT DETR和改进的RT DETR模型对这些场景进行处理,生成相应的热图。

改进后的热图在以下几个方面展示了优化模型的优越性能:

-

增强的注意力集中:改进的模型在热图上表现出更集中的注意力分布。这表明该 模型有效地关注了与行为检测任务密切相关的区域,减少了对无关区域的注意力 分散。

-

优化的空间分辨率:通过改进的位置编码,模型在热图上显示更精细的空间分辨 率。这体现在更清晰的活动区域边界上,增强了行为检测的准确性。

-

改进的特征层融合:改进的CCFM上采样策略在热图上展示了更好的多尺度融合效 果。这确保了从低级特征到高级特征的平滑过渡,有助于捕获详细信息,同时保 持整体行为模式识别。

-

减少噪声和干扰:改进后的模型在热图上产生了更清晰的信号,有效地抑制了噪 声和背景干扰。这一点尤其重要,因为它表明该模型对真实课堂环境中各种类型 干扰的鲁棒性增强。

5.讨论

虽然这项研究在检测学生课堂行为方面取得了显著的成果,但仍有一些局限性需要解决。

-

数据集多样性和规模:数据集的多样性和规模仍然不足。虽然融合数据集(FSCBdataset)结合了ai生成的数据和实际观察数据,丰富了数据源,但数据集中包含的场景和行为类型可能无法完全覆盖实际教室中所有可能的情况。使用先进的文本到图像生成技术(如Stable Diffusion和DALL-E 3)生成的数据在某些情况下可能无法完全 反映真实场景的复杂性和可变性。

-

实时性能:虽然本文提出的RT-DETR模型结合了MobileNetV3骨干网、学习位置 编码(LPE)和动态上采样(DySample)技术,显著提高了计算效率,但还需要进一步 优化以确保实时性,特别是在资源受限的移动设备或嵌入式系统中。

-

模型可解释性:深度学习模型的黑箱性质使其决策过程难以解释,这在教育环境 中尤为重要。未来的研究可以进一步探索行为检测的可解释性模型,利用注意图和可视化工具帮助教师和研究人员更好地理解模型的决策过程,从而 提高系统的透明度和可接受性。

为了进一步提升学生课堂行为检测系统的性能和实用性,未来的研究可以探索以下方向:

-

实时推理优化:研究进一步优化实时推理的方法,如边缘计算和模型压缩技术,以提 高移动设备上的部署效率和性能。量化、剪枝和蒸馏等技术是可行的方法[41]。

-

多模态数据融合:结合视频、音频和传感器数据,构建多模态行为检测系统。多模态 融合不仅提供了更全面的行为分析,还增强了各种环境下的检测鲁棒性和准确性。例如, 整合麦克风数据来检测学生的发声行为,结合视觉数据,可以提高整体检测性能[42]。

-

行为检测中的可解释性:进一步研究深度学习模型的可解释性,特别是在解释检测 到的学生行为方面。使用注意图和可视化工具等可解释性技术,可以帮助教师和研究人 员更好地理解模型的决策过程,增强系统的透明度和可接受性[31]。

这些研究方向不仅为学生行为检测提供了新的技术途径,也为教育技术领域的进一 步发展奠定了坚实的基础。未来的研究可以不断优化算法,增强模型的泛化能力,并整 合更多的实际应用场景,推进智能教育系统的发展和应用。

6.结论

本研究通过各种创新和优化,显著提高了学生课堂行为检测系统的性能和实际应用。首先,我们构建了一个融合数据集(FSCB-dataset),有效解决了学生行为检测数据集多样性有限和稀缺性不足的问题,为模型训练提供了更丰富、更真实的数据资源。其次,提出了一种改进的基于RT - DETR算法的检测模型。通过结合轻量级的Mo-bileNetV3骨干网、 学习位置编码(LPE)和动态上采样(DySample)技术,该模型的计算效率得到了显著提高, 同时在保持原有检测精度的同时,实现了轻量化设计。在FSCB-dataset上的测试结果表明, 改进的RT - DETR模型在各种性能指标上都表现出色。改进后的轻量级网络也易于在移动 设备上部署,证明了其在资源受限环境中的实用性。

这段主要说了这个论文的创新点

这些研究成果不仅为学生行为检测提供了新的技术途径,也为教育技术领域的进一 步发展奠定了坚实的基础。未来的研究可以进一步优化算法,增强模型的泛化能力,并 整合更多的实际应用场景,不断推进智能教育系统的发展和应用。

7. 最后分享

AI大模型作为人工智能领域的重要技术突破,正成为推动各行各业创新和转型的关键力量。抓住AI大模型的风口,掌握AI大模型的知识和技能将变得越来越重要。

学习AI大模型是一个系统的过程,需要从基础开始,逐步深入到更高级的技术。

这里给大家精心整理了一份

全面的AI大模型学习资源,包括:AI大模型全套学习路线图(从入门到实战)、精品AI大模型学习书籍手册、视频教程、实战学习、面试题等,资料免费分享!

1. 成长路线图&学习规划

要学习一门新的技术,作为新手一定要先学习成长路线图,方向不对,努力白费。

这里,我们为新手和想要进一步提升的专业人士准备了一份详细的学习成长路线图和规划。可以说是最科学最系统的学习成长路线。

2. 大模型经典PDF书籍

书籍和学习文档资料是学习大模型过程中必不可少的,我们精选了一系列深入探讨大模型技术的书籍和学习文档,它们由领域内的顶尖专家撰写,内容全面、深入、详尽,为你学习大模型提供坚实的理论基础。(书籍含电子版PDF)

3. 大模型视频教程

对于很多自学或者没有基础的同学来说,书籍这些纯文字类的学习教材会觉得比较晦涩难以理解,因此,我们提供了丰富的大模型视频教程,以动态、形象的方式展示技术概念,帮助你更快、更轻松地掌握核心知识。

4. 2024行业报告

行业分析主要包括对不同行业的现状、趋势、问题、机会等进行系统地调研和评估,以了解哪些行业更适合引入大模型的技术和应用,以及在哪些方面可以发挥大模型的优势。

5. 大模型项目实战

学以致用 ,当你的理论知识积累到一定程度,就需要通过项目实战,在实际操作中检验和巩固你所学到的知识,同时为你找工作和职业发展打下坚实的基础。

6. 大模型面试题

面试不仅是技术的较量,更需要充分的准备。

在你已经掌握了大模型技术之后,就需要开始准备面试,我们将提供精心整理的大模型面试题库,涵盖当前面试中可能遇到的各种技术问题,让你在面试中游刃有余。

全套的AI大模型学习资源已经整理打包,有需要的小伙伴可以

微信扫描下方CSDN官方认证二维码,免费领取【保证100%免费】

2304

2304

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?