组合优化作为研究热点,近年来备受关注,而利用机器学习求解组合优化问题更是前沿趋势,极具创新潜力。组合优化广泛应用于物流、金融、制造等领域,在提升决策精度和效率方面发挥着关键作用。

传统方法如穷举法或近似算法虽能解决问题,但在面对复杂现实场景时,往往因计算成本高昂、效率低下而难以满足需求。相比之下,机器学习凭借强大的数据驱动能力和模式识别特性,为复杂组合优化问题提供了全新的解决方案。

为帮助大家紧跟学术前沿,我系统梳理了当前热门的十几种求解方法,这些资源不仅展示了机器学习在组合优化中的多样化应用,还为研究者提供了宝贵的参考工具。无论是科研探索还是实际应用,都值得深入挖掘!

全部论文+开源代码需要的同学看文末!

一、On Representing Mixed-Integer Linear Programs by Graph Neural Networks

方法

1. MILP的图表示

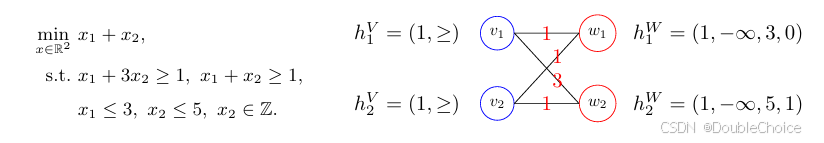

- 将混合整数线性规划(MILP)表示为带特征的加权二分图:

-

顶点类型:约束顶点和变量顶点

-

顶点特征:约束顶点的特征包含约束的右侧值和类型,变量顶点的特征包含目标系数、变量边界和整数性标识

-

边权重:对应约束矩阵的非零元素值

-

2. GNN架构设计

- 采用消息传递机制的双向GNN:

-

初始化嵌入:通过可学习的映射函数将顶点特征投影到隐空间

-

多层消息传递:通过约束→变量和变量→约束的双向信息聚合更新顶点表示

-

输出层:针对图级任务和节点级任务分别设计聚合方式

-

创新点

-

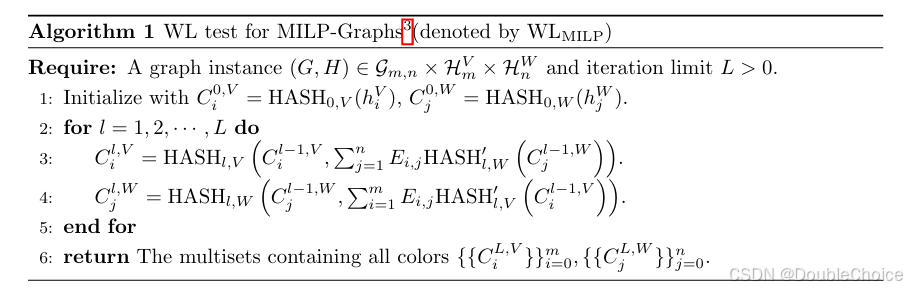

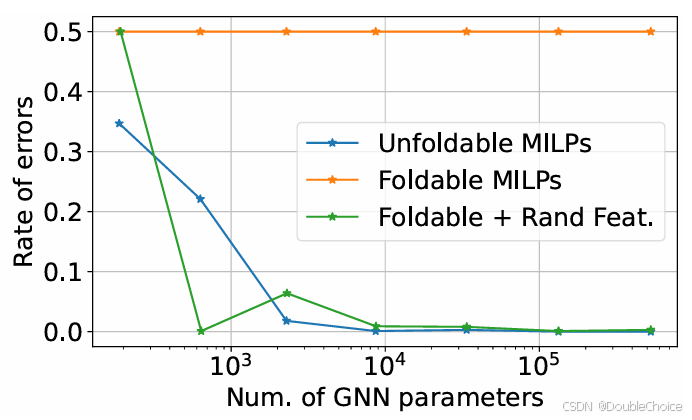

理论局限性发现:

-

首次严格证明GNN在通用MILP问题表示中的根本性局限,揭示WL测试的区分能力不足以处理所有MILP实例

-

-

可折叠问题定义:

-

提出可折叠MILP的数学定义,描述使GNN失效的问题结构特征

-

建立不可折叠 MILP类,证明其GNN可表示性

-

-

随机特征增强方法:

-

提出通过添加随机顶点特征打破对称性的通用方案

-

理论证明该方法可使任意MILP实例以概率1变为不可折叠

-

-

GNN表达能力边界刻画:

-

建立MILP-GNN的分离能力与WL测试的等价关系

-

给出GNN在MILP问题上表达能力的形式化上下界

-

-

应用指导价值:

-

为GNN在分支定界、割平面选择等MILP求解环节的应用提供理论依据

-

揭示实践中随机特征对GNN性能提升的数学本质

-

论文链接:https://arxiv.org/pdf/2210.10759

二、A GNN-Guided Predict-and-Search Framework for Mixed-Integer Linear Programming

方法

-

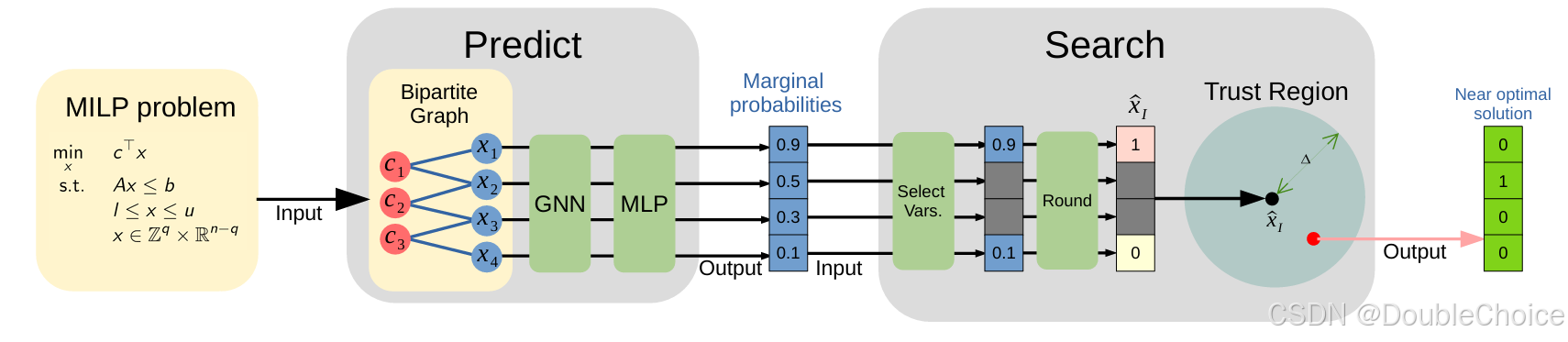

预测模块(Predict)

-

图神经网络(GNN)建模:将MILP实例表示为二分图,通过多层半卷积聚合节点特征。

-

条件分布学习:利用能量函数定义解空间的条件概率分布,通过加权样本学习变量的边际概率。

-

损失函数设计:采用KL散度衡量预测分布与真实分布的差异,分解为单变量交叉熵损失的加权和。

-

-

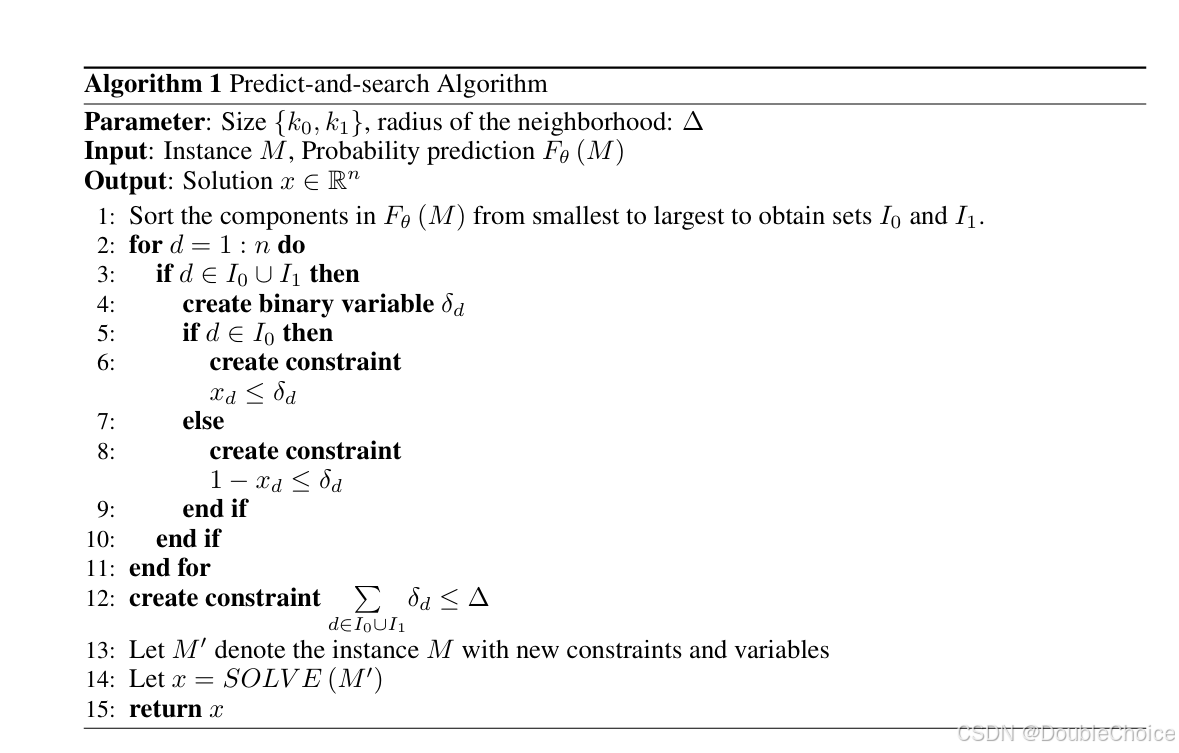

搜索模块(Search)

-

信任区域构建:基于预测的边际概率选择部分变量,定义邻域约束。

-

子问题求解:将邻域约束添加到原MILP问题,调用求解器快速搜索高质量可行解。

-

-

关键技术

-

半卷积层设计:交替聚合变量节点与约束节点的信息,使用多层感知机更新节点特征。

-

加权样本策略:通过目标值对可行解进行指数加权,减少对最优解的依赖。

-

动态参数选择:根据问题类型自适应调整(k0,k1,Δ),平衡搜索空间大小与求解效率。

创新点

-

预测-搜索融合框架

-

首次将GNN预测与信任区域搜索结合,避免传统端到端方法直接固定变量导致的次优解或不可行问题。

-

-

条件概率分布建模

-

提出基于能量函数的加权样本学习策略,通过边际概率表征解空间分布,降低高质量训练样本收集成本。

-

-

灵活邻域搜索机制

-

设计ℓ1范数约束的信任区域,相比固定策略扩展可行空间,理论证明其解质量更优。

-

-

通用性与高效性

-

框架不依赖问题特定结构,在4类公开MILP数据集上平均降低SCIP/Gurobi原始间隙51.1%/9.9%,显著优于神经分支定界等对比方法。

-

-

轻量级特征工程

-

提出仅包含目标系数、约束统计量等11维特征的二分图表示方法,无需预求解即可高效提取。

-

论文链接:https://arxiv.org/pdf/2302.05636

关注下方《AI前沿速递》🚀🚀🚀

回复“C270”获取全部方案+开源代码

码字不易,欢迎大家点赞评论收藏

686

686

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?