原作者总结的很好。

从NN到RNN再到LSTM(2): 循环神经网络RNN简介及计算

本文将简要介绍循环神经网络(Recurrent Neural Network,RNN),以及RNN的前向计算和误差反向传播过程。

转载请注明出处:http://blog.csdn.net/u011414416/article/details/46709965

以下内容主要引自Alex Graves写的Supervised Sequence Labelling with Recurrent Neural Networks 一书。

(http://www.springer.com/cn/book/9783642247965)

从NN到RNN再到LSTM(3): 长短时记忆LSTM简介及计算

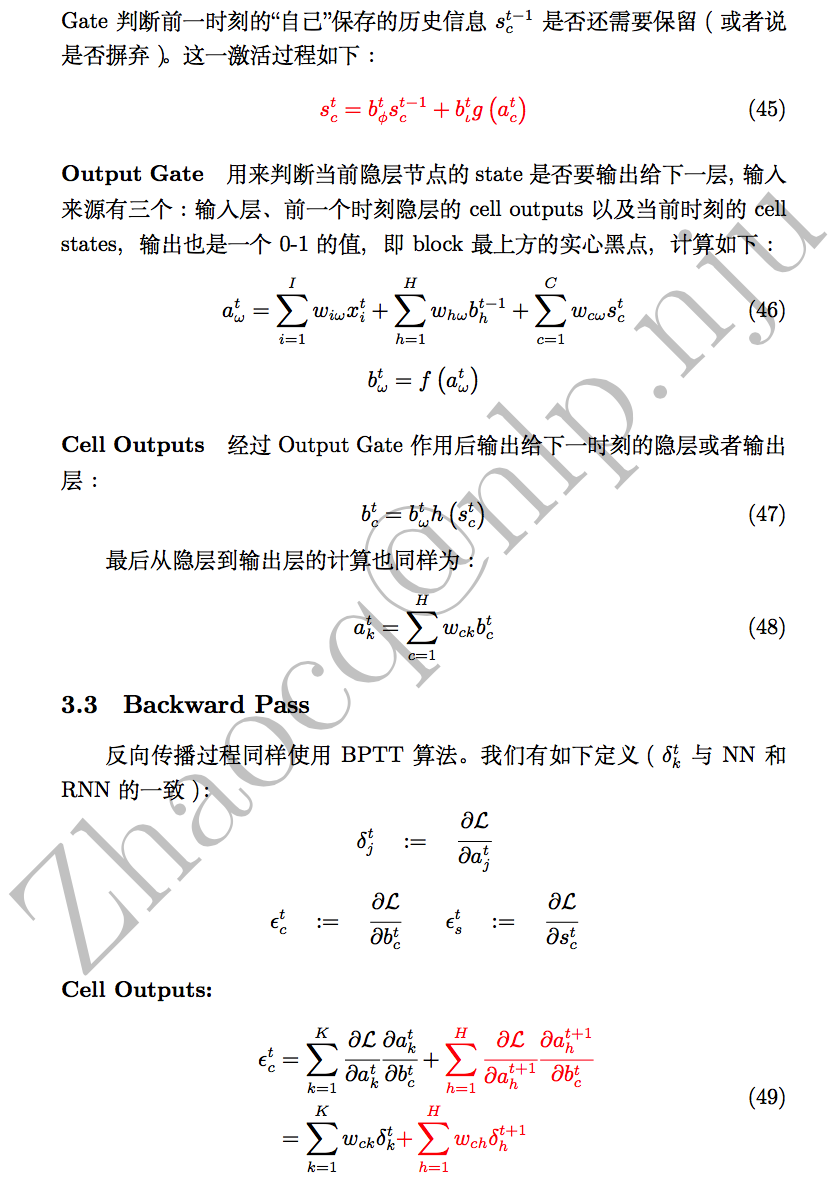

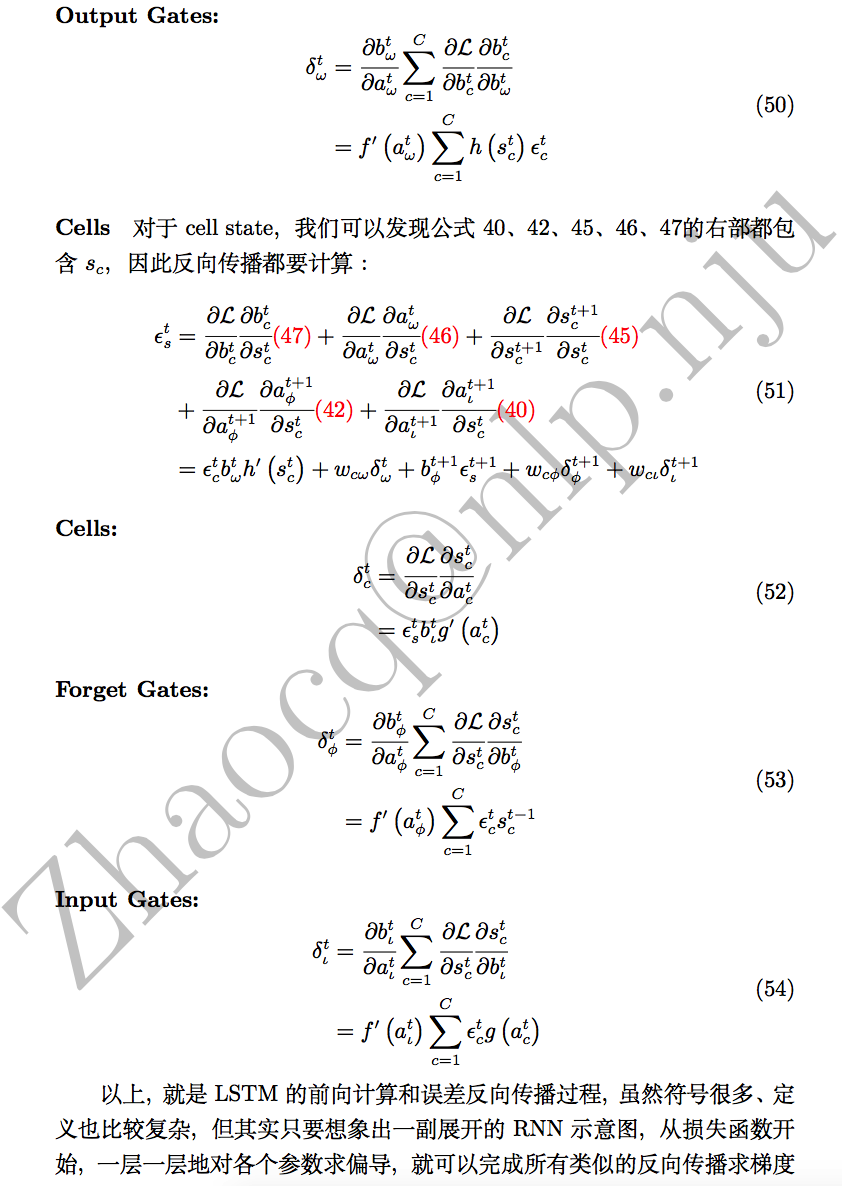

本文将简要介绍RNN存在的梯度消失和梯度爆炸问题,然后介绍长短时记忆(Long Short-Term memory,LSTM)的相关公式及推导过程。

转载请注明出处:http://blog.csdn.net/u011414416/article/details/46724699

以下内容主要引自Alex Graves写的Supervised Sequence Labelling with Recurrent Neural Networks 一书。

(http://www.springer.com/cn/book/9783642247965)

8105

8105

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?