- 🍨 本文為🔗365天深度學習訓練營 中的學習紀錄博客

- 🍖 原作者:K同学啊 | 接輔導、項目定制

一 我的环境

-

电脑:Dell Inspire 7000 i7 9750H

操作系统:Windows 11

显卡:NVIDIA GTX 1650 4G

语言环境:Python 3.11.0

开发工具:Jupyter Notebook 6.5.4

深度学习环境:Pytorch 2.2.2

-

二 开发过程

-

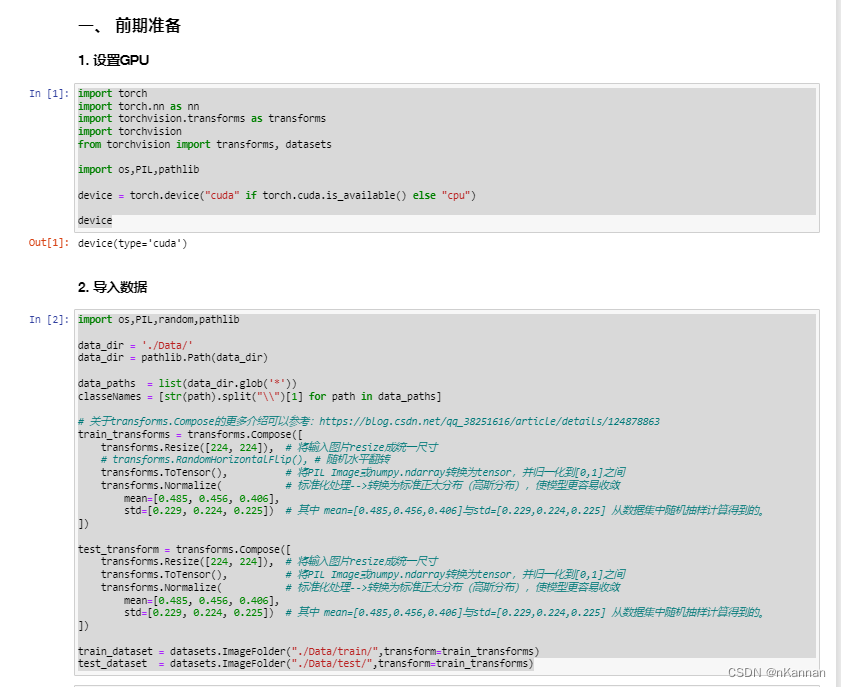

1. 设置GPU

-

import torch import torch.nn as nn import torchvision.transforms as transforms import torchvision from torchvision import transforms, datasets import os,PIL,pathlib device = torch.device("cuda" if torch.cuda.is_available() else "cpu") device2. 导入数据

-

import os,PIL,random,pathlib data_dir = './Data/' data_dir = pathlib.Path(data_dir) data_paths = list(data_dir.glob('*')) classeNames = [str(path).split("\\")[1] for path in data_paths] # 关于transforms.Compose的更多介绍可以参考:https://blog.csdn.net/qq_38251616/article/details/124878863 train_transforms = transforms.Compose([ transforms.Resize([224, 224]), # 将输入图片resize成统一尺寸 # transforms.RandomHorizontalFlip(), # 随机水平翻转 transforms.ToTensor(), # 将PIL Image或numpy.ndarray转换为tensor,并归一化到[0,1]之间 transforms.Normalize( # 标准化处理-->转换为标准正太分布(高斯分布),使模型更容易收敛 mean=[0.485, 0.456, 0.406], std=[0.229, 0.224, 0.225]) # 其中 mean=[0.485,0.456,0.406]与std=[0.229,0.224,0.225] 从数据集中随机抽样计算得到的。 ]) test_transform = transforms.Compose([ transforms.Resize([224, 224]), # 将输入图片resize成统一尺寸 transforms.ToTensor(), # 将PIL Image或numpy.ndarray转换为tensor,并归一化到[0,1]之间 transforms.Normalize( # 标准化处理-->转换为标准正太分布(高斯分布),使模型更容易收敛 mean=[0.485, 0.456, 0.406], std=[0.229, 0.224, 0.225]) # 其中 mean=[0.485,0.456,0.406]与std=[0.229,0.224,0.225] 从数据集中随机抽样计算得到的。 ]) train_dataset = datasets.ImageFolder("./Data/train/",transform=train_transforms) test_dataset = datasets.ImageFolder("./Data/test/",transform=train_transforms)3. 划分数据集

-

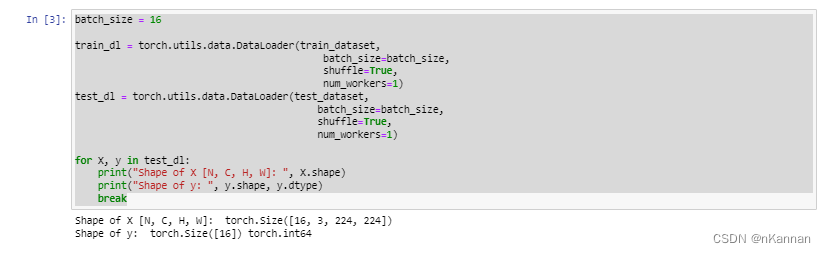

batch_size = 16 train_dl = torch.utils.data.DataLoader(train_dataset, batch_size=batch_size, shuffle=True, num_workers=1) test_dl = torch.utils.data.DataLoader(test_dataset, batch_size=batch_size, shuffle=True, num_workers=1) for X, y in test_dl: print("Shape of X [N, C, H, W]: ", X.shape) print("Shape of y: ", y.shape, y.dtype) break二、构建简单的CNN网络

-

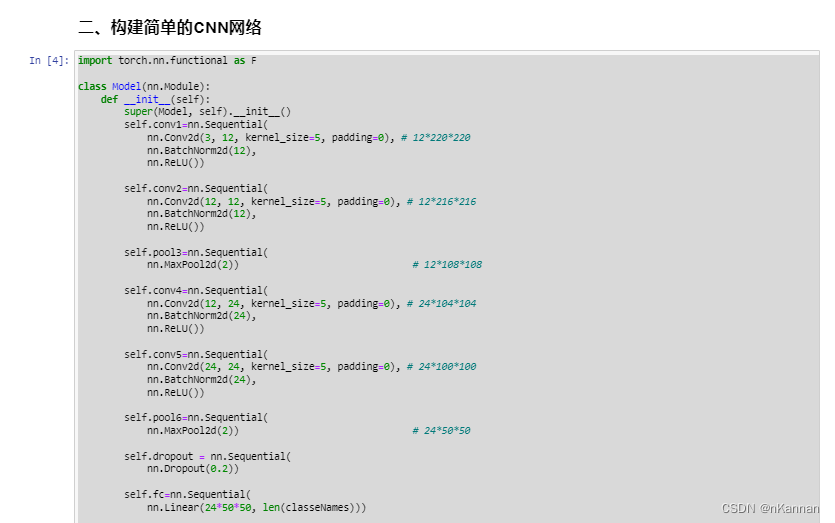

import torch.nn.functional as F class Model(nn.Module): def __init__(self): super(Model, self).__init__() self.conv1=nn.Sequential( nn.Conv2d(3, 12, kernel_size=5, padding=0), # 12*220*220 nn.BatchNorm2d(12), nn.ReLU()) self.conv2=nn.Sequential( nn.Conv2d(12, 12, kernel_size=5, padding=0), # 12*216*216 nn.BatchNorm2d(12), nn.ReLU()) self.pool3=nn.Sequential( nn.MaxPool2d(2)) # 12*108*108 self.conv4=nn.Sequential( nn.Conv2d(12, 24, kernel_size=5, padding=0), # 24*104*104 nn.BatchNorm2d(24), nn.ReLU()) self.conv5=nn.Sequential( nn.Conv2d(24, 24, kernel_size=5, padding=0), # 24*100*100 nn.BatchNorm2d(24), nn.ReLU()) self.pool6=nn.Sequential( nn.MaxPool2d(2)) # 24*50*50 self.dropout = nn.Sequential( nn.Dropout(0.2)) self.fc=nn.Sequential( nn.Linear(24*50*50, len(classeNames))) def forward(self, x): batch_size = x.size(0) x = self.conv1(x) # 卷积-BN-激活 x = self.conv2(x) # 卷积-BN-激活 x = self.pool3(x) # 池化 x = self.conv4(x) # 卷积-BN-激活 x = self.conv5(x) # 卷积-BN-激活 x = self.pool6(x) # 池化 x = self.dropout(x) x = x.view(batch_size, -1) # flatten 变成全连接网络需要的输入 (batch, 24*50*50) ==> (batch, -1), -1 此处自动算出的是24*50*50 x = self.fc(x) return x device = "cuda" if torch.cuda.is_available() else "cpu" print("Using {} device".format(device)) model = Model().to(device) print(model) for name, param in model.named_parameters(): print(f"Layer: {name} | Size: {param.size()} | Total params: {param.numel()}")三、 训练模型

-

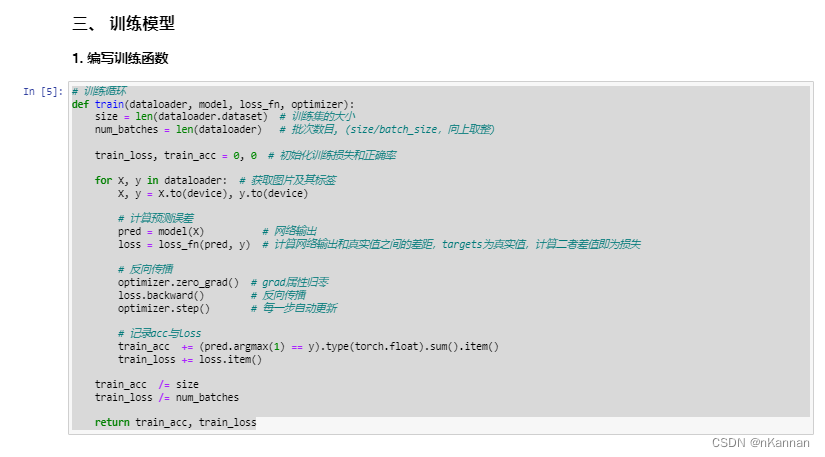

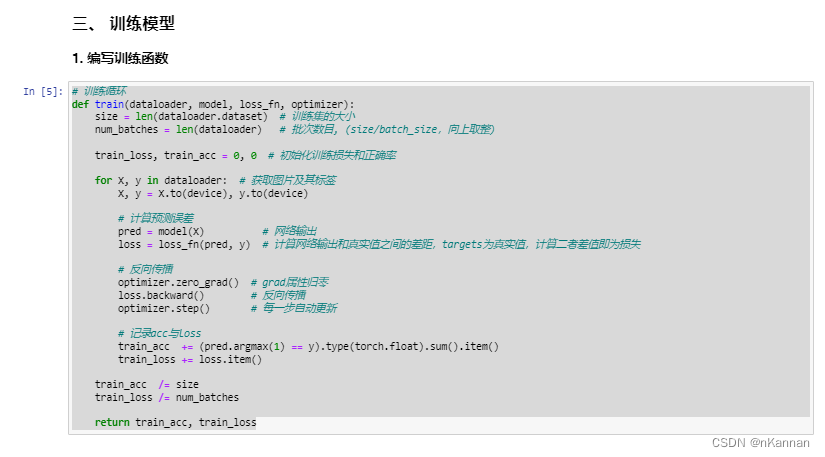

1. 编写训练函数

-

# 训练循环 def train(dataloader, model, loss_fn, optimizer): size = len(dataloader.dataset) # 训练集的大小 num_batches = len(dataloader) # 批次数目, (size/batch_size,向上取整) train_loss, train_acc = 0, 0 # 初始化训练损失和正确率 for X, y in dataloader: # 获取图片及其标签 X, y = X.to(device), y.to(device) # 计算预测误差 pred = model(X) # 网络输出 loss = loss_fn(pred, y) # 计算网络输出和真实值之间的差距,targets为真实值,计算二者差值即为损失 # 反向传播 optimizer.zero_grad() # grad属性归零 loss.backward() # 反向传播 optimizer.step() # 每一步自动更新 # 记录acc与loss train_acc += (pred.argmax(1) == y).type(torch.float).sum().item() train_loss += loss.item() train_acc /= size train_loss /= num_batches return train_acc, train_loss2. 编写测试函数

-

def test (dataloader, model, loss_fn): size = len(dataloader.dataset) # 测试集的大小 num_batches = len(dataloader) # 批次数目, (size/batch_size,向上取整) test_loss, test_acc = 0, 0 # 当不进行训练时,停止梯度更新,节省计算内存消耗 with torch.no_grad(): for imgs, target in dataloader: imgs, target = imgs.to(device), target.to(device) # 计算loss target_pred = model(imgs) loss = loss_fn(target_pred, target) test_loss += loss.item() test_acc += (target_pred.argmax(1) == target).type(torch.float).sum().item() test_acc /= size test_loss /= num_batches return test_acc, test_loss3. 设置动态学习率

-

def adjust_learning_rate(optimizer, epoch, start_lr): # 每 2 个epoch衰减到原来的 0.92 lr = start_lr * (0.92 ** (epoch // 2)) for param_group in optimizer.param_groups: param_group['lr'] = lr learn_rate = 1e-4 # 初始学习率 optimizer = torch.optim.SGD(model.parameters(), lr=learn_rate)4. 正式训练

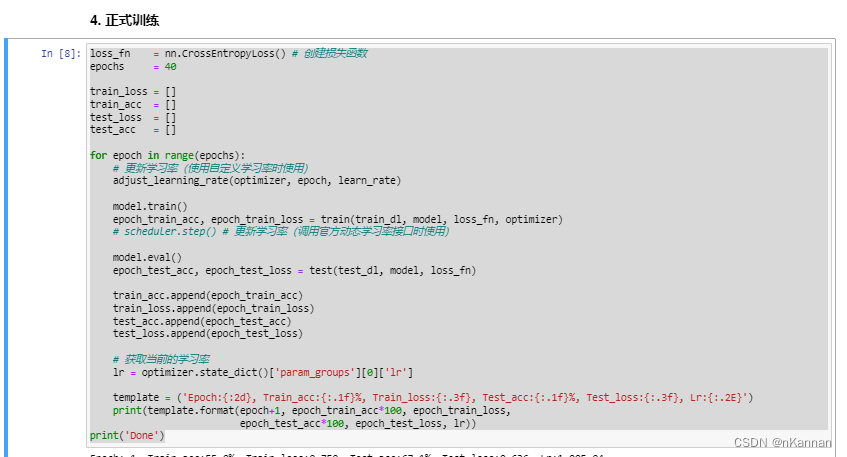

-

loss_fn = nn.CrossEntropyLoss() # 创建损失函数 epochs = 40 train_loss = [] train_acc = [] test_loss = [] test_acc = [] for epoch in range(epochs): # 更新学习率(使用自定义学习率时使用) adjust_learning_rate(optimizer, epoch, learn_rate) model.train() epoch_train_acc, epoch_train_loss = train(train_dl, model, loss_fn, optimizer) # scheduler.step() # 更新学习率(调用官方动态学习率接口时使用) model.eval() epoch_test_acc, epoch_test_loss = test(test_dl, model, loss_fn) train_acc.append(epoch_train_acc) train_loss.append(epoch_train_loss) test_acc.append(epoch_test_acc) test_loss.append(epoch_test_loss) # 获取当前的学习率 lr = optimizer.state_dict()['param_groups'][0]['lr'] template = ('Epoch:{:2d}, Train_acc:{:.1f}%, Train_loss:{:.3f}, Test_acc:{:.1f}%, Test_loss:{:.3f}, Lr:{:.2E}') print(template.format(epoch+1, epoch_train_acc*100, epoch_train_loss, epoch_test_acc*100, epoch_test_loss, lr)) print('Done')四、 运行截图

-

五、 个人总结

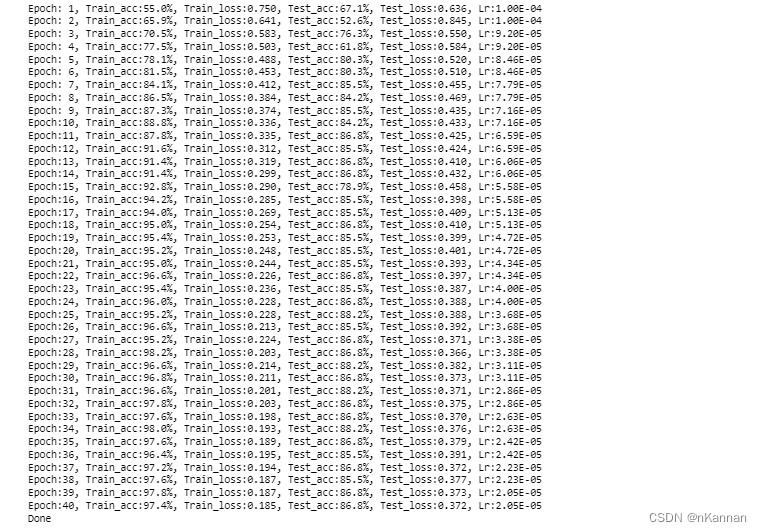

- 这次的运行不太复杂。第一次遇到了cuda out of memory的问题。没办法,在外面只能用笔记本,4G的显存有点吃力。

- 把batch size从32调整到64,问题解决。

- 而且训练结果最高准确率达到了88.2%,还是不错的。

365深度学习基础营:P5周 Pytorch实现运动鞋识别

最新推荐文章于 2024-07-24 08:57:32 发布

797

797

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?