1、概念

集成学习不能说是一种算法是一种思想。

那我们来学习一下这个集成学习的这种思想,那之前我们学过一些这个这个学习器,那之前我们学这里这个学习器,指的就是我们之前学的这个分类器,比如说决策术或者是神经网络,或者是KNN等等,那之前我们讨论的这个学习器,都是单一的独立的,然后整体表现比较差的学习器。这些样本上的表现,是否有可能会超过最好的学习器,那这句话的意思就是我们可能会有这样的一个考虑,就说比如比如说有些有有一个学习器,它的这个识别准确率,是90%,那还有一个学习器,它的识别率是60%,对于这个整体是很多样本测试的结果是这样的。

当做重要决定时,大家可能都会考虑吸取多个专家而不只是一个人的意见。集成学习也是如此。集成学习就是组合多个学习器,最后可以得到一个更好的学习器。

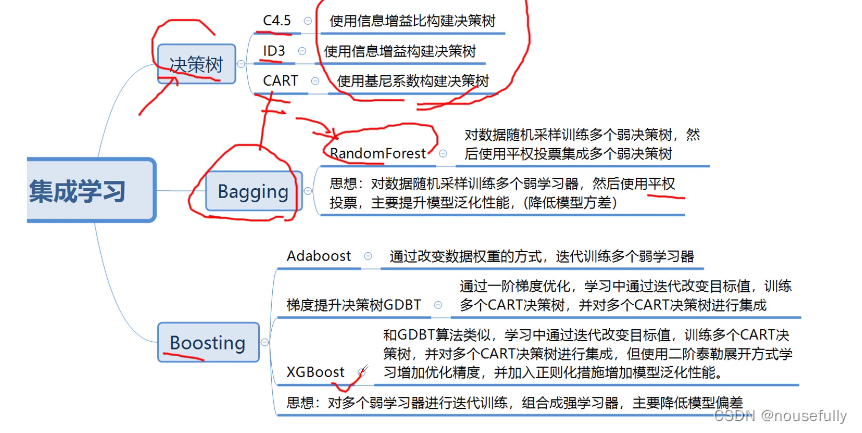

集成学习算法:

1.个体学习器之间不存在强依赖关系,装袋( bagging )

2.随机森林( Random Forest )

3.个体学习器之间存在强依赖关系,提升( boosting )

4.Stacking

2、Bagging

直觉:数据量越大,学习器性能越好。

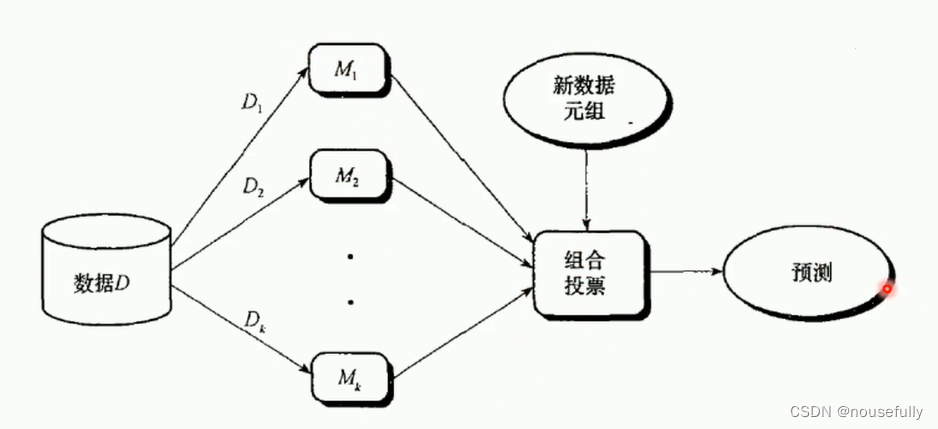

bagging也叫做bootstrap aggregating ,是在原始数据集选择S次后得到S个新数据集的一种技术。是一种有放回抽样。

这里这个图,大概就是一个bagging,这个集成学习的一个算法的结果,就首先,它先做图样,测量出很多的不同的这个训练集出来,然后我们用同一个的一个模型,对它进行训练,训练,训练训练,训练完之后,我们新的数据进来之后,我们进行这个组合投票,得到最后的一个结果。

好而不同

Bagging的实例代码:

#%%

# 导入算法包以及数据集

from sklearn import neighbors

from sklearn import datasets

from sklearn.ensemble import BaggingClassifier

from sklearn import tree

from sklearn.model_selection import train_test_split

import numpy as np

import matplotlib.pyplot as plt

#%%

iris = datasets.load_iris()

x_data = iris.data[:,:2]

y_data = iris.target

x_train,x_test,y_train,y_test = train_test_split(x_data, y_data)

#%%

knn = neighbors.KNeighborsClassifier()

knn.fit(x_train, y_train)

#%%

def plot(model):

# 获取数据值所在的范围

x_min, x_max = x_data[:, 0].min() - 1, x_data[:, 0].max() + 1

y_min, y_max = x_data[:, 1].min() - 1, x_data[:, 1].max() + 1

# 生成网格矩阵

xx, yy = np.meshgrid(np.arange(x_min, x_max, 0.02),

np.arange(y_min, y_max, 0.02))

z = model.predict(np.c_[xx.ravel(), yy.ravel()])# ravel与flatten类似,多维数据转一维。flatten不会改变原始数据,ravel会改变原始数据

z = z.reshape(xx.shape)

# 等高线图

cs = plt.contourf(xx, yy, z)

#%%

# 画图

plot(knn)

# 样本散点图

plt.scatter(x_data[:, 0], x_data[:, 1], c=y_data)

plt.show()

# 准确率

knn.score(x_test, y_test)

#%%

dtree = tree.DecisionTreeClassifier()

dtree.fit(x_train, y_train)

#%%

# 画图

plot(dtree)

# 样本散点图

plt.scatter(x_data[:, 0], x_data[:, 1], c=y_data)

plt.show()

# 准确率

dtree.score(x_test, y_test)

#%%

bagging_knn = BaggingClassifier(knn, n_estimators=100)

# 输入数据建立模型

bagging_knn.fit(x_train, y_train)

plot(bagging_knn)

# 样本散点图

plt.scatter(x_data[:, 0], x_data[:, 1], c=y_data)

plt.show()

bagging_knn.score(x_test, y_test)

#%%

bagging_tree = BaggingClassifier(dtree, n_estimators=100)

# 输入数据建立模型

bagging_tree.fit(x_train, y_train)

plot(bagging_tree)

# 样本散点图

plt.scatter(x_data[:, 0], x_data[:, 1], c=y_data)

plt.show()

bagging_tree.score(x_test, y_test)

#%%

3、随机森林

#%%

from sklearn import tree

from sklearn.model_selection import train_test_split

from sklearn.ensemble import RandomForestClassifier

import numpy as np

import matplotlib.pyplot as plt

#%%

# 载入数据

data = np.genfromtxt("LR-testSet2.txt", delimiter=",")

x_data = data[:,:-1]

y_data = data[:,-1]

plt.scatter(x_data[:,0],x_data[:,1],c=y_data)

plt.show()

#%%

x_train,x_test,y_train,y_test = train_test_split(x_data, y_data, test_size = 0.5)

#%%

def plot(model):

# 获取数据值所在的范围

x_min, x_max = x_data[:, 0].min() - 1, x_data[:, 0].max() + 1

y_min, y_max = x_data[:, 1].min() - 1, x_data[:, 1].max() + 1

# 生成网格矩阵

xx, yy = np.meshgrid(np.arange(x_min, x_max, 0.02),

np.arange(y_min, y_max, 0.02))

z = model.predict(np.c_[xx.ravel(), yy.ravel()])# ravel与flatten类似,多维数据转一维。flatten不会改变原始数据,ravel会改变原始数据

z = z.reshape(xx.shape)

# 等高线图

cs = plt.contourf(xx, yy, z)

# 样本散点图

plt.scatter(x_test[:, 0], x_test[:, 1], c=y_test)

plt.show()

#%%

dtree = tree.DecisionTreeClassifier()

dtree.fit(x_train, y_train)

plot(dtree)

dtree.score(x_test, y_test)

#%%

RF = RandomForestClassifier(n_estimators=50) #训练50个不同的决策树

RF.fit(x_train, y_train)

plot(RF)

RF.score(x_test, y_test)

#%%

4、Adaboost

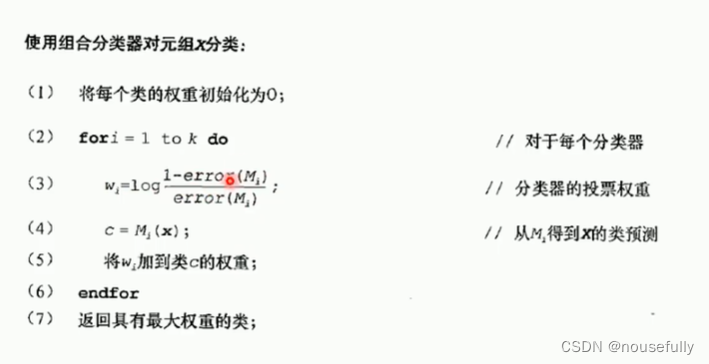

AdaBoost是英文"Adaptive Boosting" ( 自适应增强)的缩写,它的自适应在于:前一个基本分类器被错误分类的样本的权值会增大,而正确分类的样本的权值会减小,并再次用来训练下一个基本分类器。同时,在每一轮迭代中,加入一个新的弱分类器,直到达到某个预定的足够小的错误率或达到预先指定的最大迭代次数才确定最终的强分类器。

Adaboost算法可以简述为三个步骤:

(1 )首先,是初始化训练数据的权值分布D1。假设有N个训练样本数据,则每一个训练样本最开始时 ,都被赋予相同的权值: w=1/N。

( 2 )然后,训练弱分类器h。具体训练过程中是:如果某个训练样本点,被弱分类器h准确地分类,那么在构造下一个训练集中,它对应的权值要减小;相反,如果某个训练样本点被错误分类,那么它的权值就应该增大。权值更新过的样本集被用于训练下一个分类器,整个训练过程如此迭代地进行下去。

( 3 )最后,将各个训练得到的弱分类器组合成一 个强分类器。各个弱分类器的训练过程结束后,加大分类误差率小的弱分类器的权重,使其在最终的分类函数中起着较大的决定作用,而降低分类误差率大的弱分类器的权重,使其在最终的分类函数中起着较小的决定作用。换而言之,误差率低的弱分类器在最终分类器中占的权重较大,否则较小。

换而言之,误差率低的弱分类器在最终分类器中占的权重较大,否则较小。

老的:

Adaboost训练过程:

Adaboost判断过程:

新的:

#%%

import numpy as np

import matplotlib.pyplot as plt

from sklearn import tree

from sklearn.ensemble import AdaBoostClassifier

from sklearn.tree import DecisionTreeClassifier

from sklearn.datasets import make_gaussian_quantiles

from sklearn.metrics import classification_report

#%%

# 生成2维正态分布,生成的数据按分位数分为两类,500个样本,2个样本特征

x1, y1 = make_gaussian_quantiles(n_samples=500, n_features=2,n_classes=2)

# 生成2维正态分布,生成的数据按分位数分为两类,400个样本,2个样本特征均值都为3

x2, y2 = make_gaussian_quantiles(mean=(3, 3), n_samples=500, n_features=2, n_classes=2)

# 将两组数据合成一组数据

x_data = np.concatenate((x1, x2))

y_data = np.concatenate((y1, - y2 + 1)) #-y2为了更好区分

#%%

plt.scatter(x_data[:, 0], x_data[:, 1], c=y_data)

plt.show()

#%%

# 决策树模型

model = tree.DecisionTreeClassifier(max_depth=3)

# 输入数据建立模型

model.fit(x_data, y_data)

# 获取数据值所在的范围

x_min, x_max = x_data[:, 0].min() - 1, x_data[:, 0].max() + 1

y_min, y_max = x_data[:, 1].min() - 1, x_data[:, 1].max() + 1

# 生成网格矩阵

xx, yy = np.meshgrid(np.arange(x_min, x_max, 0.02),

np.arange(y_min, y_max, 0.02))

z = model.predict(np.c_[xx.ravel(), yy.ravel()])# ravel与flatten类似,多维数据转一维。flatten不会改变原始数据,ravel会改变原始数据

z = z.reshape(xx.shape)

# 等高线图

cs = plt.contourf(xx, yy, z)

# 样本散点图

plt.scatter(x_data[:, 0], x_data[:, 1], c=y_data)

plt.show()

#%%

# 模型准确率

model.score(x_data,y_data)

#%%

# AdaBoost模型

model = AdaBoostClassifier(DecisionTreeClassifier(max_depth=3),n_estimators=10)

# 训练模型

model.fit(x_data, y_data)

# 获取数据值所在的范围

x_min, x_max = x_data[:, 0].min() - 1, x_data[:, 0].max() + 1

y_min, y_max = x_data[:, 1].min() - 1, x_data[:, 1].max() + 1

# 生成网格矩阵

xx, yy = np.meshgrid(np.arange(x_min, x_max, 0.02),

np.arange(y_min, y_max, 0.02))

# 获取预测值

z = model.predict(np.c_[xx.ravel(), yy.ravel()])

z = z.reshape(xx.shape)

# 等高线图

cs = plt.contourf(xx, yy, z)

# 样本散点图

plt.scatter(x_data[:, 0], x_data[:, 1], c=y_data)

plt.show()

#%%

# 模型准确率

model.score(x_data,y_data)

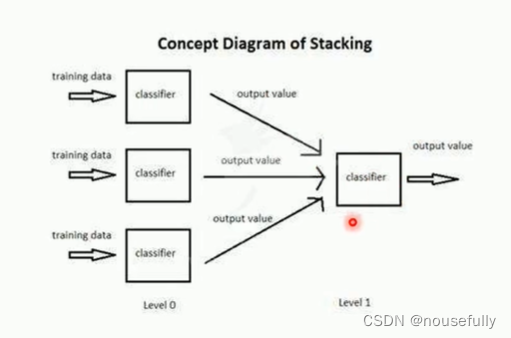

#%%5、Stacking和Voting介绍和使用

5-1、Stacking:使用多个不同的分类器对训练集进预测,把预测得到的结果作为一个次级分类器的输入。次级分类器的输出是整个模型的预测结果。

比如:

Stacking代码:

#%%

from sklearn import datasets

from sklearn import model_selection

from sklearn.linear_model import LogisticRegression

from sklearn.neighbors import KNeighborsClassifier

from sklearn.tree import DecisionTreeClassifier

from mlxtend.classifier import StackingClassifier # pip install mlxtend

import numpy as np

#%%

# 载入数据集

iris = datasets.load_iris()

# 只要第1,2列的特征

x_data, y_data = iris.data[:, 1:3], iris.target

# 定义三个不同的分类器

clf1 = KNeighborsClassifier(n_neighbors=1)

clf2 = DecisionTreeClassifier()

clf3 = LogisticRegression()

# 定义一个次级分类器

lr = LogisticRegression() #逻辑回归

sclf = StackingClassifier(classifiers=[clf1, clf2, clf3],

meta_classifier=lr)

for clf,label in zip([clf1, clf2, clf3, sclf],

['KNN','Decision Tree','LogisticRegression','StackingClassifier']):

scores = model_selection.cross_val_score(clf, x_data, y_data, cv=3, scoring='accuracy') #把训练集分成三个部分,一个部分验证集,两个部分作为验证集

print("Accuracy: %0.2f [%s]" % (scores.mean(), label))

#%%

5-2、Voting:投票

#%%

from sklearn import datasets

from sklearn import model_selection

from sklearn.linear_model import LogisticRegression

from sklearn.neighbors import KNeighborsClassifier

from sklearn.tree import DecisionTreeClassifier

from sklearn.ensemble import VotingClassifier

import numpy as np

#%%

# 载入数据集

iris = datasets.load_iris()

# 只要第1,2列的特征

x_data, y_data = iris.data[:, 1:3], iris.target

# 定义三个不同的分类器

clf1 = KNeighborsClassifier(n_neighbors=1)

clf2 = DecisionTreeClassifier()

clf3 = LogisticRegression()

sclf = VotingClassifier([('knn',clf1),('dtree',clf2), ('lr',clf3)])

for clf, label in zip([clf1, clf2, clf3, sclf],

['KNN','Decision Tree','LogisticRegression','VotingClassifier']):

scores = model_selection.cross_val_score(clf, x_data, y_data, cv=3, scoring='accuracy')

print("Accuracy: %0.2f [%s]" % (scores.mean(), label))

#%%

6、总结

效果 有三种:

7、Bagging和Boosting的区别:

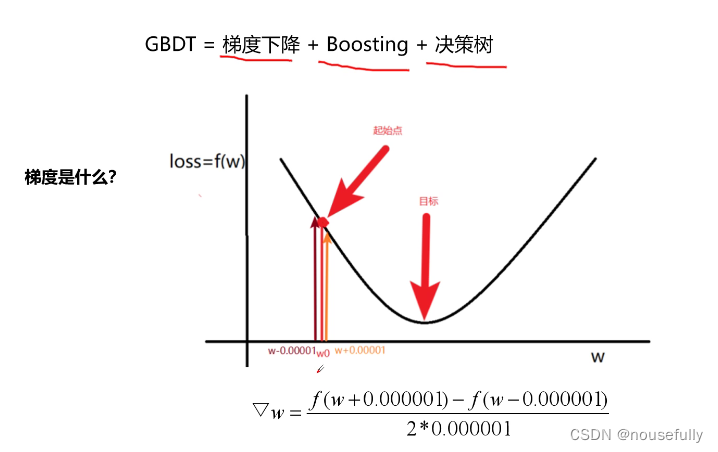

8、GBDT(梯度提升决策树)

716

716

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?