AI模型训练和评估的最佳实践:Transformers Trainer与Evaluate库详解

在机器学习中,微调模型和评估其性能是确保模型有效性的重要步骤。Hugging Face 提供了强大的工具——Transformers Trainer 和 Hugging Face Evaluate,以简化这些过程。本文将详细介绍这两个模块的功能,并通过实际代码示例帮助您理解它们的使用方法。

一、Transformers 微调训练模块 Trainer

1. 简化模型的微调训练

Transformers Trainer 模块旨在简化模型的微调训练过程。假设我们已经有了一个预训练的模型,并且希望在自定义数据集上进行微调。Trainer 模块通过封装复杂的训练流程,使得微调变得更为直观和高效。

示例代码:

from transformers import Trainer, TrainingArguments, BertForSequenceClassification, BertTokenizer

from datasets import load_dataset

# 加载数据集

dataset = load_dataset('imdb')

# 加载预训练模型和分词器

model = BertForSequenceClassification.from_pretrained('bert-base-uncased')

tokenizer = BertTokenizer.from_pretrained('bert-base-uncased')

# 数据预处理

def preprocess_function(examples):

return tokenizer(examples['text'], truncation=True, padding='max_length')

encoded_dataset = dataset.map(preprocess_function, batched=True)

# 定义训练参数

training_args = TrainingArguments(

output_dir='./results', # 输出目录

evaluation_strategy="epoch", # 评估策略

learning_rate=2e-5, # 学习率

per_device_train_batch_size=8, # 训练批次大小

per_device_eval_batch_size=8, # 评估批次大小

num_train_epochs=3, # 训练轮次

weight_decay=0.01, # 权重衰减

)

# 初始化 Trainer

trainer = Trainer(

model=model, # 预训练模型

args=training_args, # 训练参数

train_dataset=encoded_dataset['train'], # 训练数据集

eval_dataset=encoded_dataset['test'] # 评估数据集

)

# 开始训练trainer.train()

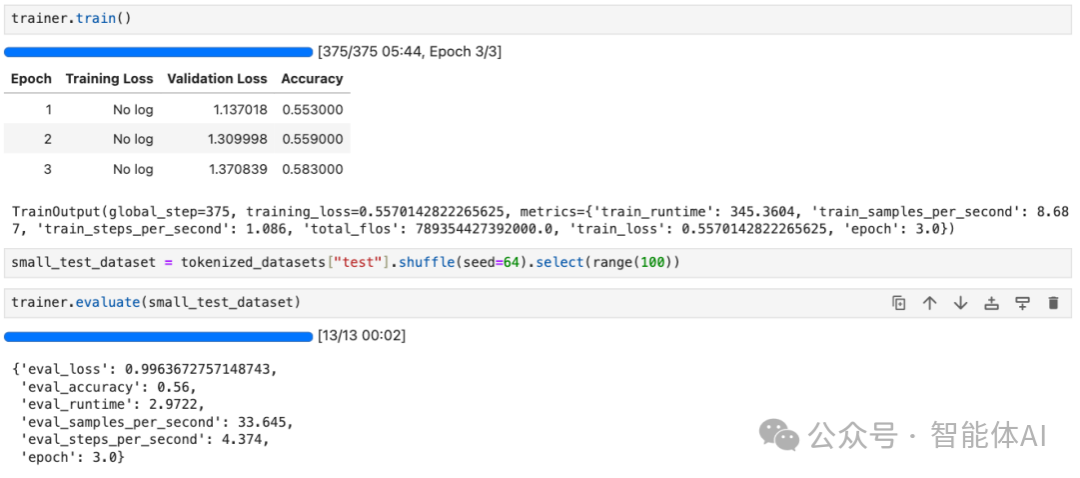

在上述代码中,我们首先加载了一个预训练的 BERT 模型和 IMDB 数据集。然后,我们定义了训练参数,并使用 Trainer 类来执行模型微调。在 Trainer 中,我们指定了模型、训练参数以及训练和评估数据集,最后调用 train() 方法开始训练。

2. 统一的训练参数配置

Transformers TrainingArguments 提供了一种统一配置训练参数的方式,简化了训练过程中的配置任务。所有的训练参数都可以在 TrainingArguments 中进行集中设置。

示例代码:

在这个配置中,我们设置了输出目录、训练轮次、批次大小、预热步数等参数。这样的集中配置使得管理训练参数变得更加方便和一致。

3. 丰富的数据集和模型支持

Hugging Face Hub 提供了大量的预训练模型和数据集,用户可以方便地从中加载所需的资源。以下是如何从 Hub 中加载数据集和模型的示例:

示例代码:

这里,我们通过 load_dataset 加载了 IMDB 数据集,并使用 from_pretrained 方法加载了预训练的 BERT 模型和分词器。Hugging Face Hub 使得获取数据和模型变得非常简单。

二、Transformers 模型评估库 Evaluate

1. 轻松评估模型和数据集

在训练模型之后,评估其性能是验证模型有效性的关键步骤。Hugging Face Evaluate 库提供了简单易用的接口来进行模型评估。以下是一个使用 Evaluate 库进行评估的示例:

示例代码:

在这个示例中,我们加载了准确率评估指标,并计算了模型预测与真实标签之间的准确率。只需几行代码,Evaluate 库便可以轻松实现模型评估。

2. 一致且可重复的评估方式

Evaluate 库确保了无论是在本地还是分布式环境中,评估过程都能够保持一致性。以下是如何在分布式环境中进行评估的示例:

示例代码:

Evaluate 库提供了在不同计算环境下都能保持一致的评估结果,使得模型评估更加可靠。

三、总结

Transformers Trainer 和 Hugging Face Evaluate 是机器学习工作流中的两个重要工具。Trainer 模块通过简化微调训练过程和统一配置参数,帮助用户高效地进行模型训练;Evaluate 库则通过简便的一致性评估方法,确保模型性能的准确评估。掌握这些工具,将使您的机器学习实验更加高效和可靠。

如何学习大模型

现在社会上大模型越来越普及了,已经有很多人都想往这里面扎,但是却找不到适合的方法去学习。

作为一名资深码农,初入大模型时也吃了很多亏,踩了无数坑。现在我想把我的经验和知识分享给你们,帮助你们学习AI大模型,能够解决你们学习中的困难。

我已将重要的AI大模型资料包括市面上AI大模型各大白皮书、AGI大模型系统学习路线、AI大模型视频教程、实战学习,等录播视频免费分享出来,需要的小伙伴可以扫取。

一、AGI大模型系统学习路线

很多人学习大模型的时候没有方向,东学一点西学一点,像只无头苍蝇乱撞,我下面分享的这个学习路线希望能够帮助到你们学习AI大模型。

二、AI大模型视频教程

三、AI大模型各大学习书籍

四、AI大模型各大场景实战案例

五、结束语

学习AI大模型是当前科技发展的趋势,它不仅能够为我们提供更多的机会和挑战,还能够让我们更好地理解和应用人工智能技术。通过学习AI大模型,我们可以深入了解深度学习、神经网络等核心概念,并将其应用于自然语言处理、计算机视觉、语音识别等领域。同时,掌握AI大模型还能够为我们的职业发展增添竞争力,成为未来技术领域的领导者。

再者,学习AI大模型也能为我们自己创造更多的价值,提供更多的岗位以及副业创收,让自己的生活更上一层楼。

因此,学习AI大模型是一项有前景且值得投入的时间和精力的重要选择。

1552

1552

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?