ICLR2017 | Paying More Attention to Attention

https://github.com/szagoruyko/attention-transfer

1.注意力机制

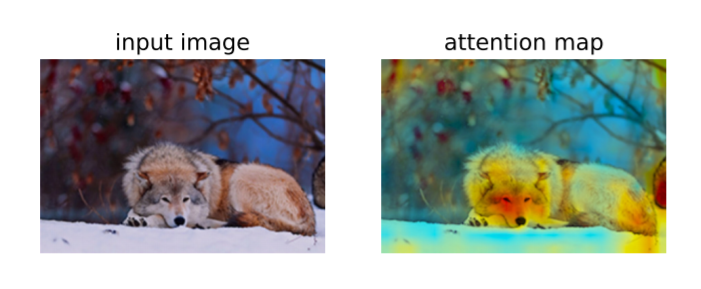

注意力在人类视觉体验中起着至关重要的作用。如下图所示,以图像分类为例,注意力地图展示了学习完成后的网络模型更关注于图像的哪个区域,是网络模型学习成果的体现。本文通过迫使学生模型模仿强大的教师模型的注意力特征图,来显著提高学生模型的性能。为此,本文提出了基于激活注意力地图的蒸馏法。

2.获取激活注意力地图

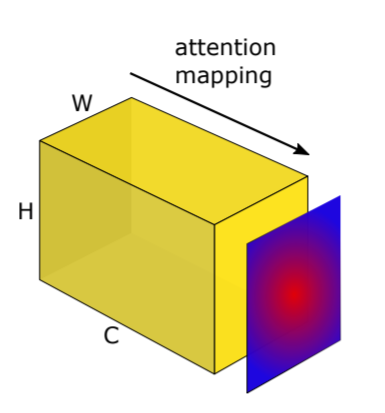

要利用激活注意力地图进行知识蒸馏的第一步就是得到当前网络的激活注意力地图。对于神经网络的某一层来说,激活注意力地图的获取方式如下图和公式所示。作者将把当前层中所有通道的激活进行合理的组合,最终形成一张可以表征当前层信息的激活注意力地图,该组合函数为F。

本文中,作者提出了三种F函数,也就是三种组合形式。如下三个组合函数的前提都是假设每个通道中的特征绝对值大,就认为当前位置被激活的程度也大。其中与Fsum()

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?