因为最近在招聘软件上收到了一些Prompt工程师的岗位邀请,月薪在35~45K之间,薪水不菲。

但我本人对Prompt工程师这个概念有所怀疑,总觉得这个事干好了就是在加速自己被裁的进度,而且做一个领域的Prompt设计师过于垂直,投入的精力没有办法得到积累。

所以就看了宝玉大佬整理的微软最新演讲,教我们“如何训练和应用GPT”[1]。

看完后,进一步让我觉得Prompt工程师是风口上的猪,同时我对prompt和GPT的思考模式有了更深的理解。

简单来说,GPT的核心是“模仿”,而Prompt就是给GPT一个模仿的样本。

展开说的话,就一起看看下面的内容吧。

-

token与中文屋

你是不是也对“token”这个概念比较模糊?什么GPT更新了,支持了更多的token输入与输出。

可啥叫token?

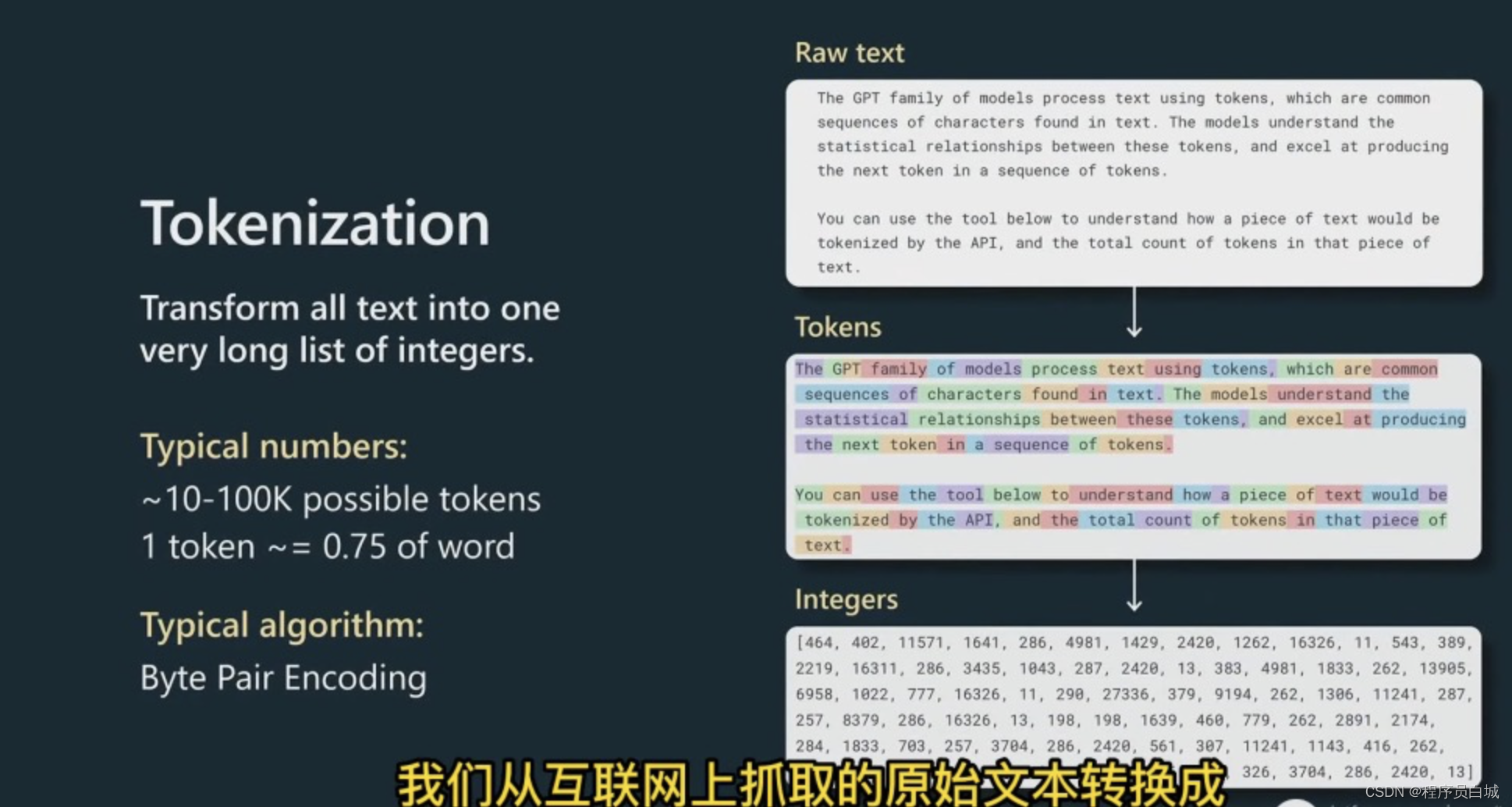

其实,大家常说的tokens,原来就是下图右侧第2张的一堆被分割的彩色单词。

GPT工作时,会把收到的文本(上图右侧第1张),通过分段标注(上图右侧第2张)转换为数字数组(上图右侧第3张)。

接着,拿这一串看着似乎没有意义的数字,送入神经网络。

本文探讨了Prompt工程师的角色,解释了GPT的工作原理,指出GPT通过模仿和大量的参数来生成内容,而非真正理解。文章强调了如何通过有效的Prompt设计引导GPT输出更准确的答案,同时揭示了这一领域所需的专业技能和知识。

本文探讨了Prompt工程师的角色,解释了GPT的工作原理,指出GPT通过模仿和大量的参数来生成内容,而非真正理解。文章强调了如何通过有效的Prompt设计引导GPT输出更准确的答案,同时揭示了这一领域所需的专业技能和知识。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1917

1917

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?