探索联邦学习:隐私保护的分布式机器学习

在当今数据驱动的世界中,数据隐私和安全性变得越来越重要。传统的集中式机器学习方法要求将数据集中到一个中央服务器上进行训练,这可能会带来隐私泄露和数据安全问题。为了解决这些问题,联邦学习(Federated Learning)作为一种新兴的分布式机器学习方法应运而生。

什么是联邦学习?

联邦学习是一种分布式机器学习方法,它允许多个参与者在不共享原始数据的情况下,共同训练一个全局模型。这种方法通过在本地训练模型并仅共享模型更新,而不是原始数据,从而保护了数据隐私和安全性。

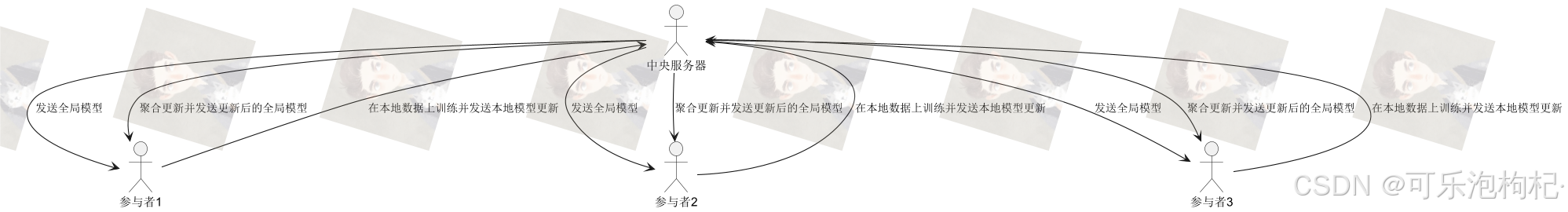

联邦学习的工作流程

- 初始化全局模型:中央服务器初始化一个全局模型,并将其发送给所有参与者。

- 本地训练:每个参与者在自己的本地数据上训练模型,生成本地模型更新。

- 模型聚合:各参与者将本地模型更新发送到中央服务器,中央服务器对这些更新进行聚合,生成更新后的全局模型。

- 模型广播:中央服务器将更新后的全局模型发送回各参与者,重复上述步骤,直到模型收敛。

联邦学习的优点

- 隐私保护:原始数据始终保留在本地,不需要集中存储或传输,从而保护了数据隐私。

- 数据安全:减少了数据泄露的风险,因为不需要将敏感数据传输到中央服务器。

- 资源利用:充分利用了参与者的计算资源,减轻了中央服务器的负担。

联邦学习的应用场景

- 医疗领域:不同医院可以在不共享患者数据的情况下,共同训练疾病诊断模型。

- 金融领域:银行可以在不交换客户信息的前提下,共同开发欺诈检测系统。

- 移动设备:智能手机可以在用户不上传个人数据的情况下,协作改进语音识别和预测文本输入等功能。

联邦学习的挑战

- 通信开销:频繁的模型更新和传输可能带来较大的通信开销。

- 异构性:不同参与者的数据分布和质量可能存在差异,导致训练过程中的非独立同分布(Non-IID)问题。

- 安全性:尽管联邦学习保护了原始数据,但仍需防范模型更新过程中的攻击,如差分隐私攻击和恶意参与者攻击。

联邦学习流程图

总结

联邦学习是一种有效的分布式机器学习方法,通过在不共享原始数据的情况下进行协同训练,解决了数据隐私和安全问题。它在许多需要保护敏感数据的应用场景中具有广泛的应用前景。然而,在实际应用中仍需解决通信开销、数据异构性和安全性等挑战。

880

880

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?