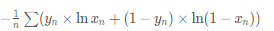

BCELoss

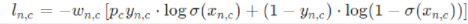

BCEWithLogitsLoss就是把Sigmoid-BCELoss合成一步。

https://blog.csdn.net/qq_22210253/article/details/85222093

pos_weight

对正样本加权pc

pos_weight (Tensor, optional): a weight of positive examples.

Must be a vector with length equal to the number of classes.

https://blog.csdn.net/weixin_44498986/article/details/111378794

预测值为1.0和2.0,标签值为0和1.预测值经过sigmoid之后为[0.7311,0.8808]

code

import torch

import torch.nn as nn

device = torch.device("cuda:0" if torch.cuda.is_available() else "cpu")

a=torch.tensor([1.0,2.0])

m=nn.Sigmoid()

b=torch.Tensor([0,1])

loss_function = nn.BCEWithLogitsLoss()

loss_function1 = nn.BCEWithLogitsLoss(pos_weight=torch.tensor([10.0,1.0]))

loss_function2 = nn.BCEWithLogitsLoss(pos_weight=torch.tensor([1.0,10.0]))

loss_function3 = nn.BCEWithLogitsLoss(pos_weight=torch.tensor([1.0,1.0]))

loss_function4 = nn.BCEWithLogitsLoss(pos_weight=torch.tensor([1.0,100.0]))

loss = loss_function(a,b)

loss1 = loss_function1(a,b)

loss2 = loss_function2(a,b)

loss3 = loss_function3(a,b)

loss4 = loss_function4(a,b)

print(loss,loss1,loss2,loss3,loss4)

简单解释下loss1=loss的问题,注意公式中的Pc是加在了第一项,就是说仅对标签1生效(对标签0 无效),而我们的标签[0,1],因此pos_weight的值[1,1]和[10,1]是等价的(第0维无效)。

https://www.jb51.net/article/212137.htm

1992

1992

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?