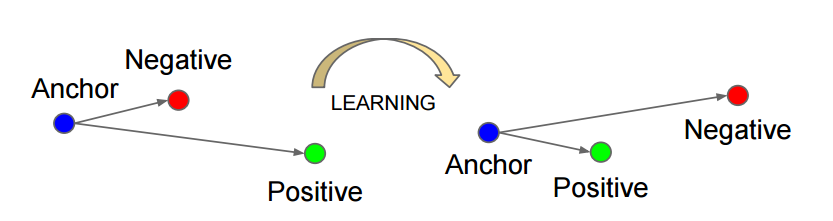

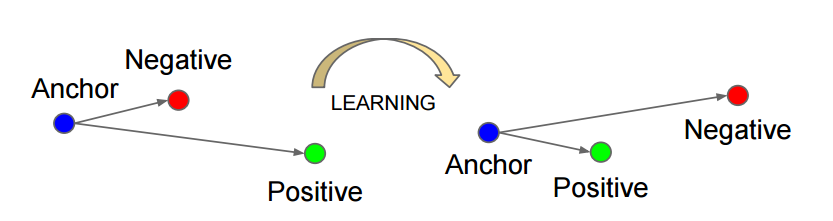

一、triplet loss 原理

triplet:一个三元组,这个三元组是这样构成的:从训练数据集中随机选一个样本,该样本称为Anchor,然后再随机选取一个和Anchor (记为x_a)属于同一类的样本和不同类的样本,这两个样本对应的称为Positive (记为x_p)和Negative (记为x_n),由此构成一个三元组。

triplet loss:针对三元组中的每个元素(样本),训练一个参

本文详细介绍了Triplet Loss的工作原理,并提供了在Caffe中实现Triplet Loss Layer的步骤,帮助读者深入理解这一深度学习中的关键损失函数。

本文详细介绍了Triplet Loss的工作原理,并提供了在Caffe中实现Triplet Loss Layer的步骤,帮助读者深入理解这一深度学习中的关键损失函数。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?