什么是梯度下降?

首先引图(引用)(https://blog.csdn.net/han_xiaoyang/article/details/50178505)

梯度(Gradient)与梯度下降法(Gradient Descent):

深入理解的概念

对于梯度下降首先掌握的基础知识:

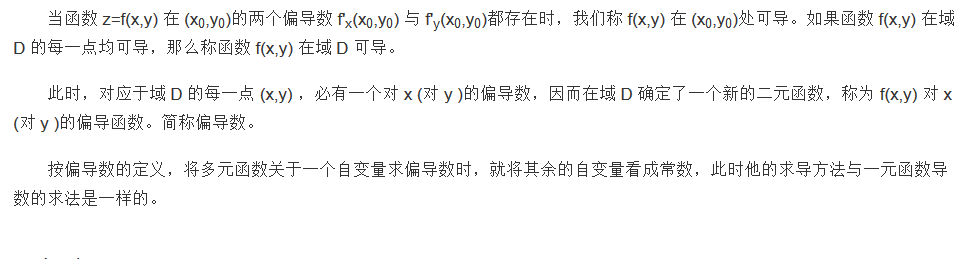

回顾:1 导数与偏导数的区别

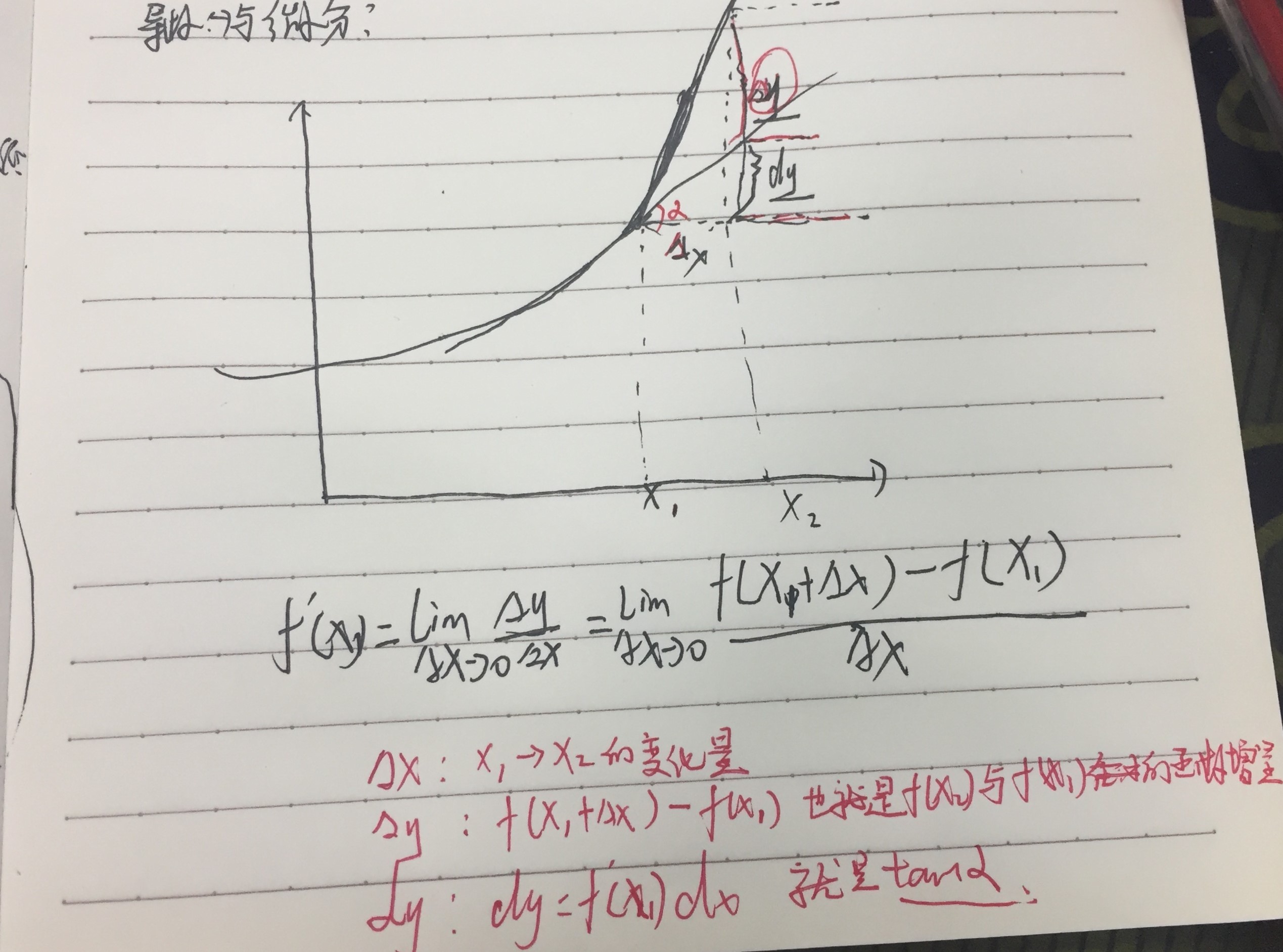

(1)导数

导数是函数某一点,沿x轴的变化率:

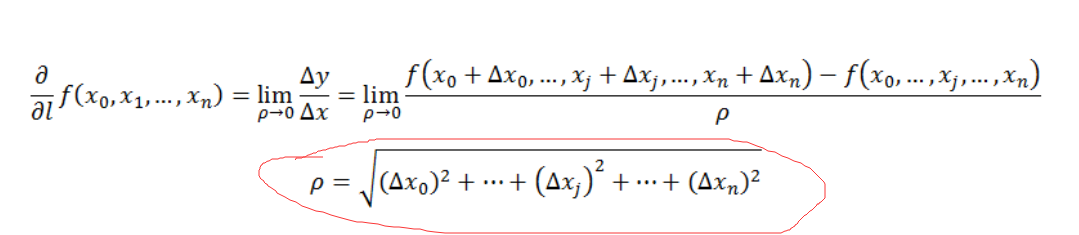

方向导数

方向导数:给一个方向,出一个实数(函数/标量场沿该方向的变化率)

方向上的导数值。

引:通俗的解释是:

我们不仅要知道函数在坐标轴正方向上的变化率(即偏导数),而且还要设法求得函数在其他特定方向上的变化率。而方向导数就是函数在其他特定方向上的变化率。

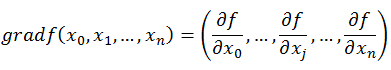

3 梯度

梯度的定义:

在函数各个点的变化率的一个向量, 向量的模就是方向导数的值

性质:--梯度是个有大小的值的向量;---最大方向导数的值(向量的模)就是梯度方向;---梯度的值就是最大方向导数的值。

通俗理解梯度:给一个函数/标量场,出一个矢量场(方向为每点方向导数值最大的方向,大小为其变化率的矢量组成的矢量场)。(参考知呼专刊)

引用@忆臻PHD Candidate个人总结的理解:

总结:

方向导数是各个方向上的导数

偏导数连续才有梯度存在

梯度的方向是方向导数中取到最大值的方向,梯度的值是方向导数的最大值

知呼专刊:里面讨论了三个问题 1 如何直观形象的理解方向导数与梯度以及它们之间的关系? 2 为什么所有方向导数中会存在并且只存在一个最大值?而不是有多个最大值、或者说没有最大值? 3 这个最大值在哪个方向取得?值是多少?

1201

1201

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?