| 论文名字 | LDP-FL: Practical Private Aggregation in Federated Learning with Local Differential Privacy |

| 来源 | 期刊 arXiv:2007.15789v1 预印本。审查中。 |

| 年份 | 2020.7 |

| 作者 | Lichao Sun, Jianwei Qian, Xun Chen, Philip S. Yu |

| 核心点 | 提出一种新型的本地差分隐私方法 |

| 阅读日期 | 2020.12.2 |

| 影响因子 |

|

| 页数 | 13 |

| 引用数 |

|

| 引用 | Sun L , Qian J , Chen X , et al. LDP-FL: Practical Private Aggregation in Federated Learning with Local Differential Privacy[J]. 2020. |

| 内容总结 | |

| 文章主要解决的问题及解决方案: 先前的联邦学习与隐私保护不能解决的三大问题:①噪声接近原始数据,增加信息泄漏的风险;②估计的平均值会引入较大的方差,从而导致较差的精度;③由于深度学习模型中权重的高维数,隐私预算爆炸。

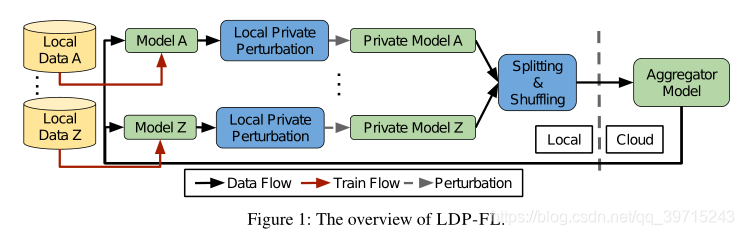

文章的主要工作: ①提出了Locally Differential Private Federated Learning (LDP-FL),一种新型的本地差分隐私方法,如图1所示。

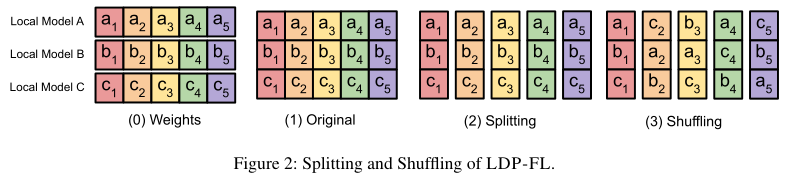

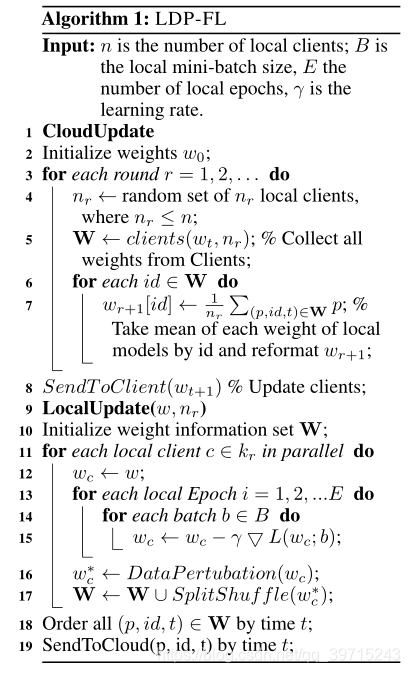

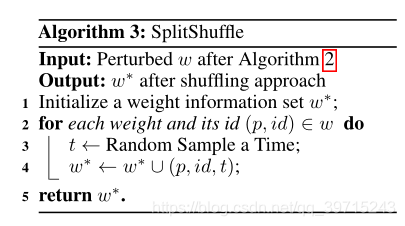

②本文的主要贡献:1)是增加噪声的扰动数据与原始数据区别更大。2)对客户端的权重使用分割和打乱是为了减轻由高数据维度和多次查询迭代引起的隐私退化。3)证明了提出的方法对平均计算引入较少的方差。 ③所提算法步骤(参考附录算法1伪代码):1)输入:n是本地客户端的数量,B是本地的mini-batch的大小,E是本地epochs的大小,γ是学习率;2)初始化权重W0 ④数据分离并打乱(如图2所示):主要目的是增强数据保护,相比于传统的机器学习,深度学习需要更多通信和权重才能使得性能更高,而导致在传统的联邦学习中会发送更多的隐私泄露。对于每个权重通过客户端将它们匿名打乱,并将每个权重及其id发送到云,其中id指的是权重值在网络结构中的位置。(数据分离与打乱的算法流程参考附录算法3伪代码)

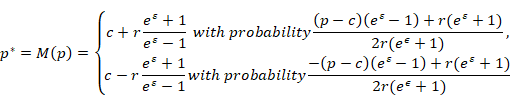

⑤增加数据扰动部分: 数据增加扰动部分如下式所示, p*=Mp=c+reε+1eε-1 with probabilityp-ceε-1+r(eε+1)2r(eϵ+1),c-reε+1eε-1with probability-p-ceε-1+r(eε+1)2r(eϵ+1) 式中,p

文章内容: 实验结果: 附录:

| |

376

376

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?