D loss 和 G loss :

LossD = Loss_fake + Loss_real

LossG = Loss_G_fake_D + 其他约束项

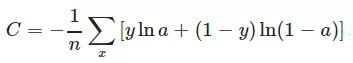

判别器 loss(BCE): BCE loss全称: Binary Cross Entropy 二元交叉熵

BCE接近0说明Discriminator可以非常容易的判别真假数据。说明Generator的训练结果不好, 理想情况下应该是无法判断真假数据才对。

GAN最重要的思想,就是让判别器D分辨不出图像到底是真实的,还是虚拟生成的。也就是说,判别器不论在哪种输入条件下,他都应该输出0.5(输出范围是0-1),就是无法分类。GAN的完美D_loss和G_loss就是0.5。那么ln0.5 ≈ -0.693

生成器loss(MSE):Mean Square Error Loss ,就是非常常见的方差

生成器loss当然是越小越好。

GAN入门基础指导:

softmax用于多分类,二分类的激活函数用sigmoid

9781

9781

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?