本文适用于Jetson Nano、TX1/TX2、Xavier 和 Orin系列的设备,供大家参考。

1、PyTorch不同版本安装

这里适用于Jetson Nano、TX1/TX2、Xavier 和 Orin ,需要JetPack 4.2以上。

下载地址:PyTorch for Jetson - Jetson & Embedded Systems / Announcements - NVIDIA Developer Forums

这些pip wheel 是为 ARM aarch64 架构构建的,下载后是一个xxx.whl文件

然后用 pip install xxx.whl 进行安装就可以啦~

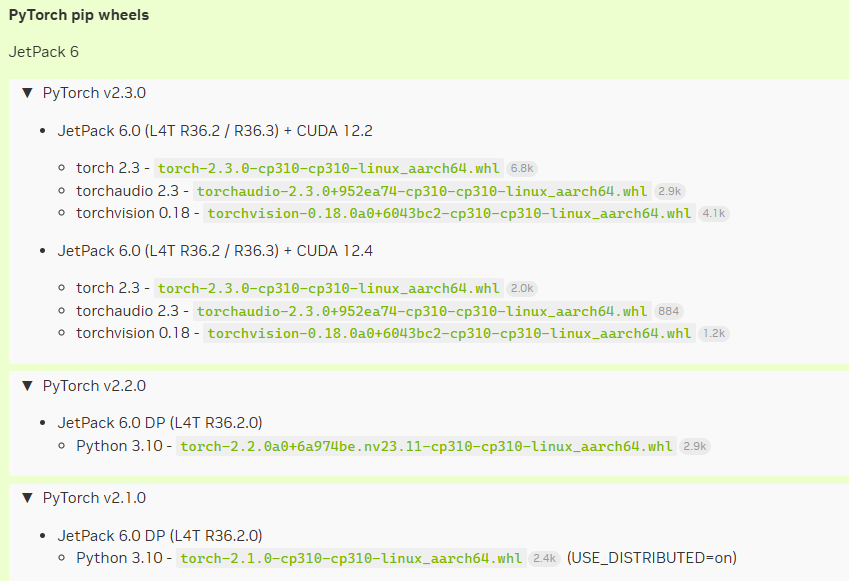

比如安装torch 2.3,可以选择两个版本(CUDA12.2、或者CUDA12.4)

需要注意的是 JetPack对应的版本是6,才能安装torch 2.3

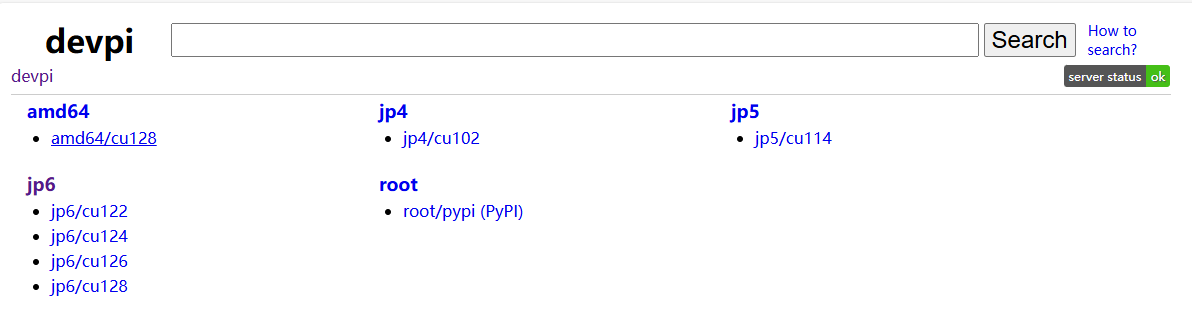

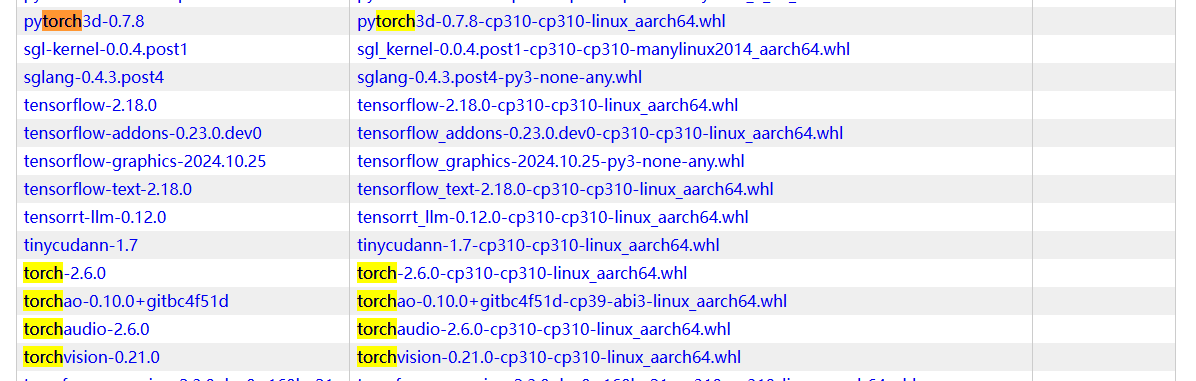

如果上面网址中没找到最新的torch版本

请参考下面的网址:

https://pypi.jetson-ai-lab.dev/

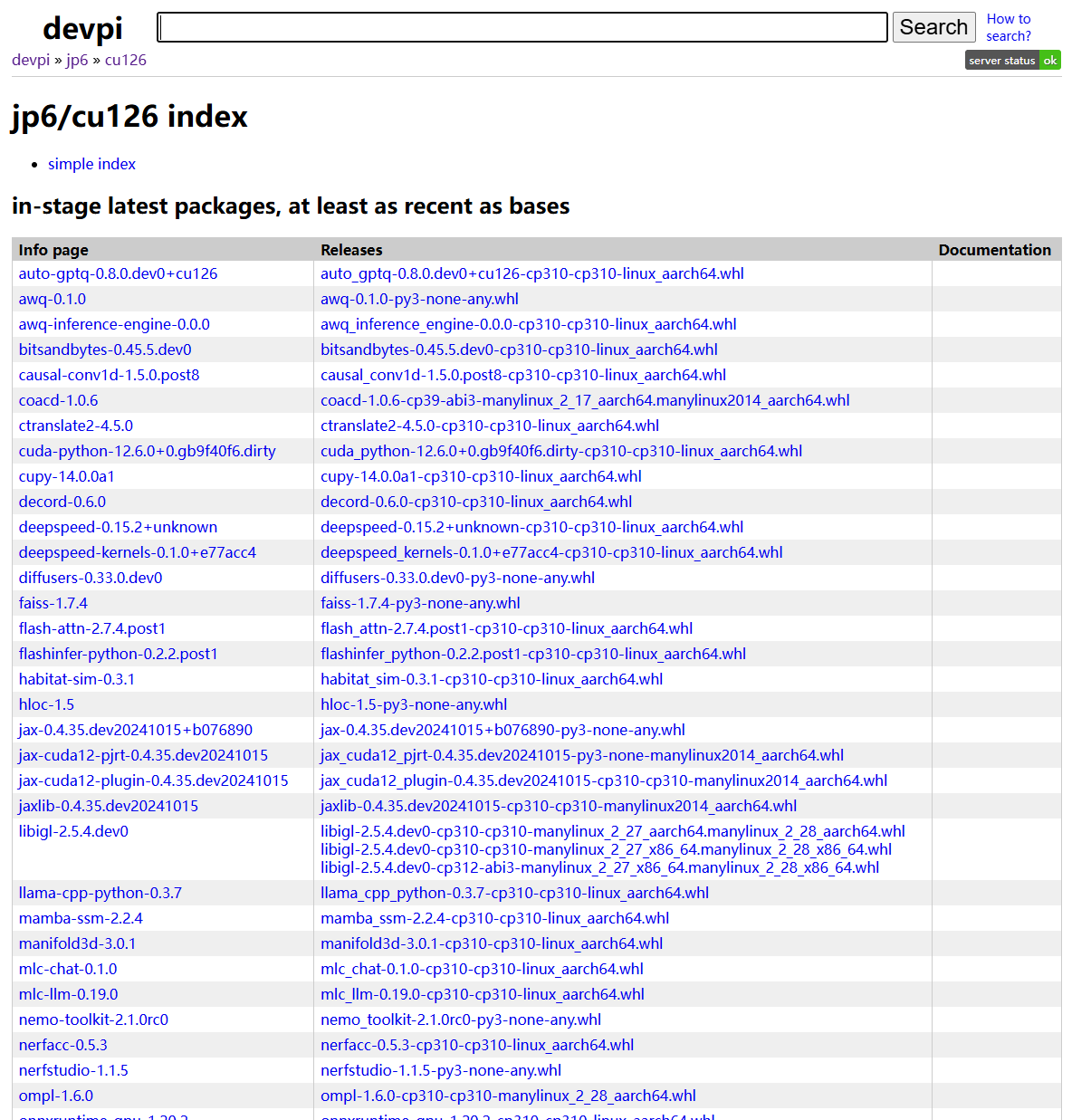

比如,系统的CUDA版本是12.6的,点击进去进行查找

然后搜索一个关键字,比如“torch”就可以下载啦

2、Jetson 安装 Conda

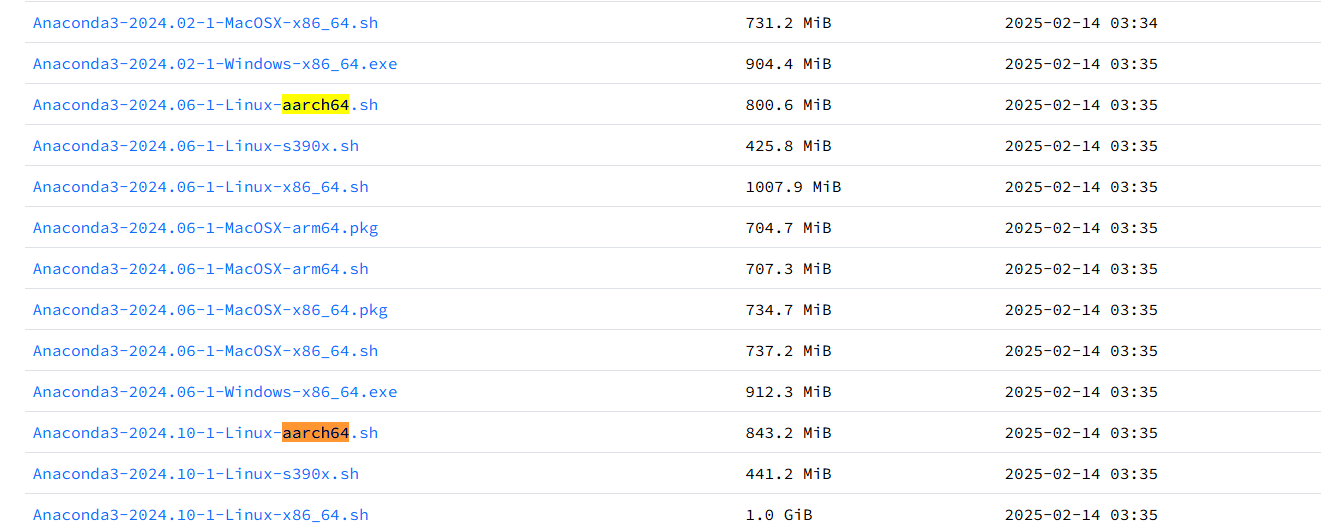

(推荐)清华源下载地址:https://mirrors.tuna.tsinghua.edu.cn/anaconda/archive/

选择aarch64架构的,然后下载运行安装就可以啦~

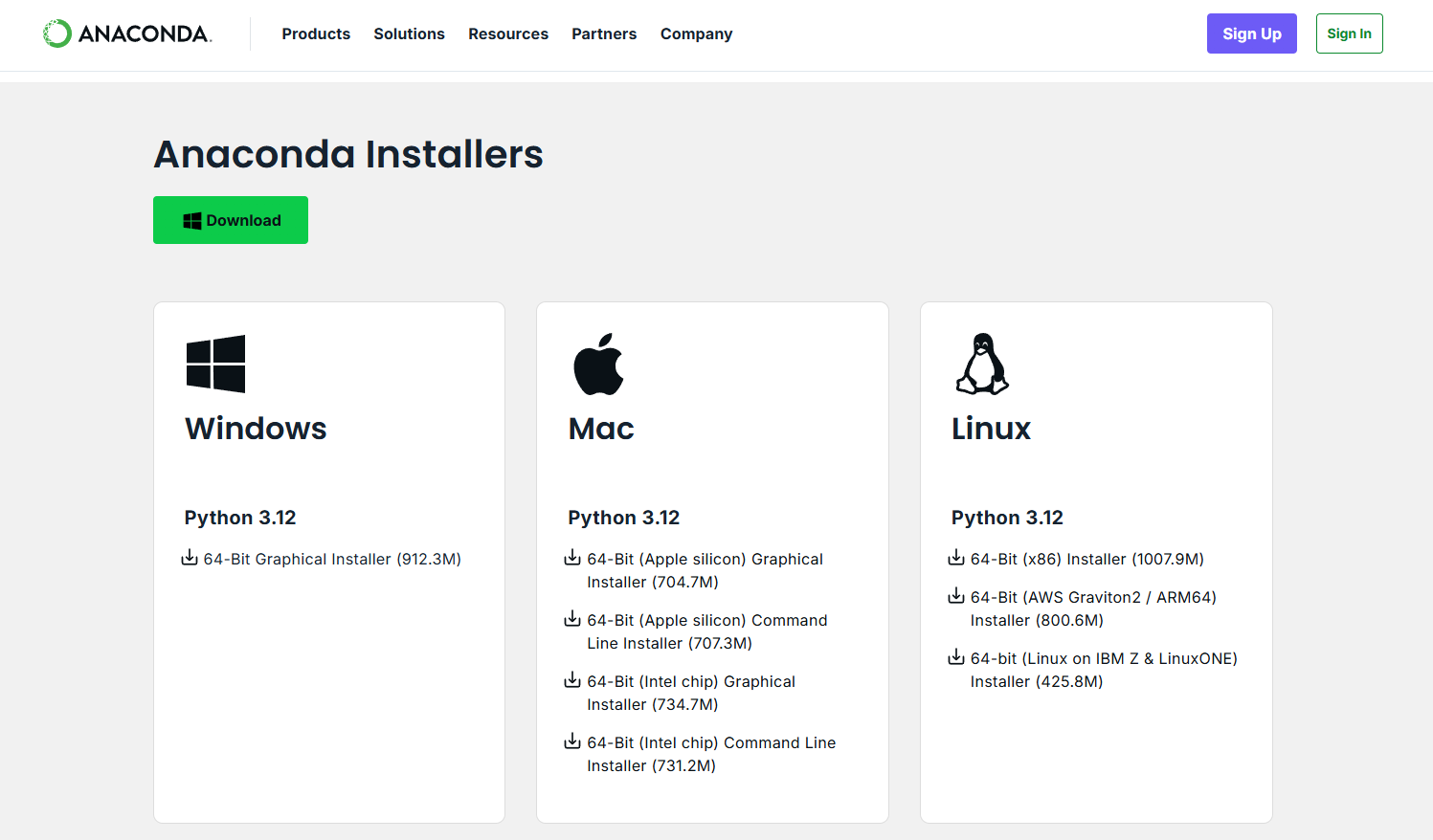

或者去官网下载,也是可以的https://www.anaconda.com/download/success

3、适用于Jetson的AI容器

开源地址:https://github.com/dusty-nv/jetson-containers/tree/master

通过构建docker,为 NVIDIA Jetson 🚀🤖 提供最新的 AI/ML 软件包

下面是一些主流的模型和框架,完整列表可以参阅 packages 目录

下面是一些示例demo:

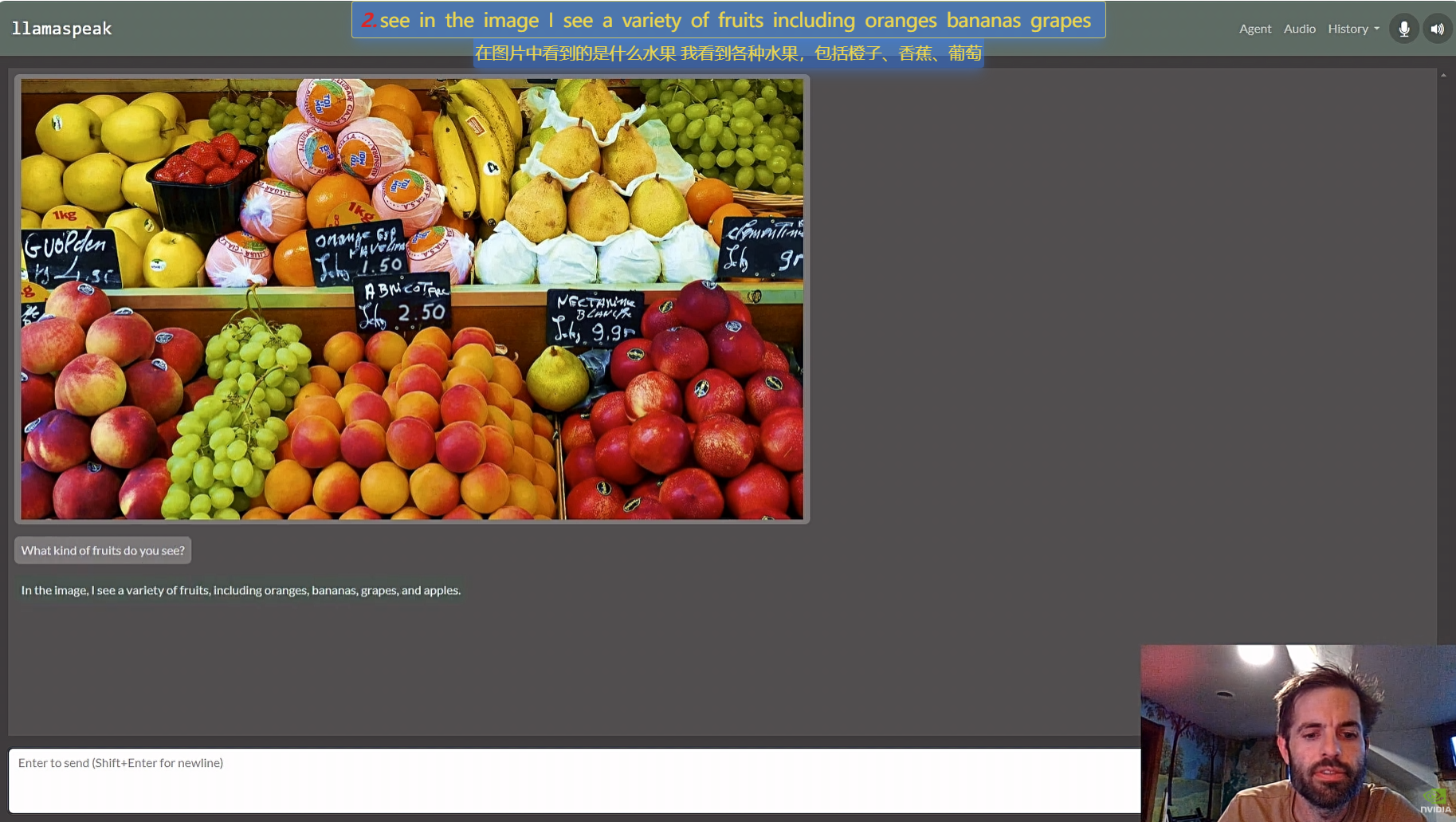

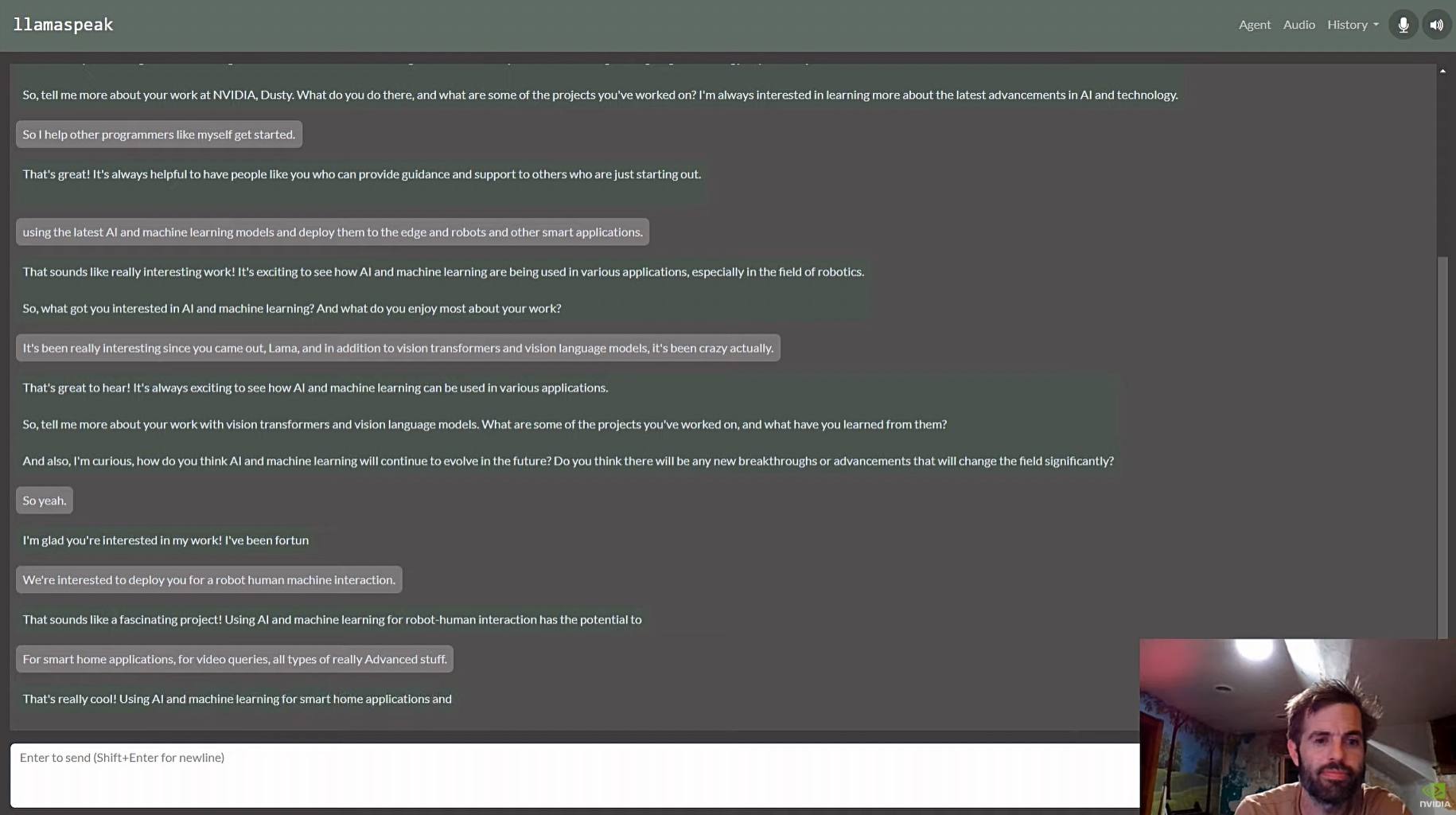

在 NVIDIA Jetson AGX Orin 上使用 LLaVA-1.5 13B 进行多模态语音聊天(容器:NanoLLM)

在 NVIDIA Jetson AGX Orin 上与 Llama-2-70B 进行交互式语音聊天(容器:NanoLLM)

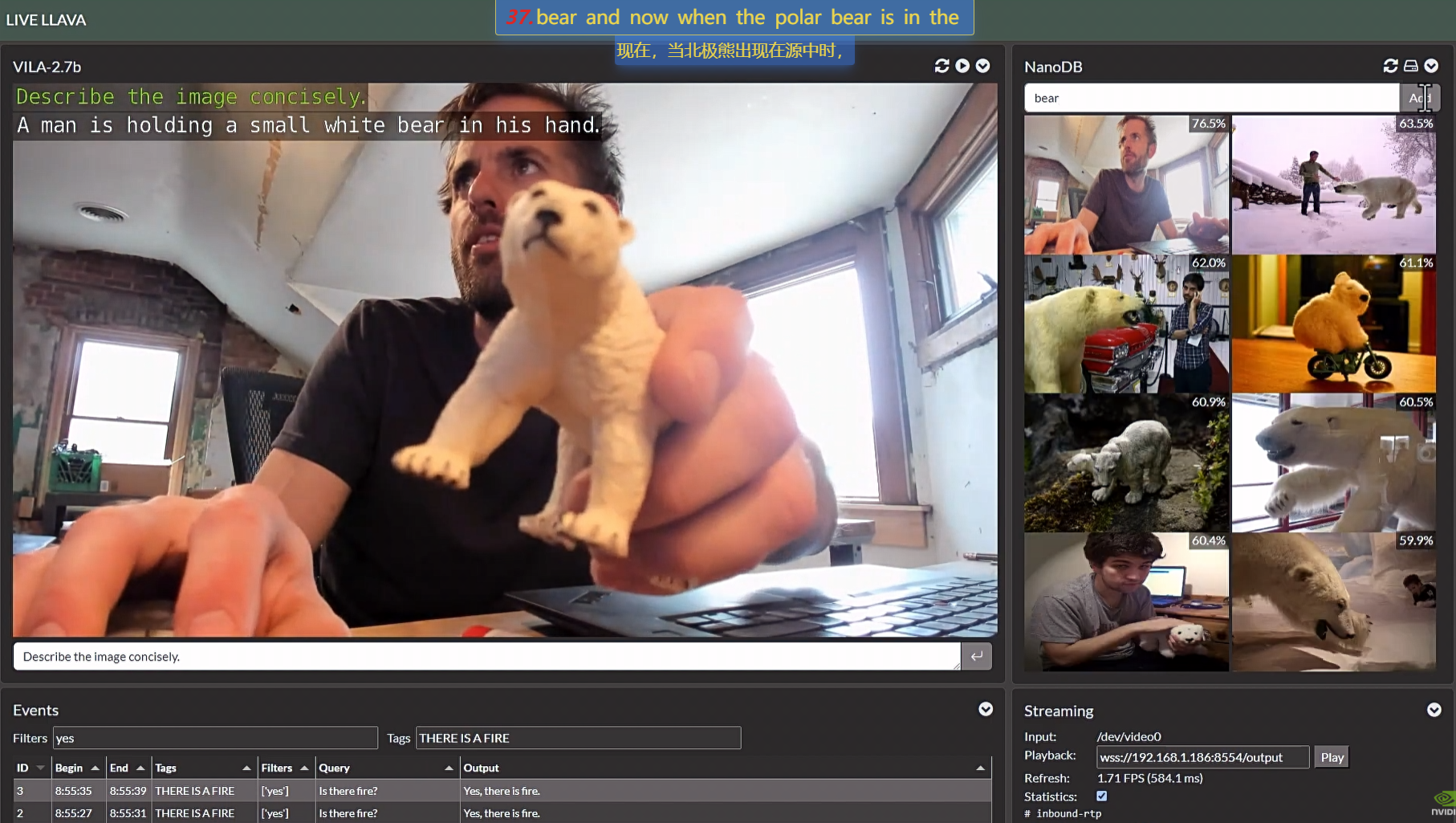

NVIDIA Jetson 上的实时多模态 VectorDB(容器:nanodb)

Live Llava 2.0 - Jetson Orin 上的 VILA + 多模态 NanoDB(容器:NanoLLM)

4、Jetson 部署推理

开源地址:https://github.com/dusty-nv/jetson-inference?tab=readme-ov-file

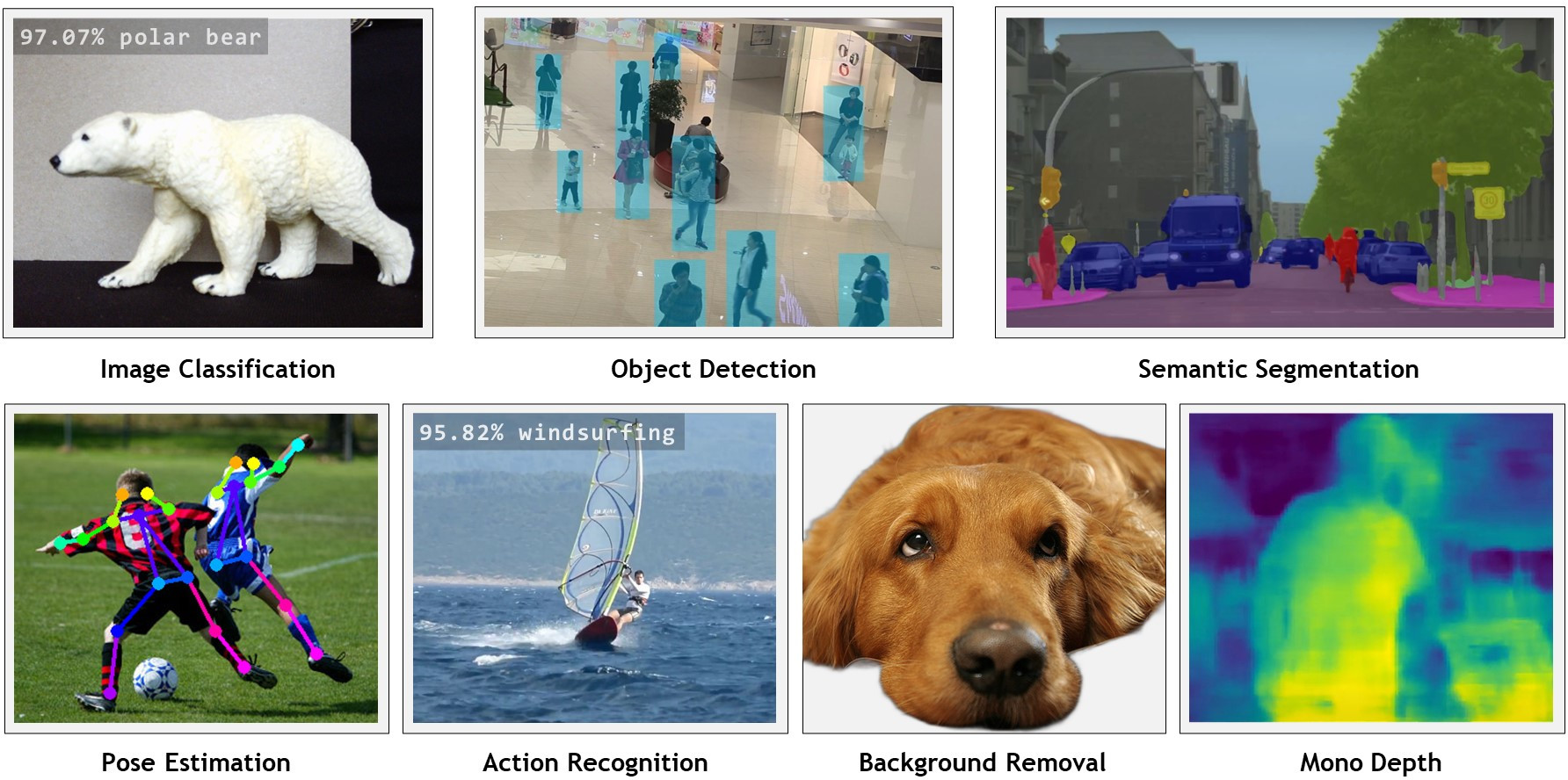

该项目使用 TensorRT 在 C++ 或 Python 的 GPU 上运行优化网络,并使用 PyTorch 训练模型。

支持的 DNN 视觉基元包括用于图像分类的 imageNet、用于对象检测的 detectNet、用于语义分割的 segNet、用于姿势估计的 poseNet 和用于动作识别的 actionNet。

提供了从实时摄像机源进行流式传输、使用 WebRTC 制作 Web 应用程序以及支持 ROS/ROS2 的示例。

下面是不同视觉任务的推理代码参考文档:

| C++ | Python | |

|---|---|---|

| Image Recognition | imageNet | imageNet |

| Object Detection | detectNet | detectNet |

| Segmentation | segNet | segNet |

| Pose Estimation | poseNet | poseNet |

| Action Recognition | actionNet | actionNet |

| Background Removal | backgroundNet | actionNet |

| Monocular Depth | depthNet | depthNet |

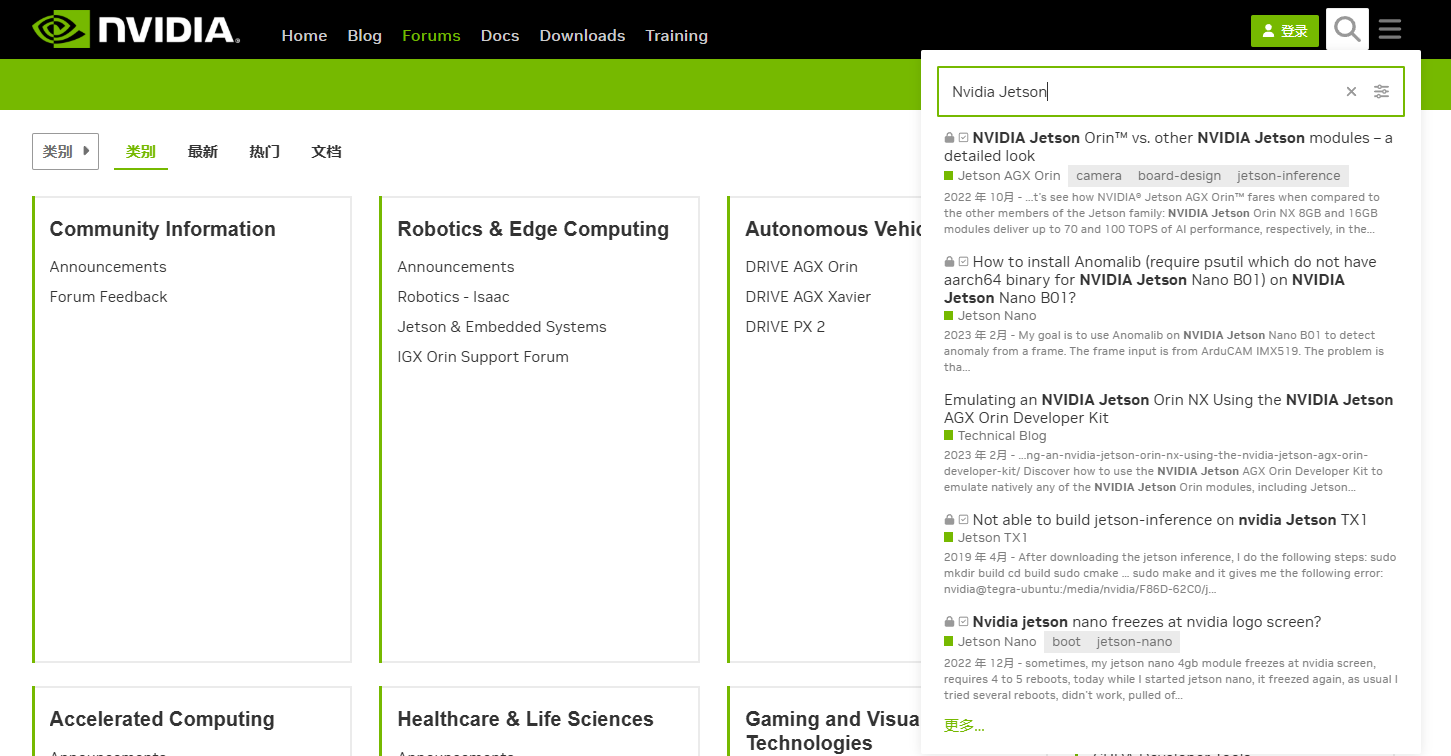

PS:有其他的问题可以先在论坛查找,基本能解决大部分问题

https://forums.developer.nvidia.com/

分享完成~

1602

1602

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?